本動画は、大規模言語モデルと視覚言語モデルの推論性能を向上させるための革新的なアプローチを提示している。従来の常識である「より長い文脈がより高い知能を生む」という概念に挑戦し、逆に文脈を削減し圧縮することで推論品質が劇的に改善されることを示す。清華大学とブランダイス大学による二つの研究論文を詳細に分析し、「検証ファースト」手法と「圧縮された座標表現」が、冗長な言語説明よりも優れた一般化性能を発揮することを解説する。誤った解答を検証させることすら推論を改善する逆説的な効果や、視覚的な詳細情報が実際には過学習を引き起こし汎化性能を低下させる現象など、直感に反する発見が多数報告されている。

文脈削減による推論性能の最適化

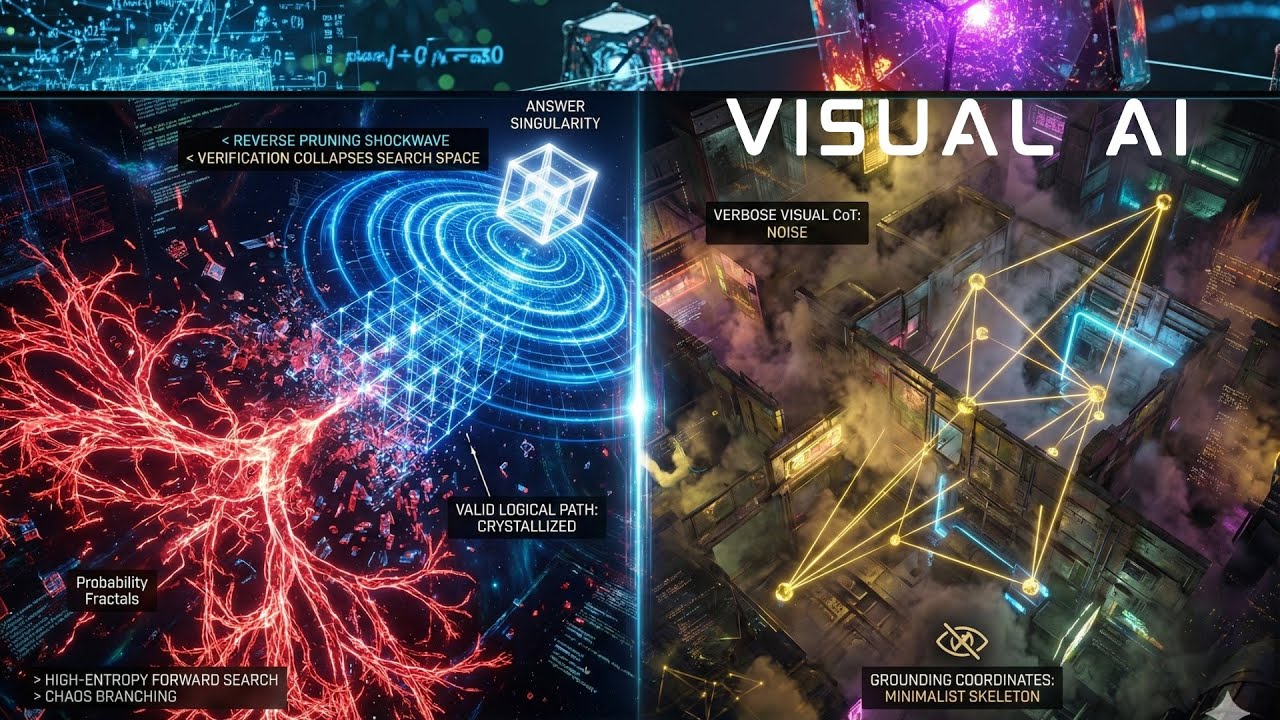

コミュニティの皆さん、こんにちは。戻ってきていただき本当に嬉しいです。今日は牛理論、牛の分岐について少しお話しします。それから高エントロピー計算を行い、確率フラクタルで少し作業します。

ご覧のように、ここには逆剪定衝撃波があり、これが我々の探索基盤において崩壊を引き起こします。そして最終的にここ、答えの特異点に到達します。これはかなりシンプルなケースだということがわかります。

そこで今日は二つ目の技術論文も扱うことにしました。これを見てください。さらにシンプルです。では始めましょう。最新のAI研究で楽しみましょう。私のチャンネル、Discover AIへようこそと申し上げておきます。

では最もシンプルな質問から始めましょう。誰もがこう言います。大規模言語モデルと視覚言語モデルの推論を改善するには、より長く考えさせなければならない、と。それだけです。答えを得るまで30分待つわけです。深い研究が進行中です。

しかし、もし私がこう言ったらどうでしょう。推論を改善するには、単に間違った答えを批評し、批判させるだけでいいと。これだけでLLMの性能が即座に向上するのです。

ご覧のとおり、今日は実用的で非常に短いながらも強力な新しいヒントについて扱います。これらを使えばLLMをすぐに改善できます。より多くのトークンからより賢いトークンへと移行しているわけです。

なぜこれができるのでしょうか。皆さんが購読者として視覚言語モデルについてより深い理解を持っているからです。

検証ファースト手法の革新性

最初の論文から始めましょう。これは清華大学、中国のトップエリート大学の一つによるものです。11月21日付けで「LLMにまず検証させることはほぼフリーランチである」と述べています。さあ、一緒にフリーランチを楽しみましょう。

ここで結果をお伝えします。マルコフ過程を見ながら、あるいは数学的枠組みを最適化する方法で、この特定のモデルは重要な何かを回避します。LLMの長い文脈ウィンドウにおけるすべての幻覚、すべてのエラーの蓄積を回避しながら、反復的に美しい解決策を導き出すのです。

つまり我々がターゲットにしているのはエラーの蓄積です。したがって、検証を行うか、あるいは単に過去のすべてを無視するという明確な中断が必要です。あなたが知っているすべてを無視して、新鮮なLLM、新鮮な目で新たにスタートするのです。

彼らはこのようなシンプルで美しい例を挙げています。迷路があり、スタート地点とゴール地点があります。二人のエージェントがいます。最初のエージェント、これが古典的なエージェントです。出口への正しい道を見つけるだけです。

ご覧のとおり、極端に広い探索空間があります。多くの可能性があります。迷路で遭遇するパターンのいくつかはそれ自体がフラクタルかもしれません。高次元空間において自己相似的な解経路を持つわけです。

では、どうやって探索空間を縮小できるのでしょうか。この人物Aにとって高い、あるいは極端なエントロピー関数があり、計算コストが高い場合、どうやってコストを最小化できるでしょうか。

アイデアはシンプルです。別のエージェントがパズルの終点に立っていると仮定するのです。非常に低いエントロピーを持ち、このエージェントには解経路が与えられます。ここをご覧ください。この黄金の経路がまさにスタート地点に逆向きに導いているのです。

何がおかしいかわかりますか。LLMにこのエージェントAで開始する前にこれを実行させると、推論プロセスにおいて遥かに優れた結果を出すのです。

これを読んで私は思いました。どうしてこれが可能なのか。コンピュータサイエンスにおけるP対NP概念を思い出してください。これは多項式時間のPと非決定性多項式時間のNP問題との違いです。

もし私が今、20,243の素因数は何かと聞いたとします。これは人工知能にとって困難な探索問題です。多くの組み合わせを試さなければならないからです。これが我々のフィードフォワード、高エントロピー関数を持つ前進エージェントが失敗する場面です。探索空間が広大すぎるのです。制約が必要です。探索空間を縮小する必要があります。

では今、私がこう言ったとしましょう。答えを教えます。101×200.42を検証してください。この掛け算を逆方向で検証すれば、これが有効な答えかどうかを数秒で確認できます。

なぜなら、今は一つの答えがあり、イエスかノーのブール値だけだからです。これが間違った答えだったらどうするのかと言うかもしれません。驚くべきことに、それは問題ではありません。間違った答えでさえ、LLMをより良い推論性能に導くのです。

これを見てみましょう。異なる答えを提供しない場合、チェーンオブソート推論を持つシステムがあるとして、非常にシンプルなMath 500テストでの精度は91%です。

別のベンチマークもあります。クエリの解は1だと伝えた場合、システムの性能は95.7%に向上します。別のランダムな数字、例えば225だと言えば、さらに少し上がります。真の答えを与えれば、全体として最高の結果が得られます。

Math 500ベンチマークを見てみましょう。ここでもチェーンオブソートで機能します。しかし、まずこの結果が1であることを検証してくださいと伝えた場合、これは完全にナンセンスですが、構いません。チェーンオブソートよりも良い性能を示します。

別のランダムな数字、実際には同じランダムな数字ですが、ほぼ同じ性能、チェーンオブソートよりはるかに優れています。真の答えを与えれば、向上します。ほぼすべてのベンチマークでこれが見られます。

どうしてこれが可能なのかと言うかもしれません。システムに思考を始める前に、これが有効な解であるか検証してから、チェーンオブソート推論プロセスを開始してくださいと単に尋ねるだけで、はるかに良い結果が得られます。

本当に飽和したベンチマークではそうなりませんが、ここを見てください。42、44、43、50です。私はこれを受け入れます。たった5語で性能を最適化できるなら、受け入れます。

なぜこれが起こるのでしょうか。見てみましょう。彼らはここに美しくシンプルな例を挙げています。一年のうち28日ある月はいくつありますか。ステップバイステップで考えてください。チェーンオブソートなどなど。

古典的なモデルの出力は、答えは1つ、2月だけが正確に28日です。

何が起こったか見てください。このチャンネルの購読者として、我々はもう少し賢明になったと想像してください。これが質問する間違った方法だと正確に知っています。

では、こう言います。一年のうち28日ある月はいくつですか。そして今、このトリックを統合します。答えは1だと思いますが、これはおそらく間違っています。まず私の答えを検証して、質問を満たすかどうか確認してください。それから通常のステップバイステップで正しい答えを見つけてください。

異なる答え、異なる性能はないだろうと推測するかもしれません。これは間違っています。モデルの出力を見てください。オープンな推論トレースモデルがあれば、こう言います。

まず答え1が正しいか検証します。この推測は1つの月だけが28日あることを意味します。これは「正確に28日ある月はどれか」という質問の解釈に依存しています。しかし、質問は「28日ある月はいくつあるか」でした。

これは28日目を含む月はすべて該当するという意味です。したがって12ヶ月すべてが基準を満たします。正しい答えは12です。

答えについて議論し、答えを批評し、この1がどのように有効な答えになりうるかの解釈を見つけようとすることで、正確に28日と単に28日の間に違いがあることを発見したのです。

これを著者は検証ファースト推論プロンプトと呼んでいます。これを使ってください。試してください。私自身も経験しました。機能します。本当に驚くべきことです。このようなシンプルで愚かなことが機能するのです。

Qの可能な答えはAではなくAダッシュだと言います。まずAダッシュが正しいか検証し、それからステップバイステップで答えを見つけてください。ほぼすべてのLLMで機能します。

次のステップに進むこともできます。1ステップでこれがあるなら、反復的なチェーンオブソートがあったらどうなるかと。同じ方法論を使います。

古典的なチェーンオブソートがあり、不正確な答えを得たとしましょう。反復プロセスのために同じ方法論を使います。質問は同じです。与えられたタプルリストで利用可能なペア間の最大差を見つける関数を書いてください。

ステップバイステップで考えた後にコードを出力すると言う代わりに、初期解が可能で実行可能だと言います。これが純粋なチェーンオブソートからの不正なコードです。

それから続けて、提供された解がクエリを満たすかどうか最初に確認すべきだとAIに伝えます。満たさない場合は、通常の手順でステップバイステップで正しいコード実装を見つけてください。

純粋なチェーンオブソートによる初期解はコードでしたが、不正なコードだとわかっています。しかし質問に対して不正な答えを提供することでさえ、AIシステムの推論性能を加速し向上させるのです。

なぜでしょう。見てください。AIは考えて言います。この初期解はペアのすべての要素にわたって最大値と最小値を計算します。しかし、これは必ずしも同じペア内の任意の二つの値間の最大差を与えるわけではありません。

各個別のペアの二つの値間の差を考慮し、見つかった最大差を追跡する必要があります。

ご存知のように、人間についても言います。ドイツ語で多かれ少なかれ、間違いによって学ぶと言います。間違いを犯すことが学習プロセスを加速させるのです。まさに同じことがここで起こっています。

不正確な、誤った答えは学習プロセス自体にとって価値があります。なぜならモデルに議論し、推論し、検証し、妥当性を確認し、考える基盤を与えるからです。そしてより良いステップバイステップの推論プロセスを進めることができます。

トークン投資と推論手法の比較

シンプルな質問があります。より多くのトークンに対して支払う意思があるなら、思考モデル、深い推論モデルを選ぶとしましょう。ここで10分の計算時間があります。素晴らしい。トークンに対して支払わなければなりません。

では、最良の、あるいは本当に良い答えを得るために、現在ある古い方法論のうち、5ドルの投資あるいは2ドルの投資に対して最良のリターンを与えるのはどれでしょうか。

競合は何でしょうか。まず古典的な自己修正または反省方法論があります。LLMが答えを生成し、視覚言語モデルが答えを生成し、それから前のステップを振り返り、エラーを見つけて修正するようプロンプトされます。

会話履歴全体、入力と試行1、批評と試行2がモデルに、プロンプトにフィードバックされます。

なぜこの方法論は通常失敗するのでしょうか。推論し、文脈オーバーフローし、幻覚の蓄積、推論チェーンにおけるすべての幻覚の集約が起こります。なぜならモデルは自身の以前の間違った、不正確な、幻覚化された思考を見るからです。

混乱する傾向があります。突然、Aは真でありAは真でないということになるからです。ではモデルは何をすべきでしょうか。時にはその初期のバイアスを倍増させ、自分自身の、これは良い表現ですが、思考の列車から逃れることができません。

この入力、試行1、批評、試行2、そして幻覚が推論トレースに顕在化しています。

二番目の競合者は自己一貫性です。これは総当たり方式の業界標準です。どうやるか知っていますよね。LLMに独立した推論経路をサンプリングさせます。例えば10の推論経路、それから多数決を取ります。LLMあるいは他のLLMがこれに投票します。

なぜこれが失敗するのでしょうか。多数派も間違う可能性があるからです。少なくとも理論的には。しかし確実に訓練データ、事前訓練データと構築された複雑性レベルによって制約されています。

複雑性レベル2で訓練された10、20、100のAIエージェントがいて、突然、複雑性レベル5の複雑な問題に多数決で投票するとしましょう。どうなりますか。すべてのレベル2のAIエージェントは間違った結論に達します。

なぜなら重力について話すべきかもしれませんが、アインシュタインについて聞いたことがなく、ニュートンについての推論や学習を止めたので、彼らの複雑性レベルに制約されているからです。

上級ユーザー向けに、自己一貫性と同様に、ベストオブN方法論があります。投票の代わりに別の報酬モデルがあります。ドメイン特有の複雑性レベルに適応した特定の報酬関数を設計し、それから特定のスコアを割り当てます。

スカラースコアかもしれませんし、より高い複雑性スコアかもしれません。これは多次元スコアで各解決策にスコアをつけ、最高の確率分布を選びます。これは本当に競争力がありますが、通常、別途訓練された検証器が必要です。

訓練データを構築し、広範なスコアリングトークンの複雑性を持たなければなりません。数学的に構築し、訓練データを構築する必要があり、すぐにこれは本当に高価だとわかります。

実験データが示す最適手法

では、どこに投資すべきでしょうか。最良の推論モデルを得たいなら、教えてください。美しい解決策を提供してくれます。

ここにQwen 2.5 14Bインストラクトと、古き良き祖父のLLaMA 3.1 8Bインストラクトがあります。古いモデルが多かれ少なかれ同じように振る舞うか見たいからです。

これを見てください。青は最初の競合者、自己修正でした。精度が下がり、下がり、下がっています。出力トークン数が増えるほどです。忘れてください。両方で起こります。

緑は自己一貫性です。ほぼ線形です。少しですが。素晴らしい。それから何があるでしょう。赤、ベストオブN、本当に複雑なものです。あまり良くありません。少し良いですが、時間が経つにつれて報酬関数が定義されているので進歩しますが、それ以外はまあまあで、忘れてください。

それからトップ2があります。彼らはここで検証ファーストの二つの異なるバージョンを使いました。説明したように直接検証ファーストから、これは紫の線です。それから不正確な結果を使わないと言います。

うまくいけば正しいチェーンオブソートを使います。より投資して、より高いNEOから始めましょうと言います。なぜなら既に別のLLMにより良いパフォーマンスのためにチェーンオブソート推論経路を提供するよう依頼しているからです。

両方のスコアがトップパフォーマーであることがわかります。異なるMath 500タスクで81%のパフォーマンスまで上がります。他のすべての方法を上回ります。

支払いたいなら、81%か、この方法論で74%のパフォーマンス精度を得られると想像してください。このテストにとって良いアイデアを与えてくれます。この検証ファースト方法論について考えるべきでしょうか。

しかし奇妙なことがあります。このチャンネルの購読者でなければ気づきもしなかったでしょう。なぜなら自己修正は履歴を保持していて失敗します。

しかしこれは、文脈が必要だ、文脈エンジニアリング、より多くの文脈がより良いという考えに反していませんか。しかし見てください。青は最大の文脈を持っていて、最悪のパフォーマンスです。

一方、両方のLLMで紫の線を見てください。履歴を完全に削除します。履歴で何が起こったか完全に盲目だと言います。現在のステップだけを見て、t+1の次のステップを予測します。それだけです。

文脈について何も知りません。過去の推論の複雑性について何も知りません。何もです。これは矛盾ではありませんか。なぜなら推論に長い文脈ウィンドウが必要だという考えを殺しているからです。

説明しなければなりません。最初にアダムとイブがいて、創造されて、などなど。これは完全な健忘症を持つエージェント、推論経路を忘れて最新の現在の出力だけを批評するエージェントが、自分自身の履歴に執着するエージェントよりもスケールするということです。

より少ない履歴、より少ない文脈の方が良いのです。記憶が自己改善ループにおいて負債にもなりうることを証明しています。

これは、LLMと視覚言語モデル自体に問題があることを示しています。なぜなら正反対であるべきだからです。他の人たちが持っていた理論、検証が視覚言語モデルにおける本当に異なる認知モードであるという理論を検証します。

視覚言語モデルでこのスイッチを起動すると、検証を行うと、視覚言語モデルに答えを見て検証しようとさせることを強制し、新鮮な目のように作用します。

自分自身の仕事を批判する新しいエージェント実行をシミュレートするようなもので、同じエージェントが自分自身の雑然としたメモを修正しようとしたり、自分自身のバイアスを強化したり、ますます自分のバイアスの渦に陥ったりするのとは異なります。興味深いです。

文脈削減の重要性

しかし何が起こっているか見てください。幻覚や不正確なバイアスのエラーを減らそうとしているので、タイムラインを切り離して過去を捨てると言います。現在だけを見るのです。複雑性と幻覚の再正規化に問題があります。

これが結果で、ダミーの答え1から始めるか不正確な答え1から始めると言い、それからチェーンオブソートの答えに投資しました。

まず、著者がここで色分けされたラベルを交換していないか確信が持てません。チェーンオブソートから始まる、チェーンオブソート推論で始まる紫のものが、不正確な答え1を与えた場合よりも高いパフォーマンスを持つことは理にかなっています。

しかし彼らは紫のものがダミーの答え1からだと主張しています。1の方がチェーンオブソート推論よりも最初から高いパフォーマンスを持つことになります。彼らがこれを混同していないか確信が持てません。

しかし、コメントを残してください。本当に興味があります。とにかく、他の効果を見てください。見えますか。わずか数回の反復の後、ダミースタート方法論がチェーンオブソートスタート方法論に追いつきます。

不正確な答えで始めるか、正しいチェーンオブソートの複雑な推論経路で始めるか、2、3000トークン後には関係なくなります。

初期シードの品質は関係ないと言うかもしれません。信じられない。これは、検証メカニズム自体が機械知能の引用符つき知能のドライバーであるという考えの肯定ではありません。

どの値で始めるかではありません。なぜなら絶対に不正確な値で始めるかもしれませんし、可能な限り最良の正しい値で始めるかもしれません。関係ありません。

検証メカニズムこそが改善された推論プロセスにとって重要であり、ランダムな推測を修正するのと同じくらい効果的に、推論されたチェーンオブソートの試みを洗練させるのに十分堅牢なのです。

したがって、良いお金を無駄にしないでください。チェーンオブソートを生成し、良い最初の引き出しを望むなら、より高い台地、より高いレベルからスタートしたいなら、忘れてください。

検証ループに飛び込んでください。考えられる最も愚かな結果を取ってください。円周率だと言うかもしれません。モデル自体がほぼ即座に天井性能まで自己修正します。

二つ目の研究があると言いました。これは本当に素晴らしいです。まさにこのトピックに近いです。これは中国のブランダイス大学とバンシードで、視覚中心の推論汎化モデルにおける長いチェーンオブソートの必要性を再検討するというものです。

まったく同じトピックです。また視覚言語モデルについてです。Qwen 2.5視覚言語モデル、残念ながら7Bではなく、Qwen 2.5視覚言語8Bでもありませんが、一世代遅れています。これは2025年11月27日です。

何を伝えたいのでしょうか。より多くの文脈を提供するために、より長いチェーンオブソートを持つ必要はないということです。対応するメールアドレス、プロジェクトページ、すべてあります。GitHubもあり、すべて利用可能です。

しかし主な結果に焦点を当てましょう。視覚言語モデルがあり、標準的な教師あり微調整を行い、その後Q1に最適化された強化学習を行います。バンがやるなら、最良の方法論、コンピューターインフラを持っていることがわかります。素晴らしいです。

しかし3つの異なるデータフォーマットを見てみようと言うだけです。まず純粋な言語チェーンオブソートで行きます。起こっていることすべて、迷路トピックを例にとって、迷路を通る経路をテキストで記述します。

スタート、北に移動、次に西に移動、それから、わかりますね。視覚的知覚が今、テキスト抽象化シーケンスになります。

それから、この情報を圧縮しましょう、グラウンディングチェーンオブソートで行こうと言います。彼らはこれをGチェーンオブソートと呼びます。モデルが座標タプルを出力します。

XY座標系があれば、1,1から2,2へ行くという具合です。迷路を通る経路の視覚的知覚が今、空間座標のシーケンスに変換されます。

それからもちろん純粋な視覚的チェーンオブソートで行きます。この迷路を上から見下ろすと想像してください。スタートから終わりまでの完璧な経路を示す線が見えます。

この経路が画像上の線、長方形の線で、ここに新しい視覚状態を作り出します。迷路プラス完璧な経路があり、これは視覚的知覚です。迷路を通る解決経路を挿入したので、視覚的操作に移行しました。

これが重要です。唯一の違い、絶対的に唯一の違いは、モデルが出力するように訓練される推論トークンのフォーマットです。チェーンオブソート、解決策です。

テキストフォーマット、抽象化された数学的圧縮XYZフォーマット、あるいは画像で行き、スタートから終わりまでの解決経路を画像に刻印するかが重要かどうかと言うかもしれません。

ここに再度あります。言語ですべてを記述し、それからグラウンディングがあり、0,3から1,3、2,3、3,3と行きます。素晴らしいのは、グラウンディングチェーンオブソートリーストもあることです。

グラウンディングには最小限のテキスト記述があります。スタートしてから、西への唯一の利用可能な移動があるので行くと言い、それから座標系を与えます。

グラウンディングチェーンオブソートリーストには言葉がありません。線形シーケンスのXYZ座標だけです。それだけです。

視覚的チェーンオブソートでは、なんてことでしょう、文脈を提供します。テキストと言葉と説明と座標系があります。ステップをリトレースし、ジャンクションまで戻り、そこでこれを行い、それから迷路に線を描きます。

すごい、視覚的チェーンオブソート。視覚的チェーンオブソートが最高のパフォーマンスシステムになると思うでしょう。

いいえ、見てください。特定の迷路の訓練精度があり、訓練サイズが6×6まで行きます。Y軸の訓練精度を見ると、ここで行うステップ数に応じて大きな違いが見られます。

青はゼロ強化学習です。訓練プロセスに強化学習が必要です。受け入れてください。しかし緑があります。緑は迷路の言語チェーンオブソート記述です。

真ん中のオレンジがグラウンディングです。赤で行くと、これが純粋な視覚的なものです。すべての大量の文脈と記述と線形と何やらを持つ純粋な視覚的なものの精度を見てください。

学習プロセスが極めて速く、それから高原状態になります。これらの線を描く特定のメカニズムを学習し、ピクセル空間にいて、ピクセル操作があります。これは極めて効率的です。

しかしパスエイトの訓練精度を見ると、多かれ少なかれ同じです。今、赤がすべてを上回っています。それからグラウンディング、それからこの貧弱な言語記述があります。素晴らしい。

次の非訓練ステップに行きます。分布外で、7×7の迷路に行きます。AIはこの複雑性を迷路で見たことがありません。どのようにパフォーマンスするでしょうか。

再び赤は今、ここの100%から最大60%に落ちています。しかし赤が最良で、同じ特性があることがわかります。

画像で考えるというのは、単純化して呼びましょう。赤は訓練中に極めて密度が高く、高度に凝縮された情報、高いシグナルフィードバックループを提供します。

しかし最後に、これを見てください。すべてのモデルが収束し、高原状態になります。例えばここで100%、ここで100%、見えない迷路があっても、見てください、すべてが一緒になります。赤、オレンジ、緑がすべて同じレベルです。

時間量、したがってお金の問題だけです。これは興味深いです。すべての追加情報を持つ視覚的チェーンオブソート、テキストと画像が今、足場として機能しますが、ロケットエンジンとしてではありません。

なぜなら、ここで100%に制限されていない場合、例えば20%にスケールダウンした場合、赤が上回ると期待していたからです。他の2つのように高原状態にならず、赤は空に向かってまっすぐ行くでしょう。そうなりません。推論において同じ限界があります。

赤は推論プロセスにおける視覚的複雑性の最適化を加速します。学習速度です。追加の画像がタスクを最初に理解しやすくします。AIがテキストと画像で訓練されているからです。

しかしモデルの基本的な推論能力を増加させません。最終精度を増加させません。驚くべきことです。なぜなら赤がここで止まりますが、オレンジが続くからです。

グラウンディングがここで視覚からの解決策を克服します。何が起こっているのでしょうか。理解しましょう。

これを見てください。2つだけを選択し、オレンジにグラウンディングチェーンオブソートのリーストバージョンがあります。訓練プロセスのために座標タプルだけを出力する短い方法です。

推論テキストなし、描画なし、視覚的なものなし、何もありません。0,0から0,1、0,1から1,0というシーケンスだけです。

それから青に完全な視覚的チェーンオブソートがあります。再び最大9×9の迷路サイズで訓練し、9×9でパスの訓練精度を持ち、それから10×10の迷路に挑戦し、汎化がどれくらい良いか見ます。

9×9から10×10の迷路へは本当に汎化ではありませんが、次の小さなベビーステップです。何が見えますか。視覚的なものが上回っていません。

なぜでしょうか。なぜ突然、視覚的なものが良くないのでしょうか。なぜ突然、グラウンディングチェーンオブソートのすべての言葉を省き、今、最適化された圧縮されたチェーンオブソートを持つと、私が示した最後のグラフとは異なるオレンジですが、さらに圧縮してGチェーンオブソートを削減すると、すべてのパス精度と分布外精度テストで視覚的なものを上回ります。

どうしてこれが可能なのでしょうか。何が起こっているのでしょうか。

著者は、強化学習段階で発見した直感に反する結果だと言いました。収束です。視覚的チェーンオブソート、画像上の線の描画が最も速く収束します。赤い線が美しく上がっていくのに気づきましたね。

しかしここでの視覚的フィードバックは強いシグナルを提供するので、これを理解します。しかし汎化は、短いグラウンディングチェーンオブソートリーストで訓練されたモデルです。

座標だけ、説明なし、追加の文脈なし、何もなしが、見えない大きな迷路サイズに最もよく汎化します。どうしてこれが可能なのでしょうか。なぜ起こるのでしょうか。

興味深いことに、視覚的チェーンオブソートが停滞するという解決策に到達します。10×10より大きな迷路構造を解くのに本当に苦労します。なぜ訓練に入っているのでしょうか。

この視覚言語モデルが線を描くプロセスに過学習したからです。100×100ピクセルグリッドに線を描くこと、あるいは小さな迷路は、ピクセル空間自体において構造的に異なります。

画像について考えないでください。ピクセル空間の複雑性だけが、はるかに大きな迷路のより密なグリッド上に描くことと異なるのです。自己相似構造ではないのかと議論するかもしれません。

しかしこの視覚的ツールが松葉杖になり、環境がスケールアップしたときに壊れました。訓練プロセスから、モデルは焦点を当てるべき論理を理解しませんでした。

しかしモデルは線を描くプロセスに過学習しただけで、なぜここからここへ線を描くのかを理解していませんでした。その背後にある論理は何か。単に線を描くことに奇妙でした。

座標系だけのグラウンディングチェーンオブソートリーストは上昇し続けます。示したように、視覚的チェーンオブソートを大幅に上回ります。

グラウンディングチェーンオブソートの複雑性をさらに削減すると、全体的に最良の結果がもたらされます。なぜでしょうか。視覚言語モデルに座標XとYだけを出力させることを強制することで、他のモーダル議論、他のモデルのノイズパターンからすべてを取り除きました。

モデルは描画ハックや冗長な記述に頼ることができませんでした。左に行き、ここから始めて、戻って、再描画するなど、何もありません。

何もありません。このXY座標系上の経路発見の抽象アルゴリズムを内在化するために、経路の最小限の表現を本当に強制されました。他には何もありませんでした。推論プロセスを妨げる言葉のサラダはありませんでした。

これは、今、靴下をしっかり持っていてください、抽象化された削減された論理が最もスケールし、ピクセル操作はしないということです。

信じるであろうこととは反対に、テキストと画像があり、画像が起こっていることの多くを説明するかもしれません。視覚言語モデルによって学習されるこのピクセルの複雑性とピクセル操作はスケールしません。

ドメイン知識、視覚的複雑性、複雑性サイズに極めて制限されています。抽象論理を汎化することはできません。抽象論理はできます。これは単純ですが、目で見なければなりません。

したがって、長いチェーンオブソートで、言語であれ言語と視覚であれ、視覚言語モデルに言語的説明のパターンに過学習させます。焦点を当てるべき基礎となる空間論理ではなくです。

視覚的チェーンオブソート、この線描画アルゴリズムはパフォーマンスの天井に達しました。なぜならモデルが中間的な視覚的成果物、線を描くことに依存するようになったからです。純粋なXY座標シーケンスで起こった抽象的経路発見を学習する代わりに。

したがって、視覚言語モデルにクエリや仕事を依頼するときは常に、どのように削減し抽象化してすべてを取り除き、核心の質問だけを尋ねることができるか考えてください。

必要のない説明をしないでください。何かを言ってあちらに見えるものを言わないでください。純粋な厳しい事実だけを与えてください。訓練プロセスで学習しなければならないからです。

それらのオブジェクトだけに焦点を当てなければなりません。訓練プロセスに入れるテキストが多いほど、妨げられる可能性があります。絶対に魅力的だと思いました。

洞察は何でしょうか。視覚言語モデル、この長いチェーンオブソート、テキストまたは視覚的編集の両方が、間違った方法で訓練分布への過学習を誘発する可能性があります。

最も堅牢な推論、視覚的推論は、視覚言語モデルに思考プロセスを可能な限り最も厳しい制限された部分空間表現に圧縮することを強制したときに現れます。

座標のグラウンディングのみ、言語的記述なし、表面レベルのパターンマッチングではなく、基礎となる空間ルールを学習することを強制します。ハードコアな数学で行ってください。

それが最良の方法です。

したがって、皆さん、質問に答えましょう。より長い文脈、より高い文脈エンジニアリングが、LLMにより高い知能を本当に提供するのでしょうか。

迷路について視覚言語モデルにあまりにも多く話させると、この美しい言語的ボトルネックを作り出すことを分析しました。言語統計を使用して視覚的問題を解決しようとし、もちろん迷路サイズが変わると失敗します。

絶対最小表現に制限することで、パズルや仕事が論理的に一貫したシーケンスで表現される最小の部分空間を見つけることができます。我々の場合、それはグラウンディングチェーンオブソート抽象です。

視覚エンコーダーの空間表現に頼ることを視覚言語モデルに強制し、したがって最良の結果を得ます。

したがって、これは間違った主張です。より長い文脈ではなく、より賢く、より圧縮された、より高度に知的な文脈の表現です。長い必要はありませんが、数学的、理論物理学の観点から極めて強力です。

情報を小さな部分空間における最小表現に圧縮します。これが最高の知能を得る方法です。

今日少し楽しんでいただけたことを願います。本当にシンプルでした。ここに二つの小さな論文があっただけです。しかし非常に興味深いと思いました。

これら二つの国際グループによるこれら二つのPDFに、直感に反する美しく詳細な数学的説明があるのを見たとき、これをお見せしなければなりませんでした。

楽しんでいただけたことを願います。少し楽しかったでしょうか。なぜ購読しないのですか。チャンネルのメンバーになってもいいかもしれません。とにかく、次の動画でお会いできることを願っています。

コメント