本動画は、AI分野における画期的な研究論文「MONET」を解説するものである。MONETは、従来の視覚言語モデルとは根本的に異なるアプローチを採用し、テキスト空間に変換することなく、純粋に視覚的な潜在空間内で推論を行う新しいAIシステムである。ピクセル空間を操作せず、ビジョントランスformerによって構築された高次元数学空間内で視覚的な「思考」を実行することで、椅子の回転や物体の拡大といった視覚的操作を数学的ベクトル演算として処理する。教師モデルからの知識蒸留と、連続的な潜在空間に対応した新しい強化学習手法VPOを組み合わせることで、テキストトークンに依存しない視覚推論を実現している。この技術は、ロボット工学や医療画像診断など、視覚的な理解が求められる分野に革命をもたらす可能性を秘めている。

MONETが開く純粋視覚推論の世界

皆さん、こんにちは。シートベルトを締めてください。これから激しい旅が始まりますよ。今日は全く新しいトピックについてお話しします。人工知能における純粋な視覚推論についてです。これまで私たちが持っていなかったものです。常にテキストによる論理構造に立ち戻らなければなりませんでした。もうその必要はありません。私のチャンネルDiscoveryへようこそ。人工知能の最新研究論文を見ていきましょう。では、始めましょう。

この論文は2025年11月26日、つまりちょうど昨日公開されました。北京大学、清華大学、そしてもちろんMITによるもので、彼らはMONETと呼ばれる新しいAIシステムを開発しました。潜在視覚空間における推論で、あらゆる画像、あらゆる言語を超えるものです。

私はこれを見て、ええ、これはビデオにしたい動画だと思いました。魅力的です。読み始めて、なるほど、つまり連続的な埋め込みを生成することで潜在視覚空間内で直接推論し、それが中間的な視覚的なものとして機能すると。でも正直言って、今読んだことが何なのか全く分かりませんでした。

この論文は、正直に言いますと、理解の糸口をつかむために2回読まなければなりませんでした。それで、この論文を見ることにしました。これが今日の論文です。もし深く掘り下げたいなら、そしてこれは冒頭でお見せするベンチマークの一つです。

もしこれが競合だと思うなら、これは2025年5月26日に公開されました。中国の浙江大学と、おそらく中国の美しい企業によるものです。絶対に魅力的です。Deep Eyesは強化学習プロセスを通じて画像との同期を促進します。つまり、私たちは巨人の肩の上に立ってさらに発展させようとしているわけですが、私の脳は単純にすぐには理解できるほど賢くありませんでした。断片的な理解はできましたが、すべてをつなぎ合わせることができませんでした。

この二次的な論文では、インターリーブモードでのマルチモーダル思考連鎖について話していて、私は一体何の話をしているんだと思いました。

MONETの基本原理

今日の論文に戻ると、比較的簡単です。彼らは言います。マルチモーダルLLMを使って、テキスト記述と画像埋め込みを超えた中間視覚的思考として機能する、全く新しい潜在埋め込みを新しい数学空間に生成すると。でも私は、これが何を意味するのか頭を回すことができませんでした。

それで、これをここに構築しようとしました。Nanobanana Proで作成したものをご覧ください。まず入力があります。入力は単純に私の人間のクエリ、つまりテキストと画像です。これは視覚的な拡張についてですから、テキストとクエリを与える必要があります。これだけです。そしてピクセル空間があります。RGB、各ピクセルに3つの値があり、線形化があり、お分かりでしょう。これが原点です。

さて、質問があります。画像の中の物体は何か、そしてそれはテーブルの上のどこにあるのか、あるいはソファーの上かもしれません。何なのでしょうか。ピクセル空間から連続的な潜在多様体に移行します。そして、視覚推論プロセスのメインロジックエンジンである潜在的な再帰コアがあることが分かります。これは再帰があることを示しており、この再帰ループで最適化しようとします。

Nanobanana Proに、フュージョン実験のようなものを構築してくれるよう頼みました。そして、勾配のあるストリームがあります。この連続潜在多様体の中で何らかの推論が起こっているなら、読み出しフェーズがあるはずです。観察1は、赤い立方体が検出したい物体であり、観察2は、赤い立方体が青い表面の上にあるということです。

最終的な答えは人間の言語に戻って、赤い立方体は青い表面の上にあります。つまり、クエリ画像から離散的なテキスト出力があるわけです。でも注意してください、これは私たちが知っているすべてのものと完全に異なります。なぜなら、ここでテキストトークンですべてを言語的なテキスト空間に変換する視覚言語モデルを使っているわけではないからです。

いいえ、完全に新しい視覚トークンを構築しますが、異なる方法で、なぜならそれらを使って推論したいからです。これが私には理解できませんでした。

視覚的思考連鎖とは何か

それで、最初から始めなければなりませんでした。視覚的思考とは私にとって個人的に何なのかと考えました。よし、椅子を取って、この椅子を心の目の前で回転させてみようと。ご覧のとおり、テキストは必要ありません。椅子が動くのが見えるだけです。

左に回転し、少し右に、上下にも。人間として、これが見えます。でも、どうやってLLMにこれを教えるのでしょうか。そして、視覚的思考連鎖が欲しい場合。つまり、テキスト拡張ですでに確立した完全な推論プロセスを、視覚拡張で、しかも視覚のみで実現したい場合、複数の要素があります。

まず平行移動があり、次に回転があります。つまり、平行移動の数学的操作があり、それから回転の数学的操作がある。鏡像かもしれません。色を変えたいかもしれません。テクスチャを変えたいかもしれません。視覚的思考連鎖があるわけです。

これで、何について話しているのか基本的な理解ができました。そして、これを特定の数学空間で数学的操作として実行しなければならないと思いました。もちろん、視覚的思考について考えるなら、そのための視覚空間を構築しなければなりません。でも、それは単なる視覚空間ではありません。

想像してみてください。宇宙の銀河の画像を想像してくださいと言ったら、渦巻銀河です。これがあなたが想像するものです。これにテキストは必要ありません。ただ見るだけです。美しい渦巻銀河を見てください。素晴らしい。1億、4億の星があります。そして、銀河を回転させてくださいと言います。すると、銀河が回転しているのが見えます。少なくとも天体物理学を学んだことがあれば、何百時間もビデオを見ていれば、銀河が回転しているのが見えます。

これのテキスト記述は必要ありません。これは脳内で起こる視覚的プロセスです。そして願わくば、このように見えます。銀河が回転しています。これをAIに教えるのです。

視覚空間の構築

では、この視覚空間とは何でしょうか。著者たちは、この視覚空間はすでにビジョントランスformerによって生成されていると教えてくれます。彼らはQwen 2.5ビジョン言語を使用しました。つまり、インターネット上のすべての画像を取得したということです。何枚の画像があるのか分かりませんが、数千万、数億、10億枚の画像がインターネット上にあり、それらでビジョントランスformerを訓練し、内部表現空間、数学空間を持っています。これが私たちが操作する視覚空間です。

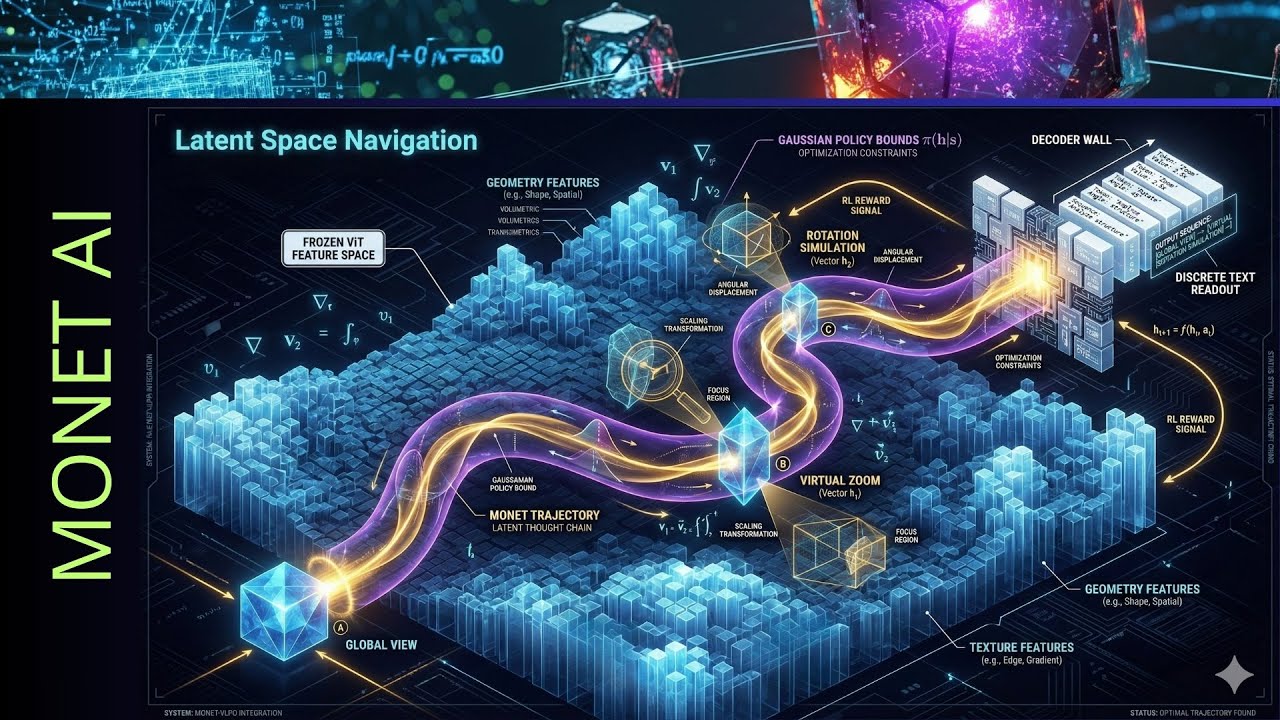

これは私がNanobanana Proに生成してもらおうとした別の画像です。青い立方体すべて、すべての青い立方体が、ビジョントランスformerによって生成された凍結特徴空間です。注意してください、これは畳み込みニューラルネットワークではありません。これはビジョントランスformer空間です。

私のチャンネルにビジョントランスformerの構築方法についてのビデオがたくさんあります。ビジョントランスformerを検索してください。この凍結特徴空間の高次元には、すべての幾何学的特徴、形状、空間的なボリュメトリクスがあり、幾何学的特徴があり、エッジや勾配などのテクスチャ特徴があります。すべてがこのビジョントランスformer、Qwen 2.5 7Bモデルに保存されています。

これが私たちが操作する数学空間です。そして、ここにユーザー入力があり、画像があります。そして今、アイデアは、ここで解決策を生成することです。お見せしたように、ここで離散的なテキスト読み出しが欲しいのです。青い表面の上の赤い箱、分かりません。では、この数学空間でこれがどのように起こるのでしょうか。視覚的な数学的操作だけがある空間です。

何らかの形でこの空間を通り、特定の経路を通らなければなりません。そして、もちろんこの経路を訓練しなければなりません。ARにいます。だから、特定の訓練、教師ありファインチューニングが必要で、それから、これをここで呼びましょう、このピンクの、何でしょう、ピンクのチューブ、あるいはピンクのトンネルをこの特定の空間に持っています。そして、もちろん教師ありファインチューニングの後、強化学習アライメントがあり、このピンクのチューブがここで完璧な金色のレーザービームに崩壊します。この特定の空間で曲がっています。なぜなら異なる重力井戸があるからです。

それで結果に到達します。連鎖のために行くことが分かります。複数のステップがあります。最初のステップは、画像にズームインしたい場合ですが、ピクセル空間を構築するつもりはありません。ピクセル空間にはいません。画像を生成していません。ピクセルのない純粋な数学空間にいます。

だから、ベクトル表現、抽象表現が必要です。これはズームインして見たものを教えてくださいというコマンドと等価です。そして、連鎖の下に第2の思考、視覚的思考があります。これは回転です。見たものを何でも、例えば左に37度回転させる、角度変位、何でもいいです。それからスケールしたいかもしれません。

訓練プロセスの詳細

これらの視覚的コマンドが私たちの経路にあるわけです。では、これを構築しましょう。数学的な観点から見て興味深く聞こえるかもしれません。なぜなら、私たちが知っているすべてのものが崩壊するからです。もう何も使えません。でも、訓練プロセスを見てみましょう。

最終的に理解する、あるいは何が起こっているのかのアイデアを得るために、付録に行かなければなりませんでした。彼らが最初にしたことは、画像テキストのインターリーブ思考連鎖訓練データセットを構築したことです。そして、ああ、今理解したと思いました。

彼らがしたことは、質問と画像を持っているということです。お話ししたように、この質問の中で、彼らは言います。下の画像に示されている物体の初期配置を考慮してください。特定の順序で一連の操作を実行する必要があります。思考連鎖操作がある場合、ステップ1はピラミッドとして識別されるすべての物体を削除します。ステップ2は青色のすべての物体を削除し、次に赤色のすべての物体を削除します。それから残っているものを教えてください。これが訓練データセットです。

思考連鎖の各テキスト拡張に対して、ここで画像を生成します。テキストから画像へのプロンプトがあり、それから画像を生成します。そして、この画像テキストインターリーブ思考連鎖は、画像に示されているオブジェクトの初期セットを分析することから始めますと言います。

観察として7つあり、観察終了、初期構成で区別されるオブジェクトのラベル。私のアプローチは、各削除ステップを体系的に適用し、最終的なカウントに到達する前に残りのオブジェクトを視覚的に追跡することです。

最初の操作は、シーンからすべてのピラミッド形状のオブジェクトを削除することを要求します。つまり、紫のピラミッドと観察されたオレンジのピラミッドの両方が取り除かれます。この変更を反映した画像を生成します。そして、テキスト推論から画像を生成します。

どんどん進んでいくと、ここに結果があります。これが結果です。では何があるでしょうか。お話ししたとおり、画像とテキストのインターリーブ思考連鎖があります。

両方があります。そして今、想像してください。テキストを忘れて、画像のシーケンスだけを見てくださいと言います。これが新しいAIシステムの訓練に役立ちます。新しい視覚状態を作成しなければなりません。

この訓練データセットの作成は膨大なタスクでした。なぜなら、すべてのステップに対して画像を作成しなければならなかったからです。

著者たちは言いました。よし、モデルの教師ありファインチューニングステップの最初のステップをサポートするために、訓練データセットを構築しなければなりません。MONET教師ありファインチューニング125,000と呼びました。彼らは本当に、12万5000の実世界のチャート、OCR、幾何学的思考連鎖を含む高品質のテキスト画像インターリーブ思考連鎖データセットを構築しました。すごいです、これは驚くべきことです。

教師-生徒学習モデル

そして彼らは言いました。よし、それができたので、AIモデルに、自動視覚数学空間の特定のベクトル座標が、視覚的コマンドのズームインと等しく、この人のバッジの名前を読むことに実際にどうやって強制するのか。彼らは、訓練中に遭遇する情報ボトルネックを視覚化する必要があると言いました。教師ありファインチューニングとステージ2に行きましょう。それ以外は単なるフィルタリングだからです。

彼らは今、これを教えることはできないと言います。なぜならこれはAIで、AIはパターン学習マシンだからです。では、模倣学習をしましょう。ピクセルを見る巨大な教師AIがいます。そして、何も見ない小さな生徒AIがいて、この人工数学ベクトル空間でこのベクトルの正しい数学的定式化を幻覚します。

だから、生徒に教師AIから学ばせることを強制します。教師AIの品質が、この学習プロセスのすべてを定義するパラメータです。

それでは、並行して実行される2つのニューラルネットワークを視覚化するグラフィックをお見せします。教師AIはメインストリームです。教師AIは目を持っています。実際のトリミングされた画像を見て、その内部状態は豊かで真実であり、完全なピクセル空間を持っています。生徒は目隠しされていて、何も見えません。

すべてがマスクされており、生徒のタスクは数学的最適化プロセスです。ベクトルを生成するだけで、潜在ベクトルと呼びます。イベントは、損失関数があり、生徒の空のベクトルをゼロから開始して、教師の豊かなベクトルと完全に整列するように強制的に打ち下ろすということです。

新しい潜在ベクトル空間でAIシステムの目隠し学習を行っているだけです。つまり、このアイデアに到達するには勇気が必要です。AIに学習させればいい。なぜ私たちがする必要があるのかと。

別のNanobanana Pro画像です。どうぞ。教師ありファインチューニング2。ここで最も重要な学習ステップです。私が持っていた二重ストリームニューラル処理概略アイデアのための潜在蒸留と勾配整列。

画像があり、目にズームインしたい、あるいはテキストバッジにズームインしたいとしましょう。ここに見えます。目にズームインすると、ここに血管が見えます。絶対に美しい。あるいはここのテキストバッジにズームインすると、小さなチップがあります。このチップの完全な画像解像度があります。これが教師AIが言うこと、インターネット上のすべての画像で訓練されたこの巨大なビジョン言語モデルが言うことです。

そして、小さな生徒がいます。小さな生徒はマスクされた画像入力を持ち、何も見えません。訓練プロセスで、教師が提供するのと同じ情報表現を学習する必要があります。潜在表現フローがあり、ここに提示される特定の損失関数があります。損失関数や力場で表現整列があることを期待します。生徒がここに来て、これがニューラル活性化なら、生徒はここで同じニューラル活性化を見つけ、このニューラル活性化を学習しますが、目隠しされており、これがズームインコマンドであることを知っているだけです。

そして美しいのは、これが一番クレイジーなことです。最初の瞬間には理解できませんでした。私たちはまだ大規模言語モデルで操作しています。しかし、厳密に視覚的潜在数学空間である数学多様体上で操作しています。

LLMが自身のテキスト多様体だけでなく、視覚多様体上でも並行して操作できることが私には理解できませんでした。どうしてこれが可能なのかと思いました。

数学空間での操作方法

簡単なトリックを理解する必要があり、そうすればパズルが開き、パンドラの箱が解決できます。このシステムは、最初に問題をAIに与え、テキストと画像があれば、AIはこれを最初にテキストレベルで解決しようとし、その後、12万5000のデータを学習したAIは、言語的パターンがパズルを解くのに十分複雑でない場合に学習します。

今、視覚推論プロセスを活性化します。別の入力データがあると言います。これが画像です。では、画像から解決策にどう到達できるか見てみましょう。AIは今、テキスト経路が十分に賢い場合にのみ、ここで開始と停止をしなければならないと決定します。テキストが失敗した場合にのみ、ビジョン推論方法論を活性化します。

テキスト経路に勾配停止があります。それで、潜在視覚ベクトル空間にズームインコマンドのこの潜在ベクトルを構築します。どうやってこれをするのか。最初から始めましょう。いつも第一原理が必要です。

画像があります。最も単純な224×224ピクセルとしましょう。ベクトル表現にカットします。重複しない正方形のグリッドに。正方形が14×14ピクセルだとしましょう。

これにより、224×224の正確に256の正方形が得られます。16×16のグリッドがあります。これは畳み込みニューラルネットワークではなく、ビジョントランスformerアーキテクチャであることを覚えておいてください。

ビジョントランスformerの利点は、画像が256の非常に特別なトークンの袋だけではないということです。トランスformerアーキテクチャからの古典的な注意メカニズムがあり、トークン番号1が最初の層でトークン256と直接対話できます。

画像がこの視覚的な正方形または視覚的パッチに分解されたので、これに対して数学的操作ができます。画像はこの離散的なパッチベクトルに分解されます。この新しいMONET潜在思考ベクトルを構築でき、今、正方形45の別の情報を比較したいと言えます。これは犬の耳がある拡大部分だとしましょう。正方形200と。これは犬の尻尾がある場所です。色の違いを見てみましょう。

ピクセル空間にいないことを覚えておいてください。これが理解するのに最もクレイジーなことです。もちろん、MONETが1つの特定の潜在ベクトルを回転させるだけなら、悲惨に失敗します。なぜなら、線形回転は椅子の後ろを見ることを表現できないからです。潜在ベクトル空間で椅子を回転させると、前脚が後脚を隠すかもしれません。オクルージョンがあります。突然生き生きとするすべての幾何学的アーティファクトがあります。これは非線形幾何学的変化です。

これは進むべき道ではありません。代わりに、MONETは256パッチの全体のクラウドまたはセット、完全な画像を取り、ここで変換を行います。全体のクラウドに対して同時に複雑な非線形変換を実行するためにMLPに行きます。

左脚パッチと座面パッチの形状を組み合わせて90度回転関数を適用すると、結果の特徴マップはどのように見えるかと言っているようなものです。ピクセルマップではありません。特徴マップです。これは抽象的なベクトル表現です。ピクセル空間への接続があるものの表現です。

視覚的思考連鎖の段階

お話ししたように、視覚的思考連鎖に行きます。連鎖回転の論理的なステップバイステップは次のとおりです。複雑さを分解します。AIでは常に複雑さを減らします。テキスト思考連鎖でこれを行い、視覚的思考連鎖でも同じことをします。

ステップ1は脱構築です。3次元構造を識別すると言います。モデルはここでパッチを集約して、椅子に4本の脚と高い背もたれがあることを理解します。数学的ベクトル空間モデルを構築します。AIを小さな人間として見ると、2次元入力からこのオブジェクトの幾何学の心的モデルを見ます。

次に変換があります。これが次のステップです。心的モデルをピクセル空間ではなく、この抽象ベクトル空間で180度回転させると言いましょう。もちろんイメージングがあります。想像した視点がオプションBと一致するか、画像が候補画像のピクチャー空間と比較可能です。

これを行うようにAIを教えるこの学習プロセスは、これまで遭遇したことのないものであり、おそらくこれが、非常に詳細だったこの技術スクリプトを読むだけでは理解が非常に難しかった理由です。しかし、このビデオで、この技術的に非常に技術的な論文の複雑さを開いて、簡単に理解できるようになることを願っています。

MONETはセマンティクスの多様体上で動作し、ピクセルのグリッド上では動作しません。理解することが絶対に重要です。なぜなら、単純にMONETは椅子の裏側がどうなっているか、木目のテクスチャを知る必要がないからです。ベクトル空間は現実の無限の複雑さを捉える必要はありません。

質問に答えるために必要な識別的特徴、青い結晶をお見せしたように、それだけを捉える必要があります。これはすべて、ビジョントランスformerの視覚空間で作成されたこのモデルの事前訓練データセットのドメインに依存します。本当に多くの低、中、高複雑度のトピックが埋め込まれている、または作成されている必要があります。

繰り返しますが、グラフィックエンジンがあり、レンダリングを行う場合、椅子の後ろを描くには無限の詳細が必要です。正確な木目、正確な光の反射、正確な影の角度、すべて。MONETはこれらのどれも必要ありません。なぜなら、ピクセル空間で作業していないからです。推論、視覚推論のための抽象的な数学的表現があります。

椅子の背もたれを識別するには、位相的特徴セットだけが必要です。これは最初の瞬間には理解しやすくありません。MONETは、背景がシートや脚よりもカメラに近いか、脚が離れた角度にあるかなどを尋ねるだけです。位相的特徴マップを求めているだけで、対応する画像で質問を与えます。

そして、MONET AIはテキスト潜在インターリーブ推論連鎖を生成します。これは正直に私の脳を壊した文章です。ちょっと待って、潜在視覚空間がありますと言いました。素晴らしい。そして、テキスト潜在インターリーブ推論連鎖があると言われます。なぜですか。ついに純粋に視覚的な推論連鎖ができると思っていました。

テキストと視覚の統合空間

ええ、でも覚えておいてください。空間があり、この空間にテキストトークンがあります。そして、これらのテキストトークンが、この巨大な多次元空間の右上隅にあるとしましょう。でも、完全に異なる空間の領域、この巨大な数学的人工空間の左下の象限にあるとしましょう、すべての視覚解釈もあります。

ええ、それは本当です。このテキスト潜在視覚インターリーブ推論連鎖があり、活性化するだけでいいのです。すぐに例を示します。これは具体的に、MONETが推論実行中に潜在視覚同期の開始や潜在視覚同期の終了のような特定のトークンをいつ生成するかを自動的に決定できることを意味し、潜在視覚推論を開始します。

お話ししたように、デフォルトはテキスト論理ですが、複雑すぎる場合、第2の入力があります。これが画像で、それから追加で視覚推論を活性化します。

論文を読んだときのMONETの推論複雑性は、すぐには明確ではありませんでした。かなりの時間を考えることに費やさなければなりませんでした。もちろん、使用するシステムのネットワークの深さ、つまりトランスformerアーキテクチャの層数と、計算する潜在ステップの数によって制限されます。

この配列が物理学に基づいている場合を想像してください。水滴の落下は物理学です。重力があります。これは空気中での挙動です。摩擦があります。美しい。しかし、水が飛び散る流体力学のように物理学が難しすぎると、もちろんMONETは失敗します。なぜなら、その内部物理エンジン、つまり世界のすべての画像で学習された重みが、ベクトル空間で水が飛び散るこの特定の配列、ビデオ配列をシミュレートするのに十分強くないからです。

でも、椅子や物体、車のような剛体に対しては、美しく機能します。これは最初のアイデアと最初の実装にすぎません。では見てみましょう。

MONETがもたらすパラダイムシフト

MONETは新しいパラダイムを導入し、AIにおけるピクセルベースのツール使用から、潜在空間の心的シミュレーションと潜在空間の内部認知シミュレーションへのシフトを行います。

これを言うと、何か関連性はありますかと言うでしょう。私の最後のビデオでAI二重多様体認知アーキテクチャについて話したからです。

このミラーマインド論文を分析したときのことを覚えていますか。これは今、本当に人間の心を鏡映しようとする試みだと言いました。例えば過去5年間の私のすべての経験と、科学者として過去5年間の私の学習プロセスを理解しようとするAI、そして認知的デジタルツインを作成しようとしています。

純粋なマルコフ的指示から私の学習経験の時系列依存性に逸脱し、今、潜在ベースの心的シミュレーションについて話しています。ええ、私たち全員が同じ方向に進んでいますが、ここで正確な言葉が見つからないことがあります。なぜなら、これは私にとって生まれてたった1日だからです。

私が理解するのがほとんど難しい解決策と発表を1日目に提供しようとしていることがあります。

方法は何でしょうか。離散的な下にあるテキスト画像出力ループを、再帰的潜在連続ループで置き換え、視覚特徴の集約と変換の複数ステップを実行できるようにします。ズームイン、回転、画像内の特定のオブジェクトの検索をシミュレートします。すべて新しい数学的埋め込み空間内で完全に行います。

美しい蒸留パイプラインを使用します。モデルがこの潜在空間を効果的に使用する方法を教えるための教師ありファインチューニングです。この教師AI、この巨大な全知の視覚言語モデルがあるので、思考を監督します。そして、強化学習に行きましょう。ここでGRPOは失敗します。最適化なので、教師ありファインチューニングは、ええ、いいですが、最適化プロセス、つまり強化学習アライメントはGRPOで失敗します。

GRPOはテキストトークン、離散テキストトークンでのみ機能すると言います。ここには連続的な視覚内部思考トークンがあります。それがトークンかどうかさえ分かりません。ベクトル表現です。もちろん機能しません。

新しい強化学習手法VPO

そして、アーティストの絶対的な美しさと知性は、問題ないと言いました。新しいものを構築しました。

純粋な視覚推論ドメインでモールのための新しいポリシー最適化を構築し、VPO、視覚潜在ポリシー最適化と呼びます。絶対に、これは本当のブレークスルーだと思います。これにより、強化学習が連続的な下にあるベクトル思考を直接最適化でき、GRPOによる離散テキストトークン強化学習の制限を克服できます。

MONETに戻ります。それは、ズームインされたバッチの座標を訪れますが、ピクセルをレンダリングするエネルギーを使いません。しかし、ピクセル空間ではなく起こっている数学的操作、仮想ズームがあります。そして、AIは今、画像を生成してここを読んでいます。ああ、これはパトリック・スミスさんです、分かりません。

抽象空間でこれを行います。仮想ズームがあるだけです。覚えておいてください、これが最初から連続ベクトルまたは潜在思考連鎖だと言いました。ここで、これが教師ありファインチューニングだと言いました。美しい。

でも、強化学習アライメントも欲しいです。これが紫の確率チューブです。そして今、ここでアライメント関数でチューブを絞りたいです。ここで金色のレーザーバンドが得られるまで。

このVPOチューブに遭遇しなければならない多くの問題があります。詳細には入りません。GPROで報酬関数をどのように計算するかを覚えておいてください。なぜなら、テキストトークンcatの確率は問題ありませんが、高次元の、4000次元ベクトル表現0.9782の確率を持つことはできません。この確率とは何ですか。この報酬構造とは何ですか。

この空間で新しい距離メトリック記法を考え出さなければなりません。ここで、彼らはガウシアンポリシー境界構造を採用します。すべての詳細は論文にあります。それほど複雑ではありません。

ここを見てください。GRPO最適化プロセスがあり、これがあなたが知っている公式で、2つの確率分布を比較するときにカルバック・ライブラー項のベータパラメータがあります。ここで報酬構造はかなり単純ですが、覚えておいてください、go目的はタックストークンでのみ計算できます。

だから彼らが賢く行ったことは、この特定の項を最適化しただけです。見てください。潜在イオン分布の議論があると言います。VPO目的のために、この報酬構造は今、新しい、複雑な数学空間での距離のアイデアに依存しています。再帰があることを覚えておいてください。これは単純に、ここで距離ステップを定義します。シンプルでエレガントです。

強化学習アライメントプロセスにこのビジョンVPO目的を使用できることを開いているのが分かります。

ベンチマーク結果

これです。これが年です。結果を見てみましょう。最終結果をお見せします。ベンチマーク1、2、3、4があります。GPT-4 omniモデルがあります。それから、Qwen 2.5ビジョン言語7B。これがベースモデルです。教師ありファインチューニングプラスGRPO。

そして、冒頭でお見せしたDeep Eyesの発表があります。これが以前の論文でした。今、MONET 7Bがあります。彼らはお見せした訓練データセットでこのモデルを構築し、この完全な教師ありファインチューニングとVPOを行いました。見てみましょう。

DARは本当に良いです。これを見てください。GPTシステムと比較して。もちろん。でも、古典的なビジョン言語Qwen 78から83に行っても、ええ、これは良い改善で、新しいモデルはまったく同じレベルです83.25。Deep Eyesと比較して、このベンチマークでは同じパフォーマンスです。

次のベンチマークに行くと、全体的にDeep Eyesはこのmoneyプロセスよりわずかに優れています。このベンチマークに行くと、ああ、MONETは本当にDeep Eyesより優れています。ここを見てください。MONETはここでベンチマークの残りすべてに勝っています。

それほど明確ではありませんが、絶対に魅力的です。なぜなら、MONETで視覚推論パラダイムでこれを行ったことを覚えておいてください。Deep EyesとQwenによる視覚トークンの統合は完全に異なります。

もちろん、いくつかの全く新しいイノベーションを持つQwen 3ビジョン言語の技術論文をすでに投稿したのをご覧になりました。これについては後のビデオで詳しく説明します。これは、このすべての抽象視覚埋め込みと訓練と推論とテスト精度最適化などの後に達成したパフォーマンスについてお伝えするためのものです。

実用的な意味

でもちょっと待ってください。もっと重要なことがあります。質問は、ナビゲーションや医療画像診断のような複雑な視覚シナリオについて、仕事をチェックするために画像を生成する膨大な遅延なしに内部で考える引用符付きのロボットまたはアシスタント視覚アシスタントが持てるかということです。

だから、推論プロセスでピクセルを幻覚する代わりに、有用な数学的操作を幻覚することに行きます。そして私は本当に幻覚を意味します。なぜならこれは確率密度関数の端にあるからです。

本当に幻覚の方向に行っています。これがこの最初の論文であることを覚えておいてください。多くの新しいアイデアがあります。

明確にするために、MONETは完璧な視覚画像物理エンジンではありません。なぜなら、お話ししたように、重力のために落ちる小さな水滴のビデオ配列を見る場合。これは物理学です。でも完璧ではありません。

訓練しようとしている視覚物理表現の確率的推定器です。繰り返しますが、ええ、確率密度分布を知っていますが、私はその端により近いです。椅子の回転も幻覚しますが、ほとんどの場合、この幻覚は正しいです。なぜなら、統計的に事前訓練フェーズ中に何百万もの椅子の画像を見てきたからです。

しかし、通常の分布外オブジェクトの場合、クレイジーなデザイナーが誰も見たことのない椅子をデザインした場合、この心的回転はもちろん失敗するかもしれません。なぜなら、訓練データにないし、分布外だからです。だから、この心的幻覚が実際に正しい、正しい結果を提供するという多様体仮説に依存しています。

多様体仮説の詳細説明

では、数学空間の複雑さと多様体仮説に来ましょう。お話ししたように、離散数学空間で操作しているのではなく、流動的で、連続的で、滑らかな数学空間で操作しています。完全に新しい代数があります。最初から始めましょう。いつも最初に戻らなければなりません。

ビジョンエンコーダを想像してください。ビジョンエンコーダは、インターネットから何十億もの画像を整理する一種の司書です。訓練のためにコントラスト損失と呼ばれる数学的目的を使用します。

ビジョンエンコーダに、これは犬の写真で、これがテキスト、犬です。この数学空間でそれらのベクトル表現をほぼ同一にしてくださいと言います。

そしてネガティブもあります。ポジティブ画像とネガティブ画像で訓練します。そして、これは猫の写真です。この数学空間で新しいベクトルを犬ベクトルから押し離してくださいと言います。

流動性の出現は、モデルが何十億もの例を見て、この空間で一種の内部視覚表現マップを作成するからです。すべての犬が一緒にまとまっています。犬のクラスターです。犬に関係するファミリーの狼は、似ているか、同じ遺産を持っているかもしれないので、犬のすぐ隣にいますが、猫はさらに離れています。猫のクラスターは犬のクラスターから離れています。美しい。

さて、重要なのは、属性によってそれらを整理することです。犬クラスターの左側に立っているすべての犬の画像があります。簡略化しましょう。そして、犬クラスターの右側に座っているすべての犬がいます。

そして今、連続空間があれば、美しいのは、立っている犬と座っている犬の間の空間が、犬が座る滑らかな連続勾配になることです。私たちが達成したものが分かりますか。離散空間に行くのではなく、テキストトークンで持っている階段を上るようなものです。滑らかな連続勾配に行きます。

これは、立っている犬から座っている犬への美しい変換、モーフィングをもたらします。もちろん、データは単純にGoogleが何百万、何十億もの異なるポーズの犬の写真を提供します。

Nanobanana Proがなぜそれほど強力なのか疑問に思うなら、言えませんが、ヒントがあります。Googleです。インターネット上のすべての画像にアクセスできると言っていいでしょう。

何かがあるのが分かります。OpenAIが簡単に模倣できないかもしれないものです。Googleはその歴史を考えると、訓練データだけで単純に優位性を持っています。

これは今、コントラスト学習アルゴリズムが、新しい数学空間での表現の流動的な構造化されたマップにそれらを整理することを意味します。MONETに1つの特定の椅子の写真を見せると、何が起こるかです。

投影があります。ビジョンエンコーダはあなたの椅子の画像を見て、計算します。うーん、この椅子は事前訓練中に見た何百万もの正面図の椅子に90%似ていますが、赤いオブジェクトクラスターの赤色を持っています。

配置のために、今、あなたの1つの画像を、事前訓練データの事前構築された巨大なマップの4000次元数学空間の特定の座標、ベクトルXYZに配置します。

どこかに配置されます。それは美しいです。なぜなら、マップはすでにビジョントランスformerによって構築されているからです。あなたの椅子の裏面は、この数学空間で理論的にすでに存在しており、整理されているので引用符付きですが、座標x + 5 yにあります。

これが再び私の脳を壊しました。つまり、ここでテキスト、単語で構築したとき、トークンが単語であるとき、人間の言語で使用するすべての可能な単語の完全な数学的表現空間を構築し、それからクロスアテンションメカニズムとトランスformer層があります。

今、ページの反対側で世界のすべての画像で同じことをします。視覚推論を行います。そして今、この巨大な多次元空間で、このベクトルがあり、この視覚トランスformer空間を構築したと想像してください。Qwen 3ビジョン言語がこの新しい視覚空間を構築しました。椅子の裏面がすでにデータベースに存在する場所です。あなたの椅子は2年前にすでに生産されたモデルで、インターネットはすでにあらゆる異なる方向と角度と照明などからあなたの椅子の100以上の画像を持っています。

可能なすべての画像は、すでにこの数学空間のこのベクトル表現にあります。したがって、AIモデルは椅子のピクセル裏面画像を生成する必要がありません。なぜなら、椅子の裏面画像はすでに数学空間にあり、事前訓練からこれを知っているからです。

X軸上でベクトル4プラス5ノッチを移動するだけです。だから単純なベクトルの平行移動です。そしてこれは今、180度の回転を表しています。これが美しさです。ピクセル空間でピクセル操作を行わないという美しさです。

しかし、理論的に可能なすべての画像のこの不条理な量の美しいベクトル表現があることを考えると、これは16×16ピクセル構造まで下がっているだけです。あらゆる画像を構築できます。これが何を意味するか分かります。これは、より良いカメラやより良いAI推論のためのより多くのピクセルが必要ないことを意味します。

必要なのは、これらの数学空間を構築するより良い事前訓練されたビジョントランスformerです。そして、MONETのようなより良いパスナビゲーターが必要です。より良い潜在推論アルゴリズムです。ボトルネックはもはやピクセルを知覚することではありません。視覚的意味がエンコードされているこの空間の幾何学を理解することです。

再び脳が壊れました。したがって、今、MONETが理解できます。これが私にとってブレークスルーでした。潜在ナビゲーションタスクのための軌道オプティマイザーにすぎず、この演習のために特別に構築された既存のセマンティック多様体、つまり極めて高次元の数学空間を通るものです。それは私たちの場合、Qwen 2.5ビジョン言語モデル、7Bモデルによって構築されました。教師モデルは72億のビジョン言語モデルでした。

これが分かります。軌道オプティマイザーがあり、X + 5の位置に行くだけで、椅子が180度回転したのが見えます。なぜなら、すべての画像がすでにこの数学空間に存在しているからです。

それでも、無限の画像を持つことはできないと思いました。それから間違いを犯していると思いました。ああ、そうです。だから、この考えを1分間保持してください。他のことをしなければなりません。

ここで実際にズームインされた画像を見る教師モデル、教師がピクセルを見て、教師の脳、AIが特定の状態ベクトルを生成します。ベクトル真理と呼びましょう。

私たちの生徒モデル、MONET 7Bモデルは、このズームされた画像をマスクアウトしています。お話ししたように、元の完全な画像のみに基づいて潜在ベクトル、ベクトル思考を生成しなければなりません。

そして今、生徒のハーモニー7Bに、スーパーAIからのベクトル真理が生徒モデル7Bが幻覚するベクトル思考とほぼ正確になるまで、数学的表現を変更することを強制するだけです。

極めて複雑な最適化プロセスにすぎないことが分かります。極めて複雑ではありません。空間が極めて複雑だからです。しかし、ここに多様体仮説があります。2分で説明します。

したがって、ここでの結果は、生徒が学ぶ、MONETが学ぶということです。ズームインされたバッジを見ることに対応する脳状態を達成したい場合、ズームイン画像で目隠しされているだけです。完全な画像を見るだけです。

この特定のベクトル座標を生成する必要があります。なぜならそこにあるからです。だから、視覚光学を必要とせずにこの詳細を見ることの数学的シグネチャを幻覚することを学びます。再び言います。

人間は目が必要です。ライターやレーダーや光学的光センサーがあります。何もありません。純粋な数学です。生徒、免疫は、この特定の数学空間で潜在思考の独自の視覚推論連鎖を移動し、最適化しています。この数学空間は、Qwen 2.5ビジョン言語72Bの教師AIの学習された世界モデルです。

小さな生徒は、720億のQwen 2.5ビジョン言語によって構築された世界モデルに移動しているだけで、そこでナビゲートしているだけです。

この視覚推論モデルは、インターネットで利用可能な何十億もの画像の世界モデルを構築し、それを理解する大きな兄弟を必要とします。立っている犬の写真が座っている犬の写真のすぐ隣にあるように。そして、MONETはここでパスファインディング最適化ルーチンにすぎません。

これを理解すれば、完全に異なるフレーミングから論文を読み、すぐに理解できます。MONETは固定視覚多様体上の潜在シミュレーションです。

ハイブリッド視覚潜在空間

しかし、これは簡単ではありません。実際にお伝えしなければならないことがあり、これは今、もう少し複雑です。MONETはハイブリッド視覚潜在空間を作成します。埋め込みが言語的セマンティクスではなく、視覚的セマンティック、形状、色、空間関係、すべてを運ぶ連続ベクトル空間です。

でも覚えておいてください、AIで動作する言語脳があります。

そして、一体どうやってこの言語脳が、最初に単語に翻訳せずに視覚データを直接操作し、計算し、消化できるのか理解できませんでした。ピースが欠けていました。

多様体仮説の説明。お話ししたように、質問がありました。こう言いましょう。画像のパッチのすべての可能な画像が意味するのか、椅子の画像を見せたら、ビジョントランスformerによるこの美しいベクトル空間のどこかにすでにあり、そこに行くためにベクトルを移動するだけでいいのですか。本当にそんなに簡単なのですか。

答えはイエスでした。笑わなければならなかった例をお見せしましょう。自分がどれだけ愚かか認識して。ピアノについて考えてください。事前訓練されたビジョントランスformerを考えてください。作成された数学的ベクトル空間をグランドピアノのように考えてください。

そして今、ピアノには4000の鍵があります。なぜと言うでしょうか。この世界で演奏できるすべての曲は、すでにそのキーボード上に存在します。グランドピアノに4000の鍵があれば、この世界のあらゆる可能な曲を演奏できます。

これは視覚推論で起こることとまったく同じです。数学空間に4000次元があり、これまでに存在し得るあらゆる可能な視覚的複雑性を構築できます。

そして突然、ああ、今分かったと思いました。ピアノビルダーはもちろん曲を書きませんでした。鍵を作っただけです。これは数学空間の次元を意味します。そして弦。これは、ビジョントランスformerの訓練でその空間の特徴表現を意味します。

今、この人のバッチをズームインするタスクは、単なる特定の和音です。椅子を回転させるのは、この4000の鍵を持つグランドピアノで演奏する特定のメロディーにすぎません。

MONETは今、この数学空間で演奏するピアニストです。ピアノを作りません。これらの特定の鍵をこの特定の順序で押すと、ズームインされたバッチの曲を生成することを学んでいるだけです。

これが何らかの明確化を提供することを願っています。そして今、ちょっと待って、それがこんなに簡単なら、第一に、なぜ著者たちは出版物にそれを入れなかったのかと言うかもしれません。でももちろん、非常に洗練されたかったことは理解しています。分かります。

でも、なぜ視覚推論を発明するのがそれほど難しかったのですか。そして今、答えは、そのベクトル空間の99.9パーセント周期的が純粋なナンセンスだからです。

ファインマンが原子核と電子球の間の原子間の空間について話したファインマンの講義を考えてください。ほとんど無限の空間があります。ここでも同じことが起こっています。

多様体の意味のある画像、実世界の椅子、実世界の犬、すべてのテキストは願わくば、私たちが期待するものは、巨大な数学空間内の極めて細いねじれた糸、多様体上に住んでいます。

極めて細いねじれた糸の多様体があり、その周りに巨大な空虚があるという極端な制約があることを願っています。

そして今、お話ししたようにベクトルx + 5をランダムな方向に直線で移動すると、糸から何もない、静的ノイズと呼ぶものに踏み出します。そして、意味のない数学的ガベージがあり、それは何も見えず、何でもありません。なぜなら、推論が起こる多様体を離れたからです。

99.99%は何もないだけです。そして今、この空間、この空間は、視覚的にズームイン、3Dでオブジェクトを回転、オブジェクトをぼかす、何かを明るくする、明るさを変更、何でも分かりますよね、すべての意味のある視覚変化のための数学的可能性を含んでいます。

入力は、ビジョントランスformerで生成されたこの特定の多様体上の1つの特定の開始座標に特定の画像が着陸します。そして、MONETは事前訓練に基づいてベクトルを計算しているだけで、この場所の移動と言い、結果は開始座標と移動ベクトルがあり、椅子の裏側のような数学的操作の結果である視覚パッチを表す答え座標をすぐに見つけます。

ピクセル空間でピクセルを生成する必要はありません。これは視覚推論の極端な加速です。

これは今、MONETが既存の場所を見つけることにおいてこの非常に小さな細い多様体上の数学的オプティマイザーまたはエクスプローラーマシンに他ならないことを意味し、ハイパー次元世界でこれはクレイジーです。なぜなら、このメトリック構造を変更する方法についてたくさんのアイデアがありますが、これは別のビデオになります。

すべてのテクスチャ特徴とすべての幾何学的特徴がここにあります。これが、Nanoban Proにここで平らな2次元フィールドではなく、少し歪んだフィールドを作成してほしかった理由です。でも、Nanobananaは私のコマンドを無視して、ゼロ、ごめんなさい相棒、でもおいおい、これが私が達成できる複雑さだと言いました。

でも、この小さな壊れやすい多様体が何らかの形で乱され、歪められ、ここで幾何学的マトリックスで何らかの形で双曲的であるか何であれ、想像してください。ここで因果操作があります。

将来予測をしたいのですが、これは10%の可能性しかないと言います。ほとんど無視できます。

でも、数年後にロボットがこの高価なビデオをフレームごとに処理しないと思います。ロボットからクラウドセンターへのスーパーハイパーリンク接続は必要ありません。なぜなら、同じ情報を潜在視覚ストリームとして処理すれば、ここで説明されたホイールアルゴリズムの子孫または最適化を使用して、この視覚多様体の圧縮された思考ベクトル。

人間が見ることさえできるよりもはるかに速く世界に反応できるようにします。

このプレプリントが、フレームごとのビデオ分析、セグメンテーション、識別、ピクセル空間での変更から離れる最初の青写真の一種だと思います。

これにより、これらすべてを捨てて、最適化しなければならない新しい数学空間でより高い価値の数学的抽象表現に行く可能性が得られます。

ああ、これは私にも意味をなさなかったです。OpenAIのストロベリー、o1に移行します。突然この隠れた思考連鎖プロセスがあり、o1は素晴らしかったです。感情的に100年前のように聞こえます。

今、同じものがあります。MONETは、AI知覚に対する思考連鎖のために、ビジョントランスformerへの同じ隠れた視覚状態を導入します。

もう少し説明的な段階に行くと、視覚ライブラリは流動的な画像ベクトル場に他なりません。しかし、すべての特定の画像の場所は、この空間の特定の点にすぎません。

何らかの4K次元ベクトルの座標を与えたら、ゴールデンレトリバーの写真の真正面に立っています。そして、この流動性はとても美しいです。もう離散的ではありません。この空間は水のように流動的です。テキストトークンで持っている階段を上るようなものではありません。

何インチでも最小量を移動できます。あるいは空間の他の位置へのあなたの距離メトリックが何であれ、突然ゴールデンレトリバーの耳がわずかに動きます。このベクトル空間で移動するだけで、画像も少し流動的で、毛がもう少し長いか、もう少し光沢があるか、もう少し灰色か何であれ、しかしこれは連続的な操作で、本当に滑らかな勾配の画像を与えます。

別のNanobanana proにいくつかの美しいアイデアを思いつくよう頼みました。一方では、すべてが単語に分解される離散的な言語セマンティクスがあると伝えました。名詞、動詞、関数、オブジェクト、述語があり、それを合計し、数学的操作があります。平滑化があります。

何でも、アイデアが分かります。これらは代数の固定ブロック、離散要素です。そして今、MONETは素晴らしい、これを柔軟にしましょう、連続的な視覚多様体を構築しましょうと言います。草の画像はちょうどここにあります。滑らかな勾配のベクトル場です。離散ではなく操作しているので突然、今は滑らかです。

少し黄色の草があります。それから、もう少し濃い緑の草があり、それから明るい緑。すべてが互いに流れてモーフィングしているだけです。この連続的な視覚多様体で作業すると、物事がはるかに簡単になり、MONETはこの機会を構築しているだけです。

これは、離散論理プロセッサ、LLMトランスformerがビジョントランスformerの数学空間表現に基づくこの連続物理エンジンのコントローラーとして機能できるようにするインターフェースであるというアイデアを証明しようとしています。

だから、離散のみから、何でも欲しいものに行きます。滑らかです。そして、これを説明してください、この数学的操作を説明してくださいと言いました。まだ理解できません。本当に感じません。

テキストでは、複雑な数学空間があれば、簡単にしましょう、基本があります。テキストベクトルがあり、この複雑な数学空間の北隅に行ったとしましょう。それらは離散点、小さな島です。そして、ビジョントランスformerからのビジョンベクトルがあり、それらはこの空間の南隅に行き、流動的な渦巻く雲と草のすべてのテクスチャと色合いと色の海です。

2つの完全に獣と2つの完全に隅があると言いました。そして、ビジョン言語事前訓練中に理解したことが起こりました。ビジョン言語トランスformerを構築する方法にかかわらず、アダプターを使用しなければなりません。今、投影層を使用しなければなりません。これが、MONETが再帰操作に後で使用する投影層です。

このMONETブリッジはMONET自体によって構築されたのではなく、ビジョン言語モデルの事前訓練から来る固有の特徴です。Qwen 3で深く掘り下げれば、これをお見せするかもしれません。

ブリッジは単純に、視覚ベクトルを、この複雑な空間の南隅から取り、何らかの形で数学的に北隅に向かってドラッグするプロジェクター状態です。はい、そうです。今日は本当に科学的です。申し訳ありませんが、少し緊張しています。

そして今、アライメントが起こります。犬の画像のベクトルをテキスト単語犬のベクトルのすぐ隣に座らせることを強制します。そして今、LLMが数学空間で動作し、純粋な視覚推論操作を行える理由が分かります。なぜなら、それらを同一のベクトル空間にマッピングするからです。

この投影層で極端に追加の複雑性があるだけです。でも今、LLMは視覚空間でも推論を行えます。そして、これについて考えたとき、今、モデルの感覚があり、何が起こっているのか理解していると言いました。

より良い即座の説明があれば、コミュニティのためにコメントを残してください。よりエレガントなアイデアをいただければ幸いです。次の数日で起こるかもしれません。

注意メカニズムの視点

これは、LLM、大規模言語モデル、ヘッドが今、流体力学の外国語として視覚を扱い、この流体力学の外国語に事前学習された論理ゲートを適用することを意味します。

これが機能していることに本当に驚いています。でも、このビデオであなたに説明しようとした複雑さと、1日目にこれを理解しようとした複雑さを考えてください。

私を知っているでしょう。簡単なら、ビデオの価値がないと思います。だから今これをやりましょう。別の視点を持ちましょう。純粋に数学的な観点から行きましょう。私の簡単な説明ではありません。

注意メカニズムからフレーミングをしましょう。もちろん、クロスアテンションメカニズムについて話しています。これをさっと流します。これは専門家のみのためです。感じられたら、素晴らしい。そうでなければ、気にしないでください。

ステップ1はプルです。これは磁石です。この空間で起こる検索です。数学的には何ですか。簡単です。アテンションは単純にこの操作のソフトマックスです。

しかし、グローバルではなく、潜在ベクトルに対してのみ注意してください。これは、潜在ベクトルが今、周波数調整された磁石として機能することを意味します。

アクションは今、この周波数調整磁石ベクトルが画像クラウド空間を飛び、磁石が赤に調整されていれば、赤いパッチベクトルだけを磁気的に引用符付きでそれに向かって引き、青いパッチは全く引かれず、そのままです。

何を意味するか分かりますか。これは理論物理学者がそれについて話す場合、数学的理論物理学的観点から説明されたアテンションです。

それから収穫があります。それからアテンション×値の出力があります。これがトランスformerで操作するものです。しかし、これは磁石に付着したものですが、そこに留まりません。

磁石が情報、知識、それが引き付けたパッチからの知識を吸収することを覚えています。ベクトルは今、詳細をダウンロードします。テクスチャ、形状、エッジ、すべて、色、完全な複雑性、引き付けた赤いパッチからの視覚的複雑性、それはより賢く、より賢く、追加情報を追加します。

そして、これが起こったら、推論プロセスまたは思考プロセスの進化があります。そして、再帰的定義があります。これは何ですか。これは少なくとも私の理解では最も重要な部分だと思います。磁石がこの特定の構成のデータ、赤と言いましょう、を吸収した後、磁石自体が変化します。磁石はより賢くなり、今、磁気周波数を別のトピックに調整できます。

磁石自体が変化します。これが数学的操作が最適化するものです。より賢く、賢く、スマートになります。引用符付きで、または最適化プロセス自体を行うと言います。

LLMの内部回路が今、磁気周波数を書き換えます。ステップ1、磁石は、磁石のタスクはこのクラウドで赤いものを見つけることだと言いました。

見つけたと言いました。統合しました。だから、赤いものを見つけた磁石になってくださいと言います。見てください。私が見つけたものの欠陥を探す磁石になります。

だから次の操作に行きます。回転かもしれません。欠陥を探しているかもしれません。これらのオブジェクトの特定の特徴を探しているかもしれません。回転対称性があるか、電荷対称性があるか、他に何でもチェックするかもしれません。理解しますか。

とにかく、どう見ても。地球に戻りましょう。この論文のこの美しい論文の単純な真実は、もう少し説明する必要があります。30秒でのアプローチの単純な真実。

画像があると想像してください。そして今、タスクは視覚推論です。タスクは、これはモーターブロックの画像で、何が間違っているか分析してください。動いていません。マルチグラニュラリティ視覚入力があり、テキスト入力があるかもしれません。

そして今、システムはこれを見ます。お話ししたように、パッチを生成します。16×16ピクセルまたは14×14ピクセル、覚えていません。ここで分析を行います。これを256パッチに分解し、これは何であれ、これはここで別の何であれ、エンジンについては分かりませんが、この画像の補助視覚クロップ詳細があり、それからシステムはここで画像全体を分析できるのではなく、各リンク単一パッチを分析できます。

これがあるべき方法ですか。これはすべてデジタル化され、教師ありファインチューニングが起こった最適化ループにここに入り、連続的なもののためのポリシー最適化がここで起こりました。

用語catの確率はないことを覚えておいてください。だから、数値密度のためにガウシアン制約関数を構築しなければなりません。こう言いましょう。

そして、すべてがここで起こっています。このチューブからさらにここに圧縮し、この金色のレーザー同期に入り、それから潜在ベクトルがあり、推論が起こっている場合、この画像で言いましょう、オイルが滴り落ちているのが見えます。ああ、間違いがあります。これらのパイプからオイルが出てくるべきではありません。

これは大丈夫、これは大丈夫、ああこれがここで起こる、という推論で、これらの潜在ベクトルはここで離散トークンに再解釈されます。これは起こっている崩壊です。そして、自然言語出力があります。これは素晴らしい観察出力で、このトランスformerアーキテクチャによってここで正常に生成されました。

これはここで視覚推論です。再び、これはNanobanana pro画像で、ここで実用的な実世界の例を持とうとしました。井戸の画像を作るか、エンジンの画像を撮って、AIに何が起こっているのか尋ねます。このオイルの小さな滴が視覚推論でここで検出されます。

前に単純な真実について話していました。中断されました。複雑な推論、言語推論でも視覚推論でも関係なく、単純なアテンション、反復的に適用されるAttention is All You Needで定義されたアテンションメカニズムにすぎません。

本当に深く深く掘り下げれば、人工知能の主力である同じアテンションメカニズムです。興味深い。

しかし、視覚推論、単純な複雑性レベルに減らさなければなりません。椅子のいくつかの平行移動と椅子の回転、椅子の反転や鏡像などをやっているだけであることを覚えています。

フレーミングの視点の変化にすぎません。現実の変化ではありません。これは興味深いです。なぜなら、テキストLLMは単語ですべてを幻覚できることを覚えておいてください。視覚推論は少し制約されているようです。しかし、これは単なるアイデアで、証明はまだありません。

興味があれば、論文を読んで、視覚推論における幻覚効果がテキスト推論と比較して少ないことを示す数学的証明を見つけられるか教えてください。この結果に非常に興味があります。

今日のビデオはこれだと思います。もう話したと思います。あら。どれくらい話したか知りたくありませんが、これは絶対に美しい論文です。

最初は理解するのに非常に問題がありました。でも、深く掘り下げれば、あきらめない、これを理解したいと本当に言おうとすれば。私の解決策は常に第一原理に戻り、ここで最も基本的な用語を理解し、それからゆっくりと複雑さを構築することです。

だから、これを簡単で美しいと言えるような方法であなたにこのアイデアを提示できたことを願っています。今、視覚推論があります。

視聴してくださりありがとうございます。聞いてくださりありがとうございます。少し楽しんでいただけたことを願っています。新しい情報があったことを願っています。購読することを決めるかもしれません。うわあ、このチャンネルのメンバーになりたいと言うかもしれません。

とにかく、次のビデオでお会いできることを願っています。

コメント