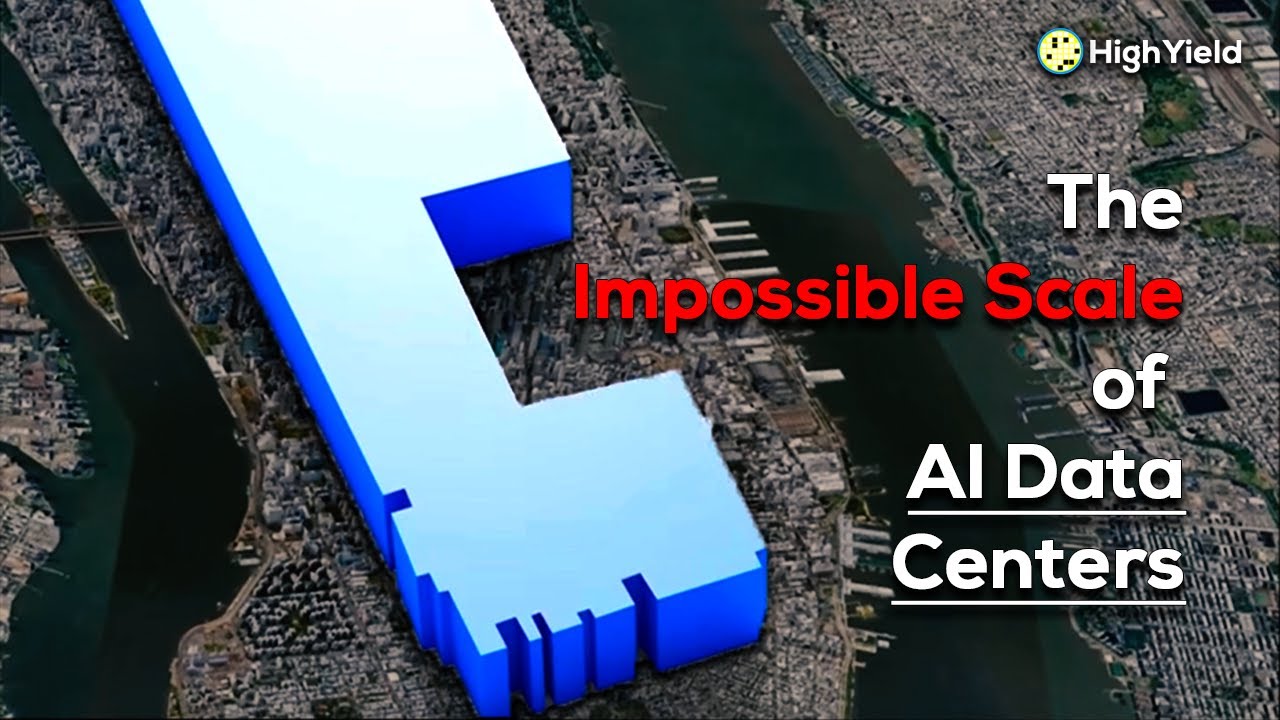

テキサス州テンプル市で起きたメタ社のデータセンター建設中止事件を発端に、従来型データセンターとAIデータセンターの根本的違いを解説した動画である。AIデータセンターは実質的にはAIスーパーコンピューターであり、従来型と比較して電力密度が10倍から40倍、液体冷却が必須、立地制約が少ないなどの特徴を持つ。AGI競争の激化により、各社は原子力発電所の再稼働や建設に乗り出し、ギガワット級の施設建設が進んでいる。この趨勢が続けば、AIデータセンターが世界のエネルギー消費の主役となる可能性が高い。

- データセンター業界に起きている地殻変動

- 現代データセンターの仕組みと変化

- 立地の重要性から密度重視への転換

- データセンターの4つの主要構成要素

- 推論処理における遅延の重要性

- コンピュート密度の重要性

- ラック単位での密度向上

- 従来型とAIデータセンターの電力消費比較

- 液体冷却への移行

- 液体冷却の隠れたメリット

- 電力容量による規模の新基準

- 電力インフラの課題

- 訓練実行における停電の影響

- テンプル、テキサスの謎解き

- 建設中に時代遅れになるデータセンター

- 原子力発電所の復活

- エネルギー需要に対する業界の対応

- 未来のスケール予測

- エネルギー事業への参入

- 秘密主義のAI競争

- SemiAnalysisの調査手法

- ChatGPT以降の加速する変化

- 世界を変える規模への到達

データセンター業界に起きている地殻変動

データセンター業界に地殻変動が起きとるんや。この変化はめちゃくちゃ早くて、その規模もでかいから、データセンターだけやなくて、業界全体を変えてしまっとる。わしの言葉を信じんでもええから、実際に見せたるわ。

これはテンプル市や、テキサス州オースティンから車で約1時間のところにある町やねん。でも今回はこの街や歴史あるサンタフェ鉄道駅舎を見に来たんやない。この町の工業地帯にある何でもない畑を見に来たんや。

正確に言うと、今お前らが見とるんは2021年8月の写真や。それから1年後の2022年8月になったら、畑は全部なくなっとる。代わりに巨大な建設現場になっとるんや。土地を買うたメタ社が大きな計画を持っとることは明らかやし、本気で取り組んどることも分かる。

それからたった4カ月後、2022年12月には、データセンターの建設がもう本格的に進んどるのが見える。でもそこで変なことが起きるんや。さらに5カ月後の2023年4月、テンプルの例の畑はこんな感じになっとる。前の工事は全部なくなって、地面まで取り壊されとるんや。メタ社は建設の途中で、データセンター全体を削除してもうたんやで。

推定7000万ドルがまるまるなくなってもうたんや。無駄になったみたいやな。でもなんでやろ?建設中に問題があったんか?それとも工事を続けるのに必要な許可が取れんかったんか?

実は、そんなことは全然関係あらへんねん。この動画では、メタ社がなんでこんな極端な決断をしたんかを解明するだけやなくて、現代のデータセンターがどう動いとるんかを見て、業界全体がなんでこんなに急激に変化しとるんかを探っていくで。

現代データセンターの仕組みと変化

この傾向が続いたら、AIデータセンターが世界を食い尽くし始めるからや。せやから、テンプルで何が起きたんやろ?

テキサスの畑で起きたことと、データセンター業界全体で起きとることを理解するには、データセンターがどう動いとるんかを理解せなあかんねん。現代のデータセンターは、コンピューターをちょっと置いた倉庫以上のもんやからな。

でも長い間、データセンターは基本的にそんなもんやったんや。初期のデータセンターは、よく事業所の中にあって、例えば地下室の何部屋かをサーバールームに改造して、IT機器を置いとったんや。

インターネットが普及するにつれて、データセンターはどんどん重要になってきて、規模も大きくなっていった。地下室のどっかに置かれるような脇役の時代は終わったんや。データセンターは巨大な建設プロジェクトになって、Web2.0の興隆を支えたんやで。

基本的にGoogle、マイクロソフト、メタ、アマゾンみたいなインターネット企業の「工場」になったんや。主な機能はデータをホストして配信することや。やから「データセンター」っちゅう名前なんやな。

今お前らがYouTube動画を見とるっちゅうことは、この動画がどっかのGoogleデータセンターに保存されとるっちゅうことや。そのどっかは、できれば君らからそんなに遠くないところにあってほしいねん。速くて途切れへんアクセスが欲しいからな。

YouTubeやNetflix、基本的にクラウドでアクセスしたいもん全部に関して言えることやけど、データセンターは大量のデータストレージを提供するだけやなくて、大きなネットワーク帯域幅と良い遅延性も提供せなあかんねん。そこで立地が重要になってくるんや。

立地の重要性から密度重視への転換

データセンターは、お前らが思うとるより立地に敏感なんや。ええ例がアッシュバーンやスターリングみたいなコミュニティやな。ワシントンD.C.のダレス国際空港のすぐ隣にある地域や。

この狭い地域には多くのデータセンターがあるんやけど、それは主要な人口集中地に近い一等地と、新しいデータセンターが建設されるたびに成長してきた巨大なネットワークインフラを兼ね備えとるからや。完璧なネットワークハブなんやで。

クラウドサービスを提供したり、お客さんにコンテンツをストリーミング配信したりするんやったら、データセンターはそこに置きたいもんや。光ファイバーネットワークが大きくて、お客さんの物理的な場所に近いほど、従来型のデータセンターにとってはええんや。

でも、こういうこと全部がAIで変わってきとるんや。最初は分かりにくいかもしれんけどな。外から見たら、AIデータセンターは従来型とよう似とるからや。

大きくて、だいたい平らで、倉庫みたいな建物で、その周りに電力と冷却のインフラがあるんや。でも、文字通りそこで似とるところは終わりや。

この動画から一つだけでも覚えて帰ってもらうとしたら、AIデータセンターは従来型のデータセンターとは全然違うもんやっちゅうことや。それだけでも価値があるで。

「AIデータセンター」って呼び方も、ちょっと誤解を招くかもしれんな。でも定着した名前やからしゃあない。わしの意見では、もっと適切な名前は「AIスーパーコンピューター」やと思う。実際にそれがそうやからな。説明したるわ。

データセンターの4つの主要構成要素

データセンターを高いレベルで見ると、4つの主要な構成要素がある。コンピュート、コネクティビティ、クーリング、パワー(C3P)や。この4つの分野を使って従来型とAIデータセンターを比較したら、違いがすぐ分かる。これでテンプル、テキサスの謎を解く一歩に近づくで。

まずはコネクティビティから始めよか。従来型データセンターにとって立地がどんだけ重要かをさっき話したからな。でも立地は文字通りAIデータセンターには関係ないんや。少なくとも従来型と同じような意味では関係あらへん。

AIデータセンターには2つの用途がある。まず、大型言語モデルを訓練することで、これは単純に「トレーニング」と呼ばれる。次に、その事前訓練されたモデルを使って出力を生成することで、これは「推論実行」と呼ばれるんや。

トレーニングクラスターは多かれ少なかれ閉鎖システムや。文字通りどこに置いても関係ないねん。少なくとも顧客に近い必要があるっちゅう意味では関係あらへん。顧客がデータにアクセスしとるわけやないからな。

それでもネットワークはあるで。大規模なトレーニング施設同士を巨大な光ファイバー回線で接続して、複数のAIデータセンターにまたがって大規模なトレーニング実行を行おうっちゅう取り組みもある。でもそれは従来型データセンターが必要とするようなネットワークアクセスやプロバイダー間ルーティングとは違う種類やねん。

推論処理における遅延の重要性

でも推論はどうなんや?ChatGPTに質問したら、推論を実行するデータセンターと直接やり取りするやろ?それは確かにそうやけど、推論も従来型データセンターと同じようなネットワークは必要ないねん。遅延に敏感やないからや。

コンピュート部分、基本的に答えを計算する部分は数秒かかることがある。その上に500ミリ秒の遅延を加えても、それはかなり多いけど、体験は変わらへん。チャットボットは、コンピュートで制限されとる限り、遅延に敏感なアプリケーションやないんや。帯域幅もそんなに必要あらへん。

画像や動画生成みたいな新しいアプリケーションを考えても、レスポンス時間に関してはコンピュート時間がネットワーク接続よりまだまだ重要やねん。これは将来変わるかもしれん。AIがもっと反応よくなったらな。でも今のところ、トレーニングも推論も強い遅延や帯域幅の要求はないんや。少なくとも消費者向けではな。

Netflixが何千何万もの4K映画を同時にストリーミング配信するのは全然違う次元やし、ビデオ通話やビデオゲームはもっときつい遅延要求があるからな。AIデータセンターにとっては、重要な要素やないんや。

コンピュート密度の重要性

コンピュートを見たら、違いはさらに大きくなる。さっき言うたように、AIデータセンターは実はスーパーコンピューターに近いんや。唯一の目標は、できるだけ効率的に、できるだけ多くの計算性能を提供することやねん。

AI作業負荷でコンピュート効率を上げるには、密度を上げなあかん。それはチップレベルから始まるんや。AIコンピュートのナンバーワンプロバイダーであるNVIDIAを見てみよか。Volta、NVIDIAの最初のテンサーコアGPU以来、各GPU世代の性能と消費電力は急激に伸びとるんや。

Voltaはたった250ワットのTDPでまだまだおとなしかったけど、その後継のAmpereは400ワットまで上げた。次のHopperはTDPを700ワットまで上げて、NVIDIAの最新世代であるBlackwellは1000ワットに達しとる。単一のGPUでや。

2つのBlackwell GPUとNVIDIA Grace CPUを組み合わせたGB200スーパーチップは、単一ボードで驚きの2700ワットTDPやで。そしてこの傾向は続くんや。

NVIDIAはすでに最大4つのレチクルサイズチップで構成されるGPUを発表しとる。Blackwellの2倍のシリコンや。より高度なプロセスノードの効率向上を考慮しても、最初の2000ワットGPUはそう遠くないで。チップレベルでコンピュート密度が大幅に増加しとるんや。

ラック単位での密度向上

でもそれだけやない。新しいチップが大幅に増加したコンピュート性能を提供するだけやなくて、単一サーバーラック内のGPU数も同時に増えとるんや。現代のAIデータセンターを建設するときは、効率を重視して建設せなあかん。実際のコンピュートに使われへんワットは全部無駄やからな。

光学相互接続は長距離では素晴らしいし、正直言うて一定の距離を超えたら他に選択肢がないんやけど、光学トランシーバーやリタイマーが必要で、これらは大量の電力を消費するんや。そやから、できるだけ銅線を使いたいんや。

NVIDIAのGB200 NVL72コンピュートラックには5000本以上のワイヤーと2マイルの銅線が入っとる。もしNVIDIAが代わりに光学を使うとったら、現在の銅ベースのNLinkソリューションより2万ワット多く消費してたやろな。

でも銅線は本当にラックスケールでしか使えへんねん。単一のデータセンター内でも、どっかの時点で光学に切り替えなあかん。やから単一ラックにできるだけ多くのGPUを入れて、そのうちできるだけ多くを銅線で接続したいんや。

コンピュート密度がAIデータセンターにとっての聖杯やねん。GPUにはできるだけ多くのシリコンを使わせて、単一ボードにはできるだけ多くのGPUを搭載して、単一ラックにはそれをできるだけ多く入れたいんや。やから単一ラックの電力要求が増え続けとるんやで。

従来型とAIデータセンターの電力消費比較

従来型とAIデータセンターがどんだけ違うかを見る一番ええ方法は、それぞれのデータセンタータイプで単一ラックがどれだけのコンピュートを使って、直接的な影響として、どれだけのエネルギーを使っとるかを見ることや。

従来型データセンターで、Google、メタみたいなハイパースケーラー以外のランダムなサーバーを選んだら、10キロワット以上使うラックを見つけるのは難しいやろな。

典型的なラック電力消費は3キロワットから多分7キロワットの範囲や。ラック当たり10キロワット以上は、従来型データセンターではすでに高性能と考えられとる。ハイパースケーラーが15から20キロワットの範囲でラックを建設しとるとしても、AIコンピュートに使われるラックとは比較にならへん。

さっき話したNVIDIA GB200 NVL72は、NVIDIAの最速ラックサイズソリューションやけど、33キロワットずつ提供する4つのパワーシェルフがある。単一ラックで合計132キロワットや。従来型データセンターで高性能と考えられるセットアップの10倍で、標準的な普通のサーバーのラック電力の30倍から40倍やで。

ここで話しとるんは小さな違いやない。昼と夜ぐらい違うんや。「AIデータセンター」がちょっと誤解を招く名前やって言うたのは冗談やないで。この数字はスーパーコンピューターさえも上回っとるからな。

もし可能やったら、AIハイパースケーラーはギガワットラックを建設するやろ。密度が王様やからな。想像できると思うけど、コンピュートと電力密度のこの大幅な増加は、冷却にも直接影響するんや。

液体冷却への移行

重要IT電力が低い従来型データセンターは、小さな冷却ソリューションが必要や。当たり前やな。最近まで、ほとんど全てのデータセンターは空冷やった。でもこれが変わってきとるんや。AIコンピュートを実行するデータセンターは、急速に液体冷却に移行しとる。

これには密度に関連した3つの具体的な理由がある。これはAMDのMI300X AI加速器や。単一のGPUで、サーバーブレードにインストールする準備ができとる。でもその体積の約90%は巨大なヒートシンクが占めとるんや。その金属の下にある小さなPCBが実際のGPUやねん。

コンシューマー向けGPUと違って、サーバー向けGPUには個別のファンがない。巨大なヒートシンクが付いとるだけで、単一ブレード上の全コンポーネントを冷却する産業用高性能ファンで冷却されるんや。

液体冷却に切り替えることで、各GPUの物理的なフットプリントが劇的に減るんや。液体クーラーは空冷に必要な巨大なヒートシンクよりもはるかにコンパクトやからな。文字通り密度が上がるんや。ヒートシンクで無駄になるスペースが少なくなるから、単一サーバーブレードとラックにより多くのハードウェアを詰め込めるようになるんやで。

もちろん、液体冷却にはデータセンター内外に大量の追加インフラが必要や。でもそれはラックスケールの外や。密度がもう重要やない場所やねん。

2番目の側面は冷却性能や。液体冷却は単位体積当たり空気の約4000倍のエネルギーを吸収できるんや。非常に密度の高いセットアップで大量のGPUを冷却せなあかんから、大量の熱を除去せなあかんときは、これが唯一の選択肢やねん。

超高密度設計は液体冷却でしか実現できへん。まだ空冷を使うBlackwellの実装もあるけど、次世代AI加速器はほぼ確実に液体冷却を使うやろ。例えばGoogleは、社内の高性能TPU用に液体冷却にずっと前から切り替えとるしな。

液体冷却の隠れたメリット

でも液体冷却には3番目の、時々見落とされる側面がある。シリコンを低い温度で動かすことは、寿命を延ばすだけやなくて、エネルギー効率も向上させるんや。GPU1つだけ動かすんやったら大したことないけど、10万個のGPUを動かすんやったら、節約効果が積み重なるんや。そのエネルギーはもっと重要なこと、つまりもっと多くのコンピュートに使えるねん。

もちろん、液体冷却は最初から計画せなあかんもんや。空冷データセンターは液冷データセンターとは全然違う設計やからな。平均的なデスクトップPCで空冷クーラーを水冷クーラーにアップグレードするような簡単な話やない。データセンターのレイアウトを完全に変えてしまうんや。

ラックレベルからビルディングレベルまで給水管を含める必要があるし、巨大な冷却塔も設置せなあかん。でも最高のコンピュート密度を目指すんやったら、それだけの価値があるだけやなくて、競争力を保ちたいんやったら他に実用的な選択肢が単純にないんや。

電力容量による規模の新基準

コネクティビティ、コンピュート、クーリングについて説明したから、今度は電力について話そか。でもラックレベルやなくて、それはもう議論したからな。施設全体のレベルでの電力について話すんや。これがデータセンターの「サイズ」について話すときの一番の基準になっとるからな。

話しとるんは建物の実際のサイズやなくて、データセンターの総電力容量、「重要IT電力」とも呼ばれるもんのことや。従来の「小売データセンター」は、重要IT電力が10メガワット未満のことが多い。

D.C.のダレス空港周辺のデータセンター群みたいな、より大きな「卸売データセンター」でも、10から30メガワットの範囲やねん。マイクロソフト、Google、アマゾン、メタみたいなところの現代ハイパースケールデータセンター、まだ実際にデータをホストする従来型データセンターの話やけど、これらは重要IT電力が40から100メガワットに達することがある。

でもAIデータセンターの重要IT電力と比べたら、全部霞んでしまうんや。重要IT電力が200メガワット以上のAIデータセンターが複数あるんやで。例えばマイクロソフトは、OpenAI用に300メガワットのAIデータセンターを2つ運営しとる。そしてこれはまだ始まりに過ぎへん。

重要IT電力1ギガワットのAIキャンパスがすでに建設中やねん。従来型データセンターは使用パターンに基づいて電力需要が変動して、フル稼働することはめったにないんやけど、AIデータセンターはほぼ常にフル負荷に近い状態で動いとるっちゅう事実で、これが全部さらに増幅されるんや。

電力インフラの課題

この巨大な重要IT電力を持っとるだけやなくて、実際にそれを使うんや。AIデータセンターの電力要求では、主要な高圧電力線への直接アクセスについて話しとるんやで。サーバーラックは高圧では動かへん。高圧は10万ボルト以上やからな。電圧を下げるためにトランスフォーマーが必要やねん。

まず中電圧に下げて、それから低電圧に下げる。データセンターでは通常415ボルトや。大都市に匹敵する電力消費で、これらの巨大なAIデータセンターには大量のトランスフォーマーが必要やねん。

実際めちゃくちゃ多くて、受注帳簿にはすでにバックログができとるんや。以前は主に政府が大都市や工業センターに電力を供給するために購入しとったトランスフォーマーが、AIのせいで急に高い需要になっとるんやで。

従来型とAIデータセンターのもう一つの興味深い違いは、バックアップ電力の考え方や。従来型データセンターにとって、停電は重大な障害点やねん。やから無停電電源供給を確保するシステムが必要やんか。

非常に短期間では、非常用発電機がオンラインになるまでの時間を橋渡しする電池が必要やねん。でもAIデータセンターは電力需要がとてつもなく大きいから、大量の発電機が必要で、それは購入するだけやなくて、適切な許可も必要やねん。

これは大量の追加コストを加えるだけやなくて、セットアップに時間もかかるんや。AI競争では市場投入時間が重要やから、AIデータセンターは非常に限定的なUPSシステムを持つことが多いねん。この場合、メイン電源が故障したら、データセンターは単純に動かんくなるんや。

訓練実行における停電の影響

面白いことに、これは訓練実行にとってはそんなに大きな問題やないんや。GPUがすでにある程度頻繁な故障を起こすからな。停電になっても、電力が戻ったときに訓練実行を単純に続けたらええんやで。

わしはここで本当に表面をなぞっとるだけやねん。コンピュート、コネクティビティ、クーリング、パワー、どれをとってももっと深いもんがあるんや。今説明したことのほとんどは、SemiAnalysisの素晴らしいデータセンター解剖シリーズに基づいとるんやで。これは現代AIデータセンターのあらゆる側面を詳細にカバーしとる。

巨大なAIデータセンターの電力段階が実際どう動くんか、データセンターを液体冷却対応にするために何が必要かを知りたかったら、動画説明欄でリンクした記事を絶対チェックしてや。

わしはこういうコラボレーションを始めるずっと前からSemiAnalysisの購読者やったし、確実にお金の価値があるで。でも秘密は、SemiAnalysisの記事の80%みたいなもんがペイウォールの後ろにないっちゅうことや。それでわしも引っかかったんやで。

研究したあらゆるトピックについて、業界がどう動いとるかを消化しやすい方法で実際に説明してくれる超詳細な記事をSemiAnalysisで見つけたからな。購読なしでもトップクラスのリソースやねん。

購読したらもっとよくなるで。心から言うとるんやで。半導体分野とAIデータセンターに少しでも興味があるんやったら、リンクをチェックして記事を読んでみてや。めちゃくちゃ価値があるから。

テンプル、テキサスの謎解き

AIデータセンターについて全部学んで、従来型データセンターとは全然違うもんやっちゅうことが分かったところで、テンプル、テキサスの謎の畑に戻ろか。

なんでメタ社は新しいデータセンターの建設を始めて、建設の途中で取り壊したんやろ?簡単におさらいしとくと、建設は2022年半ばに始まって、少なくとも2022年末まで進行したけど、2023年4月までには建設現場全体が平らにされとったんや。

その間に何が起きて、メタ社がこんな極端な行動を取ることになったんやろ?お前らの中で頭のええやつらはもう気づいとるかもしれんけど、このタイムラインは2022年11月のChatGPTリリースとほぼ完璧に一致しとるんや。せやから、それがわしらの答えなんか?メタ社は従来型データセンターの建設を始めて、建設の途中でそれが時代遅れやって気づいたんか?

まあ、そんなところやな。でもそれよりもっと極端やねん。最初の建設現場は、メタ社の試行錯誤されたH型データセンター用やったんや。データセンターの最終的な形がアルファベットの「H」みたいに見えるから、そう呼ばれとるんやで。

実際に衛星画像をもっと詳しく見てみたら、最初のビルドが完成しとったらHみたいに見えたやろうっちゅうのが分かる。このH型データセンターの多くは、CPUとハードドライブで満たされた、より従来型のデータセンターの役割で使われとるんや。

でも最大のエネルギー効率を目指して設計されとるとはいえ、メタ社のH型データセンターはすでにGPUを動かすことができるんや。メタ社は複数の同じH型データセンターにまたがって10万個のH100 GPUを組み合わせた、NVIDIAのHopperベースの巨大なAIクラスターを持っとるからな。

せやからメタ社はすでにテンプルでAI対応キャンパスを建設しとったんや。でも競争力を保つのに十分なエネルギー密度を提供してなかったんやな。業界の動きがそれだけ速いっちゅうことや。

建設中に時代遅れになるデータセンター

非常に速いタイムラインで建設されるAIデータセンターでさえ、建設中に時代遅れになることがあるんや。この話にはハッピーエンドがある。少なくともメタ社にとってはな。

2025年の最新衛星画像を見てみたら、テンプルの小さな畑には今、1つやなくて2つのAIデータセンターがあるのが分かる。これがメタ社の新しい高密度設計で、各建物が約85メガワットを提供して、合計重要IT電力が170メガワットやねん。

新しい設計には液体冷却をサポートするっちゅう追加のメリットもあって、それがそもそも高密度レイアウトを可能にしとるんや。古いH設計やったら合計たった60メガワットしかサポートできへんかった。今日のAIデータセンター競争には少なすぎるんやで。

原子力発電所の復活

そしてこれはまだ始まりに過ぎへん。これはスリーマイル島や、ペンシルベニア州ハリスバーグ近郊のサスケハナ川にある原子力発電所やねん。1979年3月、スリーマイル島発電所は、TMI-2原子炉が重大な故障を起こして部分的なメルトダウンを起こしたときに悪名高くなったんや。

今日でも、アメリカ史上最も深刻な原子力事故やで。TMI-2の炉心は現場から除去されて、2番目の原子炉TMI-1は赤字運営やったから2019年に閉鎖されたんや。現場全体はそれ以来、廃炉予定になっとった。

でもそれが変わったんや。去年2024年に、マイクロソフトが現場の所有者であるConstellation Energyと、まだ動くTMI-1原子炉を再稼働させる契約を発表したんやで。原子力発電所は2027年に運転を再開する予定で、全てのエネルギーが今後20年間マイクロソフトに供給される。

そしてマイクロソフトがその電力を何に使うかは、もうお前らも分かっとるやろ。次世代AIデータセンターに電力を供給するためやねん。

これが極端な例やと思うんやったら、もう一回考えてみてや。スリーマイル島からそう遠くない、車で約2時間のところに、サスケハナ蒸気電力ステーションがある。約2500メガワット出力の原子力発電所や。

2023年に、発電所の運営者であるTalen Energyが、現場に巨大なデータセンターの建設を始めたんや。これが2024年に約6億5000万ドルでAmazon AWSに買収されたんやで。

エネルギー需要に対する業界の対応

データセンターを原子力発電所のすぐ隣に置く理由は一つしかない。AIの巨大なエネルギー需要に電力を供給するためやねん。業界全体で似たような動きが見られとる。

メタ社はテンプルの畑でデータセンターを再建しただけやなくて、新しいAIデータセンターをテントに置き始めとるんや。建設時間を短縮するためやねん。コンピュート密度と並んで、速いことがAI競争では重要やからな。

メタ社のAI拠点トップ2は、オハイオ州のPrometheusや。これはガスタービンで動く既存のAIクラスターで、来年には1ギガワット以上まで拡張される予定やねん。でも1番はHyperionスーパークラスターで、これは本当に不可能なスケールに達する予定やねん。

2030年までに、ルイジアナ州にあるこのサイトは合計重要IT電力2ギガワットに達する予定で、5ギガワットまで成長する余地があるんやで。比較のために言うとくと、ドイツ全体の平均電力使用量は約60ギガワットやねん。

ハイパースケーラーのCoreweaveは、テキサス州デントンで以前ビットコインをマイニングしてた古い仮想通貨マイン・データセンターを買収して改造したんや。衛星画像を見てみたら、この場所に大きな建物のクラスターが見えるけど、一つだけ他と違うもんがある。

サイトの中心には、AIデータセンターに直接電力を供給する巨大なガス発電所があるんやで。イーロン・マスクのxAIは最大規模で、15万個のNVIDIA GB200を持っとる。データセンターの成長があまりにも速いから、メイン電源がオンラインになるのに時間がかかりすぎて、モバイル発電機で供給せなあかんようになっとるんや。

みんな可能な限り急いでスクランブルかけとるんやで。今わしらが見とるんは、まだ始まりに過ぎへんねん。

未来のスケール予測

300メガワットクラスターは2025年には大きく見えるかもしれんけど、最初のギガワットクラスターは来年オンラインになるんや。今のところ、20万個のGPUはAIクラスターにとって多いんやけど、すでに100万個のGPUの計画があるんやで。

そしてこれらは今日と同じHopperやBlackwell世代やない。さらに高いTDP数値を持つ今後のGPU世代やねん。単純な事実は、AGIを信じるかどうかは関係ないっちゅうことや。

重要なんは、主要プレイヤーが明らかにAGIへの競争やと信じとって、最初にそこに到達した者が全部のケーキを取るっちゅうことや。そのケーキは何兆ドルもの価値があるから、最初に到達するためにできることは何でもする気なんや。

そしてそれには文字通り電力が必要やねん。大量の電力がな。Googleは3つの先進的な原子力発電所の建設資金提供を発表しとる。ほとんどの主要ハイパースケーラーがエネルギー事業の主要プレイヤーになるのも、そう遠くないやろな。

エネルギー事業への参入

複数の原子力発電所を所有・運営することも含めてな。次世代AIデータセンターは従来型データセンターと共通点が全くないだけやなくて、近いうちに個々のデータセンターキャンパスがメガシティや巨大工業団地の電力需要さえも上回るようになるやろ。

最大のAIクラスターは、工業国に匹敵する電力需要を追加しとるんやで。減速しとらんねん。AGIへの競争はコンピュートだけの話やない。電力の話でもあるんや。文字通りの意味でも比喩的な意味でもな。

この傾向が続いたら、AIが世界ナンバーワンのエネルギー消費者になるやろ。データセンター業界では非常に多くのことが起きとって、全ての発展を追うのはほぼ不可能やねん。

秘密主義のAI競争

Top500に載ることを熱望して達成したことを見せびらかしたがるスーパーコンピューターと違って、AIデータセンターははるかに秘密主義やねん。AI競争は公然とは行われてないんや。少なくともPR発表以外では、どこを見たらええか分からんかったらな。

ハイパースケーラーは、お前らや競合他社に、実際にどれだけのコンピュートを持っとるか、今後数カ月や数年でどれだけ追加するか、AIデータセンターがどれだけ競争力があるか、というよりもどれだけ密度が高いかを知られたくないんや。そして全てのデータセンターがどれだけの電力を消費しとるかもな。

でも、こういうプロジェクト全部についてどうやって知っとるんやろ?重要IT電力、何個のGPUを動かしとるか、どれだけ効率的か、どの電源を使っとるかを、どうやって知っとるんやろ?

答えは、大きな知識ベースと、大量の高品質研究と、実際に高解像度衛星画像にお金をかけることの組み合わせやねん。Google Earthにあるような、半年に一回低解像度の更新があるかもしれんやつやなくて、プロ仕様の衛星画像のことやで。

SemiAnalysisの調査手法

これはわしの妄想を説明しとるんやない。SemiAnalysisのデータセンターチームの頭のええやつらが実際にやっとることやねん。ちょっと狂気じみとるかもしれんけど、SemiAnalysisは世界中で5000以上のデータセンターを追跡しとるんや。

追跡って言うんは、名前と住所が書かれた簡単なExcelシートのことやない。真のシャーロック・ホームズ的なやつのことや。データセンターモデルは新しい建設プロジェクトを追跡するだけやなくて、既存のデータセンターも追跡しとる。

高解像度衛星画像が詳細に分析されるんや。電力段階、発電機、冷却インフラが見えるから、データセンターチームは実際に各データセンターについて非常に詳細な洞察を作成できるんやで。もちろん、何を探したらええかを知っとる場合に限るけどな。

でも知っとったら、そしてSemiAnalysisのデータセンターチームは確実に知っとるから、データセンターは開かれた本みたいなもんやねん。SemiAnalysisのAIデータセンターモデルが提供するカバレッジと洞察に匹敵するもんは他にないと思うで。

業界で働いとるか、業界と関わっとって、現在のAIデータセンター市場の非常に詳細な概要に興味があるんやったら、データセンターモデルを絶対チェックせなあかん。めちゃくちゃかっこいいだけやなくて、AGIへの急速な競争について利用可能な最も広範囲な洞察を提供してくれるんやで。

ChatGPT以降の加速する変化

ChatGPTがリリースされたんは2022年11月、3年もたっとらんねん。それ以来、全てが加速しとるような気がするわ。AGIへの競争が、加速するばっかりのAIコンピュートへの満たされへん需要を作り出したんや。

データセンター業界は今、実際のデータセンターよりもAIスーパーコンピューターの建設に重点を置いとる。そしてそれと一緒に巨大な電力需要がやってくるんや。

それはより多くのトランスフォーマー、より多くの発電機、液体冷却を意味するだけやなくて、エネルギー生成がハイパースケーラーと大手テック企業のますます重要な焦点になっとるっちゅうことでもあるんや。

ChatGPTのローンチから来年まで、AIコンピュートは推定40から50ギガワットの世界的電力需要を追加するやろ。これらはフランスやドイツみたいな国全体の平均使用量に匹敵する数字やねん。

世界を変える規模への到達

そしてわしは繰り返しとるって分かっとるけど、これはまだ始まりに過ぎへんねん。この傾向が続いたら、Google、マイクロソフト、メタ、アマゾン、その他のハイパースケーラーが世界のほとんどの国よりも多くの原子力発電所を運営するようになるまで、あと数年しかかからへんやろ。

そして毎年ベースで、ほとんどの国家を上回る重要IT電力を持つAIデータセンターを追加するんやで。これら全部がAGIを最初に達成することを期待してやねん。

そしてもしそこに到達したら、AI電力需要はさらに急増するやろ。本当にAIデータセンターが世界を食い尽くそうとしとるように見え始めとる。どこを見たらええか知っとったら、最初の一口はすでに見えとるんやで。

SemiAnalysisチーム全体、特にわしのバカな質問全部に非常に忍耐強く答えてくれたJeremieに改めて感謝するわ。彼らの素晴らしい仕事をチェックしてや。次の一口がいつ来るかを知りたかったら、SemiAnalysisデータセンターモデルが一番ええ天気予報やで。

この動画が面白いと思ってくれて、次の動画でまた会えることを願っとるわ。あ、こういう動画をもっと見たかったら、チャンネル登録してな。

コメント