この動画は、OpenAIの最新モデルGPT-5に対する詳細な分析と評価である。投稿者は初回のライブストリーム配信では期待を下回る印象を受けたものの、実際に使用してみると従来モデルでは解決できない問題を解決できることを発見した。特に注目すべきは幻覚率の劇的な改善とコンテキスト性能の持続性であり、これらがエージェントの経済的価値実現に向けた重要な突破口となっている。国際数学オリンピック問題での優秀な成績は、モデルが革新的な解決経路を構築できる能力を示している。小型でありながら高性能なこのモデルは、将来のBlackwell GPU世代での更なる飛躍的進歩を予感させる。

GPT-5の第一印象と実際の性能

そやから、GPT-5がついに来たわけや。みんなが落ち着くまで待ってからこの動画作ろうと思ててん。なんでかって言うたら、このモデル周りでめちゃくちゃ騒がしかったからな。まあそうなるやろうと思ってたけどな。ライブストリーム見てて、正直ちょっと物足りん感じやってん。でも実際に使ってみたら、なかなかええねんこれが。

ただな、約束されてたもんとはちゃうかったし、正直言うて俺が思ってたんとも違ってたわ。もっと大きなモデルを期待してたんや。これ、めちゃくちゃ小さいモデルやねん。O3より小さいんやで。コストなんてClaude 3.5 Sonnetの半分や。そのモデル、1年以上前に出たやつやのに。

それでもベンチマーク全部で勝ってる。全部のベンチマーク飽和させとるんや。俺がこのモデルにできるとは思ってなかったことまでやっとる。実際に俺のコードベースに適用してるし、俺が作ってる実際のプロダクトの現実の問題に使ってる。そしたら俺やったら絶対見つけられんような、他のどのモデルでも見つけられんかったようなもんを見つけてくれるんや。

O3も試した、4.1 Opusも試した、2.5 Proも試した。どれもできんかったのに、このモデルはできる。

幻覚率の劇的改善という革命的進歩

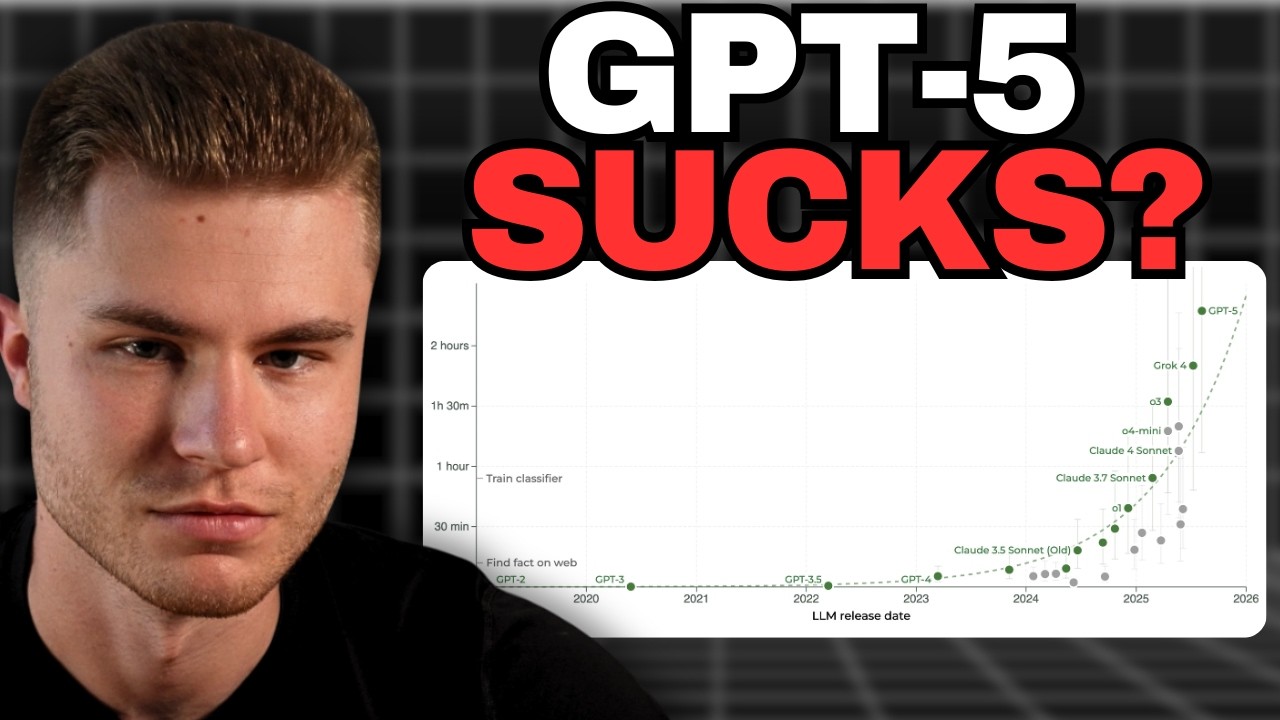

これが俺がこのモデルがみんなが言うとるより実際ええと思う理由の1つ目や。この2つのグラフに集約されてる。正直言うて、今のAI革命の段階で、これまでのどのグラフよりもこの2つのグラフが断然一番重要や。

まず幻覚率が地に落ちてる。このモデルは幻覚を解決する最初の一歩や。確かにまだ小さなアホなことは間違える。例えば、適当に長い単語の中にRが何個あるかとか。そんなんどうでもええねん。俺が見たいんは実際の問題空間に適用されてるかどうかや。

それは本当の問題やないねん。だから俺はトークン化の問題とかどうでもええ。適当に長い単語で適当な数のRが入ってるやつは、1つの単語の中に複数のトークンがあって、正しくトークン化されてないだけやから。いつか修正される問題やと思ってるし、今はそんなに重要やない。ちょっとした可愛い小技みたいなもんや。だからそんなん気にせん。

でも全体的に幻覚率は劇的に下がってる。普通やったら、これらのモデルに第一原理から考えて、システムの既約成分を実際に見つけさせようとすると、システムの中で全然既約やない何かを完全に適当に言うねん。全然印象的やない。このモデルは初めて、システムの既約成分に変数を実際に結びつけて、そこから積み上げていくことができる。そんなモデル今まで見たことない。O3でも試したし、他の全部のモデルでも試した。さっきも言うたけど、これがそれをするほど実際に知能が高い初めてのモデルや。

それでも3.5 Sonnetの半分のサイズ、つまり半分のコストなんや。これが1つ目。幻覚率が解決されつつある。まだ完全にそこまで行ってへんけど、細かいところでちょっとはあるやろうけど、幻覚率がこの2つ目のグラフに影響してるんや。

コンテキスト性能の持続性という画期的特性

時間経過に伴うコンテキスト性能や。経済的価値のあるエージェントを持つ最大の制約は幻覚率やった。それがコンテキストウィンドウ内でより長い性能を発揮するタスクを可能にしてくれる。これは時間とともにどんどん長くなっていく。GPT-5が全体的に一番上で一貫してるのが見えるやろ。O3は半分くらいでほぼ真っ直ぐ下に落ちて、ほぼ即座に下がってる。

これが経済的に実現可能なタスクにおける全てや。これが文字通りその要素や。俺らが欠いてる唯一のもんで、実際に本当の進歩を見せてる。だからGPT-5がローンチされた時に測定された他の全てのベンチマーク、実際にそこにあるもんを本当に表現してへんような疑似ベンチマークがあったけど。

これが重要なやつや。他のやつは飽和してる。全部やないけど、多くが飽和してる。でも多くはまたこれや。俺が実際に印象受けたんはこれで、実際に本当の進歩をくれてるんはこれや。

国際数学オリンピック問題での革新的推論能力

国際数学オリンピックモデルを見たら、これらも幻覚率が解決されつつあることと長いコンテキスト性能が解決されつつあることの指標や。国際数学オリンピック問題を見たら、何ページも何ページも何ページもの作業が必要な数学的証明や。出力は同じやけど、そのページは途中で変わることがある。その1つの決定論的な答えに到達する特定の1つの道筋があるわけやない。つまりこれらのモデルは文字通り道筋に沿って革新してて、その答えに到達するために道筋に沿って幻覚してへんってことや。

統計的トークンの1つが間違ってて、その答えへの道筋で長い確率、間違った確率が出てきたら、答えは完全に間違ってしまう。これが幻覚がそこにないことの最初のサインや。これがこれらのモデルでの本当の革新の最初のサインや。なぜなら解決しようとしてる問題への道筋を革新してるからや。

問題があるとする。質問でも何でもその質問や問題が、このエージェントを解決策がある道筋に向かう方向に指し示すベクトルや。そしてそれが問題を解決するための弧に沿って革新しながらこの足場を組み立てる。知能を、異なる手段を通じて同じ目標を達成することと定義することができるかもしれん。

知能の定義と効率性の向上

例えば俺に目標があって、君がその目標に向かってる。そして俺がその道筋の前に障壁を置く。君は同じ目標への異なる道筋を見つける。それが知能のサインや。もしくは君が目標への道筋を見つけて、それから目標へのより早い道筋を見つける。よう似た話や。そしてそれをどんどん早くできるなら、それはどんどん知能が高いってことや。

さて、このポケモンの例を見てみよう。O3モデルがポケモンを倒すのにGPT-5の文字通り3倍の時間をかけてる。これが3倍の知能のサインやないとしたら、俺は何が知能なんかわからん。これらのモデルはポケモンで訓練されてへん。ただこの環境に置かれて自分で理解せなあかんねん。

そして彼らは分布とニューラルネットにポケモンの情報を持ってる。人間もそうや。人間もポケモンを選ぶ。ゲーム始める時にすでにポケモンについてちょっと知ってる。ピカチュウが何かわかってる。何をせなあかんかわかってる。ポケモンボールが何かわかってる。そしてただゲームをプレイするねん。これらのモデルとそんなに違わん。

明らかに空間を移動しながらシナプス結合を作ってるわけやないけどな。でもそこまで到達するやろう。

メータベンチマークでの実用的成果

最後のポイント、メータベンチマークや。メータベンチマークを知らん人は、基本的に人間が普通やる作業の持続時間や。人間が2時間でやるようなことを、モデルは多分15分くらいでやるけど、AIモデルとしてその2時間の長いタスクを処理できる。なかなか印象的やな。

今のところ成功率50%やから、人間が2時間かかる問題を解決するのに2回試すかもしれん。それで30分かかる。なかなか印象的や。時間をめちゃくちゃ節約してるってことやな。

とにかく、俺らが見てるんは、モデルが小さくなって値段が半分になっても、この弧に沿って進歩が加速し続けてるってことや。

また、俺はこのモデルを過大宣伝しようとしてへん。全然ハイプマンになろうとしてへん。ただ本当に掘り下げて考えたらすごいことやと思うねん。なかなか印象的や。そしてこのモデルが感じる理由は、GPT-5と会話してる時、対話してる時、あんまり知能的やない感じがするねん。めちゃくちゃ小さくて軽いモデルやから。

700億パラメータのモデルと話してるような感じや。実際に中にどれくらいパラメータがあるかわからんけど、そんなにパラメータがないような感じがする。それが、こんなに小さなモデルからこれだけの効率、これだけの向上を絞り出せるってことをめちゃくちゃ印象的にしてる。

小型モデルの可能性と将来への期待

GPT4.5や40みたいなモデルと話すと、モデルはめちゃくちゃ大きくて、これらのモデルの中にめちゃくちゃ面白い個性がある。特定のトピック周りのデータの量を、その特定のトピックに対する重力みたいに見ることができる。例えば「犬」という単語を言う方法が100万通りあるとする。

「犬」という単語を無数の異なる文で無数の異なる方法で言う。その「犬」という単語周りにはめちゃくちゃ曖昧さがあって、それがこれらのモデルに、小さなパラメータのモデルにはできないめちゃくちゃ微妙で複雑な方法で表現することを可能にしてる。でも小さなパラメータのモデルがエージェント的な時間軸で実際に知能的なことをしながらこれだけの進歩を作ってるという事実が、俺をめちゃくちゃ強気にさせる。言葉にできんほどや。

モデルをスケールアップしてみよう。小さなモデルでやったのと同じことをして何が起こるか見てみよう。そう言わせてくれ。めちゃくちゃすごいことになる。

GPU世代交代と計算能力の倍増

それについて言うと、俺らが理解せなあかんのはGPT-5はまだ古いモデルやってことや。ここにGavin Bakerのツイートがある。ちょっと探してみる。今見つけられんかった。

Gavin Bakerを知らん人は、彼はテックCEO、ベンチャーキャピタリストや。AI分野でかなり大きい存在か、AI分野でそんなに大きくないかもしれんけど、AIについてめちゃくちゃ知ってる。彼が言うには、「Grok 4、GPT-5、4.1、Opusは全部昔ながらのHopper GPUで訓練されたってことを覚えとくのが重要や。」

Blackwellモデルはまだここにもない。まだ訓練始めてへんと思う。もしかしたら始めてるかもしれんけど、まだここにはない。彼は最初のモデルがBlackwellで訓練されるのを次の6ヶ月で期待してるって言うてる。そしてSam Altmanもツイートした。「俺らは今後5ヶ月でGPU容量を倍にする」って。

GPU容量を倍や。今後5ヶ月でGPU容量を倍にする。つまり彼らは今持ってるデータセンターの2倍の大きさのデータセンターが5ヶ月後にオンラインになるってことや。なかなかかっこええな。そしてそれは大きなモデルが来るってことで、大きなモデルはこれよりもっと進歩する。それが彼らのやることやから。

彼らにはデータの曖昧さがある。ちょうどええだけのノイズ、面白い出力を実際に得るためのちょうどええだけのノイズがそこにあるけど、めちゃくちゃ計算コストが高い。そしてこれらのモデルはまだ小さいってことを覚えとかなあかん。モデルはまだめちゃくちゃ軽い。

Samも言うてたけど、実際にデプロイしようとしてた大きなモデルがあるけど、十分な計算容量がないからやめたって。でもそのモデルは来ると思うし、多分次の5-12ヶ月で見ることになって、GPT-5をちょっと滑稽に見せるやろう。でも様子を見よう。

俺が知ってるんは、これらのものの科学が進歩してるってことで、それが本当に重要なことや。メータベンチマークをまた見たら、2020年から2026年の今の位置を見たら、ちょっとした離陸を見始めてて、GPT-5でここまでずっと加速を見てる。めちゃくちゃ小さなモデルやけど、めちゃくちゃ有能や。

指数関数的成長の驚異的可能性

これを引いて見てみよう。2036年まで引いて見てみよう。この改善率が続くと仮定してみよう。そうなりそうやねん。最初は俺らがS字曲線にぶつかると思ってたけど、正直に言うと、国際数学オリンピックモデルが俺の心を吹き飛ばしてる。だから俺らがこれを展開したら、また、これがそうなるかはわからん。

2030年までに簡単にお尻を上げ始めるかもしれん。ある意味そうなると思う。2035年までにお尻を上げるかもしれん。わからん。全くお尻を上げへんかもしれん。俺らには全然わからん。でも2036年まで展開したら、こんな感じになる。短いグラフは2026年まで行くのを思い出してくれ。これは2036年まで行く。

2026年を引いたグラフで見たら、離陸は全然見えん。全然離陸は見えん、2032年まで。2032年まで何も見えん。でも引いて見ると、2026年ではこんな感じに見える。これは同じデータ、文字通り同じデータや。俺がやったんは、メータからデータを取って、より長い期間にわたって伸ばしただけや。これが指数関数の力や。

離陸も見えへん。できん。このグラフでは見えもせん。俺、すまん。俺はMr. ハイプマンになろうとしてへん。ただみんなに物事を視野に入れてもらおうとしてるだけや。でもとにかく、2025年から2035年の実際のテーブルがこれや、見たかったら。

2035年には1タスクあたり41年を得る。つまりこれらのエージェントは1つのプロンプトで全生涯を生きてるってことや。もしくはその時点ではそれは生涯の3分の1かもしれん。6分の1かもしれん。誰が知ってる?でもわからんな。みんなどう思うか教えてくれ。コメントでみんながどう思うか教えてくれ。

制約の解決と科学的突破口

確かに現実的な制約があることは知ってるけど、その制約は解決されつつあると思う。これらのモデルの周りで科学的制約みたいなもんはもうないと思う。国際数学オリンピックモデルが、これが動くために作らなあかん突破口がそんなにないってことをすでに俺に見せてくれてる。検証が難しいタスクで進歩してる。コンテキストの長さで進歩してる。

さっき載せたチャートでそれを見た。もう一回載せる。コンテキストの長さと、そのコンテキストの長さでの時間経過の性能と、幻覚率での信頼性が解決されつつある。また、国際数学オリンピックモデルがそれの指標や。問題は解決されつつある。

他に何て言うたらええかわからん。面白いことに、前の動画で言うたと思うけど、俺はPeter Diamandisとエリック・シュミットのインタビューを見てた。エリック・シュミットがOpenAIのNoam Brownと話してて、エリック・シュミットが「今年の言葉は足場のようやな」って言うた。知らん人は、足場はこれらのモデルが動くもんや。

彼らはエージェント的になれん。カーソルのような足場なしには経済的価値を適用できん。Claude Codeのような何らかのCLIモデル。それがモデルが動く足場で、そしたらNoam Brownが、内部的にモデルは君がプロンプトして解決させる問題空間のために自分自身の足場を構築し始めてるって言うた。それはめちゃくちゃ心を吹き飛ばす話で、彼らが問題空間内でちょっと革新する能力、君がプロンプトしてその問題を解決しに行かせてる間にちょっと革新する能力を持ってるってことや。

エージェント的推論の発展と将来展望

例えば俺がこっちのビジネスの中の問題を解決してもらいたいとする。俺が「あっちに行ってその問題を解決して」って言える。彼らが「足場がない。その空間の中で問題を解決できるように自分で足場を構築させてくれ」って言う。だから国際数学オリンピックのようなものを解決できる推論モデルのタイプを持つことがめちゃくちゃ重要や。それは全く同じタイプの問題やから。

全く同じタイプのことや。ただちょっとだけ広い。そんなに広くない、ただちょっとだけ広い。推論パラダイムは方向的に同じや。なんてこった。

とにかく、俺は過大宣伝しようとしてへん。また、これらの動画を作ってると興奮するから、俺はそれが得意やねん。ただ俺が起こってるのを見てることを共有しようとしてるだけで、他の人が俺が見てることを見てるかどうかわからん。もしかしたら俺がおかしいんかもしれん。教えてくれ。もしかしたらGPT精神病か何かにかかってるんかもしれん。みんなが見てることを教えてくれ。

それはさておき、俺の他のYouTubeチャンネルを登録してくれ。ツールで構築することが全てや。「一人AI ビジネスモデルの構築」って呼ばれてる。そのチャンネルにめちゃくちゃ興奮してる。かなり早く成長すると思う。AIとビジネスに関して多くの人があんまり話さへんことについて話してる。俺が話すことの多くはマーケティング側により重点を置いてる。多くの人が「Claude Codeを使ってこの3つのことをする方法はこれや」みたいなことを言う間。

俺は「それはあんまり価値ない」って感じや。Claude Codeは理解するのが難しくない。理解するのが難しいんはClaude Codeで何のプロダクトを構築するかや。だから俺が話すんはもっと大きな絵で、どのプロダクトを構築すべきか、どう構築すべきか、どう市場に出すか、どうこれらのタイプの問題を実際に解決して成長できるかや。ただ適当な何かを構築させてくれやない。

何を構築したらええかわからんから、それを構築できるように何を構築すべきかや。それはさておき、動画をここで終わる。そこを登録してくれ。じゃあな。

コメント