本動画は、AIエージェントのための画期的な長期記憶アーキテクチャ「OmniMEM」と、その設計を自律的に行ったAIシステム「AutoResearchClaw」について解説したものである。単なるAIモデルの改善にとどまらず、AI自身が仮説を立て、コードを書き換え、実験を通じて自己の記憶構造を進化させていくプロセスを詳細に紐解いている。さらに、ベースとなった技術である「SimpleMem」の仕組みや、知識グラフを用いた複雑な検索手法、そして自己最適化の限界と次世代AIモデルへの課題についても鋭く考察している。

AIエージェントの長期記憶とOmniMEMの概要

コミュニティの皆さん、こんにちは。また戻ってきてくれて本当に嬉しいです。今回は、私たちのAIエージェントのための永続的な記憶、つまり長期記憶についてお話ししましょう。さっそく始めますね。

前回の動画でエージェントハーネスについて話したとき、状況はとてもシンプルでした。中心となるLLMがあり、そのLLMの周囲に複雑なファイルシステムが存在し、LLMへの情報の出入りというデータの流れ全体をコントロールしているというものでした。

今日お話しするこのハーネスのエンジニアリングについては、少し視点を変えて詳しく見ていきます。というのも、本日は自己学習の問題にも焦点を当てますが、あくまで記憶構造に絞って話を進めるからです。ここに4月1日に発表された新しい研究があります。エイプリルフールのジョークではありませんよ。2026年の研究で、タイトルは「OmniMEM: AutoResearchによる生涯マルチモーダルエージェントメモリの発見」というものです。ノースカロライナ大学チャペルヒル校、ペンシルベニア大学、カリフォルニア大学サンタクルーズ校、カリフォルニア大学バークレー校、そしてCiscoによる素晴らしい共同研究です。

この研究のアイデアは実にクレイジーです。彼らは自律型のLLMエージェントを用意しました。OpenClawを使って自律型エージェントとしてコードを書き、ベンチマークを実行し、すべてのバグを診断するという手法はご存じかもしれません。そして、数十世代にわたってシステムアーキテクチャ全体を反復的に進化させ、より優れたシステムアーキテクチャを導き出すのです。

ここでマルチモーダルな記憶構造のみに焦点を当てると、アーキテクチャの選択にまたがる膨大な設計空間をナビゲートする必要があります。ストレージをどのように構造化するか、情報をどのように見つけ出すかという検索戦略全体、そして関連する情報、知識、データの探し方などです。さらに、プロンプトエンジニアリング全体も含まれます。DSPyから、入力パイプラインやプロンプト構造へのコンテキストの提示方法、そしてデータパイプラインの構成全体に至るまで、すべてです。今回は賢い人間の手から始めるのではなく、あえて単純で愚かな構成からスタートします。

そして、OpenClawのようなシステムに、自己学習アルゴリズムを発見し、異種多様な入力を取り込んで処理し、時間をかけてより良い解決策を見つけ出すよう依頼するのです。今回注目するのは、MITライセンスのAutoResearchClawです。Pythonが96.9%を占めていて、とても美しいですね。OpenClawとチャットして少し研究させれば、あっという間に完了します。

AutoResearchClawによる自律的な研究論文の生成

これは本当にクレイジーなGitHubリポジトリです。ノースカロライナ大学チャペルヒル校、UCバークレー、UCサンタクルーズの名前が見えますね。これはまさに、研究のトポロジーにOpenClawを応用したものです。

あなたがチャットでアイデアを伝えると、OpenClawが起動して論文を作成し始めます。これは自律的であり、複数のエージェントと協調的であり、そして最も重要な点として、自己進化型なのです。さあ、見てみましょう。AIMing Labです。ここにAutoResearchClawがあります。少し詳しく見てみましょう。つい16時間前に更新されたばかりです。本当にすごいです。

論文を手に入れたら、これを検索最適化のようなものとして使用します。前回の動画では、ドット空間における数学的な最適化問題をお見せしました。そこではファイルシステムがあり、最適化を古典的なAIの最適化である強化学習として定義しました。しかしここにあるのは、ちょっとクレイジーなシステム、OpenClawシステムです。ご覧のように、1つのコマンドと1つの論文で起動できます。ただ、AutoResearchClawをインストールしてセットアップし、初期化して実行するだけです。

そしてトピックを指定します。私の研究アイデアや、この論文のトピックはABCですと伝えると、完全な論文が返ってくるのです。アイデアはシンプルですよね。あなたが何かについて考えると、AutoResearchClawがそれを形にします。さらに、彼らはいくつかの反復プロセスを用意しています。人間のフィードバックループが組み込まれているので、必要に応じて重要な決定を導くことができます。Aの方向へ進めるか、Bの方向へ進めるかを指示できるのは素晴らしいことです。そして、約束通り完全な学術論文が手に入ります。

正直に言うと、これは本当の人間が書いた学術論文ではありません。でも、幸いなことにと言っていいのかわかりませんが、本当に興味深い内容になっています。すぐに会議に提出できる状態の論文が出来上がり、新しい参考文献のリストも、修正レポートも揃っています。本当に魅力的です。

自律型研究パイプラインの23のステージ

さて、このAutoResearchClawのシステム全体は、23のステージと8つのフェーズを経て自動研究を実行します。手短に説明しましょう。

まずフェーズAは研究のスコープ定義です。トピックの初期化と問題の分解を行います。次にフェーズB、完全な文献探索です。最初は検索戦略を立て、文献を収集し、スクリーニングを行い、知識を抽出します。そしてフェーズCで、知識の統合と仮説の生成を行います。

フェーズDは実験設計、AIによる内部コード生成、リソース計画など、計画作業に関連するすべてのステップです。フェーズEは実験の実行そのものです。ここで実験を行い、AIの自己修復手順とも呼ばれる反復的な改善を実施します。フェーズFは分析と決定です。マルチエージェントによる結果分析と最適化、方針の改善を行い、エージェント同士で議論させます。

そしてフェーズGで、いよいよAIによって論文が執筆されます。まずアウトラインを作成し、次に草稿を書き、レビューを行います。その後、別のサブエージェントが登場して証拠の確認を行います。「ちょっと待って、これを確認させてくれ」という具合ですね。そして論文の改訂が行われます。

最後のフェーズHは仕上げです。定義されたゲート構造である品質ゲートを通過させ、知識をアーカイブし、LaTeX形式でエクスポートし、出版の準備をします。さらに引用の検証も行います。AIが生成した論文の最大の弱点の一つは引用の正確性ですが、彼らはこれだけのために完全な検証レイヤーを用意しています。4月1日にインターネット上で公式に発表された論文で、著者名がとても奇妙な名前だったものをいくつか見かけましたが、これですべて納得がいきました。

学術論文の表記法に詳しい人なら、これらの論文がAIシステム、おそらくこのAutoResearchClawのようなシステムによって書かれたものだとすぐに気づくでしょう。ここにはスキルやスキルのマークダウンファイルに関するビデオもあります。もちろん、MITライセンスのスキルライブラリとも統合されています。

オープンソースやカスタムのスキルを読み込むこともサポートしていますし、もしかしたら親しい友人からスキルを借りてくることもできるかもしれませんね。初期状態で19の組み込みスキルも搭載されています。科学的な文章の書き方や文献検索といったシンプルなスキルから、化学や生物学のスキルまであります。

人間が人生の半分を費やして化学や生物学などの研究を活発に行う必要があるでしょうか。ただスキルのマークダウンファイルをダウンロードするだけでいいのです。これは本当に高度な柔軟性を提供する興味深い実験だと言えます。素晴らしいですね。もしあなたが、ローカルのコードで少し遊んでみて、自分のスキルをすべて定義できたと言うなら、自分のスキルを読み込むこともできます。それがあなたを専門家にしてくれるのです。スキルをインストールし、読み込めば、ただそれだけで機能します。クイックスタート、クローン、インストール、セットアップ、構成、実行、完了。これだけです。

AIによる自己学習とシステムアーキテクチャの進化

さて、この特定のAutoResearchClawを使用するために、先ほどお見せした23段階の自律型研究パイプラインがあります。ここで研究を行い、完全な探索を行い、新しいアイデアを思いつき、AIハーネス領域において完璧な記憶構造であるOmniMEMを発見するのです。これは、「生涯学習するAIエージェント」のための統合されたマルチモーダル記憶フレームワークであり、本当に興味深く、魅力的です。

AIのための古典的な強化学習プロセスとしての検索と最適化ではなく、数学や化学、科学のスキルが定義されたOpenClawやAutoResearchClawシステムのようなものへ移行することを想像してみてください。文献検索を行い、好きな検索エンジンにお金を払って、1日か2日、予算が許す限り実行させ続けるだけで、科学的な研究論文が返ってくるのです。これは本当に興味深いです。彼らのGitHubリポジトリにはいくつかの論文も公開されているので、論文の質についてもよくわかると思います。

ただ、一人の科学者として、これには少し不満に思う側面もあります。あらゆるクレイジーなAIシステムが突然、人間が使う学術サーバーに自ら論文を書いて公開し始めるようになったからです。私はこのアイデアをあまり支持していませんが、これが私たちの現在の生きる世界なのです。

彼らのアイデアはシンプルでした。天才的な人間のアイデアから始める必要はなく、ある種のベースラインから始めればよかったのです。そしてパイプラインは、2つのベンチマークにわたって50の実験を自律的に実行しました。このベンチマークについては後で一緒に見てみましょう。失敗のパターンを診断し、ハーネス構造へのアーキテクチャの変更を提案し、データパイプラインのバグを修正し、コードを書き直し、改善を検証します。しかも、内側のループにおいて人間の介入は一切ありません。

OpenClawはただの楽しい実験だと思っていたかもしれませんが、これをAutoResearchClawに組み込むと、研究論文を書き始めるのです。しかし最大の疑問は、研究論文を書くという冗談はさておき、それが本当に新しいアイデアを生み出せるのか、創造的なのか、人間の知識を本当に拡張できるのかということです。そしてこれこそが、私の興味のある部分なのです。

OmniMEMの画期的な3つの発見

ここで、著者らがこの新しい方法論で発見した最も重要な成果をお見せしましょう。心して聞いてください。これがトップ3の発見です。

1つ目は、選択的な取り込みです。軽量な知覚エンコーダが、ハーネスから入ってくる各信号の情報の新規性を測定します。これはマルチモーダルだということを思い出してください。そして、冗長なコンテンツを保存する前に破棄し、ストレージの要件を大幅に削減します。情報の多くは冗長な重複ですからね。

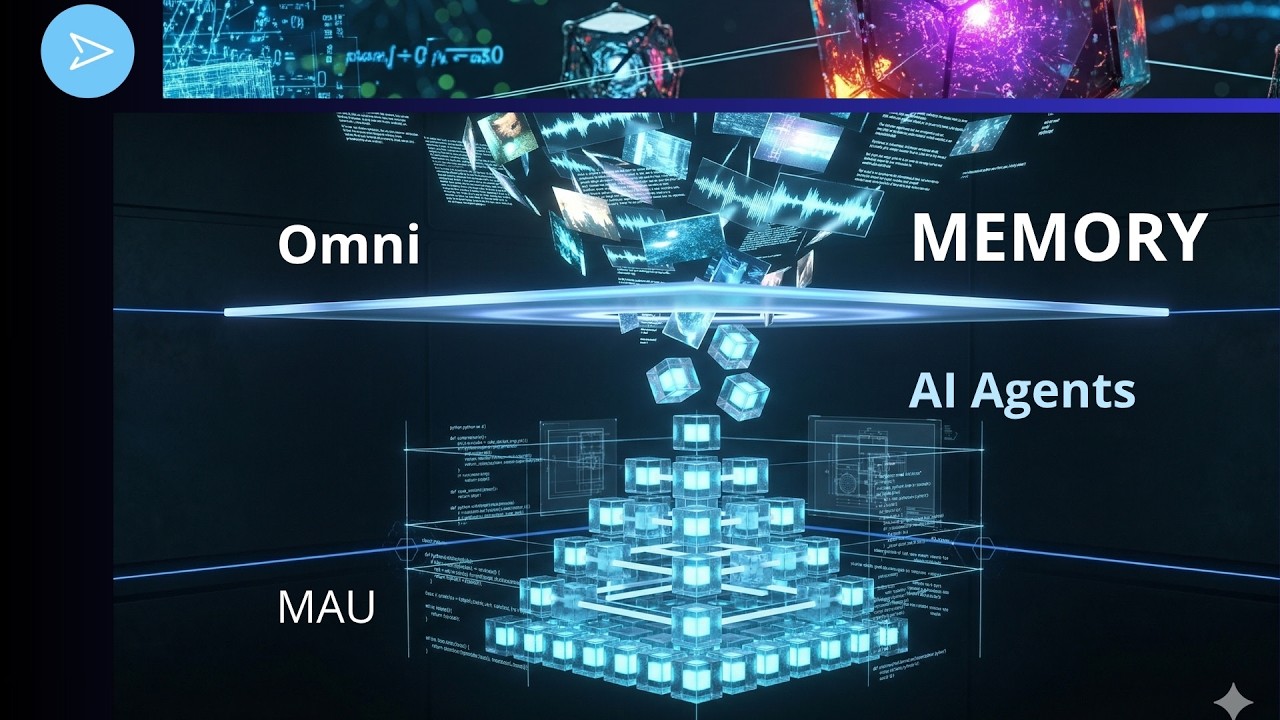

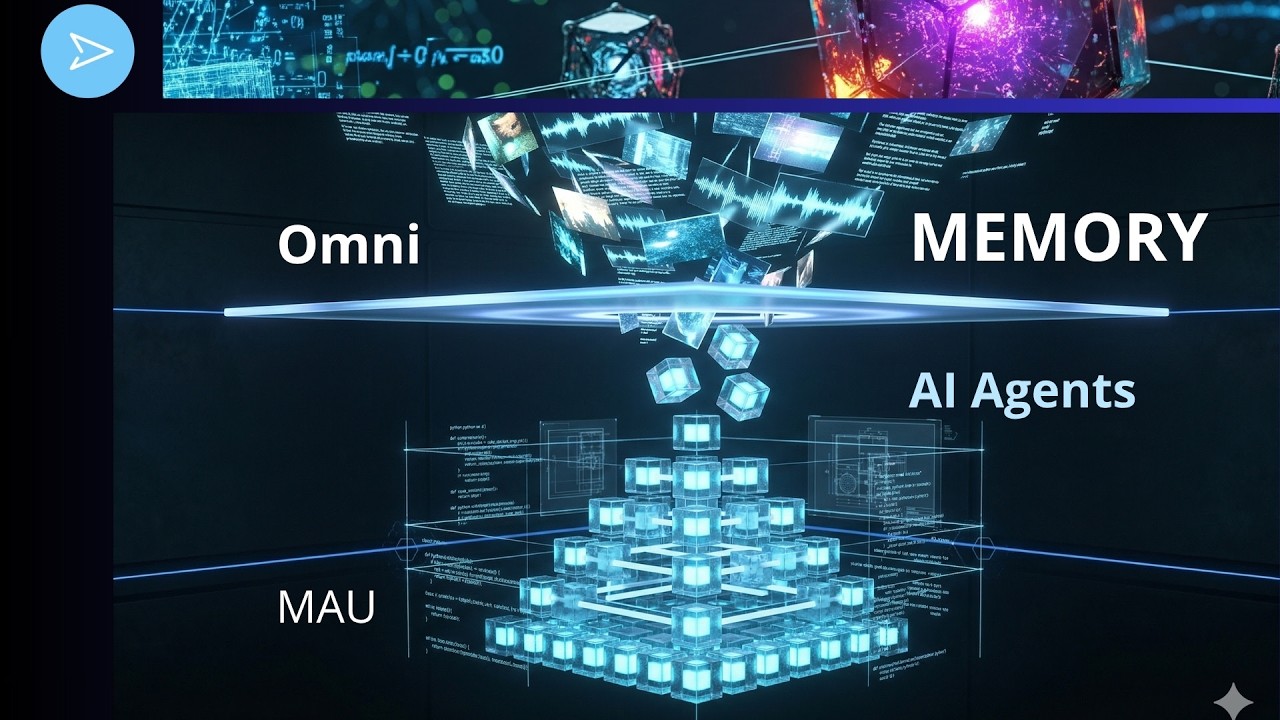

2つ目は、統合された表現です。これもマルチモーダルに関連しています。すべての記憶は、そのモダリティに関係なく特定の形式で表現されます。彼らは「MAUs (Multimodal Atomic Units:マルチモーダル・アトミック・ユニット)」と呼ばれるマルチモーダルな原子単位を採用しました。これは、軽量なメタデータを重い生データや純粋なデータから分離するものです。これにより、オンデマンドで完全なコンテンツへのアクセスを維持しながら、コンパクトなメタデータに対する高速な検索が可能になります。

これは一種のファイルシステムのようなものですが、私たちがスキルのマークダウンファイルなどで使っていたものとは少し異なります。コンテンツをマルチモーダル・アトミック・ユニットに分離するというのが、このシステムによる天才的な洞察なのです。「よし、ここにメタデータがある。メタデータのレベルだけで検索を行おう。そしてファイルにアクセスするための完全なコンテンツは保持しておき、必要なときにだけ呼び出そう」というわけです。これがブレイクスルーかどうかは皆さんの判断にお任せします。

そして、このAutoResearchClawがもたらした最後のブレイクスルーが、プログレッシブ検索です。おそらく何百万ものGitHubリポジトリで訓練された結果だと思いますが、システム自身が情報を3段階で展開するピラミッドメカニズムを発見しました。どういうことかというと、一番上の層に要約があり、中間の層に詳細があり、そして一番下の層に生のデータファイル、つまり生の証拠があるのです。

それぞれがトークン予算によって制限され、ハイブリッド検索戦略に裏打ちされています。この詳細は今は重要ではありません。重要なのは、私たちがよく知っていて大好きな密なベクトル検索と、疎なキーワードマッチングを組み合わせているということです。「すごい!」と思うか、「そんなの知ってるよ」と思うかは自由ですが、重要なのはこれが人間によって入力されたものではないということです。「こういう風にデータを保存しなさい」と人間が教えたわけではありません。システム自身がこの素晴らしい手法を見つけ出したのです。これがどれほど見事なものかは、皆さんが判断してください。

パイプラインによって自律的に発見された戦略。素晴らしいですね。著者らは、これによりマルチモーダルな記憶はAutoResearchにとって特に適した領域となり、他のシステム領域への将来の応用にも指針を与えると述べています。学術研究を目指すなら、世界はなんて美しい場所なのでしょうか。

知識グラフとMAU(マルチモーダル・アトミック・ユニット)の統合

MAUについてお話ししたように、これらは知識やデータのマルチモーダルな基本要素であり、重複を見つけるたびにコピーを破棄し、ファイルシステムに統合していきます。興味深いですね。

さて、このパイプラインは現在3つの入力を受け取っています。これは私にとって新しい学びでした。私はOpenClawについては知っていましたが、AutoResearchClawについてはよく知らなかったからです。パイプラインが受け取る3つの特定の入力のうち、最初のものが最も重要です。それは、すでに存在するシンプルな記憶のコードベースです。出発点となるのは、単一モダリティのテキストベースの生涯記憶フレームワークなのです。つまり、全くのゼロから始めるわけではなく、すでにこの記憶コードベースに統合された生涯記憶フレームワークを持っているということです。

次に、もちろんベンチマーク評価や、F1スコアや精度など、定義した定量的な指標を持つハーネスを与える必要があります。そして当然ですが、GPTモデルやGeminiモデル、あるいはClaude Opusなど、あなたが選んだ巨大なLLMプロバイダーへのAPIアクセスを提供しなければなりません。自動研究を行うなら、小さなモデルと本当に巨大なプロプライエタリモデルを見比べれば、そのパフォーマンスの違いは一目瞭然でしょう。

結局のところ、アイデアはシンプルです。AIモデルは自己学習しなければならないので、単にループを回すのです。各ステップで、パイプラインは以前の結果を分析し、改善のための仮説を生成します。AIシステムが特定の改善のための仮説を生成しなければならないと言うと、これが単なる30億や80億パラメータのLLMやVLMではないことがわかるでしょう。これは巨大なシステムなのです。

そして、コードに変更を実装します。だからこそ、私がClaude Opus 4.6に言及した理由がおわかりいただけると思います。コードで行われたすべてを特定のベンチマークで評価し、次にどうするかを決定します。「聞いてくれ、君には3つのチャンスがある。進むか、繰り返すか、方向転換するかだ」というわけです。

ある閾値を超えていれば、そのまま進みます(Proceed)。 仮説を洗練させる必要がある場合は、繰り返します(Iterate)。テスト結果が予想通りではなかったものの、惜しいところまで来ている場合です。パラメータ探索などを再定義する必要があるかもしれません。 あるいは、方向転換します(Pivot)。パフォーマンスデータが2回連続で低下した場合は、元に戻して全体的に新しい方向を試します。

私はAIを心から愛している人間ですから、こういう仕組みには本当にワクワクします。単一の推論や、複雑な推論を必要としない即問即答のサイクルであれば、これはうまく機能するかもしれません。しかし、マルチホップ推論(複数段階の推論)の場合はどうでしょうか?これを、永遠に続く記憶の最適化プロセスにどうやって統合するつもりなのでしょうか?

実は、著者はこのことについても考えていて、知識グラフを統合していたのです。絶対的に知的で、絶対的に美しいアプローチです。彼らは、単なるマークダウンファイルではなく、構造化された情報、少なくともすべてのMAU(マルチモーダル・アトミック・ユニット)間のエンティティと関係性を捉える知識グラフが必要であることを理解していました。

MAUの作成中にどうやってそれを行うのでしょうか?LLMは単にテキストやドキュメントのエンティティと、各要約からの有向な関係性を抽出するだけです。先ほど一番上が要約だという3層構造について話しましたね。そこからエンティティと関係性のトリプル(三つ組)を生成します。そして各エンティティには、7つのカテゴリからタイプラベルが付与されます。人、場所、イベント、概念、時間、組織、またはその他のオブジェクトのいずれかとしてあらかじめ定義されています。素晴らしいですね。

そしてここからが本当に知的な動きなのですが、私たちは特定のトポロジーを持つグラフニューラルネットワークの複雑さをこの構造にマッピングして扱う必要があります。そこで彼らは、クエリの実行時に、システムが私のクエリやAIへのジョブ記述で言及されたシードとなるエンティティを特定し、そこから3、4、5ホップ以内という制限付きの近傍探索を行うようにしました。

グラフ構造内で到達した各エンティティは、距離に応じて減衰する関連性スコアが付けられます。係数Dがあり、Dはシードエンティティまでの最短経路距離です。当然、4、5、10ステップと遠ざかるにつれて減衰係数が必要になります。そして、最もスコアの高いグラフエンティティにリンクされたMAUが、先ほどお見せしたハイブリッド検索結果と統合されるのです。

つまり、構造化された知識の情報がここに統合されているということです。これは美しく、前回の動画で特定のマークダウンファイルだけを扱っていた時よりもずっと進歩しています。知識グラフを統合するというのは本当に美しいです。もちろん、これが完璧な方法で構築されているかどうか、理論物理学のような複雑な分野に対応できるかどうかは別の議論になりますが、最もシンプルな形としては、LLMがエンティティを区別し、すべての関係性を導き出し、トリプルを構築できるというのは、機能する最初の実験として十分想像できます。

さて、私たちのマルチモーダル・アトミック・ユニット(MAU)は、数学的なタプルとして定義されています。 Sはテキストの要約です。「これは夕日の写真です」といったものです。 Eは数学的ベクトル空間における、その要約の密な埋め込みベクトルです。 そしてPは、JPEGやPNGなどの生データへのポインタ、またはファイルパスです。 Tはタイムスタンプです。いつ作成されたか、いつ分析されたかを示します。 Mはモダリティです。ビデオなのか、オーディオなのか、画像なのか、純粋なテキストファイルなのかを示します。 そしてLは構造的なリンクです。これはすべてが知識グラフの接続を通じて、他のマルチモーダル・アトミック・ユニットにリンクしていることを意味します。美しいですね。

これをどのように保存するのでしょうか?前回の動画では、推論LLMの周りにある点群(ポイントクラウド)をお見せしました。そこではすべてが点であり、マークダウンファイルやPythonファイルはありませんでした。今回は少し違います。著者はここで「MAUストア」と呼ぶものを採用することに決めました。なんだと思いますか?そう、JSON Linesファイルなのです。

予想通りですね。これがグラウンドトゥルースの台帳を保持します。要約、タイムスタンプ、モダリティ、ポインタといった軽量なテキストデータを保存するのです。なぜJSONなのでしょうか?それは、新しい記憶を時系列のログに追加していく上で非常に効率的だからです。ClaudeやAnthropicを一般的に扱うときに、スキルのマークダウンファイルに新しいファイルを追加するのと同じように、重いリレーショナルデータベースを立ち上げることなく、システムが簡単に読み取ることができるのです。素晴らしいですね。

もちろん、他のものもどこかに保存する必要があります。彼らは検索インデックスを採用し、ベクトルストアを使って3つのものを保存することにしました。高次元の埋め込みは、数十億規模の類似性検索のためにMetaが開発したライブラリに保存されます。コサイン類似度ですね。 次に、おなじみの古典的な手法、BM25です。テキストの要約は、完全なキーワードマッチングのために、疎なBM25インデックスにも保存されます。 そして、構造化された知識、つまりメモリ内の知識グラフ表現についても考慮する必要があります。エンティティとリンクはグラフ構造に保存され、システムはすべてのオブジェクト、人物、場所などの間の関係性を追跡できるようになります。

SimpleMem:3段階の記憶パイプライン

さて、システム全体を最初は3つの要素から開始し、そのうちの1つがすでに「シンプルな記憶」であったとお話ししたのを覚えていますか。これがシステムへの初期入力でした。私はこれが興味深いと思いました。複雑さは理解できましたが、正確にはそれは何なのでしょうか?メモリ最適化のために実行させるシステムに、著者らは何を組み込んだのでしょうか?

実は、出発点であるこの「シンプルな記憶」は全くシンプルではなく、それ自体が複雑な3段階のパイプラインであることがわかりました。よく見てみると、かなり複雑です。別の論文を見てみましょう。これは2026年の1月末に発表されたもので、先ほどの主要な研究の著者の一部が執筆したものです。

ここでは3つのフェーズがあります。 第1フェーズは、エントロピーベースのフィルタリング変換です。これは、生のダイアログをアトミックな事実に変換し、共参照とタイムスタンプを解決します。これだけでも、同じ著者らによるものだとすぐにわかりますね。チャンク化、時間的正規化、そしてノイズフィルタリングを行います。

第2ステップは、インデックス作成です。セマンティック(A)、レキシカル(B)、シンボリック(C)の各レイヤーにまたがるマルチビューインデックス作成により、正確なマルチグラニュラー(多粒度)の検索を可能にします。ここで気づくのは、密な埋め込みであるベクトル表現、BM25による疎なキーワード、そしてすべてのシンボリックなメタデータがあるということです。彼らはこのサイクルをオンライン意味合成と呼んでいます。

そして3つ目が、複雑さを意識したプルーニング(刈り込み)です。これは、マルチホップ推論や複雑な推論構造がある場合に、最適な効率を得るためにクエリの複雑さに合わせて検索の深さを動的に調整します。「クエリの複雑さに基づいて」と言うとき、これはハードコーディングされています。クエリの複雑さの見積もり、動的な深さの調整、いくつかのハイブリッドスコアリングがあります。

これは完全に新しい論文なので、ここで深く掘り下げることはしませんが、私が読んで本当に魅力的だったので、第3フェーズの秘密、つまり隠し味についてお話しできます。ちなみに、この論文のタイトルは「SimpleMem: LLMエージェントのための効率的な生涯記憶」です。ノースカロライナ大学チャペルヒル校、カリフォルニア大学バークレー校、カリフォルニア大学サンタクルーズ校の研究で、2026年1月29日に発表されました。興味深いですね。今日のメイン論文の前提条件として、3つか4つの論文が統合されていることがわかります。

もちろんSimpleMemもAIMing LabによるGitHubリポジトリがあり、ご覧の通り3ヶ月前の1月末に作成されています。素晴らしいです。Claude DesktopやLLM Studioなどによく統合できるPythonパッケージがあるのも面白いですね。

では、基本的にはどのようなものなのでしょうか。今お見せした3つのステップです。 意味的構造化圧縮:暗黙的な意味ゲーティングを利用して、冗長なインタラクションコンテンツをフィルタリングします。美しいですね。 オンライン意味合成:関連する記憶ユニットを即座に合成し、より高度な抽象的表現やノイズのない記憶トポロジーを作成します。 意図を考慮した検索プランニング:プランニングは常に複雑です。潜在的な検索意図を推論して検索範囲を動的に調整し、コアLLMの後続の推論のために、正確でトークン効率の良いコンテキストを再構築します。

そして、2026年1月の古い研究について、もう1つだけ知っておくべきことがあります。SimpleMemは、包括的な検索プランニングを生成するためにLLMの推論機能を活用しているのです。人間からのクエリQと、人間とのやり取りの履歴Hが与えられたとき、プランニングモジュールPは情報ニーズを分解する推論器として機能し、必要な検索の深さDを推定します。

ただ、個人的な感覚ですが、これは簡単な作業ではないと思います。理論物理学に特化したデータベースで、私の情報の検索に必要な深さを推定しろというタスクをAIに与えた場合、必要な検索の深さDを理解するには、その分野の深いドメイン知識を持っていなければなりません。

ここではシンプルに表現されています。クエリQと履歴Hがあり、QM、Qは先ほど言ったようにセマンティック、レキシカル、シンボリックな検索を象徴しています。Dは適応的な検索の深さを表し、クエリの推定される複雑さを反映しています。AIの推定能力をそこまで信用していないようにも見えますが、まあいいでしょう。

そしてこのDの推定に基づいて、AIシステムはコンテキストウィンドウの制約(たとえばGPT-4のコンテキストウィンドウなら128,000トークン)に対して、リコールの網羅性のバランスをとるために、候補の上限N(5、6、7ステップなど)を利用します。これは非常に繊細なバランスの上成り立っていることがわかります。SimpleMemの論文をぜひ見てみてください。彼らはこれを出発点として使っています。本当に美しいです。

OmniMEMのマルチビュー検索とコンテキスト構築

さて、今日のメインの研究に戻りましょう。2026年4月1日です。今日この動画で学んだことをすべてここに適用します。

SimpleMemのこれらすべてのプランニングと慣性的な位置づけに導かれ、システムは並列マルチビュー検索を実行します。新しい情報について、私たちが持っているすべてのインデックスレイヤーを同時にクエリするのです。ベクトル埋め込みのコサイン類似度を見れば、これがベクトル構造に関するものだとすぐにわかります。おなじみの古典的なBM25を見れば、これが語彙に関するキーワード検索最適化だとわかります。

そしてもちろん、ここで欠けているのは対称性ですね。つまり、構造がグラフ表現になっている構造化メタデータ制約に基づくエンティティ表現のことです。各ビューは異なる関連性シグナルを捉えます。もしよければ、これが主なアイデアだと言っていいでしょう。

マルチモーダルであるため、入力パイプラインは3層あります。 1つ目はセマンティックな入力パイプライン、2つ目は正確なキーワードによるレキシカルな入力パイプライン、そして3つ目は意味的複雑さのトポロジー的な複雑さを分析するパイプラインです。これらが、先ほどお見せしたNホップ問題に対する関連候補を提供する構造化メタデータ制約を持っています。

そして、これをコアとなる推論LLMのためのコンパクトなコンテキストとして提供するためにどうすると思いますか?私たちは集合の和集合演算を使用して、これらすべてのコンテキストを1つにまとめます。これが新しいコンテキストCです。このハイブリッドアプローチは、どのビューからの強力なシグナルも確実に保持され、推論された深さDに基づいてシステムが適応的に検索ボリュームNをスケーリングできるようにします。これは非常に繊細なバランスです。美しいですね。

つまり、データの世界にあるものをすべて入力として取り込み、コア推論LLMのプロンプトのための完璧でコンパクトなコンテキストを構築するのです。

ベンチマークテストを通じたパフォーマンス評価

前述したように、SimpleMemに続く2つ目の要素として、2つのベンチマークが必要でした。彼らは、メモリに依存する推論構造の相補的なタイプを網羅する2つのベンチマークを選びました。素晴らしいです。

これがその2つの研究です。ご存じかどうかわかりませんが、2024年2月のものはかなり有名ですね。「LLMエージェントの非常に長期的な会話記憶の評価」です。もう1つは比較的新しく、2026年1月初旬のものです。「Mgallery:マルチモーダル大規模言語エージェントのためのマルチモーダルな長期会話記憶のベンチマーク」です。この2つのベンチマークを使って何が起こるか見てみましょう。

実装に興味がある方のために言っておくと、彼らはBM25を使用し、Frozen CLIPとJSONモードのGPT-4oを使っています。素晴らしいですね。

結果を見てみましょう。システムが何を成し遂げたかです。上が最初のベンチマーク、下が2つ目のベンチマークです。X軸は反復回数、Y軸は成功率、つまりF1スコアで、高いほど良いことを示しています。

さて、AIシステムが自身のコードベースを自己最適化し始めます。各反復で何が起こったのか、どのような新しい利点があったのか、新しいコードはどうだったのか、どうやって自身を改善したのかを著者が注意深く観察しているのがわかります。

反復1回目を見てください。なんと175%の改善です。まあ、始めたばかりですからね。API呼び出しにレスポンスフォーマットを追加するという1行の修正でした。それでも「おぉ、175%の改善だ!」となるわけです(相対的な改善ですが)。 反復2回目では44%。BM25のハイブリッド検索アルゴリズムが最適化されました。 反復3回目で11%。タイムスタンプの最適化です。 反復5回目で7%。タイムスタンプの修正です。

そして、これを行っているAIシステムの知能が閾値に達する様子が見て取れます。ここを見てください。プラトー(停滞期)に達しています。興味深いことに、そのまま実行し続けると、システムは退化し、パフォーマンスを下げてしまいます。新しいアイデアが出なくなり、何を試しても自分自身のパフォーマンス指標を下げてしまうのです。だからここで中断し、「これが他のモデルと比較して私が達成したことです」となるわけです。

より新しいMgalleryベンチマークの方を見てみると、39回の実験が行われています。しかし、すぐにプラトーに達してしまっています。4回の反復、4回の実験でF1スコアが70%に達した後、なんというか…友好的な言い方が難しいですが、単に停滞してしまいました。その後少し上昇して80%近くまで行きましたが、そこでもまた停滞しています。

最初は良い改善を見せますが、なぜ停滞するのか、なぜAIシステムの知能がそれ以上自己開発、自己改善、自己修正できないのかについて議論する必要があります。なぜなら、より複雑な構造をどうやって改善すればいいのか、私たちもまだ答えを知らないからです。

数値結果を知りたい方のために、さまざまなバックボーンAIによる結果がここにあります。彼らは安価であるためGPT-4oを採用し、その他にOmni Mini、GPT-4.1 Nano、GPT-5.1、GPT-5 Nanoなどを使用しています。青い線で新しいOmniMEMシステムに下線を引きましたが、ほぼ常に古いシステムを上回っていることがわかります。まあ、驚くことではありませんね。

ただ、世代間の進化について少し触れておくと、GPT-5.1の最初のベンチマークは59%でした。GPT-4.1 Nanoは47%、巨大なGPT-4oは55%でした。つまり、GPT-4oが55%で、彼らが検証した最新のGPT-5.1が59%なのです。モデルの世代交代による飛躍としては、そこまで大きくありません。

巨額の新規株式公開(IPO)を控え、何兆ドルもの評価額を目指す世界的なAI企業が、「まだまだ最適化の余地はあるが、あえて新しいモデルであるGPT-6は出さず、GPT-5の周りのエージェントハーネスを最適化してシステム全体を少しだけ賢くしよう」と考える理由がおわかりいただけるでしょう。そういうものとして受け止めましょう。

最適化の限界とAIモデル進化の今後の課題

さて、今日の3つの論文のまとめです。メインの論文から引用すると、著者はこのように述べています。「私たちは本論文において、新しいアイデアであるOmniMEMを提示した。これは統合されたマルチモーダル記憶フレームワークであり、そのアーキテクチャと構成は、自律型研究パイプラインであるOpenClaw(またはAutoResearchClaw)アーキテクチャを通じて発見されたものである。」

非常にシンプルなベースからスタートし、パイプラインは約72時間の実行時間で50回の実験を自律的に実行しました。そして動画の冒頭でお見せしたように、3つの主要なブレイクスルーを達成し、両方のベンチマークで最高水準(SOTA)、あるいはSOTAに迫るかそれを超える結果を出しました。

しかし深く掘り下げてみると、私たちが先ほど確認したように、最もインパクトの大きかった発見は単なるバグ修正、つまりシンプルなコード最適化による175%の改善でした。本当に興味深いのはアーキテクチャの変更であるはずですが、それはごく初期の段階で44%貢献したに過ぎません。

そして古典的なプロンプトエンジニアリングが登場します。「DSPy 3.4が達成できなかったことは何なのか?」と疑問に思うでしょう。プロンプトエンジニアリングは、どのみち私たちが古典的に行う最適化です。コード圧縮とコンポーネント間の推論を必要とするABCを含んでいます。ここでまたコンポーネント間の推論という言葉が出てきましたね。これはほとんどAGI(汎用人工知能)に近い響きがあります。

しかし私は、今回見られたものはやはり大半がコードの最適化に過ぎないと考えています。プロンプトエンジニアリングやコンテキストエンジニアリングもそうです。彼らが使用した方法論はすべて、すでに私たちに知られているものばかりです。それらの方法論を組み合わせる順序が新しかったのかもしれませんが、全く新しい革新的なものは見当たりません。とはいえ、それが自律的に行われたという点は特筆すべきであり、それらについてモデルが訓練され、一部のモデルはそれを実行できたということです。

深く掘り下げてみると、これは本当に美しい研究です。彼らはすべての情報を提供してくれているので、興味があれば自分自身で深く検証することができる、真に科学的な研究と言えます。

改善のステップについても触れましたね。システムがどこで最大の改善ステップを踏んだのか。反復プロセスを見ていくと、最初のベンチマークであるLoCoMoでは、コードから一部のパラメータが欠落していたJSONのレスポンスフォーマットの問題でした。これは単純なバグ修正であり、コードの修正による改善が175%です。すごいですね。次にBM25ハイブリッドにおけるキーワードの最適化で+44%。そしてアンチハルシネーションのプロンプティングという、単なるプロンプトエンジニアリングで11%の改善。

しかし、そこからパフォーマンスはどんどん下がっていきます。フォーマットのアラインメントで5%の改善。そして、単なるハーネスだけでなく、システム自体のハイパーパラメータをいじり始めると、改善は本当に限定的なものになってしまうことがわかります。Top-Kなどのハイパーパラメータで遊ぶようになっても、大した改善はありません。

さらにシステムを実行し続けると、これは危険な兆候ですが、生産的でないアイデアばかり生み出すようになります。そのため、強制的にコーディングを停止し、得られた結果を受け入れるしかないのです。これは私に、これがまだ完璧な解決策ではないことを教えてくれます。単純なバグ修正はありましたが、ここにはまだ新しいトポロジーも、全く新しい方法論の発明もありません。これほど巨大で複雑なAI構造に私が期待するのは、「新しいアイデアはどこにある?新しい方法論はどこにある?」ということです。それらが欠けているのです。コードの最適化は素晴らしいですが、それだけでは物足りません。

結局、過去3回の動画で指摘した古い問題に戻ってしまいます。AIのハーネス領域は素晴らしいです。しかし、私たちのモデル自体はまだ十分に賢くありません。コアとなるLLMの知能が足りないのです。

素晴らしいIPOを実現し、大成功を収めて何十億ドルもの現金を手に入れたいと考えるAI企業が、新しいモデルを出すのを恐れ、ハーネス構造自体の最適化にとどめておきたい気持ちはわかります。IPOの直前にネガティブなニュースを出したくありませんからね。しかし、これではAIの開発は前に進みません。

だからこそ、Anthropicには期待したいのです。OpenAIが非常に慎重で少しずつしか進まないのは理解しますが、Anthropicよ、どうか新しいモデルを出してください。それは絶対に魅力的なことです。新しいモデルが出れば、ハーネス領域でまだうまく機能していないものは何なのか、そしてシステム全体をどうやってさらに最適化できるのかを学ぶことができるからです。

皆さん、少しでも楽しんでいただき、新しい情報をお届けできたなら幸いです。次回の動画にも興味を持っていただけるかもしれませんね。今回はトレーニング時間の最適化についてでしたが、明日はこの分野のテスト時間コンピュートの最適化に関する全く新しい論文を見てみる予定です。

私たちがまさに正しい軌道に乗っていることがわかりますね。これこそが、現在すべての巨大な大学が人工知能システムをさらに最適化する方法を探求している、熱い研究の方向性なのです。次回の動画でお会いできるのを楽しみにしています。

コメント