スタートアップ企業Talasが開発した新型チップ「HC1」は、Llama 3.1(8Bパラメータモデル)をチップ上に直接組み込むことで、毎秒最大17,000トークンという前例のない推論速度を実現している。NvidiaやGroq、Cerebrasといった既存の推論チップと比較しても群を抜く速度を誇り、サブミリ秒レベルのレイテンシはAIエージェント間通信の新たな可能性を切り開くものとして注目されている。同社はわずか24名のチームで、調達資金2億ドルのうち3,000万ドルのみを使用してこの成果を達成しており、今後の展開にも大きな期待が寄せられている。

毎秒17,000トークンを実現した新型チップ

毎秒17,000トークン。これが、Talasというスタートアップが開発した新しいチップの実力です。

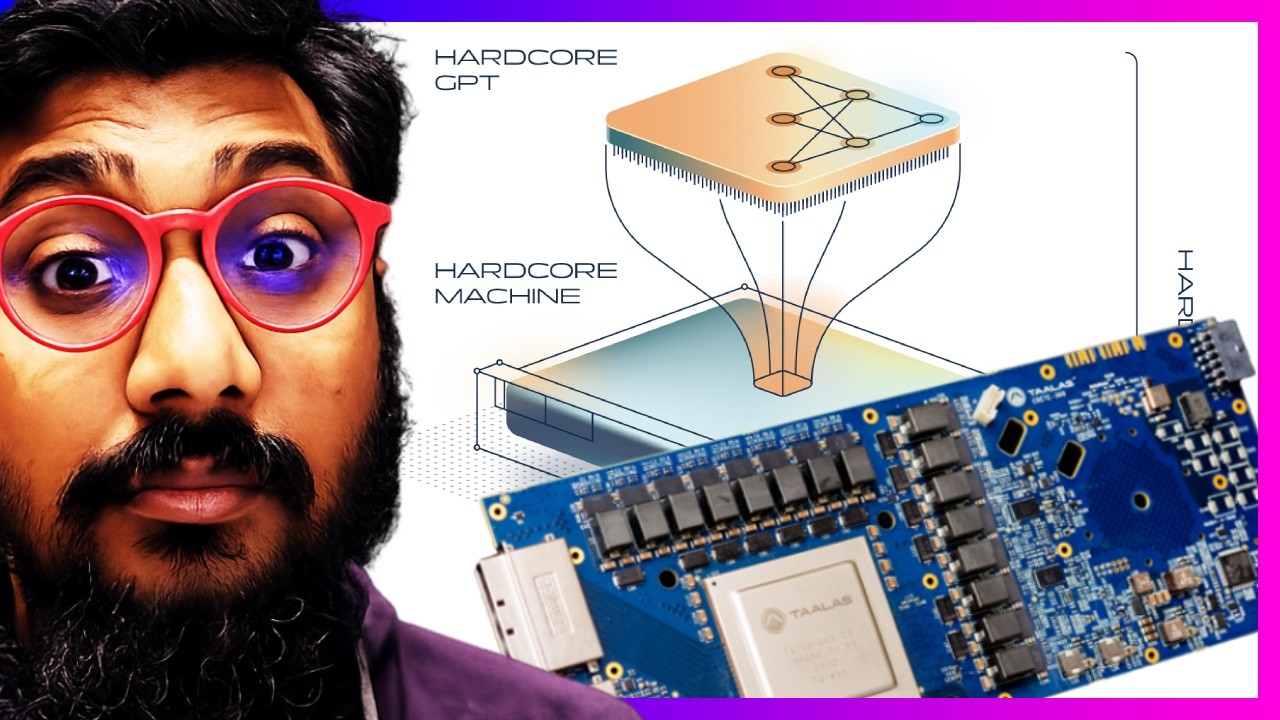

この会社は、大規模言語モデル——具体的にはLlama 3.1の8Bパラメータモデル——をチップ上に直接組み込むことに成功し、これまで誰も見たことのない毎秒17,000トークンという驚異的な速度を実現しました。

もともとAI分野では、NvidiaやAMDといった企業がCPUやGPU(グラフィカル・プロセッシング・ユニット)を開発し、大規模言語モデルや機械学習モデル、ディープラーニングモデルを動かすための基盤を提供してきました。そして最近になって、LLMの推論速度を特化して向上させるカスタムチップを手がける企業が登場し始めました。Groqがその代表的な例であり、Cerebrasもそのひとつです。こうした企業のおかげで、より高いスループット、つまりより多くのトークンをより低コストで高速に生成できるようになってきました。

そしていま、まったく新しいスタートアップとしてTalasが登場し、毎秒最大17,000トークンを生成できるチップを作り上げたのです。

ライブデモで確認する驚異の速度

しかも、これは単なる論文上の話でも、ただの約束でもありません。今すぐ自分で試せるライブデモが公開されています。実際に見てみましょう。

デモサイトにアクセスして、生成量が多くなるようなプロンプトを入力します。何か長めのものを……そのまま送信してみると、送った瞬間にはもう完了しています。おそらく1ミリ秒にも満たない時間で、毎秒15,000トークンという速度で生成されました。

最大では毎秒16,000〜17,000トークンに達しますが、今回は15,000トークン毎秒での生成でした。出力された内容はでたらめではなく、大規模言語モデルらしい一貫性のあるテキストで、完全な長文のブログ記事が生成されています。

Talasとはどんな会社か

では、会社自体についても見ていきましょう。

Talasが公開したブログ記事によると、同社の創業者はTentorの元創業者兼CEO・CTOであり、AMDでディレクターとして経験を積んだ非常に技術的なバックグラウンドを持つ人物です。半導体という非常にニッチな業界の第一線にいた人物が立ち上げた会社だけに、彼らが作り上げたものには大きな期待が持てます。

チップの使い方は2通りあります。チャットボットとして利用するか、APIリクエストフォームに記入してAPIアクセスを取得するかです。今回はLlama 3.1がチップ上に直接組み込まれており、ソフトウェアではなくハードウェアとしてモデルが搭載されています。この最初のチップは「HC1」と呼ばれており、Nvidia H200、Nvidia B200、Groq、SambaNova、Cerebrasと比較しても、Talas HC1はピーク時に毎秒約17,000トークンという、おそらく最速の数値を叩き出しています。

なぜLlama 3.1を選んだのか

なぜLlama 3.1なのかという理由も明示されています。まず、このモデルはオープンソースであること。そして、小型モデルとオープンソースモデルのあいだでちょうどよいサイズ感であること。さらに、コンテキストウィンドウのサイズを設定できたり、カスタムLoRAを使ってファインチューニングができたりと、柔軟な活用が可能な点も挙げられています。

また、他社が量子化の詳細を隠している中、Talasは非常に明確に開示しています。彼らの最初のシリコンプラットフォームは3ビットを基本データ型として使用しており、これを「シリコンLlama」と呼んでいます。つまり積極的な量子化が施されており、3ビットと6ビットのパラメータの組み合わせで動作しています。GPUによるパラメータと比較するとクオリティ面での劣化はあります——たとえば毎秒16,000トークンと230トークンのモデルの間には品質の差が存在します。ただし、第2世代のシリコンチップではllama.cppやLM Studioで一般的な標準的な4ビット量子化に対応することを約束しています。

今後のロードマップとAIエージェントへの応用

同社の大きなアピールポイントのひとつが、新しいモデルの追加に時間がかからないということです。次に搭載される予定のモデルは、思考能力を持つ中規模の推論モデルで、今春——つまりあと数ヶ月以内に提供される予定だとしています。

また、現在公開されているモデルは最先端ではないと明言したうえで、それでもベータサービスとして公開した理由は、LLM推論がサブミリ秒で動作したときに何が可能になるかを示したかったからだと説明しています。確かに、人間がこの速度でシステムとやり取りすることはありませんが、AIエージェント同士がこの速度でコミュニケーションを取り合うことは十分可能です。ツール呼び出しや関数呼び出しに対応したモデルがあれば、特にOpen Claudeなどのオートメーションが広がる時代において、この速度を持つチップの上に巨大なシステムを構築することができ、その可能性は非常に刺激的です。

チームの規模を見ても、わずか24名という小さなチームで、調達した2億ドルのうちまだ3,000万ドルしか使っていません。つまり、まだまだ余力があるということです。十分な人材と資金を持って、さらなるモデルを搭載していける体制が整っています。

実際にコード生成も試してみる

プラットフォームに戻って、もうひとつ試してみましょう。実際に動くコードが生成できるかどうかを確認してみます。チャットをリセットして新しいチャットを始め、コード生成を依頼してみると……コードが返ってきました。コピーして貼り付けてみると、まあまあのコードが生成されています。今の時代の最先端モデルと比べれば見劣りするのは確かですが、大規模言語モデルをチップに組み込んで、会話ができて、コードが生成できて、毎秒17,000トークンを叩き出せるというのは、それ自体が完全に常識外れの話です。

ぜひあなたの感想を聞かせてください。chatjimmy.aiにアクセスすれば、このモデルと今すぐ会話できます。これだけの高スループットと低レイテンシで、どんなユースケースが実現できると思いますか?ぜひ教えてください。それではまた次の動画で。

コメント