NVIDIAが2025年12月30日に発表した最新の研究論文「MASTERS」は、72億パラメータのビジョン言語モデルを2~3億パラメータの小型モデルに効率的に蒸留する革新的な手法である。従来の蒸留手法では教師モデルの複雑な表現を小型の生徒モデルが学習する際に表現の崩壊が発生し、性能が大幅に低下していた。MASTERSはマスキング手法とオフライン強化学習を組み合わせ、教師モデルの重みを段階的にマスク解除するカリキュラム学習と、正確性と転移可能性の両方を評価するデュアル報酬構造を採用することで、この問題を解決した。その結果、従来手法では64%程度だった性能を80%まで向上させることに成功し、iPhoneなどのエッジデバイスで動作可能な高性能ビジョンAIモデルの実現に大きく近づいた。

NVIDIAの新研究「MASTERS」とは

コミュニティの皆さん、こんにちは。お戻りいただきありがとうございます。はい、NVIDIAから新しい研究が発表されました。早速見ていきましょう。私のチャンネル「Discovery」へようこそ。最新の論文を見ていきます。

72億パラメータのビジョン言語モデルを小型の3億パラメータのエッジモデルに蒸留しようとすると、従来の標準的な蒸留手法はすべて失敗してしまいます。特にビジョン言語モデルの場合はなおさらです。

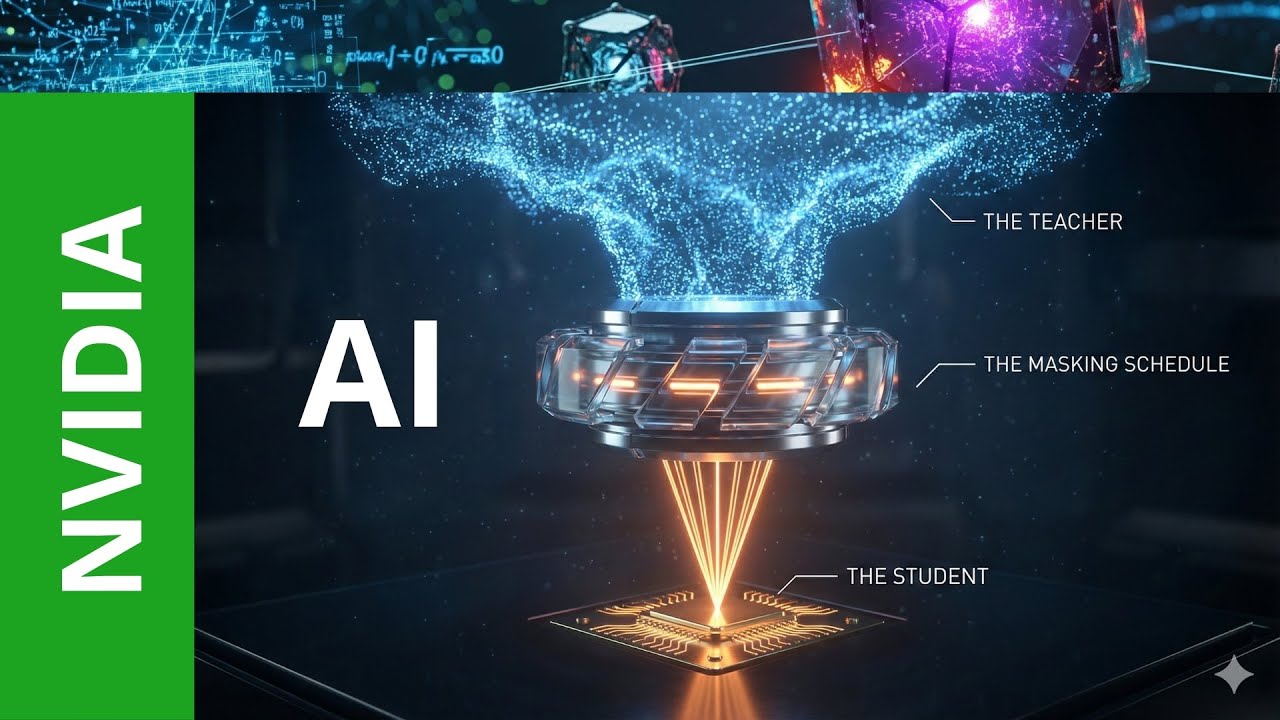

私たちが求めているアイデアはシンプルです。高度な教師AIの頭脳があって、そこからすべての新しい洞察、すべての複雑性、すべての推論を小さな生徒モデルに抽出したいのです。生徒は抽出された洞察だけを受け取り、学習プロセスには十分な大きさである必要はありません。なぜ失敗するのかと疑問に思うかもしれません。

教師の表現は高次元の多様体に存在しており、限られたパラメータと隠れ次元によって制約された生徒のビジョン言語モデルは、単純にそれをマッピングできません。生徒は「表現の崩壊」と呼ばれる問題に苦しみ、教師のロジックのノイズの多い平均的な近似しか学習できず、より大きなモデルサイズが持つ明確な精度が失われてしまいます。

MASTERS:マスキングと強化学習を組み合わせた新手法

NVIDIAは2025年12月30日に最新の研究を発表しました。「ビジョン言語モデル蒸留のための教師のマスキングと生徒の強化」というタイトルです。彼らが行っているのは、MASTERSと呼ばれる新しいフレームワークの提案です。これは「Masking Teacher And Reinforcing Student」の略で、2つの結合された動的プロセスを通じて蒸留プロセスを再構築します。

まず、カリキュラムプルーニングがあり、次にオフライン強化学習があります。両方の手法については皆さんもよくご存知でしょう。ここでは既に知っている手法の組み合わせに過ぎません。NVIDIAが私たちに伝えているのは、小型AIモデル、小型ビジョンAIモデルの能力を現在十分に活用できていないということです。単純に蒸留技術が非効率だからです。それだけのことです。

驚異的な性能向上の結果

そして、ここに結果があります。この論文を読むべきかどうか迷っているなら、これを見てください。ここではX軸にモデルサイズ、Y軸に平均性能の向上を示しています。

点線を見ると、72億パラメータのモデルを従来の方法で7億に縮小したり、3億や2億のモデルに模倣学習を行ったりすると、性能が低下していくのがわかります。グラフの下部に位置しています。しかし、この新しい手法を使用すると、実線で示されているように、この巨大な知識をほぼ同じ平均性能レベルに保ちながら、2億、3億、または4億のモデルサイズで動作させることができるのです。

これは間違いなく改善ですが、注意していただきたいのは、64パーセントポイントから、例えば青い線では76パーセントポイントまで上がっているということです。ジャンプは確かにあります。100%まで本当に到達するわけではありませんが、性能を向上させる次のステップではあります。

MASTERSの仕組み:段階的な知識伝達

アイデアはシンプルです。はっきり言っておきますが、誰でもこれを実行できます。MASTERSは学習プロセスの開始時に、支配的でない重みテンソルをマスクアウトすることで、教師の知能を人為的に弱めます。つまり、教師は少し愚かになるわけではなく、少しシンプルになるのです。

そして、トピックについて何も知らない生徒がトレーニングを開始すると、教師は徐々にどんどん知的になり、どんどんマスクが解除され、段階的に表現の複雑さが増していきます。これは標準的なカリキュラム学習ですが、非常に興味深い方法で実施されています。

同時に、NVIDIAが教えてくれるのは、このフレームワークが従来の強化学習であるGRPOを使用しているということです。新しい道を探索するためではなく、しっかりと聞いてください、教師によって事前生成された応答に対する事後的な選択を実行するためです。正確で転移可能な応答に報酬を与えるのです。ここでは、おそらく2つの異なる損失関数をインテリジェントな方法で組み合わせる必要があります。

計算時間の大幅な短縮

MASTERSは、教師の能力を動的に変更すること、つまりゆっくり始めてどんどん知的になることが、トレーニングデータそのものと同じくらい重要であることを証明しています。事前生成されたサンプルに対する従来のGRPOを使ったオフライン強化学習が、計算時間のほんの一部で最先端の結果をもたらすことを実証しています。

NVIDIA GPUをお持ちなら、同じ結果を得るのに30日以上かかるのではなく、わずか2日で済むというのは素晴らしいことです。MASTERSにより、3億から8億のモデルが、特定のベンチマークにおいて、重みテンソルにアクセスできる72億のような大規模なオープンソースモデルを大幅に上回ることができるのです。

この画像を見ると、Qwen 2.5 VL Maxのような巨大なビジョン言語モデルの膨大な知能があり、それを蒸留したいのです。その論理をNVIDIAの小さな生徒チップに集中させて刻印したいのです。

フレームワークの詳細:二重の目的関数

フレームワークは比較的シンプルです。統一された目的関数で動作し、モデルがどんどん知的になっていくマスク進行型蒸留損失と、デュアル報酬オフライン強化損失を組み合わせています。これから楽しくなりますよ。

教師のマスキングプロセスとは何でしょうか。このマスキングプロセスは大きさベースです。説明しましょう。教師の能力を調整するため、重みWTを持つTと呼びましょう、テンソルの大きさに基づいてプルーニングされます。

バイナリマスクが、望ましいスパース比から導出された特定の閾値を使用して生成されます。注意してください、このマスキングは特定のレイヤーが完全に崩壊するのを防ぐために、レイヤーごとに行われます。教師の完全な知能を持ちたいのです。学習プロセスが本当にすべてのステップを含むべきなので、すべてのレイヤーが存在することを望みますが、複雑さの問題でモデルが崩壊することは望みません。

マグニチュードプルーニングの役割

したがって、マグニチュードプルーニングは、ここでの仕様のブルートフォースヒューリスティックのようです。これは、ゼロに近い値を持つパラメータが意味的に不活性であるという仮定で動作します。小さな重みを取り除くことで、教師のロジックに対して時間ステップとともに徐々にローパスフィルタを効果的に適用します。

生徒に最初は大きな重みテンソルではなく、大まかな輪郭だけを学習させるのです。マグニチュードプルーニングがかなり鈍い手段であるという事実は、実際にはここでは特徴なのです。これは残酷な正則化として機能し、学習プロセスの早い段階で教師の細かいニュアンスに生徒が執着するのを防ぎます。

ニュアンスは後で学びましょう。まず基本的な事実を学びましょう。もちろん、すべてはL1ノルムの仮定に依存しています。重みのスカラーが大きい場合、信号が次のレイヤーに強く伝播し、小さい場合は信号を減衰させます。したがって、小さな重みを取り除くことで、出力活性化の変化を最小限に抑えます。

カリキュラム学習による段階的な複雑化

このマスキング比率は静的ではないと言いました。カリキュラム学習として知られているカリキュラムに従います。イテレーションIにおいて、比率R(I)は線形に減衰し、徐々に教師の完全な能力、つまり教師AIマシンのロジックと因果推論における意味的な豊かさを復元していきます。

これにより、AI生徒マシンとしての生徒が、細かく定義された高次元の依存関係、つまり細かいディテールに取り組む前に、まず粗い特徴と整合することが保証されます。ここにあります。マスキング比率20%から始まり、15%、10%、5%と進み、最後には素晴らしい状態になります。

各マスキング段階で教師E(I)に対して、生徒は2つの特定の報酬関数を使用して更新されます。正確性報酬と蒸留報酬があります。この進行型蒸留により、生徒への滑らかで安定した知識伝達が可能になります。これらを組み合わせると、性能でさらに10パーセントポイントジャンプできます。

デュアル報酬構造を持つオフライン強化学習

デュアル報酬構造を持つオフライン強化学習について、すぐに疑問が湧くでしょう。クロスエントロピーではなくGRPOを使用するということはわかっていますが、これが今解決しなければならない最適化目的です。

Kullback-Leibler ダイバージェンスではなく、古典的なJensen-Shannonダイバージェンスを使っていることに気づくでしょう。このプロセスではこちらの方がはるかに安定しているからです。私が何を話しているのかわからない場合は、簡単に説明したビデオがありますので、この数学的表記が何を意味するのかすぐに理解できます。

このデュアル報酬関数について少し詳しく見てみましょう。GRPOのアドバンテージは、合計報酬で計算されます。いくつかの加算項があるだけです。正確性報酬は簡単で、申し訳ありませんがLLMが審査員として評価します。幻覚を起こすLLMの判断に完全に依存しているわけで、これには満足していません。意味的な正確性を確保するために、ゼロまたは1のバイナリ結果を得ます。

しかし、さらに蒸留報酬があります。これが新しい部分です。これは、あるAIマシンから別のAIマシンへの知識の転移可能性の容易さを測定します。特定の応答に対する教師と生徒のロジック間の乖離が小さい場合、報酬は高くなります。これを安定させるために、リバース平均最大正規化を使用していますが、すぐにお見せします。素晴らしいですね。

マスキング比率の段階的変化

でも見てみましょう。マスキング比率はここで始まります、または特定の3.5 14Bでは40%、35%から始めます。段階関数が下がっていくのがわかります。最適化する必要があります。38Bの場合は、この緑の段階関数があります。

マスキング比率のステップワイズキーは、滑らかではなく階段関数であるということです。これはシンプルで、NVIDIAにとって高速です。これにより、次のより難しいレベルに進む前に、AIとしての生徒が特定の複雑さレベルで安定化できます。学習の飽和、完璧な学習、次のステップという流れです。

性能トレンドを見て、これらを組み合わせると、段階的学習があり、緑色で示されているマスターズ手法で大きな教師のみを使用した場合、すぐに飽和してほぼプラトーに達し、平均性能で77パーセントポイント程度になります。しかし、中規模と大規模の教師を持つマスターズを使用すると、段階的に進みます。古典的なカリキュラムAIトレーニングがあります。80%まで上がるのがわかります。

わずかでも重要な性能向上

これは大したことではないと思うかもしれません、77%から80%ですが、私たちはここで1桁ごとに戦っているのです。はい、間違いなく改善です。そして、強化学習の有無による蒸留の最終的な結果を見ると、素朴な手法とマスク進行型で強化学習なしの青い線が77%、複数の損失関数を持つ強化学習のこの新しい手法では80%まで達成できます。

絶対値では3パーセントポイントにしか見えませんが、私たちを助けてくれるものは何でも求めているのです。生徒は最初から72億の訓練可能なパラメータを持つAIモデルの完全な確率分布を模倣することを強制されません。これは素晴らしいことです。複雑さが増していく簡略化された分布を学習することから始まり、これにより生徒はより良い知識伝達機能を持つことができます。

オフライン強化学習の限界と可能性

しかし、もちろんオフライン強化学習は高速である一方で、探索を制限します。生徒は教師が事前生成しなかった通常の状況のパスを発見できません。非常に小さな生徒AIしかないためです。ここでは推論のトレースを模倣するだけです。絶対的に新しい新規の解決策のパスを発見することはできません。

これは大きな制限です。72億のビジョン言語モデルを教師として学習した知能の中にないものは、3億のモデルの中には見つけられないのです。知能の創発があって突然システムが知的になるなどと言わないでください。そんなことは起こりません。

したがって、NVIDIAはすでにハイブリッドアプローチを考えています。オフラインウォームアップとオンラインファインチューニングを組み合わせることで、この表現を持ったら後で性能をさらに押し上げることができます。

具体例:精度と蒸留の両立

非常にシンプルな例です。入力に質問があります。「画像の中で犬が座っている乗り物の種類は何ですか」そして、マスクされた教師と複数の応答があります。2つは意味的に正確ですが、マスクされた教師も幻覚を起こしています。これは航空機ではありません。オートバイです。この幻覚をフィルタリングする必要があります。

そして、さらに蒸留があります。正確性報酬が各応答のバイナリ正確性を評価する一方で、蒸留報酬は教師と生徒のロジット間の発散目的に基づいて知識伝達の容易さを測定します。素晴らしい。

論文の総評と推薦

なんと美しい研究でしょう。2025年の最後の日の1つに、NVIDIAが言うのです。「知的なビジョン言語モデルを小さくしなければならない。この巨大なモデルから知識と洞察と素晴らしさと推論のトレースを、2億、3億のパラメータの本当に小さなローカルビジョン言語モデルにどうやって蒸留できるか。もしかしたらiPhoneに載せられるかもしれない」と。どの市場セグメントについて話しているのかすぐに理解できますね。素晴らしい。

この論文を推薦するかって?絶対に推薦します。小型言語モデルシステムやマルチモーダルビジョン言語モデルシステムを最適化しようとしている人にとって、洞察に満ちたプレプリントです。素晴らしい。シンプルなアイデア、素晴らしいアイデアです。高度に知的なモデル、巨大なビジョン言語モデルの主要な推論トレースを、エッジデバイス用のわずか2億、3億のビジョン言語モデルに圧縮または抽出するための、堅牢でスケーラブルなレシピを提供しています。

強くお勧めします。気に入りました。楽しんでいただけたら幸いです。チャンネル登録してメンバーになりませんか?とにかく、次の動画でお会いしましょう。

コメント