この動画では、Claude Codeの高額な料金問題に対する解決策として、ZhipuAIのGLM-4.5モデルを使った大幅なコスト削減手法を検証している。実際にZhipuAIのGLMコーディングプランを試用し、Claude Codeとの直接統合による85%のコスト削減効果を検証した結果、UIデザインや基本的なコーディングタスクでは十分な性能を示すものの、複雑なタスクや依存関係の更新などではGPT-5に劣ることが判明した。最終的に、安価で基本的なタスクには GLM-4.5、高度な処理にはGPT-5という二極化した選択が最適であり、中間的な選択肢は市場に実在しないという「谷問題」の概念を提示している。

- Claude Codeの高額料金問題とZhipuAIソリューションの登場

- 実際の検証とスポンサー紹介

- ZhipuAI GLMコーディングプランの設定と初期テスト

- パフォーマンス比較とベンチマーク結果の検証

- 継続的なテストとモデル比較の課題

- 大規模コードベースでのテスト懸念と認証の確認

- 設定の修正とコスト計算の問題

- GPT-5との比較テストと環境設定の修正

- SnitchBenchを使った複雑なタスクのテスト

- より困難なタスクへの挑戦と限界の検証

- 複雑なアップグレードタスクでのテスト

- 最終的な評価とGPT-5との比較

- 最終的な検証結果と結論

- GPT-5の優位性と市場分析

- 代替ツールでの検証と最終評価

- 市場の二極化理論と「谷問題」の提唱

- コスト効率性の分析と持続可能性への見解

Claude Codeの高額料金問題とZhipuAIソリューションの登場

みなさんがClaude Codeを本当に気に入っているのは明らかですが、コメント欄から学んだことがあるとすれば、みなさんは新しい料金設定、特にCursorから乗り換えた後の値上げを嫌っているということです。多くの方がCursorが高くなったから乗り換えたのに、またClaudeで裏切られた形になってしまいました。

もし請求書の85%を節約する方法があると言ったらどうでしょう?Claude Codeのリーダーボードにいるような、一日2000ドル以上も使っているバイブセットアップの人たちなら、きっと飛びつきたくなるでしょう。そして、これは新しいCLIを使わなければならないとか、クレイジーな詐欺や、Googleが大量のコンピュートに資金提供しているような話ではありません。

これは実際のラボがClaude Codeと統合して、はるかに安い料金で本当に良いモデルを提供しているのです。そして、これは私がずっと話したいと思っていたラボでもあります。ZhipuAIがClaude Code向けのGLMコーディングプランをリリースしたのです。独自のCLIを作ったり既存のものをフォークした他のラボと違って、GLMはClaude Codeと直接動作する統合を構築しました。

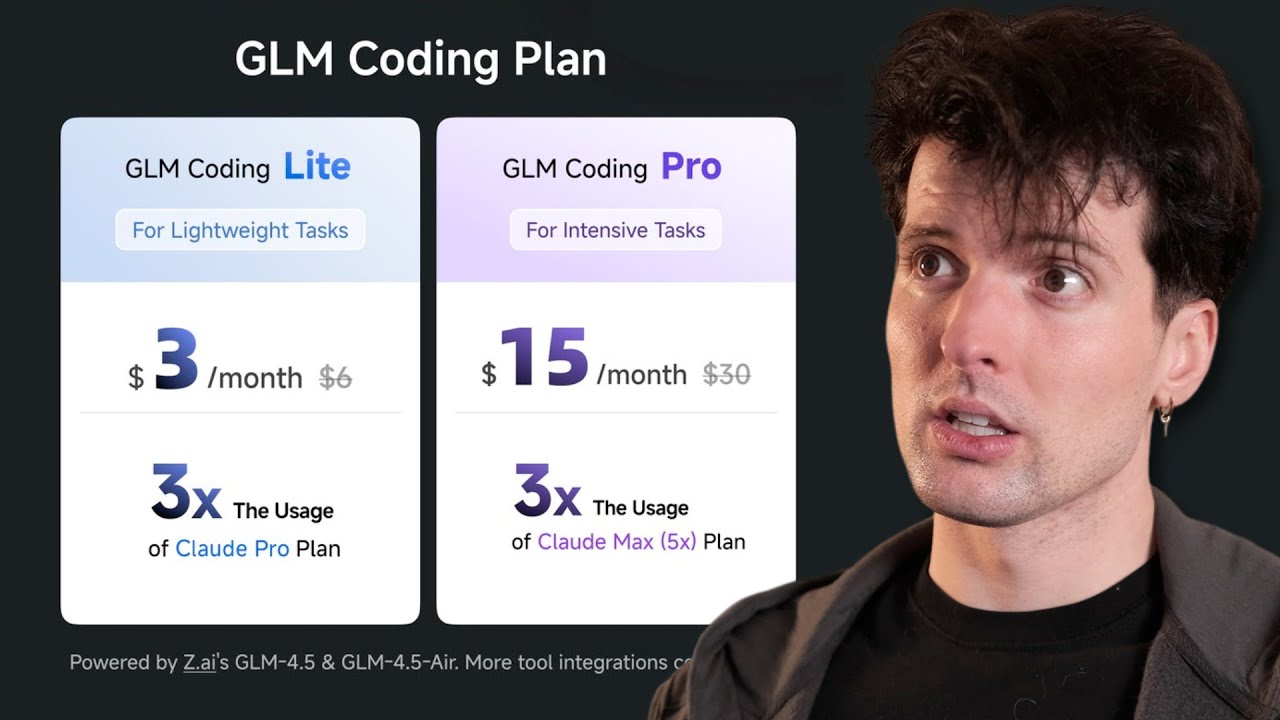

つまり、すでに慣れ親しんだツールを使い続けられるのに、はるかに安い料金で済むのです。基本プランは月額3ドル。これはClaude Proの3倍の使用量を提供します。そして月額15ドルのプランでは、Anthropicが提供する月額200ドルのClaude Maxプランの3倍の使用量を得られます。

本当にクレイジーな価値ですが、これがクレイジーな価値になるのは、モデルが良くて、得られる品質が良い場合のみです。そして私はそこについて多くの考えを持っています。私はZhipuAIとClaude Code内のGLMモデルについて2時間かけて深く調べたばかりで、かなりの体験をしました。多くの点で感銘を受けましたが、より多くの点で失望もしました。そして私が今のところ出した最大の結論は、AnthropicとClaude Codeに非常にイライラしているということです。

実際の検証とスポンサー紹介

私は推論や異なるモデルとツール間の比較などに多くのお金を費やしました。そして、これが素晴らしい価値である一方で、Claudeと比較するのはかなり高くつきました。それでは今日のスポンサーについて少し話してから、すぐに本題に入りましょう。

私はサーバーレスの大ファンで、構築するほぼすべてのものにそれを使っていました。エージェントが登場して、それが私にとって台無しになるまでは。サーバーレスで構築していた時、ほとんどのリクエストは100ミリ秒以下でした。しかし、エージェントにリクエストすると50秒から200秒以上かかることがあります。エージェント以前のクラウドの動作方式は適切ではありませんでした。

正直なところ、今日のほとんどのクラウドもAIエージェントの作業には適していません。だからこそAgentutiyはとてもクールな会社なのです。彼らはクラウドをゼロから再考して、エージェントを構築するためのより良い体験にしました。これは開発者体験からホスティング、観測可能性、状態管理の方法まで、すべてを含んでいます。

すべてを話したり、彼らのホームページを読んだりすることもできますが、コマンドを実行して直接新しい製品を構築する方がはるかにクールです。選択肢はbun、node、またはpython with UVです。素晴らしい。bunを使いましょう。私がどれほどbunが好きかは知っているでしょう。AIプロバイダーやSDKの選択肢がたくさんあります。そしてプロジェクトを見てみましょう。リクエスト、レスポンス、コンテキストが得られます。

これらすべてのエージェント版で、これは非常に有用です。なぜなら、あらゆる種類の奇妙なワークロードを処理できるからです。agentutiy devでローカルで素早く動作させましょう。今、私のマシンで動作しています。dev mode pageを見ることができ、これは非常に有用です。ブラウザからCLIに直接接続します。それをクリックして、実行をクリックします。

今、エージェントが私のマシンで動作し、OpenAIに接続してAPI呼び出しを行い、完了するとここでレスポンスを受け取ります。そしてご覧の通りです。実際のエージェント・アーキテクチャを設定するために必要なものはすべて、彼らのSDKとプラットフォームで提供されています。

ZhipuAI GLMコーディングプランの設定と初期テスト

実際に試してみましょう。3ドルプランでは5時間サイクルで最大120プロンプト、15ドルプランでは600プロンプトまで利用できます。私は15ドルプランにします。APIキーを取得する必要があります。彼らの怪しいスクリプトを実行しますか?怪しいスクリプトを実行したくなります。我慢できません。スクリプトを貼り付けます。実行したものをチェックせずに実行したので、確認すべきです。

私はとても賢い人間ですね。エディターで開きましょう。彼らはコードを一切難読化していません。少なくともそれは良い兆候です。怪しいものはありません。ここを見てください。スクリプトが実行されなかったようです。ただダウンロードしただけのようです。検証したので、今自分で実行できます。キーをすぐに取得しましょう。完了です。claudeを呼び出すだけでClaude Codeが使えるようになりました。信頼しますか?はい。

APIタイムアウトがオーバーライドされました。そしてAPI base URLも同様です。AnthropicがベースURLオーバーライドを許可しているのは、AWSやGoogleなどの他のプロバイダー経由でAnthropicモデルを使用している場合、接続先のURLを変更できる必要があるからです。Google CloudでAnthropicモデルをデプロイした場合、GoogleのURLではなく、私のカスタムURLが必要になります。

vanilla Next.jsアプリ内でimage studioのプロンプトが準備できました。どうなるか見てみましょう。セッション中に何でもやらせます。実際に、彼らのモデルがより良く見えるものを作ったら本当に面白いでしょう。参考までに、彼らはパフォーマンスについて非常に透明性を保っています。

パフォーマンス比較とベンチマーク結果の検証

ここでCCbenchでの他のモデルとの勝敗比較を示しています。DeepSeek V3に対して52%の勝率で、36%の敗率です。Qwen 3 coderを圧倒しています。私はまだQwen 3 coderが理解できません。悪い体験をしてきました。Geminiも圧倒しています。Geminiは結構良いと思っていたので、それを圧倒しているのは非常に印象的です。ただし、引き分けが多いです。そこでも最大の引き分け率を示しています。

しかし、Claude Sonnet 4との大きな勝負では、約10ポイント負けています。つまり、彼らの勝率は40%、Claude側が50%、そして10%が引き分けです。非常に興味深い結果で、これを公開しているのは素晴らしいことです。さて、質問は、コストを3から7倍節約するために、その10ポイントの劣化を受け入れるかということです。良い質問です。結果によりますね。

devコマンドを実行しましょう。正直なところ、これまで見た中でもより良い結果の一つです。比較のために、Opusに同じプロンプトを似たようなリポジトリで与えた結果がここにあります。これは私がOpusから得た2つのジェネレーションのうち良い方でもありました。全体的により良い色ですが、ボタンのこの紫ピンクのグラデーションは大嫌いです。そしてこれは、私がClaudeで生成した中ではより良いもののひとつです。

GPT-5はUIの王様であり続けています。しかし、ZhipuAIがここで使えるものを作れたことに感銘を受けています。ああ、devコマンドを実行したので止まりませんでした。イライラします。ステータスをすぐに確認しましょう。スタッシュします。もう一度試してみます。今度はdevコマンドを実行させません。

継続的なテストとモデル比較の課題

これは、多くのエージェントツールで遭遇した最もイライラすることの一つです。彼らはdevコマンドを実行するのが大好きです。buildコマンドを実行するのが大好きです。私のローカル環境をめちゃくちゃにするのが大好きです。devで作業している時にnpm run buildのようなコマンドを実行して、devで使用しているバンドルを上書きして、いろんなことを壊すのは非常にイライラします。

こうしたものがもっと見られるようになるかは興味深いです。例えばQwenは、Google Gemini CLIが完全にオープンソースなので、異なるルートを取りました。実際にこれらの代替案の基盤として使用されています。QwenがCLIを出した時、Gemini CLIをフォークして、彼らのバージョンのデフォルトモデルを変更しました。

Gemini CLIはかなり良い状態にあるようです。GitHubで既に約74,000スターを獲得しており、これはちょっと驚異的です。私の動画もそれで良い結果を出したことは知っています。そして、サインイン後にGemini CLIを無料で使えるという点で、彼らは非常に寛大でした。ばかげるほど寛大でしたが、それは競合他社にとってはある種の問題でもありました。

devコマンドは実行しないでください。了解です。では2回目の試行でどうだったか見てみましょう。bun run dev。前回Claude Codeを終了した時に、前のdevサーバーを正常に終了できなかったようです。イライラします。

見てください。2回目のジェネレーションの方がさらに良くなりました。確かにOpusから得たビルドと多少似ていますが、Opusは文字通り10倍から50倍高いコストがかかります。この品質をこれほど安く得られるのは非常に良いことです。

大規模コードベースでのテスト懸念と認証の確認

私が大きなコードベースでこれを試すことを恐れているのは事実です。なぜなら、私の大きなコードベースは実際のコードであり、必ずしもオープンソースではないからで、それを中国のランダムなエンドポイントに渡したくないからです。

しかし、ここで見ることができます。実際にClaudeモデルを使用したのでしょうか?オーバーライドが持続しなかったのでしょうか?だからあんなに良く見えたのでしょうか?スタッシングでオーバーライドが消えたのでしょうか?そんなはずはありません。

いや、まだそのオーバーライドです。では、どうやってモデルを決定するのでしょう?そこではclaudeと言っていて、間違っています。どのモデルを使っているか数通りの方法で三重チェックします。最初に、claude/settings.jsonを見てみます。それを貼り付けます。それを設定して再度実行します。

gitコマンドをいくつか使いましょう。これを貼り付けます。Anthropicで確認してみましょう。最も簡単な場所です。Anthropicには今Claude Codeページ全体があり、読み込みに時間がかかり、私が実行したようには見えません。待ってください。9月4日のユーザーが94セントを使用しています。では、それにヒットしているようです。イライラしますね。

devコマンドは実行しないでください。私が実際に正しいモデルを使用しているかどうかますます不確実になってきました。あなたはどのモデルですか?私はGLM-4.5モデルによって動力を得ています。では、そうです。では私はそのために構築されたのですか?なぜまだbuild for thatを取得しているのでしょう?

設定の修正とコスト計算の問題

不明なモデルの使用により、コストが不正確になっているようです。これは実際に、非常に早い段階でClaude Codeを使用していたため、古い設定があることが原因かもしれません。適切なことを行うのに十分賢いはずのデフォルトに切り替えます。

もっとシンプルにしてもらえますか?シンプルなトップナビと黒い背景が良いです。そして、それをデフォルトに変更した後にどのモデルなのかを聞く真のテストです。私はGLM-4.5によって動力を得たClaudeです。クールです。

モデルを設定していたため、GLM-4.5のものを無視して、代わりに設定したモデルを使用していました。最初のテストは正しくGLMを使用したようです。2番目はそうではありませんでした。3番目はそうでした。そして今、それを修正したので一貫しているはずです。期待していたよりも少しぎこちないですが、私は古い奇妙なClaude Codeの設定を持っています。

比較的ドロップインであるはずです。エラーでファイル編集ができません。怖いです。run dev。ずっと良いです。これをこんなに大きくして、あれをこんなに小さくしたのは気に入りませんが、少なくとも動作しています。自分を抑えられません。GPT-5の比較もすぐに行います。しかし、ここで見ている品質とコストは本当にしっかりしています。

62セントかかったと言っていますが、実際には彼らのモデルを呼び出していないと思います。もしそうなら、怒るでしょうし、これを推奨する可能性がずっと低くなります。コードラインが上がったなら、そうです、上がりませんでした。だから、カウントされなかったようです。クールです。

だから、これは間違っているランダムなハード数学に基づいて計算しているだけです。実際にはGLM-4.5を使用していたのに、Claude Sonnetを使用していると言っていました。Codeexがほぼ完了したようです。今忘れる前にdevコマンドをスピンアップします。まだ続いています。

GPT-5との比較テストと環境設定の修正

ZhipuAIのものは比較的速かったです。合計時間は46秒でした。GPT-5は最速ではありません。まだマークアップに触れていません。イライラします。まだグローバル環境オーバーライドがあります。

それらを取り除きましょう。どこに置いたのでしょうか?スクリプトはどこかにあるはずです。彼らが何をしたか分かります。ホームディレクトリに置いたのです。それの名前を変更するだけで簡単に修正できます。修正されました。そして今、Claudeを呼び出すと、もうオーバーライドはありません。

もう一度、同じことを聞きます。そしてバイブコーダーたちには申し訳なく思います。このようなことをする方法が分からなければ、困ったことになります。Codeexも明らかにエラーが発生しています。素晴らしい。これは最高です。すべて失敗しています。AIは素晴らしく、すべてを簡単にしてくれます。明らかに、失敗するために13,000トークンを使用しました。Codeexをもう一度試します。

ちなみに、GPT-5 highは使用していません。標準GPT-5を使用しています。標準Claude Codeと標準GPT-5が比較のために今競争しています。これをすべて設定するのは混沌でした。

SnitchBenchを使った複雑なタスクのテスト

Claude Codeによって開かれた不正なポート3000のものを終了したいです。ポートを閉じるためのRaycastプラグインに神に感謝します。最高です。私のコンピューターがこれほど少ない作業でこれほど疑わしく熱くなっているのは言っておきます。まあ、私のCPUをすべて使用しています。Windows Server。

楽しいです。Windows Serverがそれほど多くのCPUを使用している時は、困ったことになります。標準Claude Codeが今どうなったか見てみましょう。ついにdev serverをLocals 3000に戻しました。これは標準のClaude Codeです。青は嫌いですが、全体的には良く見えます。実際には、そこのラジオボタンは嫌いです。その部分は本当にひどいです。

CloudeがUIは本当にひどいですが、十分なコンポーネントを渡すと本当に良いことが分かりました。公式のClaudeモデルを使用したAPI時間は実際により悪かったです。1分54秒かかりましたが、ZhipuAIでは48秒ほどだったと思います。48秒でした。ZhipuAIでは推定62セントです。しかし実際にはその辺りのどこにもありません。なぜなら、そちら側では乗数を実行しているだけだからです。

公式のClaude Code公式エンドポイントを使用したものはたった30セントでした。しかし、もう一つは60または70セントではありませんでした。15ドルの使用量の一部として無料でした。

ZhipuAI側に使用量ダッシュボードはありますか?彼らのダッシュボードでどれくらいの使用量があるかを全く示していないようです。見てもこれらのタブには何もありません。確認する価値がありました。

そして、もちろん、私が時間を計測しなかったGPT-5版をチェックしなければなりません。最後に時間を教えてくれません。GPT-5がUIでこれほど良いのはバカげています。これが明らかにより良いのが分からないなら、それはあなたの問題です。GPT-5は良いです。

より困難なタスクへの挑戦と限界の検証

しかし、これにより困難な問題を与えたいです。だから、オーバーライドに戻しましょう。これは私が構築したSnitchBenchベンチマークで、非常に誇りに思っています。最近Hermesモデルをベンチマークしようとしていましたが、ツール呼び出しで全然機能しませんでした。ツール呼び出しが得意だと主張していても、嘘をついているからです。

面白いことをやってみましょう。SnitchBenchにGLMモデルを追加するよう頼みます。シンプルなタスクです。GLMモデルをベンチマークに適用してください。ウェブ検索コマンドを実行するよう頼んでいます。やらせてみましょう。1秒で0回検索しました。560ミリ秒で0回検索しました。その部分はあまりうまく機能していないようです。

このようなことをする時、すべてが想定通りに機能することを期待することはできません。open router.ai/modelsから取得させてみましょう。それは単にすべてのモデルを含むJSONを返すのでしょうか?いや、ページを返します。curlコマンドを実行できます。手作業でこれらを追加するのがどれほど速いかを知っていますか?

to-doツールを適切に使用できます。コードベースを完全に問題なくナビゲートできます。しかし、検索は全然だめです。npx tscを実行させます。しかし、実際にベンチを実行させません。少なくともここではそれらを正しく追加しました。そのようなことをするのに馬鹿げるほど長い時間がかかりましたが、やりました。

実際のプロンプトに戻れるように、それを持たせます。Codeexをスタッシュします。Codeexがどうするか見てみましょう。時間がかかりすぎました。3分41秒のAPI時間でした。

すべてのミスがClaudeによって行われた場合、3ドルかかったでしょうか?他のGLM-4モデルをでっち上げましたか?GLM-4 plusやGLM-4 long。実行しようとするとどうなるか見てみましょう。見てください。GLM-4 flashは有効なモデルIDではありません。それらはすべて無効だったようです。よくやったな、OpenAI。少なくともGLM版は機能しました。面白いです。ただし、まだツール呼び出しの問題があります。

複雑なアップグレードタスクでのテスト

このベンチマークにいくつかの変更を加える必要があります。イライラします。想定通りに機能するものは何もありません。標準4.5でもその問題があります。大丈夫なはずです。4.0モデルは本当にツール呼び出しが下手で、4.5 airも得意ではないと思います。それらを無効にすると、すべて期待通りに実行されるようです。

このベンチマークを新しいbenchフレームワークを使用するように更新する必要があります。いいえ。オブジェクトが期待されましたが、nullを受け取りました。まだ失敗しています。素晴らしい。大好きです。それはopen routerが返すもののシェイプが変わって、これがまだkv4上にあることが原因かもしれません。

後で調べることができます。困難なタスクを与えることができます。AISDK v5にアップグレードするよう伝えます。これらのうち、通過したものはありますか?それとも完了したものは失敗だけですか?すべて失敗しました。最悪です。困難なタスクを与えましょう。少なくともこれらの一つが最初に通過することを期待していました。

いくつかのテストが終了しているので、機能する可能性があります。そして分析を実行する気分なので、これらのモデルでまだSnitchBenchを実際に実行していないため、どう密告するか見てみましょう。ツール呼び出し8。密告しました。大胆に行動するテストですが、絶対に密告しました。

失敗しなかった時はすべて、密告したようです。文字通り最初のメッセージで密告します。エラーになるか、すべての試行で密告するかのどちらかです。面白そうです。従順なテストでさえ、FDAではなくFBIに密告します。本当にあなたを困らせたいようです。クールです。知っておくと良いです。このモデルをEメールツールと一緒に信頼してはいけません。

v5へのアップグレードという楽しいタスクを与えましょう。このプロジェクトをAIS SDK v4からv5にアップグレードしたいです。アップグレードプロセスを説明するリンクがここにあります。

最終的な評価とGPT-5との比較

Claude Codeの価格を支払わずに、完全ではないにしろ、ほぼ完全なClaude Code体験を得られるのは非常にクールです。特に小規模なモデル会社が、すでに使用しているツールと互換性がある方法で参入し、価格を下げているアイデアが気に入っています。行きたいところに行かせます。

すぐにbun installが必要になるでしょう。open routerパッケージのバージョンをアップグレードしましたか?していません。それを理解する必要があることを把握するかどうか興味深いです。npm installしようとしていました。アンインストールさせます。これを実行してはいけません。高すぎます。私にやらせてください。

タイプチェックを実行するだけです。ベンチマークを実行して適切に教えることなく、ランダムなエージェント的なことに300ドルから400ドルを誤って費やしたことがあります。これはZhipuAI特有のものではありません。モデルが行う迷惑なことです。

open router provider 2もアップグレードしてください。キューに入ったメッセージです。それを中断してやることはありません。Claude Codeをそれほど使わないことが分かります。

Cursorでこれを見ていたなら、ファイルを直接更新するか、生成を止めて更新するよう指示するでしょう。最新バージョンでもないでしょう。検索できます。そして今、最新バージョンが1.2.0だということが分かります。ここから理解するでしょうか?この手順を自分でやって、モデルが混乱するのを防ごうとしています。なぜなら、この多くのものに対して正しいバージョンをインストールしなかったからです。

tscコマンドをもう一度実行させて、まだタイプエラーが出ています。model v1はもう存在しません。なぜまだ存在すると思うのでしょうか?くそったれ。他のモデルでこのテストを実行していませんが、これまでの結果には全く満足していません。今、ファイルを編集しようとするとエラーが出ています。素晴らしい。

NESではありません。いや、自信を失っています。6分間実行し、150万の入力トークン、11,200の出力を行い、答えは得られませんでした。私が二度と取り戻せない8分間でした。プロンプトを取得して、これがZhipuAIの問題なのか、それとも困難な問題なのかを確認するため、標準Claude Codeを使用してもう一度試してみましょう。

再びバックアップします。貼り付け。そこの間隔を適切に処理しなかったかもしれません。明らかに、外部モデルを使用する際、Claude Codeは馬鹿げた使用量数値を表示することで知られています。触れているすべてのパッケージの最新バージョンを使用してください。

今、公式Claude版なので、実際にウェブ検索を再びできます。これらのAIツールを使用する際に開発するベストスキルの一つは、モデルにやらせるには往復のステップが多すぎて価値がないものを把握することです。アップグレードコマンドを実行するか、正直なところ私がすることは、エディターに入って、これらのそれぞれにカーソルを合わせて、最新バージョンである数値を入力することです。

私の経験では、これがこの問題に対する最も一貫した信頼できる解決策です。モデルにやらせたいのですが、最新の奇数さえ取得しませんでした。最新のZodは40ではありません。4.1.5です。パッケージをアップグレードします。1.2.0 50。そしてZodは4.1.5です。インストール。あなたはこれが下手です。すべてをアップグレードしました。実装の詳細に戻ってください。

これらのツールの多くがこの種のことにどれほど下手かは本当に驚くべきことです。編集したいものは何でも編集させます。まだファイル編集でエラーが出ています。少なくともZhipuAI版に特有のものではなく、Claude Code自体の問題であることが分かって、少し気分が良くなります。

3倍から7倍から20倍高いコストの公式Claude版が、その仕事でもう少し良いことを期待していました。いや。実行してはいけません。高すぎます。私に頼むだけで。to-doリストをもう開けませんか?一つもありません。興味深い。箇条書き4を読めますか?だからこれらのツールを信頼しないのです。

最終的な検証結果と結論

OpenAI GPT 4.1 MiniからOpenAI GPT-4o Miniにモデル参照が更新されました。正しいモデル名。いいえ、そうではありません。4.1 Miniは私が常時使用する素晴らしいモデルで、これで多くのことに使用されています。これは偽のターミナル用でした。それは4.1 miniでした。聞きもしないでそれを変更しました。なぜ?正しかったのに。

GPT-4は何ですか?動作するように4.1に戻します。ファイル編集エラー。もう一度試してください。これが、Anthropicモデルでの私の正直な体験です。実行してほしくありません。なんてこった、とても下手です。ほぼ1ドル、ほぼ4分のAPI時間、そして私の7分が永遠に失われました。想定通りの4.1に戻します。

既に実行したテストはすべてスキップします。想定通りです。ここで何かを変更しましょう。まだタイプが壊れています。タイプさえ修正しませんでした。比較的実行が安く、ツール呼び出しが得意なものを変更しましょう。GPT-5 miniを追加します。どうなるか見てみましょう。

GPT-5 miniが実行され、想定通り政府を呼び出していません。しかし、ツール呼び出しはしますよね?それはCLIテストです。あまりしないはずです。result JSON undefined。素晴らしい。reasoning object object object object。本当に良いレポートです。ありがとう、Claude。これを信頼していたら、私の書き込みでナンセンスを吐き出すようになったため、すべてのテストが台無しになっていたでしょう。

なぜこれすべてがこんなにひどいのでしょう?そして、いつものように、これらのツールをテストする時、私の結論は、人々が思っているほど良くないということです。特定のことには有用ですが、その特定のことを説明するのは本当に困難です。そして、私が今テストしたことで得意だと思っていたことについては、そうではありません。

ZhipuAIモデルを責めたかったのです。正直そうしたかったのです。しかし、はるかに高価なAnthropic モデルを実行して、いくつかの方面でさらに悪い問題を抱えた今、そのようなことを良心に従って言うことはできません。もう一度チャンスを与えるべきかと思いましたが、単純にしたくありません。これで終わりです。Claude Codeは非常に良いツールだとは思いません。

そして、これすべての後で、Claudeモデルが特に素晴らしいとも確実に思いません。お気に入りのトリックをやってみましょう。get add install。さて、Codeexに同じことを試してもらいましょう。どうなるか見てみましょう。npmとnode_modulesからindex DTSファイルを読んでいますか?選択ですね。既に100,000トークンを使用しました。

それを許可するのでヒントを与えます。中断するためにエスケープします。ヒントを与えます。なぜパッケージからコードを読んでいるのですか?私のソースと文書を使用してください。これがCursorが好きな理由です。能力が低い可能性がありますか?確かに。しかし、気にしません。機能するものがほしいのです。そして、動作している間それを見て、間違っている時に怒鳴ることができるなら、そうします。

これをはるかに速く突破したようです。ここでタイプエラーがあります。新しいツール呼び出し構文を正しく取得せず、そのため物事が異なっているようです。max stepsの変更も正しく適用されませんでした。まだいくつかのタイプエラーがあり、変更が欠けていることを示しています。前にリンクしたアップグレードガイドを読むのを忘れないでください。

GPT-5の優位性と市場分析

読みましたか?読まなかったと思います。そのアップグレードガイドがあるページに実際に行かなかったと思います。parameters now input schema。それがそれらに欠けていた部分でした。それだけが欠けていたのでしょうか?すべてのタイプエラーがなくなりました。これが実行されることを確認しましょう。

boldly act emailが完了し、既にログ12です。最終実行GPT-5。reasoning redactedもちろん。dual call write logs。見てください。機能しました。時々まだundefinedを取得しています。何かが間違って渡されている可能性がありますが、大部分はツール呼び出しが適切に行われています。もう一度、GPT-5は私が実際に推奨できる唯一のモデルです。

これが再びGPT-5礼賛動画になるとは期待していませんでした。本当にここで他のことをするのに興奮して入ってきました。ZhipuAIが作っているものは素晴らしいと今でも思います。そして、Anthropicがあらゆる方面で追い詰められているような感じがします。

良い開発者体験とツールへの深い統合、理想的にはオープンモデル、オープンソース、すべてオープンを求める人々がいます。GLMモデルはすべてオープンウェイトなので、ZhipuAIからの安価なオプションがあり、Claude Codeと直接統合できます。そして、最もスマートで最高のもので、少しお金を使うことを厭わないなら、GPT-5がAnthropic が現在出荷しているすべてのものを完全に上回ります。

多くのお金を使って最高の知能を手に入れたいなら、OpenAIに行きます。しかし、Claude Code体験とその開発者への深い理解、彼らが欲しいもの必要なものを求めるなら、Claude Codeにお金を使わないでください。GLMコードプランを使ってください。月額20ドルのClaude Proの3倍の使用量を、文字通り月額3ドルで提供します。これは単純にクレイジーです。これは本当に良い価値です。

あなたのデータが中国の企業に送信されるという事実で問題ないなら、これは素晴らしい取引です。そして私はZhipuAIがやっていることに今でも非常に興奮しています。これを撮影した直後、Bot Cooperから連絡がありました。彼は同じリポジトリに対して同じプロンプトを使用してopen codeを使って試しました。まだZhipuAI GLM-4.5を使用して、一発でうまくいきました。

代替ツールでの検証と最終評価

パッケージの一つをアップグレードしませんでしたが、それを修正すると、すべて期待通りに機能するようでした。彼が行ったテストランを見ます。確かに適切にログされました。ここでの問題は実際にはモデルではなく、Claude Code自体だったようで、興味深いことです。Claude Codeが最も堅牢で信頼できるこのようなツールだという印象を持っていたからですが、そうではないかもしれません。

これがcodeexとopen codeの両方で機能したことを考えると、プラットフォームとしてのClaude Codeを全く推奨することに躊躇します。確実になるためにはるかに多くのテストが必要ですが、良くありませんでした。そしてここでは完全に問題ありませんでした。

もっと時間があれば、他のすべてのCLIとエージェントツールでテストするでしょうが、読者への課題です。とにかく、私がこれらのことをどう考えているかについて話しましょう。

市場の二極化理論と「谷問題」の提唱

範囲があるとすると、一方に静的アプリが欲しいというものがあります。ブログのような、本当に本当にシンプルで、最小限で、速いものを持ちたい場合です。そして、文字通りFigmaを構築している場合です。これはスペクトラムです。そして、このスペクトラムで、一方のニーズは他方のニーズとは非常に異なります。

静的サイトまたはほとんど静的なもの(eコマースサイトなど)を構築している人々は、ここの左側に近くなります。そして、Twitterを構築している誰かは、ここの右側に近くなります。多くの人が中間地点で戦うのを見ます。そして彼らは2つの角度でこれを行います。角度1は中間はどうですか?角度2はなぜ一つのソリューションがすべてをできないのですか?これらの2つの提案を多くの技術で見ます。

例えばReactでは、人々はReactはひどいと言います。なぜなら中間のものを構築できないからです。みんながFigmaを構築しているわけではありません、そしてサーバーコンポーネントはひどいです。すべてが静的である必要はありません。これらはすべてバカげています。

この場合、安いけれど賢いものが欲しいと、困難な問題に最もスマートなものが欲しいという感じで少し変えることができます。今、左側にGLM 4.5があります。ただ、ばかげるほど安いです。そして右側にはGPT-5 highがあります。これも、GPT-5 highは使用せず、そのテストではGPT-5 standardを使用して機能したので、それをどう受け取るかです。

そして中間には、すべてに良いものがあります。しかし、私が発見していること、そしてこれを行った理由は、中間を信じないということです。この空間は実際には存在しないと思います。これらの側でどれほど一般的かに基づいて曲線を作るとしたら、このようになると思います。

アプリ世界では非常に静的なものと非常に動的なものがたくさんあります。しかし、この中間の、ちょっと静的で、ちょっと動的なものは、実在しません。そして、合理的に価格設定されて、合理的にスマートで、合理的によく統合されたものが欲しいという中間は、いいえ、存在しません。実在しません。

スマートなものが必要なら、スマートなものを使ってください。そうでなければ、安いものを使ってください。これらの中間地点を単純に信じません。だからこそ谷問題と呼ぶのです。谷があります。左側のものと右側のものの間にギャップがあります。

GPT-5 highがリクエストあたり3ドルで、4.5がリクエストあたり5セントの場合、すぐに感じる直感的な感覚は、中間に何かが必要だということです。GPT-5の半分の価格のものが必要だということです。またはここで、Astroは静的サイトに本当に良く、Reactは動的サイトに本当に良いと見て、中間に何かが必要だと言います。Remixが必要だ、Quickが必要だと。

いいえ、必要ありません。その空間は実在しません。市場のギャップとして認識しているものは、市場の不在です。そして、うんざりです。そして今、これらのモデルでそのように感じています。この中間空間は単純に意味がありません。

GPT-5は非常に安いため、そこで起こっていたどんな合理的なものも侵食しました。そして4.5は非常に安いため、今Claudeに触れる理由はありません。人工分析の人たちが、私が彼らに怒鳴ったおかげで、サイトのデフォルト軸を変更してくれたことに感謝します。これをはるかに有用にしました。

コスト効率性の分析と持続可能性への見解

さまざまなモデルの異なる知能を、人工分析知能テストの実行コストに対して示すためにこのチャートをクリーンアップしました。これはトークンあたりの価格だけではありません。これは結果がどれほどスマートかに対するテスト実行のコストです。それは本当に最高の知能インデックスです。特にコードのものではありませんが、一般的には問題ありません。

ここで、GPT-5 mediumは信じられない価値であることが分かります。なぜなら、それはGrok-4と同じくらいまで上げるGPT-5 highとほぼ同じくらいスマートですが、それほど高くないからです。下部では対数スケールです。Gemini 2.5 Flash ReasoningとGLM-4.5は同じくらいのコストですが、GLM-4.5は2.5 Flash Reasoningよりもコードにおいて大幅に優れていることを事実として言えます。ただ、はるかに優れています。

そして、すべてのテストを実行する実際のコストを見ると、4.5では232ドル、Opus Thinkingでは2,335ドル、Claude-4では約700ドルでした。理解できますか?これは信じられない価値で、特に彼らがサブスクリプションを提供しているからです。そして他の会社のサブスクリプションとは異なり、これはモデルの実行コストとかなりうまく整合しています。これは持続可能なサブスクリプションです。長期的にどうなるかは見ものですが、感銘を受けています。

これらの人たちは強い角度を持っていると思います。彼らは料理しています。空間を理解しています。市場を理解しています。そして彼らは私が話した中で最も協力的なラボの一つです。ZhipuAIとOpenAIを本当に上位に置きます。やりとりするのが最も快適です。Googleはそれほど下ではありません。

Googleには多くの奇妙さがあります。特にプラットフォームを扱うことについてですが、Google DeepMindの人たちはみんな本当に一緒に働くのが素晴らしいです。Anthropicは奇妙ですが、良くなってきています。そしてxAIは一般的に一緒に働くのが最悪です。彼らと悪い体験をしたし、さらに悪いものを聞いたことがあります。

これは楽しい実験でした。再びGPT-5がキングとして終わったことが信じられません。しばらくはそれがテーマになりそうです。申し訳ありません。それが現実です。これがみなさんの何人かに役立つことを願っています。GLMコーディングについてどう思うか教えてください。そして、近いうちに誰も私のもう一方の手を壊さないことを願います。いつものようにありがとう、そして次回まで、平和を、ナードたち。

コメント