GPT-5

GPT-5 GPT-5 – 彼らが言わなかったこと

OpenAIが発表したGPT-5に関する詳細分析である。プレゼンテーションの問題点から始まり、GPT-5が単一のモデルではなくルーター機能を持つシステムであること、ベンチマーク評価の疑問点、価格設定の魅力、そして他のAIモデルとの比較まで幅...

GPT-5

GPT-5  GPT-5

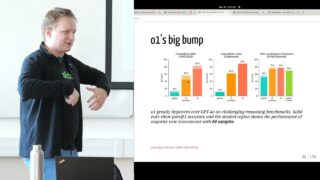

GPT-5  AI推論・CoT

AI推論・CoT  RAG

RAG  AI研究

AI研究  AIアライメント・安全性

AIアライメント・安全性  AGI・ASI

AGI・ASI  LLM・言語モデル

LLM・言語モデル  脳科学・意識・知性

脳科学・意識・知性  LLM・言語モデル

LLM・言語モデル  LLM・言語モデル

LLM・言語モデル  イーロンマスク・テスラ・xAI

イーロンマスク・テスラ・xAI  AGI・ASI

AGI・ASI  AIエージェント

AIエージェント  LLM・言語モデル

LLM・言語モデル  ソフトウェア開発・プログラミング

ソフトウェア開発・プログラミング  LLM・言語モデル

LLM・言語モデル  AI研究

AI研究  LLM・言語モデル

LLM・言語モデル  LLM・言語モデル

LLM・言語モデル  LLM・言語モデル

LLM・言語モデル  LLM・言語モデル

LLM・言語モデル  LLM・言語モデル

LLM・言語モデル  LLM・言語モデル

LLM・言語モデル  AIベンチマーク

AIベンチマーク  LLM・言語モデル

LLM・言語モデル  LLM・言語モデル

LLM・言語モデル  Google・DeepMind・Alphabet

Google・DeepMind・Alphabet  LLM・言語モデル

LLM・言語モデル  LLM・言語モデル

LLM・言語モデル  Anthropic・Claude・ダリオアモデイ

Anthropic・Claude・ダリオアモデイ  Apple・ティムクック

Apple・ティムクック  LLM・言語モデル

LLM・言語モデル  AGI・ASI

AGI・ASI  Apple・ティムクック

Apple・ティムクック  Apple・ティムクック

Apple・ティムクック  LLM・言語モデル

LLM・言語モデル