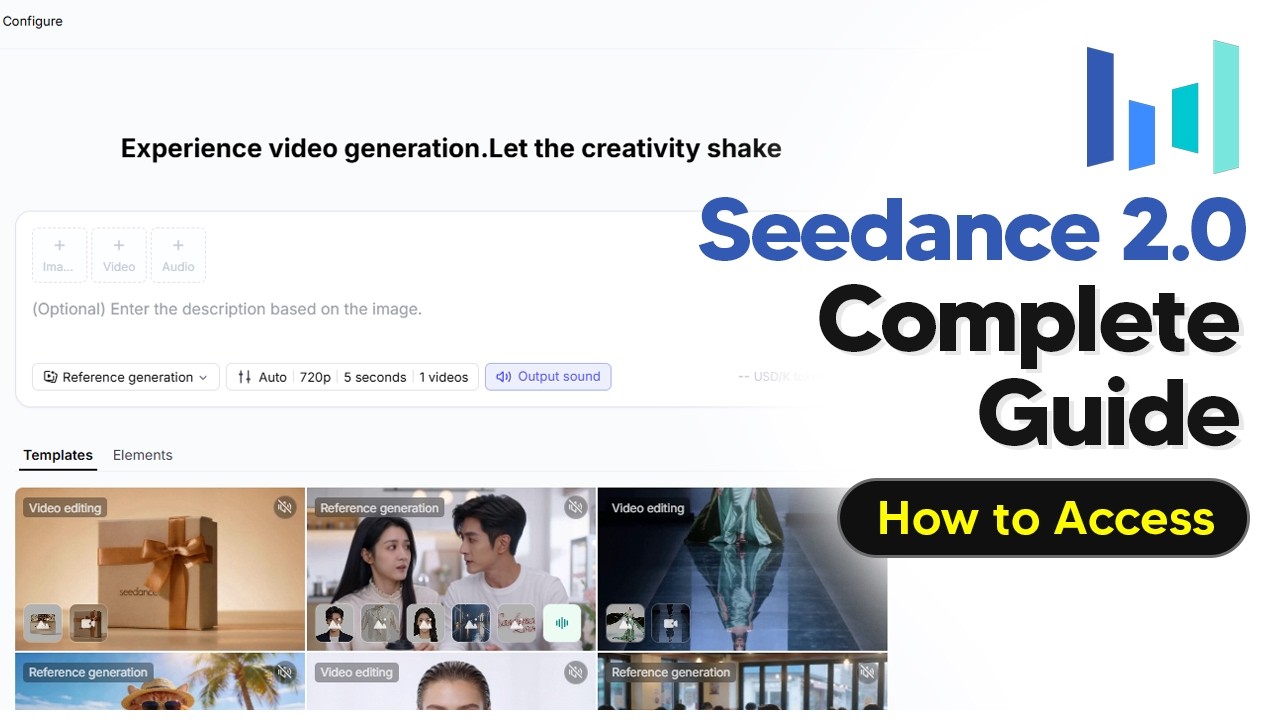

ByteDanceが開発した次世代動画生成AI「Seedance 2.0」は、現在インターネット上で大きな注目を集めている。本動画では、このモデルへのアクセス方法と効果的なプロンプト技術を詳細に解説する。Seedance 2.0は、テキストや画像から高品質な動画を生成できる革新的なツールであり、特にモーショングラフィックスやキャラクター動画の制作において、従来数千ドルかかっていた作業を大幅に効率化する可能性を秘めている。本ガイドでは、アカウント作成から実際の使用方法、最適なプロンプト作成のコツまで、初心者が知っておくべき全てを網羅している。

Seedance 2.0の基本とアクセス方法

ByteDanceのSeedance 2.0が今、インターネットを席巻しています。今日の動画では、このモデルに実際にアクセスする方法と、最高のプロンプト技術の使い方をお見せします。それでは早速、動画に入っていきましょう。

まず最初にやっていただきたいのは、説明欄にあるリンクをクリックすることです。これでByteDanceのPlayground Arenaに移動します。ここでモデルに簡単にアクセスできるようになっています。もちろん、サインインする必要がありますが、アカウントをまだ作っていない場合は、「今すぐサインアップ」ボタンをクリックしてください。ここでByteDance Plusへのサインアップを促されます。

ほとんどの方にとっては、Googleアカウントで続行するのがおそらく一番簡単でしょう。すでにGoogleアカウントをお持ちでしょうから。ただし、電話番号を用意しておく必要があることを覚えておいてください。これは必須要件となっています。では、サインインのプロセスを進めていきましょう。

アカウント作成とセットアップ

サインインのプロセス中に、アカウントプロフィールを追加する必要があることがわかります。組織名、フルネーム、国、住所、郵便番号などです。これらの詳細はそれほど重要ではありません。最も重要なのは、電話番号が実際の電話番号であることです。なぜなら、アカウントを作成するためにこれを確認する必要があるからです。

詳細を入力する際は、必ず実際の電話番号を入力してください。電話番号を入力してコードを受け取ったら、必ずそのコードを入力してください。アカウントが作成されたら、ログインエリアにアクセスできるはずです。ここから次のステップが始まります。

ログインしたら、チャットエリアではなく、メディアエリアをクリックしてください。そして、ドロップダウンメニューから、ByteDance Seedance 2.0をクリックしてください。ドロップダウンメニューには複数の異なるモデルが表示されますが、正しくサインインしていれば、「エクスペリエンスのみ」と表示されているByteDance Seedance 2.0が表示されるはずです。

ここで見ていただけるのは、エクスペリエンスというモデルがあることです。つまり、これは最終バージョンではないということです。もちろん、これは変更される可能性があります。もう一つ注目すべき点は、500万の無料トークンが提供されるということですが、これらのトークンは動画の解像度や出力によってかなり使用されます。

モデルの有効化と支払い設定

ここでのステータスは「有効化されていません」となっています。つまり、私はこれにアクセスできません。これを有効化する必要がある部分に移動します。有効化に進むと、私の場合はByteDance Seedance 2.0のみを有効化したいので、確認と認証をクリックします。

次に、支払い詳細を完了します。完了をクリックします。そして、もちろんアカウントプロフィールを追加します。ここにあります。ここでは、もちろん詳細を入力します。これから入力していきます。そして、もちろんこれが完了したら、支払い方法を追加します。カードを追加します。

これで全て完了したら、動画が完成するはずです。ここでご覧いただけるように、全て完了すると、動画の処理が開始されたことがわかります。カードを追加した時点で、実際に物事が進み始めます。

チャット機能でのアクセス方法

Seedance 2.0にアクセスするもう一つの方法は、実はチャットでも利用可能だということです。チャットの唯一の問題は、これを使用するには招待コードを取得する必要があることです。私は招待コードを3つしか持っていません。そのため、この動画には掲載しません。おそらく瞬時に消えてしまうでしょうから。私のAIアカデミーに掲載する予定です。

これは基本的に私の小さなコミュニティで、文字通り1日たった10分でAIにおいて99%の人々より先を行くことができます。ここに掲載する唯一の理由は、申し上げたように、これは独占的なものを共有するコミュニティだからです。テンプレート、プロンプトプレート、AIツールへの早期アクセスなどです。

これは文字通り私のコミュニティです。文字通りこれを構築したばかりです。文字通り全てのエージェント、全てのテンプレートがあります。エージェントに行けば、たくさんのものがあります。プロンプトに行けば、たくさんのものがあります。レッスンに行けば、さまざまなAIビジネスを始めるためのたくさんのものがあります。

これを始めた理由は、ほとんどの人がAIが非常に速く動いていることを認識しているからです。このようなものがあれば、AIアカデミーのようなもので、文字通り1日10分、月額10ドルで、飛び込むだけで最新情報を得ることができます。このようなものは非常に有用です。私の場合、招待コードをそこに残す予定です。

それがうまくいかない場合は、APIを待つしかないでしょう。チャットでの生成にどれくらい時間がかかるか気になる方もいるでしょうが、かなり時間がかかります。ここでご覧いただけるように、アイアンマン対サノスについての動画を依頼しました。これはおそらくモデルのプロンプト方法としては適切ではありません。

本当に良いものができるはずだとわかっていますが、基本レベルのプロンプトがどんなものか見たかっただけです。完了までに約15〜20分かかると表示されています。このプラットフォームを使用する際は、現時点ではそれほど速くないことを理解してください。このモデルに対する需要が現在、非常に高いためです。

効果的なプロンプト技術

プロンプトに関して私が見つけた重要なことの一つは、Patrick Castleによるもので、Seedance実際には単一の画像に適用できるカメラムーブメントを持っているという事実です。この例では、説明欄にリンクを残しますので、皆さんもご覧いただけます。プロンプトには「ビデオ1のリズムに合わせたカメラムーブメントとシーントランジション、および複製のための画像1の赤いスーパーカーを参照してください」と書かれています。

これはチャットではできないと思いますが、現在のSeedanceに実際にアクセスできる場合は、基本的にその動きを単一の画像全体に変換できます。これは非常に強力です。なぜなら、1つの映像を取って、全く別のものに変換できるからです。

特定の動きを説明しなければならないのか疑問に思っているなら、その必要はありません。それがSeedanceの力です。ソフトウェアには数多くの例があり、文字通りさまざまな画像を取ることができます。動画から動画へ、画像を取って動きを使うことができ、それを本当にうまくやってくれます。

キャラクターの一貫性を保つコツ

このモデルSeedanceは、それほど広範なプロンプトを必要としないことを覚えておいてください。しかし、私が読んでいるガイドが言っている一つのことは、最高の一貫性を得るためには、最大1〜2枚のキャラクター画像を使用するのが最善だということです。複数の異なるクレイジーなキャラクターが演技をして、あらゆるクレイジーなシーンを行うのを見ている動画ですが。

文字通り画像から1〜2人のキャラクターだけを使用するのが最善です。なぜなら、より多くの画像を使用すると、14の異なる主題を持つことができるNano Banana Proのようなものとは異なり、AIが少し混乱し、一貫性が低下する可能性があるからです。2人のキャラクターが戦っている動画を作る場合は、1〜2人のキャラクターのみを使用してください。

あるいは、私が提案するのは、AIモデルがキャラクターが誰であるかの知識ベース、つまり内部知識ベースを持っている場合です。例えば、Twitterで人々がサノスの戦闘シーン、インフィニティ・ウォーの戦闘シーン、キャプテン・アメリカ対スパイダーマンの戦闘シーンをやっているのをすでに見たことがあるかもしれません。これらの動画は、まあまあで、安定性があります。なぜなら、AIがすでにこれらのキャラクターが誰であるかを認識しているからです。

キャラクターが継続的に認識されることを確実にしたい場合は、1〜2枚の画像のみを使用してください。そうしないと、混乱する可能性があります。もう一つやるべきことは、プロンプトの継続時間を使用している場合は、その継続時間を明示的に述べることです。例えば、女性が3秒間歩き、止まってから2秒間振り向くと言う場合です。

これももう一つやりたいことです。そして、もう一つ言いたいことは、私が実際にこのモデルをさまざまなユースケースで見ていたときに気づいたのですが、このモデルは基本的に全てを行うモデルだということです。かなり陳腐に聞こえるかもしれませんが、真実にこれ以上近いものはありません。

モーショングラフィックスとコスト削減

これは基本的に全てを行うモデルです。ご覧いただいている動画は、本質的に単一のテキストプロンプトと単一の画像プロンプトで作成されたモーショングラフィックス動画です。これに関するプロンプトは非常に非常に詳細だったと確信していますが、ここで言いたいポイントは、モデルが明らかに苦労しているものが一つもないということです。

これまでの全てのモデルには、映像がAI生成であることが明確にわかるような何らかのボトルネックがありました。この例について言えることは、テキストやもちろん数字が少しぼやけたり、少し変になったりするケースが潜在的にあるということだけです。しかし、どれだけの時間、お金、労力を節約しているかを考えると、これは懸念の原因ではないと思います。

典型的なモーショングラフィックスプロジェクトは、非常に低価格で約600ドル、非常に高価格で4,000ドル、3,000ドルくらいかかります。つまり、人々がこの技術を使用するインセンティブがあることを理解しなければなりません。もちろん、これが人々のキャリアを奪うことになることは嬉しくありませんが、これらのモデルがこれほど優れている場合、ハリウッドはこれに注目するのかという質問を始めなければなりません。

私は確実にこれに注目します。これでたくさん遊んでみるつもりです。もちろん、より多くのツールやチュートリアル、このようなものや本当に特定のワークフローを見つけた場合は、私のコミュニティに残します。もちろん、できる限り動画を作ります。動画を楽しんでいただけたら、次の動画でお会いしましょう。

コメント