3,639 文字

これはとても興奮する話題です。私たちは大規模言語モデルのための完全に新しいアーキテクチャを手に入れました。それは拡散(ディフュージョン)を利用したもので、他の全ての人が使用している自己回帰型アーキテクチャとは異なります。優れたAIのAndrej Karpathyもこれについてツイートしています。これについては後ほど詳しく説明します。

予想通り、このモデルは非常に高速で、トークン生成プロセスが本当に気に入っています。これはInception Labsという会社から発表されたもので、彼らはMercuryという商用規模の初めての拡散型大規模言語モデルをリリースしました。拡散に基づいているため、最先端の速度最適化LLMよりも10倍速く、既存のNVIDIAハードウェア上で毎秒10,000トークンまで生成できます。非常に高速であり、そのパフォーマンスはGemini 2.0 Flashlight、GPT-4o miniなどの小型フロンティアモデルと非常に似ています。

拡散型言語モデルとは正確には何でしょうか?これについてはAndrej Karpathyの投稿を見てみましょう。彼は言います。「これまで見てきたLLMのほとんどは、コアモデリングアプローチに関しては類似しています。そのほとんどはトランスフォーマーベースか、その変種です。それらはすべて自己回帰的に訓練されています。つまり、左から右へトークンを予測していきます。」

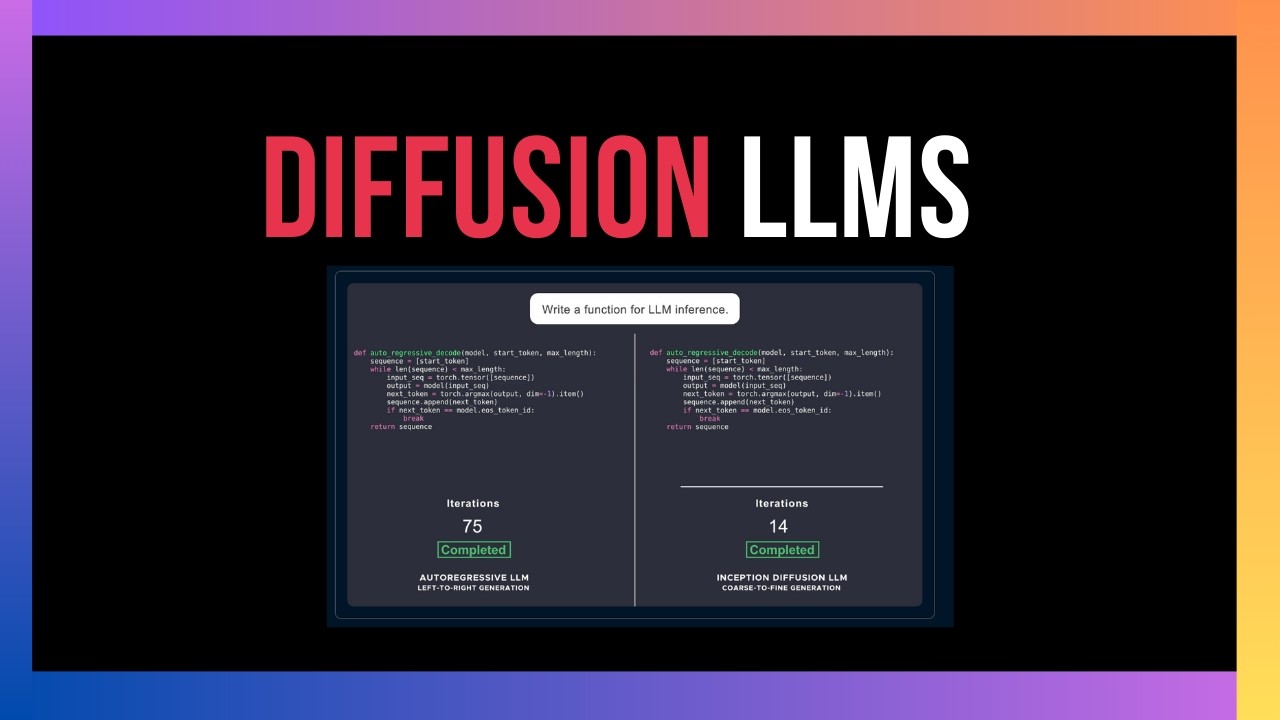

すべてのトランスフォーマーベースのモデルは次のトークン予測器または生成器です。データの分布を見て、それに基づいて次にどのトークンが出現するかを決定します。拡散は異なり、左から右へではなく、一度にすべてを処理します。ノイズから始めて、徐々にトークンストリームへとノイズを除去していきます。拡散は並列で動作し、解決策を生み出した後、その解決策を並列生成で反復処理します。

原理的には、これは今日私たちが見ている画像や動画生成モデルと非常に似ています。SoraやV2のようなものも拡散に基づいています。Andrejは、テキスト、そして時にはオーディオだけが拡散の部分に抵抗してきたと述べています。なぜかテキストは自己回帰を好み、画像/動画は拡散を好むという理由が、彼や多くの人々にとって少し謎でした。しかしInception Labsの人々は言語モデルのためにこれを機能させることができました。これは非常に興味深く、このアプローチは、トークンの生成方法だけでなく、独自の心理とその強みと弱みを持つ異なるタイプの言語モデルをもたらす可能性があります。

これらの新しいモデルで生成できたコードの例をいくつか紹介しますが、その前に同じカテゴリの他のモデルとどのように比較されるか見てみましょう。速度は非常に速く、それに近いものはありませんが、さまざまなベンチマークのパフォーマンスも一部のフロンティアモデルと非常に似ています。彼らはMercury Coder MiniとMercury Coder Smallという2つのバリエーションを比較しています。そしてそれらをGemini 2.0 Flashlight、Claude 3.5、GPT-4o mini、また数種類のオープンウェイトモデル(Qwen 2.0、Qwen 2.5 Coder、DeepSeek Coder V2 Light)と比較しています。

全体的に結果を見ると、これらは表の他のモデルと非常に比較可能です。現在彼らは2つのコーディングモデルのみをリリースしていますが、これらは拡散ベースのモデルなので、間違いなく動画や画像生成とともにテキスト生成を可能にするマルチモーダルバージョンが登場するでしょう。推論能力もサポートする可能性があるので、思考の連鎖と非常に似ていますが、一度に1つのトークンを生成するのではなく、並列で解決策を生成します。また、エージェンティックワークフローでも機能する可能性があると考えられています。

モデルはchat.inceptionlabs.aiでテストできます。リンクは動画の説明欄にあります。これがランディングページです。Mercury Coder、おそらくこれが大きなモデルです。「私たちの最初の商用グレードの拡散LLMを試してみてください」とあります。最良の効果を得るには、「拡散効果を有効にする」を確認してください。このモデルを無料で使用するにはサインアップが必要です。これらは人々が試しているプロンプトのようです。

最初の「5つのボールが跳ね返るシミュレーターを書いて」を試してみましょう。これが実際に並列で実行されているトークン生成プロセスで、ここに跳ね回っている5つの異なるボールがあります。なかなか良いですね。

しかし、モデルの性能を確認するために自分のテストを実行してみましょう。新しいチャットを開きます。私のプロンプトはこれです。「単一のウェブページを作成したいです。コードはHTMLであるべきで、「クリックしてください」というボタンがあり、ジョークのリストからランダムに選択し、背景色を変更し、ボタンがクリックされたときにアニメーションも追加します。」

これは比較的単純なタスクのように見えますが、mistralを含む最初のオープンウェイトモデルはこれを行うことができませんでした。実行して何が起こるか見てみましょう。

これは初めて見ることですが、「高負荷を経験しています」と表示され、今コードの生成が始まりました。最初に気づくのは、同じジョークがあることです。新しいものを思いつくことを期待していました。コードを生成し、HTMLファイルで何かを生成するように頼むと、実際にプレビューも表示されます。これはなかなか良いですね。

これをクリックすると、背景色が変わり、アニメーションも表示されますが、画面上にジョークが表示されていないのが不思議です。ただ、ここにジョークが見えます。「ジョークが表示されていません」と伝えて、どうなるか見てみましょう。

コードを生成している間でもプレビューが表示されるのが興味深いですね。これでジョークの問題は修正できましたが、色は今2つだけです。そのため、クリックするとそのうちの1つを選択するのが見えます。実際、コードではこの2つの色があります。5つの異なる色を使用していると考えているようですが、2番目の色が4回繰り返されています。全体的には、これがモデルの最初の反復であることを考えると悪くないと思います。

コーディングモデルをテストするときに使用するのが好きな別のプロンプトがあります。「JavaScriptを使用して、リアリスティックな物理特性を持つ落下する文字のアニメーションを作成してください。文字は画面の上部にランダムに表示され、地球の重力の下で落下し、実際の文字の形状とサイズに基づく衝突検出を持ち、他の文字、地面、画面の境界と相互作用し、水に似た密度特性を持ち、画面サイズの変更に動的に適応し、暗い背景に表示されるべきです。」

これを送信しましょう。コードの生成方法が本当に気に入っています。これはかなり素晴らしいです。基本的にコードを生成しながら解決策を反復しているのが見えます。

ここに出力があります。衝突はうまく機能しているようで、上部でランダムに文字を生成しています。画面に合わせて調整できるか見てみましょう。それも機能しているようです。これはなかなか素晴らしいです。これほど良いとは予想していませんでしたが、私たちが持っていた要件のほとんどに従っているようです。

現在、レート制限があるようで、1時間に10リクエストしか送信できません。それはあまり良くありませんが、十分なリソースを持っていない新しい会社にとっては、現在彼らが持っている容量でサポートできることかもしれません。

個人的には、まったく新しいアーキテクチャを見るのは本当にワクワクします。これは特定の領域でのイノベーションを本当に押し進めるでしょう。例えば、Liquid AIには独自のモデルファミリーがあり、LFMまたはLiquid Foundation Modelsと呼んでいます。これはトランスフォーマーベースのアーキテクチャと比べて少し異なるアーキテクチャですが、これらのモデルの実世界でのテストはそれほど印象的ではありませんでした。

Inception LabsのMercuryモデルも同様です。これらのモデルをまだ十分にテストしていないので、特に非常に高速な推論速度に興味がある場合は、チェックすることを強くお勧めします。彼らはすぐにAPIアクセスをリリースする予定です。コメント欄でこの新しいモデルとの経験を教えてください。

この動画が役立ったことを願っています。視聴いただきありがとうございます。いつものように、次回の動画でお会いしましょう。

コメント