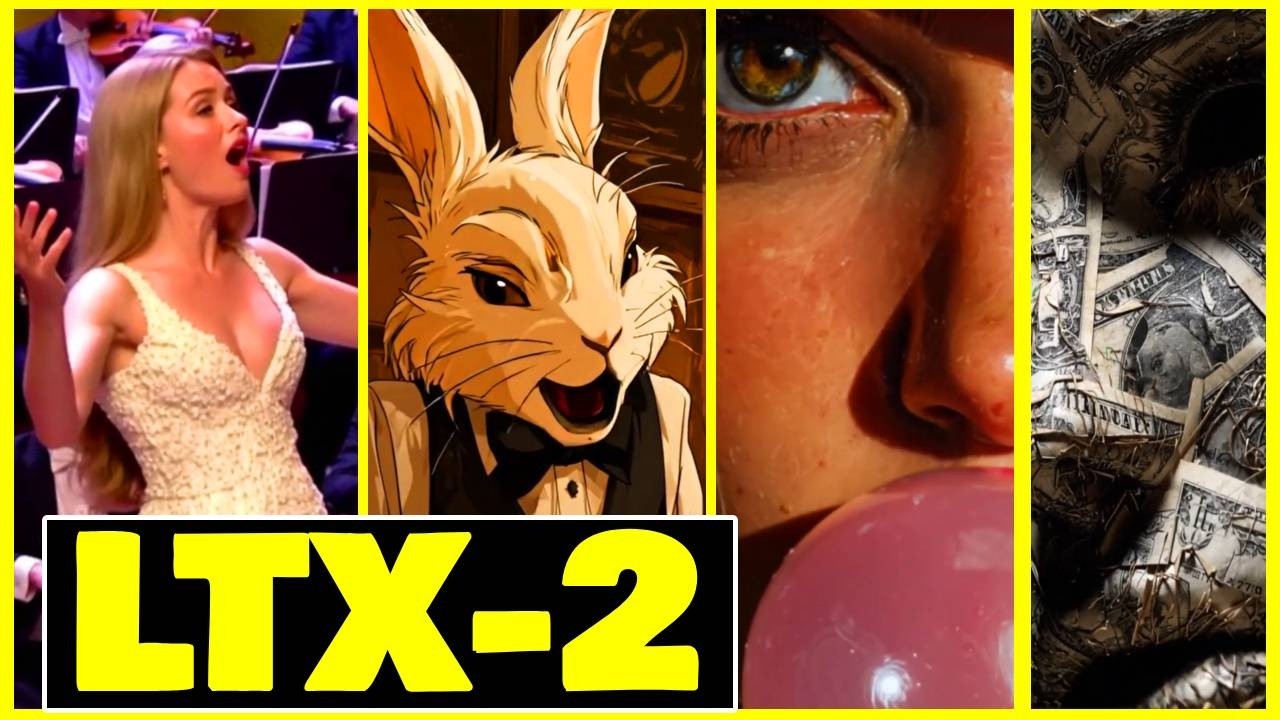

AI動画生成の分野において画期的なリリースが登場した。Lightricksが発表したLTX2は、単なるデモやラッパーではなく、完全なオープンウェイトと訓練コードを含む真のオープンソース動画ファウンデーションモデルである。NVIDIA RTX GPUに最適化されており、消費者向けハードウェアでの高品質なローカル動画生成を実現する。最大4K解像度に対応し、音声生成機能もネイティブに搭載している。完全版と蒸留版の両方のモデルウェイト、訓練フレームワーク、ベンチマーク、そしてLoRAまで公開されており、開発者やスタジオが独自のワークフローに適応できる。テキストから動画、画像から動画、動画から動画、さらには音声条件付き生成まで、フルマルチモーダルパイプラインをサポートする革新的なシステムである。

LTX2の革命的なリリース

これはAI動画の分野で今年、そして昨年を通じても最も重要なリリースかもしれません。ラッパーではありません。制限付きデモでもありません。完全なオープンウェイトと、何より重要な完全な訓練コードとともにリリースされた、フル機能のオーディオビデオ生成モデルなんです。これはLightricksのフラッグシップオープンソースビデオファウンデーションモデルで、実際のワークフローのために構築されています。

これがLTX2です。このリリースで、彼らはモデルファミリー全体を公開しています。完全版と蒸留版のウェイト、訓練フレームワーク全体、ベンチマーク、そしてLoRAです。そしてこれはNVIDIAのRTX GPUに最適化されています。これにより、家庭用コンシューマーハードウェアでの高品質なローカル動画生成が実用的になります。音声もネイティブに組み込まれています。

今グリッチを起こさないでください。グリッチを起こさないでと言ったでしょう。よくもここに戻ってこられましたね。アンダーダークに足を踏み入れるべきではありませんでした。禁断のランプを渇望しています、兄弟よ。準備ができていませんね。彼らは常に借りを返します。私もそうします。

最大4K解像度まで対応でき、完全に無料です。

実際の動作とローカル実行

この動画では、オープンとは実際にどういうことかをお見せします。これをローカルで実行し、完全版と蒸留版モデルの違いを見て、マルチモーダルパイプラインの使い方をお見せしましょう。では始めましょう。

まずスペックをお伝えします。これは通常見るものとは異なるからです。通常、オープンソースとはウェイトがあります、頑張ってくださいという意味です。LTX2は実際のシステムなんです。ローカル推論用のモデルウェイトが手に入りますが、訓練フレームワークとレシピも手に入ります。これは継続的な事前訓練とドメイン適応のためのモジュラーパイプラインです。進むにつれて適応し、進化します。つまり、開発者やスタジオであれば、これを自分のニーズや自分のワークフローに適応させることができるんです。

そして、フルマルチモーダルパイプラインをサポートしています。テキストから動画、画像から動画、動画から動画、さらには音声条件付き生成まであります。このビデオのスポンサーであるLightricksに感謝します。このプロジェクトをできる限りの方法で支援できることに非常に興奮しました。

システム要件とハードウェア構成

ベンチマークを見る前に、完全な透明性を保つため、私が何を使っているのか、どんなハードウェアをセットアップしているのかをお見せしたいと思います。LTX2を実行しています。メインワークステーションでテストしています。GPUはNVIDIA GeForce RTX 4090です。24GBのVRAMを搭載しています。CPUはIntel Core i9、64GBのRAMです。LTX2はNVIDIA RTX GPUに最適化されているので、私のコンピューターにあるこの4090は、このセットアップを簡単に処理します。

24GBのVRAMと64GBのシステムRAMがあるので、完全なモデルウェイトを問題なく直接メモリにロードできます。しかし、このリリースのクールな部分があります。私は4090でこれを実行していますが、Lightricksはモデルの蒸留版と量子化版をリリースしました。これは具体的にメモリ要件を削減するためです。

ですから、これをローカルで実行するために私と全く同じセットアップは必要ありませんが、ハードウェアがあれば、パフォーマンスは驚異的です。

ComfyUIでのセットアップと実行

さて、話はもう十分です。あなたのマシンでこれを動かしましょう。LTX2はComfyUIに直接統合されており、起動時にリファレンスワークフローが利用可能です。ウェイトを直接ダウンロードできます。説明欄にリポジトリをリンクしておきました。モデルバリアントに関していくつかのオプションがあります。完全版と蒸留版の両方のモデルウェイトが提供されています。完全版モデルは最高品質とファインチューニングに最適ですが、蒸留版または量子化版を使用するオプションもあります。

これらは、標準的なワークステーションでローカル実行する場合のメモリと計算要求を削減するように設計されています。これらの蒸留版により、ローカル動画生成が高速で実用的になります。私は今GPUでこれをローカルで実行していますが、反復速度は非常に実用的です。非常に速いペースでこの動画を生成します。

ComfyUIを以前使ったことがない方は、基本的にはコンピューターでローカルにAIを実行するための定番ツールです。これを見て、なぜこれがスパゲッティの皿のように見えるのか疑問に思っているかもしれませんね。素晴らしい質問です。ComfyUIはノードベースのグラフィカルインターフェースで、生成モデルをローカルで実行できます。

プロンプトを入力してゴーをクリックするだけのシンプルなウェブサイトとは異なり、ComfyUIはパイプライン全体を視覚化します。モデルローダーからテキストエンコーダー、サンプラーを経て最終的に動画デコーダーまで、データがどのように流れるかを正確に見ることができます。

ComfyUIでのLTX2の使用方法

ComfyUIでLTX2を使いたい場合、まず最初に、ComfyUIがインストールされていることを確認してください。インストールされていない場合は、コンピューターへのインストール方法の完全なウォークスルーを含む動画があります。その動画を下にリンクしておきます。インストールされていなければインストールしてください。無料です。オープンソースです。

既にインストールされている場合は、最新バージョンであることを確認してください。必要に応じて更新してください。それが設定できたら、始めましょう。

さて、ComfyUIが起動して実行されています。LTX2のテキストから動画テンプレートを開いています。テンプレートに移動して、LTX2を検索しましょう。このフォルダー、テンプレートフォルダーを開くと、2つの異なるパスが表示されます。通常版、これが完全版モデルで、蒸留版があります。

違いを理解することが重要です。そうしないと、レンダリングに何時間も無駄にしたり、PCをクラッシュさせたりする可能性があります。これが本当にLTX2の生のパワーなんです。このワークフローでは、ファウンデーションモデルウェイト、完全なウェイトをロードしています。これは最大限のコントロールと最高品質を持つ完全なワークフローです。いつこれを使いたいのか。これは絶対的に最高の忠実度が必要で、生成のために少し長く待つ意思があり、それを実行するために必要なVRAMとRAMを持っている場合です。

そして蒸留版ワークフローがあります。これは速度と効率のためのものです。速く生成したいだけなら、これを使用してください。またはマシンが完全版モデルを処理できない場合は、蒸留版を使用してください。つまり、蒸留版チェックポイントには、最適化が既に組み込まれているということです。

RTX 4090で実行しているので、これを楽々使用できます。しかし、テストの大部分、テストの90%では、蒸留版テンプレート、蒸留版ワークフローに固執します。これで素早く反復でき、さまざまなことを試し、異なるプロンプトをテストでき、そのプロンプトが確定したら、LTX完全版モードに切り替えます。

完全版と蒸留版の比較

ここではLTX2蒸留版のテキストから動画を使用しています。「黒いタキシードを着た男性が赤いタイル張りのバスルームに立っている」と言いましょう。彼は「違いに気づいてください」と言います。カメラは彼の顔に劇的にズームインしています。赤いタイルは非常に反射的で、いくつかの軽い傷や不完全さがあります。これがそのクリップです。赤いバスルームの男性蒸留版。

違いに気づいてください。

そして、これが全く同じプロンプトです。テキストから動画LTX2.0で実行しています。これが完全版です。これがどのように見えるかです。

違いに気づいてください。

かかる時間の目安をお伝えすると、蒸留版は53秒かかり、完全版は2分27秒かかりました。ですから、品質とかかる時間のトレードオフについて理解していただけたと思います。そして、完全なモデルを実行するための強力なマシンがない場合でも、見ての通り、蒸留版もそれほど悪くありません。決してそんなことはありません。

ちなみに、ここではフレーム数121、1280×720の解像度を使用しています。つまり、24フレーム毎秒で、5秒のクリップが得られます。

ComfyUIインターフェースの解説

本当に速く、UIを少しウォークスルーさせてください。初めて使用する場合は少し大変かもしれないので。常に新しいタブをここに追加できることを覚えておいてください。そしてテンプレートをクリックして、必要なテンプレートを追加します。

複数のタブに異なるテンプレートを同時に実行させることができます。切り替えることができます。例えば、ここに素早いテスト用の蒸留版を実行させることができます。このウィンドウでは実際の完全版を実行できます。最初のもので反復し、2番目で準備完了の映像を作成します。

ここにいくつかのオプションがあります。それについては少し後で話します。デフォルトではすべてが折りたたまれています。ここにこのボタンがあり、全体を展開します。それについても少し後で話しますが、それをクリックする必要すらありません。入る必要はありません。それはかなり複雑になるからです。

ですから、使用初日であれば、最初からすべてを理解する必要はないことを知っておいてください。しかし、慣れ始めたら、ぜひそれを開いて中を見てみてください。

プロンプトはここに入ります。プロンプトボックスに必要なものを入力し、幅、高さ、フレーム数121のオプションがあります。フレーム数×24フレーム毎秒、実行されている速度です。つまり、5秒の出力を意味します。5秒の長さです。

解像度を変更する必要がある場合、ここに役立つヒントが表示されます。強力なGPUがあれば1920×1088を試すことができます。フレーム、数字は特定の形式に従う必要があることに注意してください。しかし、これらすべてがここに入ったら、実行をクリックします。

実行をクリックすると、すべてが正しく設定されていれば、これが緑色に点灯します。実際、ジョブ履歴に行くと、何が起こっているか見ることができます。これが実行中の現在のジョブです。また、アセットフォルダーがあります。それをクリックすると、一番左側に表示され、生成したものがすべて表示されます。

さて、ここのこれを簡単にクリックしましょう。これはサブグラフを表示します。これを閉じましょう。これを閉じましょう。これがワークフロー全体の様子です。左から始まります。すべての入力です。幅、高さ、フレーム数、ノイズ、シード、テキスト、チェックポイント名があります。幅と高さ。ビデオ設定に入ることに注意してください。

フレーム数は長さに入ります。次にシード、テキスト、チェックポイント名がすべてモデルまたはプロンプトに入ります。ここにカメラLoRAもあります。Ctrl+Bで有効化します。これらはカスタムLoRAのようなものです。後で話しますが、これがある場所です。Ctrl+Bをクリックしてこのノードを有効にできます。

サンプラーステージ1、サンプラーステージ2があり、アップスケールサンプリングもあることに注意してください。これがどのように動画を生成するかというと、実際には半分の解像度で動画を作成し、それをアップスケールします。2倍にアップスケールします。なぜこのようにレイアウトされているのか疑問に思っていた場合のためにお伝えしました。

これでより高度になると、これらの設定の多くを変更および追加できます。これの多くは動かすことができます。好きなように配置できます。非常に良いビジュアルインターフェースです。好きなだけ高度にすることができます。

しかし、通常のビューに戻ります。これが与えたプロンプトの出力です。ですから、ここを見ると、このプロンプトの生成に2分43秒かかったことがわかります。

ここでは基本的に、雨の中で歌っている陽気な女の子の人形を作っています。

2ステージ生成プロセス

さて、これを実行する前に、LTX2がどのように動画を構築するかを実際に理解する必要があります。全体の高解像度ファイルを一度にレンダリングするだけではありません。ワークフローは2つの異なるステージで実行されます。

まず、低解像度のベース動画を生成します。次に、そのデータをアップスケーラーに渡します。ここからデータを第2ステージ、つまり空間アップスケーラーに渡し、細部を洗練させ、その第2パスで完全な解像度まで拡大します。

パラメータを設定しましょう。解像度を1280×720に設定します。フレーム数は通常121に設定します。24フレーム毎秒で、5秒のクリップになります。次のステージはプロンプトです。LTX2はネイティブにマルチモーダルで、自然言語に応答します。ですから、あまりクレイジーや技術的になる必要はありません。タグはありません。欲しいものを説明するだけです。

シーン、照明、キャラクター、そしてキャラクターに特定の対話をさせたい場合は対話を説明できます。終わったら、実行をクリックするだけです。初期生成を実行し、第2パスのためにアップスケーラーに渡されるのが見えます。そして最終結果が提供されます。

生成できたデモクリップをいくつかお見せします。ご覧ください。

LoRAの活用方法

さて、次はLoRAについて話しましょう。LoRAまたはLow Rank Adaptationsは、基本的に大きなモデル、実際のモデルの上に載る軽量モジュラーファインチューンです。モデルに特定のスキル、特定の習熟を持たせたい場合、巨大なモデル全体をゼロから再訓練する代わりに、これらの小さなアダプターを接続し、モデルに特定の概念や特定のスキルを学習させます。

これはキャラクターや特定のスタイル、または特定のタイプのカメラ動きである可能性があります。このリリースで、LightricksはLTX2用の多数の付属LoRAとIcy LoRAを提供しました。これらはスタイル、構造、モーション、カメラの動作を制御するために特別に設計されています。

例えば、ここにドリー動きのいくつかがあります。ドリーアウト、ドリーレフト、ドリーライト。その1つをクリックすると、ファイルに移動してファイルをダウンロードできます。safe tensorで終わります。ですから、これを見つけてダウンロードをクリックするだけです。

その後、ComfyUIフォルダーを見つけ、models/LoRAsに移動し、そのファイルをここに追加するだけです。既にドリーレフトIC LoRAを持っているので、それを使用します。新しいものを追加した場合、ComfyUIが認識しているかどうかを確認するには、モデルに移動し、LoRAsフォルダーをクリックすると、LoRAがここに表示されます。何か他のものを追加した場合は更新をクリックでき、更新されてここに追加されます。

これを閉じると、カメラLoRAはここにあります。デフォルトでは、バイパスされます。Ctrl+Bで有効にするか、Ctrl+Bが機能しない場合があるので両方を選択できます。右クリックしてバイパスをクリックすると、これらが有効になります。次に、ここでLoRAを選択できます。カメラコントロールドリーレフトを使用しています。

同じことがここにも当てはまります。カメラコントロールドリーレフト。ここで理解することが重要なのは、これが2つのステージ、2つのパス、初期ステージとアップスケーリングステージであるため、これがこれらのLoRAを使用したLTX2ワークフローの最も重要な部分だということです。両方に適用する必要があります。最初のパスにのみ適用すると、アップスケーラーは意図したカメラスタイルやカメラ動きなどとは何の関係もないものを幻覚する可能性があります。

ノードが接続されたら、プロンプト内でそのLoRAをトリガーするだけです。プロンプトに戻ると、トリガーされることを確認するために、プロンプトのどこかに明示的にドリーレフトショットと言います。ライオンから逃げる男性のドリーレフトショット、「ああダメだ」と言っています。ああダメだ。

ああダメだ。実行をクリックします。より高い解像度と時間の2倍でも試してみます。ちなみに、ここの完全ビューに戻ると、LoRAローダーで実際にエフェクトの強度を変更できます。

強度を下げると、ベースモデルにより多くの創造的自由を与え、例えば1.0に上げると、そのLoRAに厳密に従うように強制します。ですから、提供したものに厳密に従わせたい場合は1のように高くします。もう少し創造的自由を与えたい場合は0.8にするか、必要に応じてさらに低い強度をテストすることもできます。

これらのLoRAにはそれぞれ、これらをより良く機能させるための推奨プロンプティングとガイドラインがあります。例えば、ドリーレフトLoRAの場合、モーションキャプチャの最良の結果を得るための推奨プロンプティングがあります。LoRAは動きの目的地とシーンの隠れた部分を説明し、フレームがシフトするにつれて何を明らかにするかをモデルが知るようにします。

例えば、部屋の左端、フレームの左側に配置されたオブジェクトや人物、視差によって見えるようになる背景構造。これにより、カメラが左にスライドするにつれて何が存在するかのビジュアルマップがモデルに与えられます。その特定のLoRAを使用したサンプルショットをいくつかお見せします。

ああダメだ。

画像から動画への変換

次に、おそらく私のお気に入りの1つである画像から動画を見てみましょう。新しいタブを開き、テンプレート、LTX2を検索し、この画像から動画を実行します。

これは以前使用したテキストから動画と非常に似ていますが、1つ違いがあります。この画像の読み込みがあります。ファイルをアップロードします。プロンプトを追加すれば準備完了です。

画像を開始フレームとして考えてください。画像を提供していますが、開始フレームです。それをどのようにアニメーション化するかをモデルに伝えるためにプロンプトを提供する必要があります。

例えば、話しているキャラクターや動いているカメラを説明します。モデルは画像を構造的なアンカーとして、テキストをモーション ガイドとして使用します。設定では、1280×720とフレーム数121に固執します。これも5秒の出力を提供します。

ポップクイズ、ホットショット。この絵画は何と呼ばれ、誰によるものですか。ここにアップロードします。

これは描かれてからしばらく経っているのでパブリックドメインにあり、著作権の問題なく使用できます。説明には、「男性はカメラに向かって歩きながら悲しみの叫び声をあげる」と言います。いくつかの別のバリエーションを作ったので、それらをテストしてどれが良いか見てみます。これでは、「なぜ誰も私を描いたのが誰か知らないのか」と言って首を振ります。

私はいつもゴッホの絵画だと思っていました。私が尋ねた何人かの人はサルバドール・ダリだと思っていました。しかし、違います。これは「叫び」と呼ばれ、ノルウェーの芸術家エドヴァルド・ムンクによって作成されたアート作品です。私は今日歳になってそれを知りました。

どのように仕上がったか見てみましょう。

まとめ:LTX2の重要性

まとめとして、このリリースがなぜ重要なのかを強調したいと思います。行き止まりになるだけの多くのオープンモデルを見かけます。意図された方法では実際にはオープンソースではありません。LTX2は異なります。Lightricksが訓練コード、ベンチマーク、完全なウェイトをリリースしたからです。使用するだけのツールではありません。

新しいパイプラインを構築している開発者であろうと、IPをプライベートにローカルネットワーク上に保つ必要があるスタジオであろうと、LoRAをいじりたいだけのクリエイターであろうと、これはあなたが適応させるためのものです。

しかし、私の言葉だけを信じないでください。オープンソースの最良の部分は、自分で検証できることです。GitHubリポジトリとモデルウェイトへのリンクを説明の一番上に置きました。リポジトリをクローンし、蒸留版ウェイトまたは必要に応じてモデル全体をダウンロードして、自分のGPUで実行してください。

あなたがこれで何を作るか見たいです。X/Twitterで私をタグ付けしてください。私はWesrothです。このビデオをスポンサーしてくれたLightricksに大感謝します。そして正直なところ、ラッパーではなく実際にオープンなモデルをリリースしてくれたことに感謝します。このガイドが役に立ったら、いいねボタンを押して、より多くのローカルAIチュートリアルのためにチャンネル登録してください。次の動画でお会いしましょう。

コメント