本動画は、2026年のAI業界における最重要概念の一つとなる「継続学習」について、その本質と課題を5つのレベルに分けて解説している。現在の大規模言語モデルが抱える根本的な問題として、学習後にモデルが凍結され、過去の会話や経験から学習できない点が挙げられる。継続学習は、新しい知識を獲得しながら既存の知識を保持する能力であるが、ニューラルネットワークには「破滅的忘却」という致命的な問題が存在する。動画では、セッション記憶から失敗からの学習まで5段階のレベルを定義し、それぞれの実現可能性を検証。さらに、継続学習の実現に向けた二つの陣営—アーキテクチャの根本的変革を主張する懐疑派と、既存システムの工夫で解決可能とする実用主義派—の対立を紹介している。Anthropicが導入したClaudeスキルなどの実用的なアプローチが、完全な継続学習の実現前に「学習しているように見える」システムを可能にするとし、経済的インパクトと実現可能性の観点から今後の展望を示している。

継続学習とは何か

2026年には「継続学習」という言葉を頻繁に耳にすることになるでしょう。そこで今回は、この概念を詳しく解説していきます。継続学習にはさまざまなレベルがあり、それが単なる流行語なのか、それとも本質的に重要なものなのかについてお話しします。

継続学習が重要である理由を理解するには、まずそれが解決しようとしている問題を理解する必要があります。現在のLLM、つまりChatGPTやClaude、Geminiなどに話しかけてみると、これらはすべて学習後に凍結されていることがわかります。学習が完了すると、それで終わり。モデルはその場所に固定されてしまうのです。

実際には、これはモデルの知識が事前学習段階で学習した内容に限定されることを意味します。つまり、会話が特定のモデルの文脈窓を超えると、あなたがモデルと話し合ったすべての内容は消えてしまいます。モデルはそれを保持できません。これは、これらのモデルが経験から学習できないことを意味します。

すべてのセッションは、まるで以前に話したことがないかのように、完全にゼロから始まります。この制限こそが、継続学習という分野が解決しようとしていることなのです。

継続学習の定義と人間との比較

問題を理解したところで、継続学習が実際に何を意味するのかを定義しましょう。その核心は、既に知っていることを忘れることなく、時間をかけて新しいことを学び続ける能力です。

人間にとっては非常に簡単です。例えばギターを学び、しばらくしてからバイオリンを始めたとしましょう。練習すればバイオリンが本当に上手になるかもしれませんが、ギターの知識は依然として残っています。少し鈍っているかもしれませんが、知識はそこにあるのです。

しかし、ニューラルネットワークはそのようには機能しません。チェックポイント後にニューラルネットワークに新しいことを学習させると、以前に学習したことを文字通り上書きしてしまいます。

この概念は「破滅的忘却」と呼ばれ、ニューラルネットワークの学習における実際の問題です。困ったことに、人々が継続学習について話すとき、彼らはしばしばまったく異なることを話しています。AGIという用語と同じように、異なる難易度レベルの問題を説明するために同じ言葉を使っているのです。

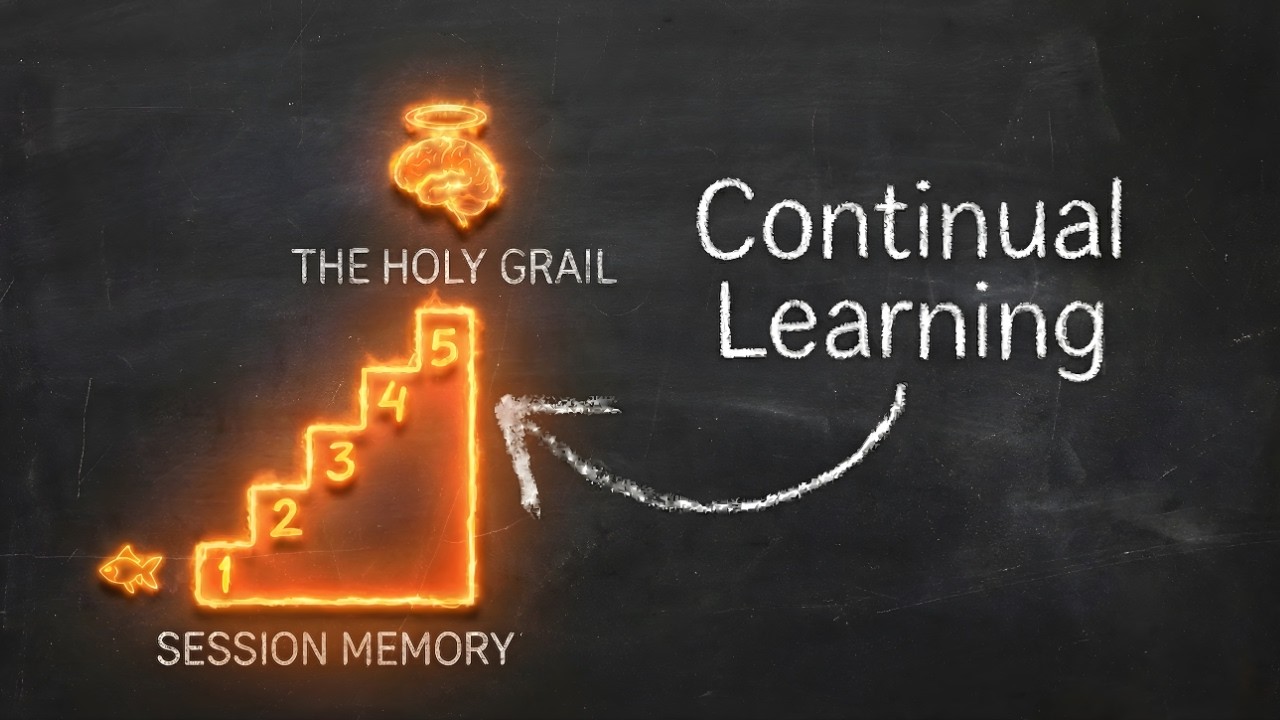

継続学習の5つのレベル

まず、継続学習の5つのレベルというフレームワークを提示します。これらは最も簡単なものから最も難しいものまで段階分けされています。

レベル1はセッション記憶です。モデルが会話の初期に何が起こったかを覚えています。これは基本的に解決済みです。それが文脈窓の役割です。より長い文脈窓が必要である以外、ここで革新は必要ありません。

レベル2はクロスセッション記憶です。モデルが以前の会話からの内容を覚えています。外部記憶システムや検索拡張生成によって、ここではある程度の進歩を遂げていますが、完璧ではありません。検索は時々情報を見逃します。通常、最も重要な文脈を見逃す可能性があります。

レベル3は、私がタスク適応と呼ぶものです。モデルが時間とともに特定のタスクで向上します。この一例がファインチューニングで、これは機能しますが、厄介な副作用もあります。つまり、あまりにもファインチューニングしすぎると、モデルは一般的な能力を失ってしまうのです。

そしてレベル4は、私が真の継続学習と呼ぶものです。ここでは、忘却や劣化なしにリアルタイムでモデルの重みを更新します。これは研究者たちが2026年を継続学習の年と言うときに意味することです。

そしてレベル5があります。これは失敗からの学習です。私はこれを聖杯と呼びます。モデルは単に記憶するだけでなく、実際に犯した間違いから改善するのです。

これは失敗をデータとして使用することになります。そして、これこそが継続学習という用語を聞いたときに、ほとんどの人が実際に望んでいることだと思います。

継続学習の実践的ビジョン

これら5つのレベルが実際にはどのように見えるかを描いてみましょう。なぜなら、このビジョンこそが継続学習をエキサイティングなものにしていると思うからです。

例えば、あなたがClaudeやGemini、ChatGPTでコーディングしていて、モデルが間違いを犯したとします。そのプロセスであなたがそれを訂正し、正確に何が間違っていたかを伝えます。

次回、同じような状況に遭遇したときに、モデルが実際に覚えていて、同じ間違いを二度と繰り返さないと想像してください。そして時間とともに、モデルはあなたのコードベースや特定のタスクに特化して調整されるようになります。

モデルが自分の間違いから学習できるかという問いは、継続学習という分野全体の核心にあります。

現在の状態では、LLMはまだこれを行うことができません。それを回避する方法はあります。これらについては後ほど動画で見ていきます。しかし、まずこの破滅的忘却という概念を見てみましょう。これは基本的に、なぜニューラルネットワークに記憶させることができないのかという問題です。

破滅的忘却の仕組み

例を挙げましょう。タスクAでニューラルネットワークを学習させ、一定の精度レベルに達したとします。しかし、その後、同じニューラルネットワークを完全に異なるタスクでさらに学習させたいとします。

タスクBでは、さらなる調整によっておそらく改善するでしょう。しかし、タスクAで再度テストすると、パフォーマンスは通常大幅に低下します。その理由は、まったく新しいタスクで学習させようとすると、ニューラルネットワークの重みが書き換えられる、または上書きされるからです。

これは基本的に破滅的です。新しい学習が古い知識を上書きするのは、ネットワークがすべてを同じ共有重みに保存しているからです。

これは研究者が「安定性と可塑性のトレードオフ」と呼ぶものにつながります。安定性とは、学習したことを保持する能力です。可塑性とは、新しいことを学習する能力です。両方が必要ですが、それらは互いに対立します。記憶を助けるメカニズムは変化にも抵抗し、学習を助けるメカニズムは忘却も助けてしまうのです。

ダイヤルのようなものだと考えてください。安定性の方に完全に回すと、モデルは新しいタスクを学習できません。その場所に凍結されてしまいます。逆に可塑性の方に完全に回すと、モデルは新しいタスクごとにすべてを忘れてしまいます。中間のどこかに設定する必要があります。

しかし問題は、なぜこのトレードオフが存在するのか完全には理解していないということです。回避策はありますが、まだ解決策はありません。

継続学習をめぐる二つの陣営

これはAIコミュニティにおける議論につながります。実際に継続学習を解決する必要があるのか、それとも工学的に回避できるのか。問題が解決可能かどうかについて、基本的に二つの対立する見解があります。

陣営1は懐疑派です。この陣営で最も明確な主張をしているのがDwarkesh Patelです。Dwarkeshを知らない方のために説明すると、彼は最高のAIポッドキャストの一つを運営しています。彼はすべてのトップ研究者にインタビューしています。Ilya SutskeverやDemis Hassabisのような、実際にこれらを構築している人々にインタビューしているのです。

彼の最近のブログ投稿からの直接の引用を紹介します。「LLMは仕事中に学習することができない。継続学習を可能にするには、何か新しいアーキテクチャが必要になるだろう。」

彼の主張は、今日存在するLLMは、人間が行うように時間とともに根本的に改善することができないというものです。これは小さな制限ではありません。巨大なボトルネックです。AGIという用語に同意するなら、これはAGIを阻んでいる主な要因の一つです。

しかし、より重要なのは、ここでの核心的な議論は、スケーリングではこれを解決できないということです。モデルを大きくしたり、より多くのデータで学習させたりするだけではダメなのです。トランスフォーマーアーキテクチャそのものに、この制限が組み込まれています。根本的に異なる何かが必要なのです。

一方で、実用主義者がいます。良い例がNathan Lambertで、彼は以前Hugging Faceにいたと思いますが、現在はオープンソース分野でAIラボを運営しています。

彼の見解は、継続学習は究極的には学術的な難問であるというものです。必要なのはシステムのスケーリングを続けることだけで、そうすれば人間がやることと区別がつかないものを無料で手に入れることができる、と。

彼の主張は根本的に異なります。継続学習をアルゴリズム的に解決する必要はないかもしれない、と言っているのです。単に工学的に回避すればいいだけかもしれません。

例えば、文脈窓をスケールアップし、より良い記憶システムを構築し、検索を改善する。これらを組み合わせれば、実用的な目的において、学習とまったく同じように感じられるものが得られます。

彼の見解は、これはアルゴリズムの問題ではなく、システムの問題だということです。そして、私たちはすでにほとんどそこまで来ています。

両陣営の見解を統合する

さて、誰が正しいのでしょうか。私の意見では、おそらく両方とも部分的に正しく、異なる質問に答えていると言えます。私はこう考えます。

純粋なAGIビジョン、つまりマーケティング用語を超えた何か、人間のように真に学習するAIについて考えるなら、懐疑派はおそらく正しいです。新しい何かが必要です。

しかし、実用的なアプリケーション、例えばあなたの好みを覚えているコーディングアシスタントを作るためには、実用主義的なアプローチはすでに機能しています。私たちが持っているモデルの周りにより良いシステムを基本的に作る必要があるのです。

問題は、どのバージョンの継続学習について話しているかということです。

現在機能している回避策

では、これらの回避策について話しましょう。今日、実際に何が機能しているのでしょうか。

最近、Anthropicは「Claudeスキル」というものを導入しました。当初、人々はこれがMCPのようなものの代替だと考えていました。MCPつまりモデルコンテキストプロトコルの問題は、モデルが質問内容を知る前に、すべてを前もって文脈に投げ込むことです。

一方、スキルはまったく異なるアプローチです。それは段階的な開示です。つまり、実際に必要なときに情報を明らかにするのです。

仕組みはこうです。エージェント、例えばClaudeはスキル名の説明のみを見ます。利用可能なものを知るのに十分な最小限のトークンを使用します。スキルと一致する何かを尋ねると、その時初めて完全な指示セットを読み込みます。

そして、サポートファイルは、スキルがそれらを必要とするときにのみ読み込まれます。これは、文脈がスリムに保たれ、実際に関連性があるときに情報を公開することを意味します。

これは人間がどのように学習するかを模倣しようとしています。つまり、すべての知識を前もって読み込む必要はありません。最も関連性の高い情報の断片を探すだけです。

例えば夕食を料理しているときに電気工学について考えることはありません。その知識は必要なときに活性化されます。スキルはClaudeに似たようなものを与えます。これは真の学習ではありませんが、学習のように感じられる適応的な文脈です。

自己改善スキルの仕組み

しかし、ここから興味深くなります。このシステムを時間とともに実際に改善させることができたらどうでしょうか。Claudeが間違いを犯すたびにあなたが訂正すると、その訂正は信号です。それには、あなたが何を望んでいるか、どのように作業するか、どのパターンがあなたにとって重要かについての情報が含まれています。

自己改善スキルがどのように機能するかは次の通りです。二つの異なるオプションがあります。一つは手動モードで、スキルにセッションを分析させ、訂正を抽出して自己更新させたいときに、/reflectコマンドを実行します。

もう一つは自動モードです。すべてのセッション後にトリガーされるストップフックを設定します。スキルは何もしなくても、起こったことから自動的に学習します。

ワークフローはシンプルです。スキルはあなたのセッションを分析します。あなたが行った訂正を抽出し、自己更新します。次回は記憶しており、同じ間違いを二度と繰り返しません。

それが自己改善スキルの回避策です。良い点は、非常にシンプルなアプローチであることです。スキルは単なるマークダウンファイルで、段階的に探索します。これが実用主義的な議論です。私たちは継続学習をアルゴリズム的に解決しているのではありません。現在機能する何かを工学的に構築しているのです。

経済的インパクト

さて、私たちがまだ本当に話していないことの一つは、ここでの経済的な利害が非常に大きいということです。例えば、GPT-5やClaude 4、Geminiのようなフロンティアモデルを再学習するには数百万ドルのコストがかかります。DeepSeekならもっと安いかもしれません。それはまったく別の話ですが。そのため、毎回、計算要件は驚異的なものになります。

継続学習が機能すれば、完全な再学習なしにモデルの重みを段階的に更新できれば、そのコストは潜在的にゼロになります。これが何を意味するか考えてみてください。

これが機能すれば、計算は学習から推論にシフトします。モデルを作成するための初期投資は劇的に減少します。静的なスナップショットを作成するために数百万ドルを支払う必要はもうありません。

基本的に、継続的な小さな更新で推論を実行するだけです。これはAIの経済全体を変える可能性もあります。これにより、小規模プレイヤーが実際に競争できるようになるでしょう。

今後の展望

さて、私の考えはこうです。アルゴリズム的に実際に解決する前に、十分に良い継続学習へと工学的に道を切り開くことになると思います。

実用主義的なアプローチが実用的なアプリケーションでは勝利するでしょう。それがより優雅だからではなく、実際にはハックなのですが、今日機能し、急速に改善しているからです。特にモデルは本当に優れたものになっており、その周りにより良いハーネスを作ることができています。

スキルのような段階的開示のアプローチでは、一般的にシステムが学習しているように感じられるものがあります。

モデルがリアルタイムで理解を更新することによって、人間とまったく同じように学習するという純粋なビジョン。これはまだ何年も先のことだと思いますし、おそらく完全に新しいアーキテクチャが必要になるでしょう。おそらく、私たちが思っていたよりも難しい問題なのでしょう。

しかし、ほとんどの実用的な作業、あなたの好みを覚えて特定のタスクで向上するツールについては、ほとんどの人が認識しているよりもはるかに近いところにいると思います。

あなたがどう思うか教えてください。この動画が役に立ったことを願っています。ご視聴ありがとうございました。いつものように、次回お会いしましょう。

コメント