本動画は、Kimiチームが提案した新手法 Attention Residuals を軸に、現行AIが抱える「長く深く考えるほど初期の情報を見失う」という記憶の問題を解説する内容である。従来のTransformerや残差接続の限界を整理しつつ、なぜAIが推論の途中で“記憶喪失”のような状態に陥るのかを丁寧にひも解いている。そしてAttention機構をモデルの深さ方向にも適用することで、AIが過去の重要な中間表現を選択的に参照できるようになり、推論性能、学習効率、モデル設計の自由度が大きく向上する可能性を示している。最終的には、この仕組みが単なる性能改善ではなく、AIをより動的で適応的なシステムへと変える一歩かもしれないという視点まで踏み込んでいる。

大きなブレークスルーとAIの記憶喪失問題

これはかなり大きな出来事です。Kimiの開発チームによる最近のブレークスルーは、Kimiがもう一つのDeepSeekのような存在だと考えると分かりやすいのですが、より優れたAIモデルを構築するうえで私たちが抱えていた制約を完全に打ち砕くものです。これは現在のAIが抱える記憶喪失の問題を解消するだけでなく、実際には、自分自身を再構成しながらその場で学んでいけるような新しいアーキテクチャ設計まで生み出したと言えます。

論文に入る前に、まずは問題をもう少し理解しておきましょう。人生で最も難しい数学の試験を受けているところを想像してみてください。ちょっとした小テストではなく、50段階くらいの手順を必要とするような過酷な問題です。最初は順調です。ステップ1、ステップ2、ステップ3と、どんどん進められます。そこまではかなり簡単です。

でもステップ48あたりに来ると、脳が過負荷になります。処理しなければならなかった数字の量があまりに多くて、完全に圧倒されてしまうのです。作業記憶が限界に達してしまいます。巨大で複雑な計算を見つめてはいるのに、自分がそもそも何を解こうとしていたのか、その筋道を完全に見失ってしまう。いわば局所的な記憶喪失のような状態です。

あまりに深く考えすぎて、自分の先ほどまでの考えが自分自身の中でかき消されてしまうわけです。これは人間には非常によくある問題です。私たちの作業記憶には厳しい物理的な限界があります。長く考えすぎたり、深く考えすぎたりすると、ただただ圧倒されてしまうのです。しかも不思議なことに、GPTやGeminiのような、私たちが毎日使っている巨大な1兆パラメータ級のAIモデルも、まったく同じ記憶喪失に苦しんでいることが分かってきました。

ところが今回のブレークスルーは、このAIの記憶喪失に対する治療法を提示しています。論文のタイトルは、Kimiチームによる Attention Residuals です。非常に魅力的な論文なのですが、とにかく技術的です。ですのでこの動画では、その内容を誰にでも分かるように噛み砕いて説明していきます。ではさっそく見ていきましょう。まずは、現在のAIモデルの設計について簡単な背景から始めます。

現代のAIモデルはなぜ深くなると苦しくなるのか

AIがなぜ圧倒されるのかを理解するには、まずこうしたモデルが実際にどう作られているのかを見る必要があります。大規模言語モデルというとき、私たちが指しているのは、100個を超える逐次的なブロックやレイヤーを持つ非常に深いモデルです。そして、それぞれのブロックが非常に複雑な行列計算を大量に実行しています。概念的にはこんなふうに考えられます。

最初のレイヤーは生のテキストを処理します。次のレイヤーは文法パターンを見るかもしれません。その次は意図を理解し始めます。さらに次のレイヤーはテキストをもっと深く分析します。その次はさらに深く。120層目あたりに達するころには、モデルは驚くほど抽象的で深い思考を行っているわけです。ところが何年もの間、こうしたモデルを本当に深く作ることはできませんでした。

モデルを深くしすぎると、訓練が非常に難しくなってしまうからです。AIモデルがどう学習するかを、ごく簡単に説明します。訓練中、AIは自分の出力と正解を比較します。そして間違っていれば、損失、つまりペナルティを受けます。このペナルティがモデルの中を逆向きに流れ、パラメータを調整することで、次回は少しでも間違いが減るようにするのです。

この過程は、誤差逆伝播と勾配降下法と呼ばれます。しかしモデルを深くしすぎると、言い換えればレイヤーを積み重ねすぎると、この逆向きに流れる学習信号が、モデルの最初の方に届く前に消えてしまいます。これがいわゆる勾配消失問題です。

幸い、2015年に研究者たちは Residual Connections、つまり残差接続と呼ばれる修正法を考案しました。発想はとてもシンプルでした。各レイヤーが受け取った情報を完全に変換しようとするのではなく、元のデータをそのレイヤーを丸ごと飛ばして最後に足し戻すようにしたのです。これは情報があまり変化せずにネットワークを通り抜けられるショートカット、あるいは高速道路のようなものだと考えると分かりやすいです。

そしてこの高速道路のおかげで、モデルは数十層程度から、数百層、さらには数千層もの深さへと拡張できるようになりました。これが現代のAIモデル設計の基本です。ところがKimiチームが新しい論文で指摘しているように、この高速道路こそが、実は大きな根本的欠陥でもあるのです。実際、AIが一度に大量のことを扱うときに起こす記憶喪失は、まさにここから生じています。

なぜかというと、各レイヤーの結果を、レイヤーごとに次々と足し合わせているからです。最終結果は、巨大な累積データの山になってしまいます。信号の総量は深くなるほど増大していきます。信号がどんどん大きくなるにつれて、個々のレイヤーが寄与した重要性は相対的に小さくなります。つまり初期の情報は埋もれてしまい、取り出したり思い出したりすることが非常に難しくなるのです。

要するに、私たちは、AIがあまりにも必死に考えすぎて新しい思考を山のように積み上げた結果、問題の最初で何を考えていたのかを思い出せなくなるようなシステムを作ってしまっていたわけです。これをイメージしやすい例えで考えてみましょう。50人のシェフがキッチンに一列に並んでいて、それぞれがAIの50層を表しているとします。

最初のシェフは繊細なバジルを刻んで空っぽの鍋に入れます。それを2人目のシェフに渡すと、その人は牛肉のブイヨンを1ガロン注ぎ込みます。3人目はジャガイモを入れます。4人目はトマトを加えます。5人目は自分の食材をまるごと木箱ごと運んできて放り込みます。6人目は袋いっぱいの食材を入れます。7人目もまた別の食材をどさっと入れます。そんなふうにして50人目のシェフにまで回っていくわけです。

こうして50人ものシェフがそれぞれ材料を注ぎ込んだ結果、スープの器はあふれかえるだけでなく、出来上がったスープを味見しても、最初のシェフが入れたバジルの味を感じ取るのがとても難しくなります。すべてが巨大なごった煮の中に混ざり込んでしまっているからです。しかもここには二つ目の問題もあります。

この深いAIモデルの各レイヤーは、最終結果に目立った影響を与えるために、ますます強い信号を出さなければならなくなります。前のレイヤーたちの騒音にかき消されないように、叫ばなければ聞こえないようなものです。先ほどの例えに戻ると、50人のシェフが巨大な鍋のスープを作った後で、少し塩気を足したいと思ったとします。そのとき、もはやひとつまみの塩では足りません。鍋の量が多すぎるので、少し塩辛くするだけでも大袋いっぱいの塩を入れなければならないのです。

ここでこう思うかもしれません。問題は単に信号が大きくなりすぎることなのだから、縮小すればいいのではないかと。たとえば初期レイヤーの信号を弱める音量ダイヤルをつけて、後半レイヤーの信号を強めるダイヤルもつければいいのではないかと。ですが結論から言うと、それはすでに試されています。

Scaled Residual Paths や Multi-Stream Recurrences のような賢い方法はいくつかあります。しかし要するに、それらのどれも核心的な問題は解決できませんでした。どれも、各レイヤーがそれ以前の全レイヤーの単一の集約結果を受け取るという、同じ根本的欠陥を抱えていたのです。結局すべてが一つに混ざり、圧縮されてしまう。材料が多すぎて何が何だか分からない巨大なスープ鍋と同じです。

Transformerから発想された解決策

ここでKimiチームの論文が示した提案が、本当に見事なのです。彼らは一歩引いて考え、実は私たちはすでに解決策を持っていたのだと気づきました。その解決策を説明する前に、AI言語モデルの歴史を少しだけ振り返っておくことが重要です。現在のAIモデルは Transformer アーキテクチャに基づいています。

このおかげでAIは、詩を書いたり、エッセイを書いたり、さらには完全な調査レポートを書いたりするような驚くべきことができるようになりました。自然言語をここまでうまく理解できるのは、Transformer が文脈を理解できるからです。たとえば、猫は疲れすぎていたので道を渡らなかった、という文を考えてみてください。

ここで it は道を指すことも猫を指すこともできそうですが、私たち人間は文脈から、それが猫を指していると分かります。ところが Transformer が登場する以前は、言語モデルがこうした文脈を理解するのはとても難しかったのです。Transformer 以前に最も有力だったのは、Recurrent Neural Network、略してRNNでした。

そのアーキテクチャはだいたいこんな感じです。これらのモデルはテキストを一語ずつ処理していました。そして、それまでに見たものを Hidden State の中に圧縮して入れていきます。これは記憶のようなものだと考えると分かりやすいです。ところがRNNに大量のテキストを処理させると、同じような記憶喪失にひどく苦しみます。

段落の最後にたどり着くころには、前の部分を簡単に忘れてしまうのです。過去の情報をあまりに強く圧縮しているからです。段落を読み進めるたびに圧縮、圧縮、また圧縮を続け、やがて記憶が過負荷になり、最初の方の内容を思い出せなくなります。ところが Transformer は Attention という仕組みを導入することで、この問題を解決しました。

単一の圧縮された記憶を引き渡す代わりに、モデルは前のどの単語にも直接立ち戻って、今の単語にとってどれが関係あるかを見られるようになったのです。つまり必要な情報だけを選択的に取り出せるようになりました。これこそが現代AIを可能にしたブレークスルーでした。ちなみにTransformerが実際にどう動くのか、その技術的詳細に興味があるなら、以前に私がTransformerを深掘りした動画をぜひ見てみてください。

とにかく、このTransformerの設計が、Kimiの研究者たちにとってのひらめきにつながったのです。現代のTransformerモデルは、Attention を使って古いRNNの記憶喪失問題をすでに解決していました。では段落のテキスト次元ではなく、AIモデルの深さ次元に対して同じ修正を適用したらどうなるのでしょうか。結局のところ、何百、何千層もあるAIモデルは、ある意味で一つの長い段落と同じようなものです。

しかも現在の設計では、それはまさにRNNのように振る舞っています。データが前方に流れるにつれて、各計算は一つの累積信号に次々と圧縮されていき、その結果として記憶喪失が起こるのです。信号は薄まり、中間ステップは絡み合い、最終層に達するころには元の信号をほとんど取り戻せなくなっています。

長いテキストを処理できないRNNとまったく同じです。つまり答えは、ずっと目の前に隠れていたのかもしれません。非常に深いAIモデルの残差接続に Attention を加えたらどうだろうか。これが論文タイトルの由来でもある Attention Residuals です。

Attention Residualsの仕組み

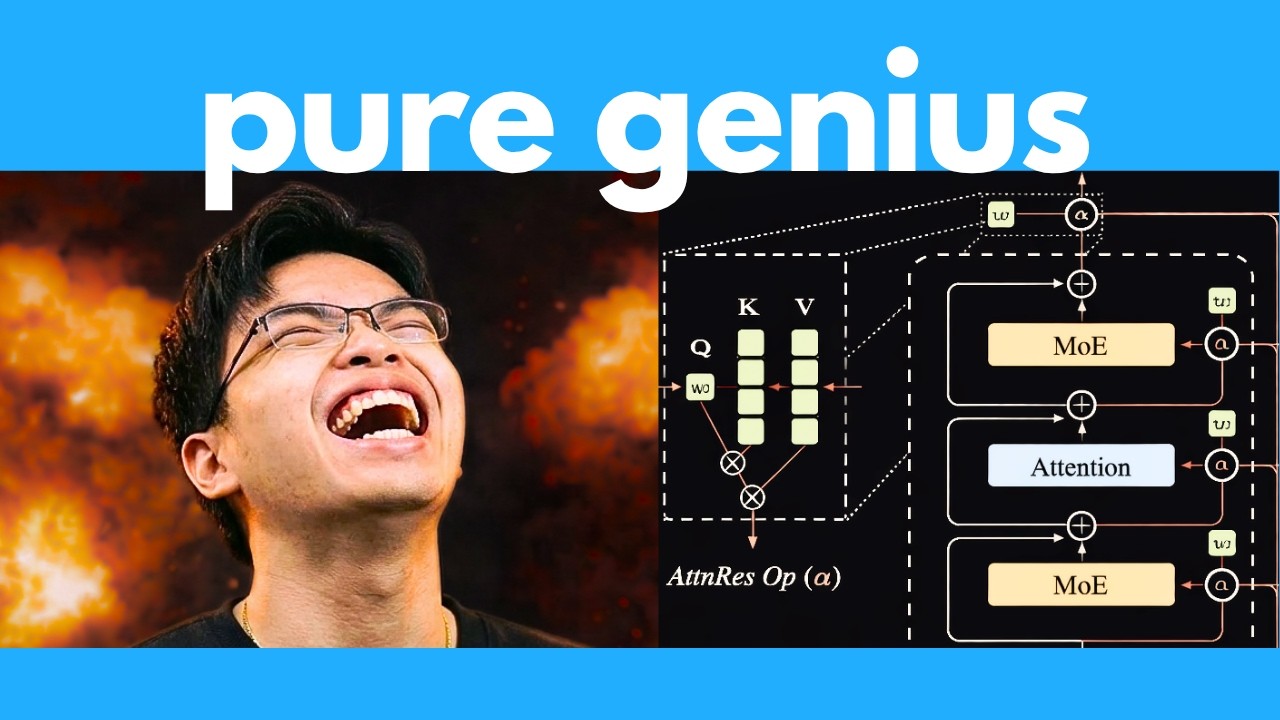

ではKimiチームはどのように設計したのでしょうか。内部では大量の数式が動いていますが、ここではシンプルに説明します。従来のように情報が端から端へ線形に流れるだけのコンベヤーベルトではなく、今は各レイヤーが前のどのレイヤーの出力にでも立ち戻って参照できるようになっています。これによってAIは、より深く考えるほど混乱したり、以前の考えを忘れたりするのを防げます。

この仕組みを実現するために、モデルは Query、Key、Value ベクトル、略してQKVのシステムを使います。これはTransformerのAttention機構とまったく同じです。もしTransformerにあまり馴染みがないなら、やはり先にその動画を見るのを強くおすすめします。ですがとにかく、各レイヤーはそれぞれ特定の Query、つまり問いを持っていると考えることができます。各レイヤーが、前にあるすべてのレイヤーから何を必要としているのか、自分はどんな情報を探しているのか、と尋ねているようなものです。

そして Key は、各過去レイヤーの内容を説明するラベルのようなものです。各レイヤーが手を挙げて、ここにあります、私はこういう内容を表しています、あなたのQueryが私の持っているものと合うか見てください、と言っているようなものです。さらに Value は、その各レイヤーの中に実際に入っている情報そのものです。

仕組みとしては、たとえば今のレイヤーがデータを処理しているとします。そのレイヤーは、自分の Query をそれ以前のすべてのレイヤーの Key と比較し、どのくらい一致するかを見ることができます。そしてよく一致していれば、その前のレイヤーには今のレイヤーにとって関連する情報があるということになります。そこで、そのレイヤーの Value を現在の出力に混ぜ込むのです。

この見事な設計によって、AIは最も重要な詳細にしっかり集中できるようになります。どれだけ多くの思考ステップを踏まなければならなくても、どれだけ多くのレイヤーがモデルにあっても、各レイヤーはごちゃごちゃした累積信号をただ受け取るのではなく、どのレイヤーの情報を使うかを選択できるのです。

先ほどのシェフの例えに戻ると、各シェフが材料を巨大なスープ鍋に放り込んで全部を混ぜてしまう代わりに、このAttention Residual方式では、各レイヤーはビュッフェに入っていくようなものです。前の各レイヤーは、自分の出力をきれいに分けた皿に載せて並べています。ジャガイモのトレー、ニンジンのトレー、トマトのトレーという具合です。

各レイヤーは、自分に必要なものだけを正確に選び取れます。重要なレイヤーもあれば、完全に無視されるレイヤーもあります。ここがこの設計の美しさです。各レイヤーは、自分が何を処理しているかに応じて、何を探すかを調整できます。モデルが therefore のような語を見たときには、論理や順序を専門とするレイヤーから強く情報を引き出すかもしれません。

あるいは betrayed という語を見たときには、感情や人間関係に関わるレイヤーに注意を向けるかもしれません。少なくとも概念的には、そのように考えることができます。理屈の上では、これで記憶喪失問題は解決するはずですよね。ところが、解決したと思った瞬間、現実が強烈に立ちはだかります。何百億、あるいは1兆を超えるパラメータを持つ最先端AIモデルの規模にこれを拡張すると、物理的制約という巨大な壁に正面からぶつかるのです。

Wondercraftの紹介

最近のAIを追っているなら、数秒で派手な動画やアバターを作れるツールをたくさん見かけていると思います。でも本当の問題はそこです。それを実際に使い物になるものへ仕上げられるでしょうか。そこが私にとっての悩みです。AIクリップは確かにすごいですが、結局は自分でつなぎ合わせて、さらに編集しなければなりません。

やはり編集スキルも必要ですし、ナレーション、音楽、字幕、ブランディングなども必要です。そこで登場するのが Wondercraft です。Wondercraft は、実際に公開できる完成度の高い動画を作るのを助けるために作られたAI動画スタジオです。これは単なる断片的な生成ツールではなく、完成度の高い動画を作りたい人向けにテンプレートやワークフローまで整えられたフルプラットフォームです。

そして ready to publish というのは、収益化までできる状態という意味です。実際にアップロードして広告を回したり、講座販売に使ったり、クライアント向けの仕事に使ったりできる類いの動画です。仕組みはこうです。まずワークフローを選びます。解説動画、オンボーディング、研修動画、プロモーション動画、さらには動画ポッドキャストまであります。そこにアイデアを入れていくつか質問に答えると、Wondercraft が最初の完全なドラフトを生成してくれます。

たとえば explainer video のワークフローを選んで、ローマ帝国の歴史を説明する子ども向けの短い動画を作らせてみましょう。実行を押します。するとここでさまざまなカスタムスタイルを選べます。たとえば、この playful pastel スタイルを選んでみましょう。ほかにもさまざまな言語、動画タイプ、フォーマット、長さ、テンポまで選べます。

そしてこれが結果です。

昔々、ローマの物語は、オオカミに育てられた双子の兄弟、Romulus と Reheis から始まりました。ローマは小さな村から成長し、元老院がみんなのために法律を作る強力な共和国になりました。やがて偉大な皇帝たちが統治するようになります。ローマ軍は非常に強く、遠く離れた多くの土地へ進軍していきました。

Wondercraft は、B-roll、字幕、音楽、ナレーションを含む動画を一度に生成してくれます。その後はスタジオ内で、まるで動画編集ソフトのようにさらに磨き込むことができます。要素を動かすこともできますし、このAIにチャットで編集を頼むこともできます。単発のクリップではありません。編集し、ブランドに合わせ、実際にアップロードしてお金を生み出すものへと仕上げられます。Wondercraft は Amazon や Spotify のような大手企業のチームにも信頼されており、小規模ビジネス、代理店、あるいは個人クリエイターにとっても同じように有用です。

AIで完成度の高い動画制作を自動化したいなら、Wondercraft をぜひチェックしてみてください。概要欄のリンクからアクセスして、最初の動画を無料で作ってみてください。

巨大モデルに適用すると何が問題になるのか

ここで本題に戻ります。GPTやGeminiのような最先端モデルは通常、あまりに巨大なので、最上位クラスのGPU一枚にはモデル全体が収まりません。というのも、H100 GPUですらメモリは80GBしかないのに対し、最先端AIモデルは1テラバイトを超えることもあるからです。

ではAIラボはどう対応しているのでしょうか。現在はモデルをデータセンター内の複数のラックに分散して配置しています。これは Pipeline Parallelism とも呼ばれ、モデルを分割して運用する方法です。たとえば1層から10層はサーバーラックA、11層から20層はデータセンター内の別の場所にある次のラック、という具合に配置され、それぞれが光ファイバーケーブルで接続されます。

従来であれば、これは特に問題ではありませんでした。サーバーAが仕事を終えると、次のデータサーバーに送られるのは単一の圧縮された出力だけだからです。そこが終わればまた次のサーバーへ一つの出力を送る。あくまで一本の線形シーケンスにすぎません。

ところがこの新しい、ビュッフェ形式のような Attention Residuals では、各レイヤーが判断のために前のレイヤー群を見に行く必要があります。そうなると、もはや一方向に一つの出力を送るだけでは済みません。各レイヤーがそれ以前のすべてのレイヤーとやり取りしなければならないなら、データ通信量は爆発的に増えます。異なるサーバーラック間での通信が大幅に増え、きわめて非効率になってしまうのです。

そのため、現在の Attention Residuals の設計のままでは、これをデータセンター内の巨大モデルにはそのまま適用できません。インフラ側の制約も考えなければなりません。そこでKimiチームは、Block Attention Residuals という見事な工夫を考案しました。簡単に言えば、モデルをいくつかのブロックに分解するのです。

各ブロックの内部では、この新しい Attention Residuals が働いて文脈を理解します。しかし異なるブロック同士の間では、従来どおりの線形通信だけを行います。各ブロックの内部レイヤーは、自分たちの仕事を一つの代表的な要約にまとめ、その要約だけが次のサーバーラックに送られます。

こうすることで、各レイヤーが過去のレイヤー出力をビュッフェのように参照できるという Attention Residuals の利点を取り入れつつ、複数のサーバーラックに対しても、やり取りのための膨大なデータ転送で全体が極端に遅くなることなく、効率的に適用できます。

つまり素晴らしいのは、Kimiチームが単なる理論だけを発表したのではないという点です。実際のインフラ環境にも適用し、きちんと動くようにしたのです。

性能結果はどれほどすごいのか

では設計は分かりましたが、実際どれくらいうまく動くのでしょうか。結果はかなり衝撃的でした。参考として論文中の図を一つ見てみましょう。

青い線は Attention Residuals なしのベースモデルです。赤い線は完全な Attention Residuals を使ったものです。オレンジの線は、サーバーラックごとにモデルを分割した Block Attention Residuals を使ったものです。見て分かるように、Attention Residuals を使った二つのモデルはいずれも、学習中に同等の性能を達成しながら、1.25倍少ない計算量で済んでいます。

最初はそれほど大きく聞こえないかもしれません。しかし現代AIの規模では、一回の学習実行に数千万ドル、あるいは数億ドルかかることもあります。そのスケールでは、この差はとてつもなく大きいのです。数百万ドルの節約になることを意味しますし、同じ予算で大幅に強力なモデルを作れることも意味します。実際、ここではこの新しい Attention Residuals の手法が、DeepSeek の最近のブレークスルーである MHC、つまり Manifold Constraint Hyperconnections すら上回っていると書かれています。

これは大きなブレークスルーですが、効率性は最もわくわくする部分ではありません。本当の突破口は推論に現れます。GPQA Diamond は、大学院レベルの科学問題で満たされた非常に難しいベンチマークですが、そこで Attention Residuals を使ったモデルは 7.5 ポイントも向上しています。これは非常に大きな伸びです。つまりこのモデルは、特に多段階推論タスクにおいて、実際によりよく機能しているのです。

また、MMLU を見ると、これは世界知識と推論能力を評価するための別のベンチマークで、STEM分野、人文学、社会科学、法学など幅広い領域を含みますが、ここでも Attention Residuals を使ったモデルの方が優れています。こうした一般知識ベンチマーク全般において、Attention Residuals を持つモデルはベースモデルより高いスコアを出しています。

同じ傾向は数学やコーディングといった特化タスクでも見られます。これらは単なるパターンマッチングではなく、本当に長い多段階推論を必要とするタスクです。そしてまさにそこに、この新しいアーキテクチャの強みが現れます。

内部では何が改善されているのか

内部で本当に起きていることは、先ほど話した核心的な問題、つまり信号の希薄化が修正されているということです。通常モデルでは内部表現がレイヤーを通過するたびに無制限に成長していきますが、この赤い線から分かるように、Attention Residuals を加えると信号は有界で安定した状態に保たれます。緑の線ははるかに安定して見えます。指数的に爆発することもなく、初期の信号が埋もれてしまうこともありません。

そしてその結果として、微妙でありながら非常に重要な変化が起こります。学習プロセスそのものが、よりバランスよくなるのです。論文の別の図を見ると、そこには勾配、つまりモデルにどう改善すべきかを伝える信号が示されています。見て分かるように、Attention Residuals を使うと、この信号も全レイヤーに対してより均等に分配されます。

ネットワークのあらゆる部分が、明確で使いやすい学習信号を受け取れるようになるのです。システム全体がより健全になります。しかし、まだそれだけではありません。このブレークスルーは、モデル設計そのものの考え方まで変えてしまいます。

従来、深くすることにはかなり大きなリスクがありました。レイヤーを増やしすぎると信号が崩壊してしまうのです。研究者たちは、記憶喪失が起きることを恐れて、ネットワークを深くしすぎることに非常に慎重でした。そのため、代わりに幅の広いモデルを作らざるを得ませんでした。しかしそれらは遅く、非効率でした。

ところが今や Attention Residuals によって、その制約は消えます。記憶喪失問題を起こさずに、より深く、より深くモデルを作れるようになるのです。そこで次の疑問が生まれます。広いモデルと深いモデルでは、実際にはどちらが優れているのでしょうか。

Kimiの研究者たちはそこも考慮し、大規模な実験を行いました。異なる形状を持つ25種類のモデルを訓練したのです。背が低くて横に広いものもあれば、深くて細いものもありますが、いずれもパラメータ数は同じにして、公平に比較できるようにしました。目的は、どのモデルがより良い性能を示すかを確かめることでした。これが論文の図7です。

かなり技術的な図ではありますが、ここでの重要な結論は、どちらのアーキテクチャでも、幅を広げるより深くしたほうが性能が向上したということです。ただし、Attention Residuals を持たないベースモデルは途中で壁にぶつかりました。深くしすぎると性能が崩壊してしまうのです。

一方、Attention Residuals を持つモデルはさらに先まで伸びていきました。より深いモデルを作っても、改善が続いたのです。言い換えれば、深さはもはや制約ではありません。利点になったのです。

動的に配線を変えるAIへ

そして、ここから非常に強力なことが可能になります。より長い思考の連鎖をたどれるモデル。レイヤーごとに専門化できるモデル。深く進むにつれて、初期の推論を失わないモデル。実際、最も魅力的なのは、モデルの中をのぞき込んだときです。

研究者たちは、異なるレイヤー間での Attention パターンを可視化しました。要するに、各レイヤーが他のどのレイヤーから情報を引っ張っているかを地図のように示したのです。すると、そこに現れたものは、まるで脳のスキャン画像のようでした。

まず局所性があります。ほとんどのレイヤーは、依然として近くの隣接レイヤーに主に依存しています。これは通常の段階的な処理です。ですが次に、新しい現象が見えてきます。突然の長距離接続です。ネットワークの奥深くにあるレイヤーが、途中をすべて飛ばして、かなり初期のレイヤーまで一気に戻って情報を引き出すのです。

まるでモデルが、待って、最初の前提に戻る必要がある、と気づき、それを実行するために自分自身の配線を動的に組み替えているようです。つまり、その場で自前の残差接続を作っているのです。

さらに専門化も見られます。レイヤーの種類によって振る舞いが違います。短期記憶のように局所的な情報に集中するレイヤーもあれば、ネットワーク全体から情報を引き集めるグローバルな調整役のようなレイヤーもあります。もはやシステムは一様ではありません。構造化され、整理され、機能的にはほとんど階層的です。それはまさに、人間の脳が働く仕組みに非常によく似ています。

そしてこれは、ニューラルネットワークの見方を根本から変える変化につながります。Attention Residuals によって、それらはもはや静的なパイプラインではありません。実際には動的なシステムなのです。固定された演算の列ではなく、モデルは受け取る入力に応じて絶えず自分自身を再構成できるようになります。

入力が与えられるたびに、その入力専用の経路をレイヤーの中に構築し、それを使い、そして捨てるのです。単に計算しているだけではありません。経路を振り分け、選択し、判断しているかのようです。

人間の脳との類似と自己改善AIの可能性

ここから非常に興味深い洞察が生まれます。こうした Attention Residuals は、性能を改善するだけではなく、システムそのものの性質を変えているのです。静的な構造を、流動的で適応的なものへと変えるわけです。少し引いて見ると、それは奇妙なほど見覚えのあるものに見えてきます。

人間の脳に似てくるのです。人間は考えるとき、ただ盲目的に思考を積み上げたりはしません。立ち止まり、戻り、過去の情報を取り出します。関係ない考えは無視して、大事なことに集中します。自分の内部的な注意を管理しているわけですが、まさにそれをこの Attention Residuals がやっているのです。

さらに、私たちが学習する過程で、脳は絶えず自分の配線を組み替えています。有用な接続を強め、ノイズを剪定し、必要だと判断した新しい接続を作っていきます。この能力は神経可塑性、Neuroplasticity と呼ばれます。そして今、Attention Residuals によって、AIもある意味では同じことができるようになります。

よりよく記憶するだけではなく、何を記憶すべきかを決められるようになるのです。文脈に応じて自分自身の接続を組み替えられます。もしかするとこれは、時間を通じて継続的に学習できる自己改善型AIを設計するための、次の一歩なのかもしれません。

まとめ

さて、かなり深い内容でした。ご覧のとおり、この論文は非常に深く、非常に技術的です。ですので、かなり多くの部分を単純化して説明しましたが、大筋は以上です。少しでも理解しやすく伝えられていたならうれしいですし、これが将来、より良いAIモデルの設計をどう変えていくのか、その可能性も感じてもらえたならと思います。

これについてどう思うか、ぜひコメント欄で教えてください。いつものように、今後も皆さんに共有するために、最新のAIニュースやツールを追い続けます。ですので、この動画を楽しんでいただけたなら、ぜひ高評価、共有、チャンネル登録をして、今後のコンテンツも楽しみにしていてください。

それから、AIの世界では毎週本当に多くのことが起きています。私のYouTubeチャンネルだけでは、とてもそのすべてを取り上げきれません。ですので、AIの最新動向を本当に追いかけたいなら、無料の週刊ニュースレターにもぜひ登録してください。リンクは概要欄にあります。ご視聴ありがとうございました。それでは、また次の動画でお会いしましょう。

コメント