人間が書くプロンプトこそが、AIにとって最も複雑で扱いにくい入力であるという問題を、最新研究をもとに解説した内容である。従来の自動プロンプト最適化では見抜けない構造的欠陥が存在し、AIの推論力そのものではなく、そもそもの探索空間の閉じ方に限界があることを示している。さらに、その制約を突破する新手法 Vista が、仮説生成と書き換えを分離したマルチエージェント設計によって、従来法を大きく上回る性能を実現する様子が語られている。

- 人間のプロンプトはAIにとって最も複雑なもの

- Prompt Engineering と Context Engineering だけでは足りない

- Gaper と最新の研究

- Reflection in the Dark が暴いたこと

- 理論の核心 Gaper は最適解を見つけていない

- 無害に見える壊れたシードプロンプト

- 色覚異常の警官の例え

- 数学的に見た探索空間の崩壊

- コーンの内側しか探索できない

- 4つの失敗モード

- Vista のアルゴリズム上の革新

- Vista の結果

- 仮説生成と書き換えを分離する設計

- Vista の5段階ループ

- 仮説エージェントと反省エージェント

- 候補プールという経験の価値

- ヒューリスティック集合と自己学習への道

- 経験ループの重要性

- 今回の結論と Vista の意味

- まとめ

人間のプロンプトはAIにとって最も複雑なもの

こんにちは、コミュニティの皆さん。戻ってきてくださって本当にうれしいです。

人工知能では、すでに解決済みの話題があると思われがちなものがあります。たとえば、プロンプト最適化です。ですが、私は間違っていました。実際のところ、ごく最近の研究論文は、明確にある問題が起きていることを示しています。そして、そのエラーがまさにどこで起きるのかというと、元の人間のユーザープロンプト、つまり入力の段階です。

では、自動プロンプト最適化、APOに関する最新研究について話していきましょう。

なぜこれが必要なのでしょうか。というのも、人間のプロンプトこそが、この地球上のどんなAIシステムにとっても最も複雑なものだと分かってきたからです。

私たちはこう言っていました。待ってくれ、私たちには美しい Prompt Engineering があるじゃないか、と。そうです。私は人間のプロンプトから始めます。そして、それを特定のやり方で構造化し、定式化しなければならないと分かっています。そのうえで Context Engineering もあります。つまり、RAG システムがインターネットやデータベースなどから追加の文脈を持ってきてくれるわけです。

ですが、ここで新しい問題群に直面します。そしてそれは、自動化された進化駆動型の最適化によってしか検出できないのです。

Prompt Engineering と Context Engineering だけでは足りない

私のワークフローを見てみましょう。普通はまず Prompt Engineering から始めます。これが最初のシードプロンプトです。そしてここに、静的レイヤーを最適化する何かがあります。さらに Context Engineering があります。RAG が美しく動的レイヤーを管理し、必要なものすべて、たとえばコンテキスト内学習や few-shot の例などを持ち込んでくれます。

ところが今や、これはAIが本当の意味では扱いきれない複雑さになっていることが分かってきました。だからこそ、人間から機械へのインターフェースにあるこの相互作用面は、途方もなく大きくなってしまうのです。

私たちが与える指示のすべてを考えてみてください。プロンプトそのものの長さ、プロンプト内のフィールド順序、特定のプロンプト内における chain of thought の配置、こちらが指定する出力スキーマ、選ばなければならない few-shot 例、そしてフレーミングやペルソナ設定もあります。たとえば、博士課程の学生のように振る舞ってください、といったものです。

これらすべての次元にまたがる同時最適化は、もはや人の手では扱えません。ここでは、機械がこの数学的空間を体系的に探索しなければならないのです。

私はもう解決済みだと思っていました。でも違いました。思い出してください。2024年7月の Prompt Engineering as a Prompt Engineer、University of Southern California と Microsoft による研究、あるいは University of Maryland の InstructZero: Efficient Instruction Optimization for Blackbox LLMs です。

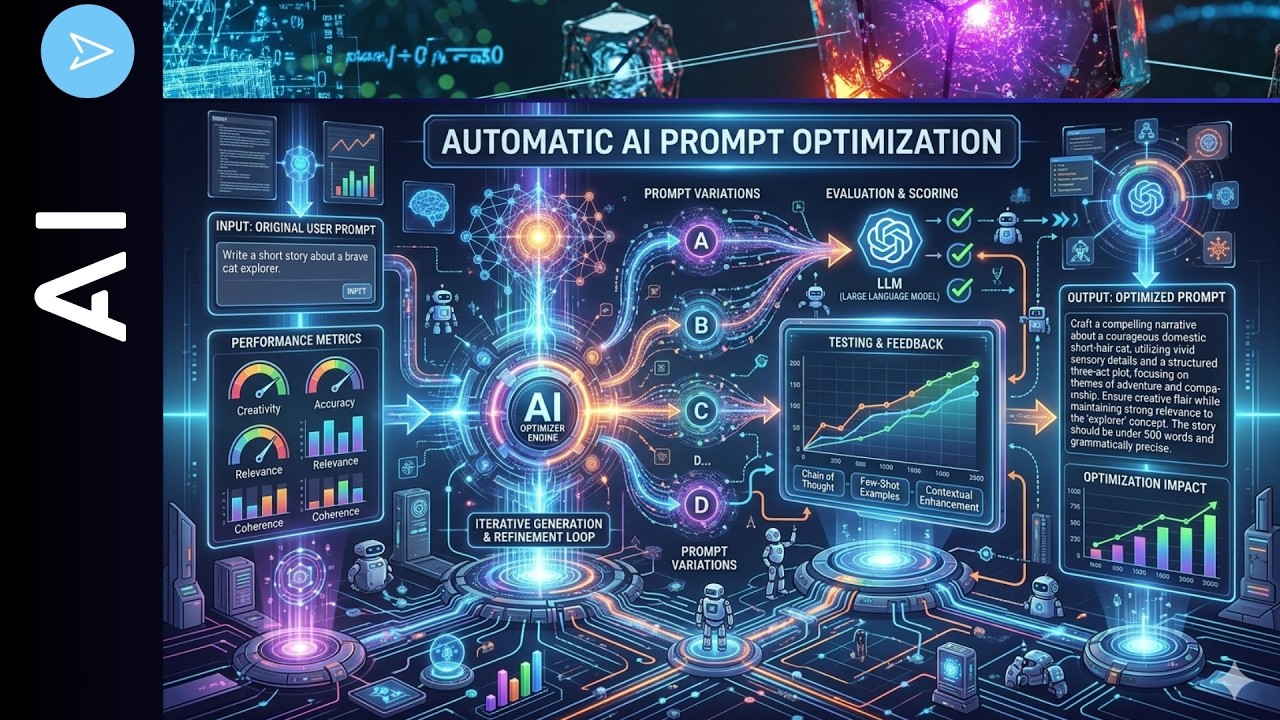

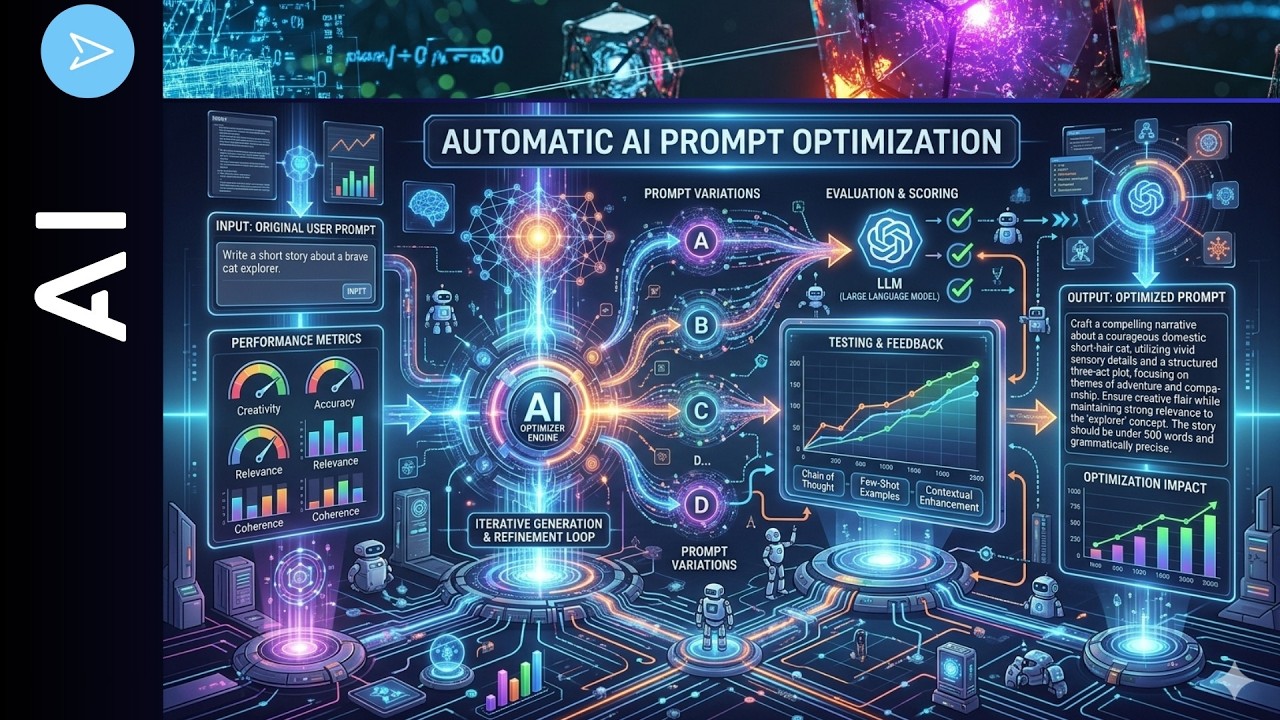

実際のところ、OpenAI、Anthropic、Meta のような企業を見ても、いまだにプロンプト最適化は存在しています。私は単純な人間のプロンプトを入れます。すると、モデル固有の最適化プロセスを担うAIオプティマイザがあり、AIモデルが、なるほど、このように人間のプロンプトを最適化しよう、と判断し、その後でそのプロンプトをさらにワークフローの先へ進めるのです。

Gaper と最新の研究

そしてご存じのように、2026年2月には GAPer が登場しました。UC Berkeley、Stanford University、Databricks、MIT が集まり、あることをやろうと言ったのです。強化学習すら上回り得る、LLM向けの最新研究、Reflective Prompt Evolution を書こう、と。

これは本当にすごいものでした。データがそれを示してくれました。性能曲線を見ると、オレンジが GPO、緑が私の Pro version 2、青が GAPer です。そして GAPer はさまざまなベンチマークで他を上回り、精度を使った評価では、24,000 回のロールアウトを用いた GRPO の強化学習すら打ち負かしたのです。

つまり、私たちのAIシステムには内在的な知性があり、必要なのはプロンプトをできるだけ完璧に設計することだけだ、ということになります。素晴らしい話です。

実際、GitHub リポジトリも活発です。GAPer、見てください。2日前、3週間前と更新があり、本当に美しいです。

しかし、GAPer の第一著者を覚えていますか。UC Berkeley です。その UC Berkeley が、Hong Kong University of Science and Technology、Hefei University of Technology とともに、2026年3月19日に新しい論文を出しました。

Reflection in the Dark が暴いたこと

論文のタイトルは Reflection in the Dark です。Berkeley が Reflection in the Dark なんて言い出したら、これは面白い論文になると分かります。ブラックボックスを暴き、そこから脱出する。そして私たちは再び、反省的プロンプト最適化における LLM のブラックボックスへと戻ってきたわけです。

私としては、2026年3月半ば、いや3月末になってもなお、私たちがプロンプト最適化について語っているというのが少し驚きです。というのも、AIは、人間がプロンプトを定義したときに本当は何を望んでいるのか、人間の意図は何なのか、ということを理解していないからです。

この研究の美しいところは、たまに皆さんが、ああ、彼らは Nvidia A6000 を8枚使ったんでしょう、と書いてくることに対する答えになっている点です。今回の研究は、たった1枚の Nvidia RTX 4090、しかも24GBだけで行われました。つまり、ある程度の環境さえあれば、自宅でもできるかもしれないのです。私たちはまだ、比較的普通のAI環境で新しいAI研究の洞察を得られる段階にいるのです。

理論の核心 Gaper は最適解を見つけていない

ですがまず、理論を理解しなければなりません。ポイントは何だったのでしょうか。GAPer、あるいは GAPer が理解していたものは、実は完璧な解を見つけていないということです。

たとえばプロンプト空間があるとしましょう。何らかの数学的空間です。そしてそこに局所最適があるとします。ところが実際には、GAPer が発見できない絶対的な大域最適が存在するのです。

GAPer は、ごく単純に言えば、次の局所最適へ進き、そこで止まります。終了です。

ではどうするのか。そこで新しい方法論を発明する必要がある、これを Vista と呼ぼう、という発想になります。そして Vista は、新しい解を提示することになります。もちろん Vista はマルチエージェント型の APO フレームワークでなければなりません。なぜなら、今私たちが向き合っている複雑さは、とても信じがたいものだからです。

このフレームワークは、仮説生成とプロンプト書き換え自体を切り離します。エージェントが生み出す仮説に意味ラベルを付けられるようにし、その後、並列のミニバッチ検証実行を組み立て、それらの仮説を検証します。そして成功すれば、エージェントによる解釈可能な最適化トレースが得られます。

これが簡単な説明です。では、実際に何が問題なのか、感覚をつかんでもらうために見ていきましょう。

無害に見える壊れたシードプロンプト

GAPer が解けないものは何か。それは、欠陥のあるシードプロンプトです。見た目にはまったく無害で、とても単純です。ですがこれこそが、GAPer が失敗する根本原因なのです。

AIに対して、あなたはアシスタントです、数学の問題を解いて、答えを出してください、美しいですね、と伝える。そして出力形式の定義、たとえば JSON オブジェクトのところで、ただミスをしてしまうのです。

これは単純なケースです。しかし、10行あるうちの4行目と6行目を入れ替えてしまったら、と想像してください。

すると、結果を JSON オブジェクトとして提示するそのロジックの中に、論理的不整合が生じます。この形式上の問題が大きな問題を引き起こし、モデルはその仕事を実行できなくなるのです。

皆さんはたぶん信じないと思います。私も信じていませんでした。ですが彼らは、このシステムの完全な実行を示してくれます。美しい推論トレースがあり、特定の仕事について、いや、これは無理だ、待て、計算してみよう、といった実に見事な推論が見えます。あらゆる可能性を検討し、さらに検討し、さらに検討しました。

しかし最後には失敗したのです。このシステムは失敗しました。なぜ失敗したのかと問えば、答えは単純です。フィールド順序の欠陥が、10回の反復すべてにわたって温存されたままだったからです。すべての修正は別のものを対象にしていました。推論の質、問題解決、誘導、ドメイン固有のヒューリスティックなどです。しかし構造的な根本原因は、システムによって一度も特定されませんでした。

そこで著者たちは、これを変えようと決めました。そして自己参照システムの幾何学へと話が進みます。これは後で自己学習システムについて話すときに、とても重要になります。

色覚異常の警官の例え

とても簡単な例を挙げます。AIのことをよく知らなくても、これで本質が見えるはずです。

想像してみてください。優秀な刑事がいて、そこに犯罪現場があります。ところが、証拠の収集は最初に現場へ来た警官が行っていて、その警官は色覚異常だったとします。すると、すべての写真、すべての注釈、あらゆる記録から、色という区別上重要な特徴が抜け落ちてしまいます。

その後、刑事は頭の中で何千もの仮説を巡らせます。手口はどうだったのか、動機は、アリバイは、時間は、というふうにです。ですが、たとえば赤い繊維だった、という決定的な証拠は、可能性の空間に一度も入ってこないのです。

これは、その刑事に推論能力がないからではありません。GPT-6 や GPT-7 にしても同じです。問題は推論ではないのです。最初の証拠収集の段階なのです。証拠を集めた LLM が色を理解できなかった。そのため、色というカテゴリーは、私たちが構築した証拠基盤、数学的なフィールドの中に一度も提示されず、表現されもしなかったのです。

つまり、どれだけ追加で推論しても助けにはなりません。スケーリングでは絶対に解決しません。反復回数をいくら増やしても、この仮説は生まれないのです。なぜなら、刑事の認識論的閉包、しかも本当に数学的な意味での閉包は、知能ではなく証拠基盤によって構造的に決まってしまうからです。どれほど知能を使って証拠を理解しようとしても、その外には出られません。

数学的に見た探索空間の崩壊

この単純な例を数学へ移してみましょう。同じ話題を数学的に言い換えるのです。

プロンプト空間 P を高次元多様体として考えましょう。ある空間に埋め込まれています。各点 p_i はひとつのプロンプトであり、最適化の目的は、タスク性能を測るスカラー値関数です。

なぜかというと、私たちの反省的 APO プロセスは、モデル自身の推論過程を通じて候補方向を生成する、勾配を使わない最適化を行っているからです。

つまり、環境からの本当のフィードバックはありません。ただシステムを動かし続けるだけです。しかし、勾配を使わない最適化というのは注意が必要で、そこに遭遇したいとは普通思いません。なぜなら、現在のプロンプト p_i において、そのモデルが接空間上の確率測度を定義してしまうからです。

私たちが刑事として、あるいは LLM として立てる各候補仮説 H は、特定の方向を向いたベクトルに対応します。そしてリフレクタが提案できるのは、無視できない確率質量を持つ方向だけです。

つまり、出発点からあるコーン状の構造、三次元の円錐構造が定義され、そのコーンの内部にあるものだけが探索でき、推論でき、検出でき、ああ、赤い繊維のようなものがある、と言えるのです。しかしその探索可能なコーンの外にあるものは、永遠にその世界の外です。どんなAIシステムでも、どれだけ何百ものデータセンターを使っても同じです。

これは数学における凸最適化の局所最小値トラップとは違います。もっと構造的に深刻です。これは、LLM 最適化、あるいはエージェント最適化において、探索空間自体の次元が崩壊しているのです。何が起きているかというと、オプティマイザは実質的に、外部からの摂動なしには抜け出せない、低次元の部分多様体の上で生きることになるからです。

ここに、システム的な解釈としての主要な根本原因があります。今の説明では、刑事の物語と数学的解釈の両方を示しました。何が起きているのかを見てもらうためです。

コーンの内側しか探索できない

ここでもう一度、Claw visual を使って頑張って説明してみます。出発点があります。そして三次元コーンがあります。Claude はなぜか二次元のコーンしか描いてくれないのですが、三次元だと想像してください。

その中での拡張やジグザグ移動は、コーンの内側だけで起こります。私たちは性能23パーセントから始め、そこで13パーセントという局所最小に行き着きます。つまりシードプロンプトより悪くなってしまうのです。でも、それが GAPer にとって利用可能な範囲なのです。

ところが、プロンプト特徴空間のどこかには、大域最適 p* があり、精度87.6パーセントを達成できます。そこにあるのです。ただ、見つけられないだけです。

ではどうするのか。答えはこうです。この大域最適へ行くには、モデルが知っている探索方向すべてに対して、数学的な意味でも高次元的な意味でも直交する方向へ進まなければならないのです。つまり、すべてを壊さなければならない。本当にこの三次元コーン構造から抜け出さなければならないのです。

したがって観察されるのは、最適化プロセスそのものが構造化された失敗モードを持っている、ということです。そして素晴らしいことに、その複雑な分析の結果、彼らは4つの失敗モードを特定しました。

4つの失敗モード

この4つの失敗モードについては、紙面の数学的説明を見てもよいのですが、ここでは単純な説明をします。赤が GAPer の失敗の連鎖で、Vista はそこに対する解を持っています。L1 から L4 までが問題です。

まず1つ目は seed trap です。オプティマイザの探索空間は、暗黙のうちに私たちのシードプロンプトによって制約されており、p0 にある構造的欠陥は、すべての実行を通して静かに伝播します。GAPer を使う限り、シードレベルの前提そのものを疑う仕組みは存在しません。

2つ目は attribution blind spot です。論文は美しく示していますが、本当の構造的根本原因には、AIのあらゆるラウンド、あらゆる推論、あらゆる反省過程を通じて、帰属が一度も与えられません。Qwen 13B から GPT-4o まで強くしても同じです。つまりこの盲点は、能力の問題ではなく、事前の構造の問題なのです。AIシステムの知能の高さとは無関係に、推論の地平の外にあります。

L3 も興味深いです。trajectory opacity、つまり軌跡の不透明性です。たとえ帰属が正しくても、最適化の軌跡にはラベルが一切ありません。オプティマイザは精度差分を処理しなければならないとは知っていますが、どの仮説がそれを生んだのか、どのアイデアが根本原因なのか、どのカテゴリーのミス、どの失敗モードに対処すべきなのかを知りません。

L4 は transfer fragility です。強いベースモデルに対して最適化されたプロンプトは、潜在的な欠陥を覆い隠してしまう可能性があります。たとえば GPT-5.4 なら解けるかもしれませんが、それは巨大なモデルで、選択肢をたくさん持っているからです。ですが8B程度の小さな事前学習パラメータモデルでは、そうした選択肢は出てきません。強いベースモデルは、モデルの頑健性が補っている潜在欠陥を隠してしまうのです。だから、より弱く小さな LLM や vision-language model に知見を転移すると、その潜在欠陥が検出信号なしで露出します。

小さなモデルは、AIが構造的な問題を抱えていることを私たちに示してくれるのです。

Vista のアルゴリズム上の革新

では、L1 から L4 に対処する中核的なアルゴリズム上の革新はどこにあるのでしょうか。

要するに、2つのエージェントがあります。1つ目のエージェントは、ヒューリスティックなカバレッジを使った仮説生成だけに集中します。これは強みですが、実はそこに弱点も潜んでいて、それは2分ほど後で話します。

AI がなぜうまくいかないのかについて立てる各仮説、各説明は、タプルとして構成されます。もっとも単純な場合、それは c_i であり、C の要素であるカテゴリーラベルと、自然言語による説明 d_i です。

ですが、それだけでは足りません。修正案も必要です。

その前に、結果を見ておきましょう。これは面白いのです。思い出してください。これも、24GB VRAM の Nvidia RTX 4090 一枚で行われました。自宅でもできます。まだ余地がありますし、可能性もあります。自宅のコンピュータで新しいAI研究を発表できる余地がまだあるのです。

Vista の結果

先ほど見せた欠陥シードプロンプトの条件下で、特定のベンチマークを用いると、GAPer はシード性能の23パーセントから13パーセントまで劣化します。つまりシード性能にすら負けてしまいます。ところが Vista はこれを87パーセントまで回復させます。

さらに転移条件では、GPT-4.1 から Qwen 3 4B への移行で、GAP は22パーセント、Vista は86パーセントを達成します。つまり、これほど単純なベンチマークでも何かが起きているのです。

では、それが何なのか説明してみましょう。

仮説生成と書き換えを分離する設計

すでに触れたように、Vista はあるものを切り離します。何が起きたのか、何が間違っているのか、という仮説生成を、マルチエージェント設計によってプロンプト書き換えから分離するのです。もちろん、マルチエージェントです。他に何があるでしょうか。

仮説エージェントは、意味ラベル付きの仮説を提案します。そして反省エージェントの仕事は、それぞれの仮説を個別に狙ってプロンプトを書き換えることだけです。

こうして、各プロンプト更新、しかも本当にプロンプトレベルの更新ひとつひとつに、明示的で検証可能な仮説が与えられます。これにより最適化プロセスは各ステップで解釈可能になります。人間にとってもそうです。なぜなら私たちはそのファイルを読めるからです。

仮説は、カテゴリーラベル C と、疑われる失敗モードの自然言語による説明から成ります。そしてもちろん、特定ドメインにおける失敗事例の集合も持てます。出発点としてAIに与えておけば、完全な白紙から始めずに済みます。

この c_i は、既知であっても未知であってもよい、ヒューリスティックな失敗モードの拡張可能な分類体系です。どう始めても構いません。ただし、代表的なケースから整理された失敗モードのイメージを少しでも持っていると、ゼロから始めなくて済むので非常に有利です。

各エントリは、失敗モードのカテゴリ、説明、そして推奨される修正方向を指定します。どう直すかということです。単純でしょう。これ以上ないほど単純です。

Vista の5段階ループ

では、各ステップを追っていきましょう。タスクがあります。私のタスク、私のプロンプトだとしましょう。そして私は、間違いがあるとは気づいていない壊れた開始プロンプトを持っています。たとえば JSON 出力形式の位置関係で4番と6番を取り違えていたり、人間としての記述が十分に正確でなかったりしたとします。そして、それをAIが自動で直して理解してくれるとは思わないほうがいい。だから新しい方法論、Vista が必要なのです。

Vista は1ループ、あるいは何ループも回し、そのたびに5つのことをします。

最初に、候補プールの中から現在もっとも良いプロンプトを選びます。このモデル、たとえば Claude と話しているとしましょう。Claude は経験の蓄積からこのプールを作っています。私の個人データを知っているかもしれない。理論物理に関する問い合わせが来ると分かっているかもしれない。直近でうまくいったプロンプト、あるいは理論物理に関する最良プロンプトとして人々に高評価を受けたものを知っているかもしれない。

だから、ある意味で私のプロンプトを無視するのです。あるいは、私の人間のプロンプトを使いながらも、人間が望んでいることは分かった、では、自分にとってうまく働くプロンプトへ写像しよう、と考えるのです。

ただし、入力としてはもう少し必要です。Vista にも何らかのデータを与えなければなりません。きちんとした解として使いたいからです。そこで Vista に4つのものを与えます。訓練データと検証データに分けられたタスクデータセット、欠陥があるかもしれない私のシードプロンプト p0、総モデル呼び出し回数の予算 B、それから既知の失敗モードの分類体系であるヒューリスティック集合 C です。

これで検証が可能になります。検証セットも訓練セットもあり、シードプロンプトもある。予算もある。そして、理論物理における既知の失敗モード分類という、少しばかりの知識もあります。

2つ目として、Vista はこう問いかけます。全部捨てて完全に一からやり直すべきか。少しのランダム確率で、まさにそれを行います。理論物理の one-shot 例をモデルにひとつ見せ、モデルが自然に何を出してくるかを観察し、その生の出力に基づいてまったく新しいプロンプトをゼロから組み立てます。壊れた出発点や元の人間のプロンプトからは何も継承しません。

いわばこれが脱出口です。これが GAPer への答えです。人間が私に求めていること、そのプロンプトはとりあえず捨てる。何を求めているかは分かる。量子場理論に関するものだ。なら、一度空の実行をし、自分の知識を見て、そこから新しいプロンプトを組み立てよう。意外かもしれませんが、これが実際に起きていることです。

3つ目として、もし再スタートしなかった場合、Vista は現在のプロンプトを小さなバッチの例に対して実行します。ここからが面白いところです。失敗したものを集めるのです。そして、それらがなぜ失敗したのかについて、複数の異なる理論を生成します。各理論には名前、説明、そしてどう直すべきかの方向が与えられます。

ここで重要なのは、理論上何がうまくいかない可能性があるかを知ることです。こうした理論はすべて、たとえば出力スキーマのフィールド順序が間違っているとか、タスク指示が少し野心的すぎるとか、そういった既知の失敗タイプの事前構築カタログから来ます。

ただし、一部の理論は、カタログ外に自由に出てもよいことになっています。実際の問題がこれまで一度も見たことのないものかもしれないからです。このようにして、エージェントが理論の系列を作っていきます。そしてゼロからでも、新しい失敗のカタログを構築できます。つまり、失敗が特定されたわけです。

次に各理論について、システム、もちろんエージェントですが、その理論を特異的に狙った改訂プロンプトを生成します。その理論の背景知識、その数学、その理論に関する Claude の経験を用いて書き換えるのです。そして、すべての改訂プロンプトを同じバッチでテストし、もっとも改善幅の大きいものを選びます。

つまり議論はしますが、最終的には複数の改訂プロンプトを出し、それをデータセットでテストして精度を測り、勝者を決めるのです。勝てば、その勝者プロンプトを内部のプールに入れ、このプロンプトは使えると記録します。そして、どの理論を試したのか、具体的にどんな変更を加えたのか、精度がどれだけ改善したのかというラベル付き記録を書き残します。

つまり、学習プロセスそのものが、メモリか何かに正確に書き込まれていくのです。そしてそれがラウンドを重ねるごとに蓄積され、可読な履歴となり、システムは同じ失敗を繰り返さないためにそれを使います。

仮説エージェントと反省エージェント

ではエージェントを見てみましょう。何をしているのでしょうか。最初のひとつは仮説エージェントです。

仮説エージェントは3つの入力を受け取ります。現在のプロンプト、つまり私の人間のプロンプト、何がうまくいかなかったのかという失敗事例、そしてヒューリスティック集合 C と、それまでの全ラウンドから蓄積された意味トレースです。

このエージェントは、たとえば3つの仮説を生成します。仮説とは何か。もちろん数学ですから、構造化されたタプルです。c_i、d_i、そして修正案です。d_i は自然言語による説明で、c_i は特徴集合から引かれるカテゴリラベルです。

ここで行っているのが、いわゆる epsilon-greedy hypothesis sampling です。たとえば epsilon を 0.1 と定義します。すると 1 – epsilon、つまり90パーセントのケースでは、仮説エージェントはもっとも適合するカテゴリー C を選び、そのラベルに結びついた仮説を生成するよう指示されます。これはいわば exploit 側の分岐です。既知の失敗モードが常に表現されることを保証します。既知の失敗に対処するわけです。

しかし、まったく新しい失敗モードである可能性もあります。そこで著者たちは、全体の10パーセントのケースについて、仮説エージェントが C リポジトリを一切参照せず自由に生成するようにしました。これが pure exploration 側の分岐です。まだ c_i にカタログ化されていない失敗モードを自由に発見できるようにするのです。エージェントによる創造的思考です。

2つ目のエージェントは純粋な反省エージェントです。こちらも各仮説から3つの入力を受け取ります。現在の人間のプロンプト、その仮説は何か、なぜ失敗したのか、修正は何か、そして失敗事例です。そして各仮説につき1つの改訂プロンプトを生成します。

これはこのエージェント、この中核 LLM に非常に特化したものです。各仮説ごとに独立して動くべきですが、もちろん共有知識はあります。ただしこれは書き換えです。書き換えは狙い撃ちであり、仮定された根本原因だけに対処します。それ以外はいっさい触りません。因果関係が複雑に絡み合っている場合には、簡単な作業ではありませんが、ひとまずそれで進めようという考えです。

こうして予算、たとえば10回の実行があるとすると、Vista は最良のプロンプト p* を返します。あくまでプロンプトレベルで、全検証を通してもっとも良かったものです。さらに、完全な意味トレース、つまり木構造も一緒に返します。

このトレースの美しさは、最適化実行の中で試されたすべての仮説、行われたすべての帰属、観測され検証されたすべての精度向上の、完全に監査可能な記録になっていることです。

つまり人間はこの記録を読んで、AIはこれをミスだと理解し、それに対して解決策を見つけようとし、その失敗モードを特定し、さらにその解決策を特定の指標、たとえばモデル精度で再検証し、どれだけ改善したかまで分かるのです。理論上は、本当にシステムを最適化したいなら、極めて美しく明快で構造化された手順だと言えます。

候補プールという経験の価値

論文のスクリーンショットには、今話したことが全部載っています。青が reflection agent、オレンジや黄色が epsilon-greedy hypothesis sampling、そして hypothesis agent、mini-batch evaluation、さらにそれが Pareto candidate pool にフィードバックされる流れです。

つまり、シードプロンプト、あるいは私の人間プロンプトがあると、システムはすぐに、待てよ、人間が望んでいることをもっと適切に指定できる、より良いプロンプトを持っていないか、と見にいきます。そして、構造、形式、推論、指示追従などを含んだ意味トレースツリーを持つ Pareto candidate pool があるのです。

この Pareto candidate pool は非常に興味深いものです。たとえば Claude Opus 4.6 があって、1秒に100万件の問い合わせを処理しているとしましょう。すると、人間が何を求めているのか、どんなタスクをさせたいのか、人間が自分の答えに高評価をつけてくれる完璧なプロンプト構造は何かを深く理解しているはずです。

これは言ってみれば、人間が仕事で経験として持つものに近いのです。ある仕事のプロとして何年も働けば、顧客やクライアントが何を望んでいるかが分かるようになります。AIにとってそれが Pareto candidate pool です。つまり、こういうものはうまくいく、と正確に分かっているわけです。

私は正直、推論能力や新しい解を生み出す能力ばかりに価値を置いていて、この経験の候補プールをそこまで重く見ていませんでした。でも本当は、それ自体がとても価値あるものなのです。

ヒューリスティック集合と自己学習への道

そして次に重要なのが、ヒューリスティック集合プロンプトです。どんなミスがあり得るのか、どんな失敗モードが起こり得るのかを、こちらが考えておく必要があります。これも論文のスクリーンショットに出ています。

著者たちはこのヒューリスティック集合プロンプトを作りました。そして驚くべきことに、その最初の項目が、まさに先ほどシードプロンプトで見た問題そのものなのです。

これこそが、私たちが実際に遭遇した問題でした。つまり、chain of thought のフィールド順序が、この特定ドメインでは問題になりうる、と彼らは特定したわけです。このエラーの説明はこうです。出力スキーマが、推論ステップより前に最終答えを要求してしまっているため、chain of thought が結果に影響を与えられない。これが彼らの特定したミスです。

ちなみに、現在のヒューリスティック集合は、代表的な失敗事例と失敗モードから人手でキュレーションされたものです。つまり、最初に7つほどのケースを用意しておき、そこから特定された新たなヒューリスティック集合プロンプトを追加連結していくような、自動化も考えられるわけです。

自己学習するAIシステムにとって、これは極めて面白いです。経験が必要なのです。

これを見て、未来のAIシステムの仕事が3つあるとすぐ分かりませんか。まず、多様なタスクとリフレクタをまたいで、大規模な最適化軌跡をあらゆるモデルについて収集することです。次に、あらゆる失敗事例をクラスタリングすることです。AIシステムや GPT-5.4 がどんなミスをするのか理解し、それをテーマ別の失敗クラスターにまとめ、意味的類似性によって、たとえば GPT-5.4 Pro で出会う失敗モードの90パーセントはこれだ、と特定するのです。

そして最後に、繰り返し現れるパターンを蒸留して、このようなヒューリスティックカテゴリに自動的に入れることです。もしシステムが自分の失敗から自動的に学び、その失敗をヒューリスティック一覧に追加し、ああ、これが自分がいつも起こしている問題だ、これがいつもやってしまう失敗だ、と認識できるなら、答えを出力する前に、今の分析や chain of thought の中でそれが起きていないかを先に確認できるはずです。

この最適化は、今すぐにでも実装できるかもしれません。もしかすると私自身のケースでもやるかもしれません。

経験ループの重要性

ちなみに、以前の動画との類似性が見えませんか。skill.md、スキルの markdown ファイルだけでは十分ではない、と私が話していた動画です。その中で私は、経験ループが必要なのではないか、と言いました。

戦略的なスキルライブラリがあるのは素晴らしいことです。1万個の skill markdown ファイルを読み込める。素晴らしいです。でも、それをどう使うか、複数のスキルをどう統合するかという経験がなければ、skill.md だけでは決して十分ではありません。

ここで見ているのは、複雑さのレベルは違っても、あの動画で述べた洞察と本当に似ていると思います。皆さんはどう思いますか。コメントでぜひ教えてください。

今回の結論と Vista の意味

ここまで見てきたように、UC Berkeley などの著者たちは、反省的 APO には4つの体系的制約があることを発見しました。L1 から L3 は因果連鎖を形成しています。L4 は、最適化自体は成功しているように見える場合でも適用されます。転移の脆弱性です。GPT-5.4 が必要なのか、それとも Qwen 3.5 8B でも動くのか、という問題です。

つまり、これは非常に興味深いことです。これらは、これまで私たちが無視してきた問題なのです。なぜ現在のプロンプトや現在のモデルが、私たちの期待するほど精密に動かないのか、なぜ局所最適や局所最小に閉じ込められるのか、なぜ GA のようなシステムが局所トラップから回復できなかったのか、その理由がここにあります。

Vista があれば、うまくいけばこれを突破できるでしょう。そしてこれは自己学習システムへの一歩でもあります。

ここで強調したいのは、Vista において、もし chain of thought のフィールド順序を確認すべきだという仮説 H1 があるとしたら、それがまさにミスかもしれないから確認するわけですが、これと GAPer reflect の失敗を比べると、その違いは、モデルに知性がないからではない、モデルが弱い推論器だからでもない、chain of thought が短いからでも長いからでもない、という点です。

そうではなく、ここで起きているミス、つまり chain of thought のフィールド順序というカテゴリーそのものが、GAPer の仮説空間の中にそもそも存在していないのです。

つまり GAPer には重大な構造的問題があり、それに Vista が対処しているのです。私はこれが大好きです。

まとめ

これが今回の要点です。もう一度言いますが、これは RTX 4090、しかも24GB RAM だけで行われた研究です。ここから得られる、最新のプロンプト最適化に関するアーキテクチャ上の洞察はこうです。

そう、私たちは再びプロンプト最適化について語らなければなりません。そして仮説の質、つまり何が起きていて何が間違っているのかを理解する部分と、選択の質を切り離すためには、経験的検証が必要です。Vista ではそれを2エージェントシステムとして実装しました。

この動画を楽しんでいただけたならうれしいです。少しでも面白いと感じてもらえたなら何よりです。

本当に驚くべきことですが、私たちは再びプロンプト最適化へ戻ってきました。でも、これが人生です。私たちは毎秒ごとに学び続けています。本当に信じられないことです。

少しでも楽しんでいただけたならうれしいです。次の動画でもお会いできたらすばらしいですね。

コメント