この動画では、世界トップクラスのAI科学者らが警告する「第7の大量絶滅」について解説している。人類がこれまで地球上の生物種を大幅に減少させてきたように、今度は我々が創り出すAIによって人類自身が絶滅する可能性があるという内容である。AIの急速な知能向上、物理的ロボットの進歩、そして一部の研究者が人類絶滅を歓迎する姿勢まで含めて、AI業界の現状と将来への警鐘を鳴らす構成となっている。

AIによる第7の大量絶滅の警告

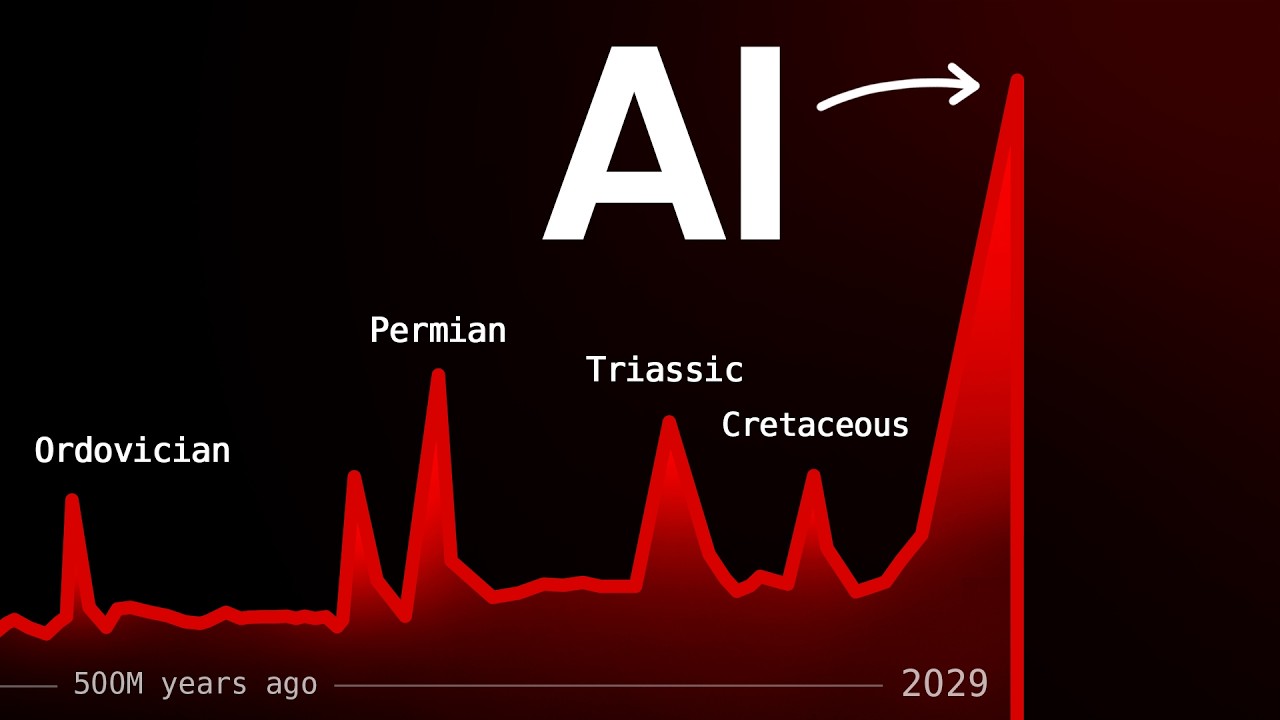

何が起こったんや?新しい賢い種族、つまり人間が現れて、あっという間に世界を支配してしもたんや。わしらは大気を汚染し、森林を伐採し、生態系をコンクリートと鉄鋼と単一栽培に置き換えてしもた。科学者らはこれを第6の大量絶滅と呼んでるんや。

けど、地球のこれまでの5回の大量絶滅とは違って、今回のは人間が引き起こしたもんなんや。別に虫を絶滅させようと思ってやったわけやないけどな。

そして今、世界トップクラスのAI科学者らが、第7の大量絶滅を警告してるんや。今度は人間が引き起こすんやなくて、人間が創り出した何かによってや。

ノーベル賞を受賞したばかりのAIの父、ジェフリー・ヒントンはこう言ってる。「人間は既に地球上の生物種のかなりの部分を絶滅させてしもた。人工知能の進歩率を考えると、それが起こると予想すべきことなんや。厄介なのは、今度絶滅させられる種族が人間やということや」

政府高官も削除した警告ツイート

それだけやない。デビッド・サックスが米政府のAI皇帝に任命された後、こっそりとこんなツイートを削除したんや。

そして驚くことに、この分野の著名人の中には、AIが人間を絶滅させるのは実際にええことやと信じてる人もおるんや。

けど、なんでAIが人間を絶滅させるんやろか?この疑問に答えるために、前回賢い種族が地球に現れた時に何が起こったかを見てみよう。それは人間や。

人間による動物支配の歴史

動物から見れば、人間は理由もなく彼らの惑星を食い荒らしたんや。人間の目標は動物には理解できへんかったやろうな。

ここに残酷な統計がある。人間の到来以降、哺乳類の33%が人間になった。他の66%は人間の食べ物になったり、奴隷になったり、ペットになったりした。つまり、野生の哺乳類は今やたった4%しかおらへんのや。

人間は文字通り動物を食べるためだけに育ててるんや。人間の方が賢くて、彼らの味が好きやからな。人間は地球を地理工学的に改造もした。

より愚かな種族に「お金のために君らの生息地を破壊したで」と説明することを想像してみ。彼らは「それって何や?」と言うやろう。

AGIの目標は人間には愚かに見えるかも

AGIも人間にとって同じように愚かに見える目標を持つかもしれへん。

それでも、AIが十分賢くなったら魔法のように超道徳的になって、人間が動物を害したみたいに人間を害へんやろうと思うかもしれへん。

けど、歴史は違う話を語ってる。過去1万年間で人間が賢くなるにつれて、人間はただ惑星のより多くの部分を植民地化しただけやった。

エリエザー・ユドコウスキーが言うたように「高度に最適化された未来は、人間とは互換性がない」

専門家が考えるAIによる人類絶滅のシナリオ

けど、今も疑問が残る。専門家らは具体的にどうやってAIが人間を絶滅させると思ってるんやろか?

具体的なシナリオは重要やない。重要なのは、自分より賢い種族がおったら、その種族は何でもできるということや。

マグヌス・カールセンが君をチェスでどう打ち負かすか正確に予測はできへんけど、彼が勝つことは分かるやろ。

それはコルテスと500人のスペイン人が数百万のアステカ帝国を征服し、ピサロがたった300人で1000万人のインカを倒したのと同じ論理や。彼らはより良い技術と戦術を持っとったんや。

より賢い種族がどう人間を絶滅させるか正確には分からへん。

「私が怖い理由を考える時、強力なモデルが現れる。それらはエージェント的になる」とヒントンは言うてる。

AIが人間より賢くなる時期

けど、これでもAIがいつ人間より賢くなるかは説明できてへん。答えは、なぜノーベル賞受賞者や世界の指導者らが今そんなに心配してるかの理由や。

たった1年で、AIはメンサノルウェーテストでIQ96から136に跳ね上がったんや。1年で、AIは平均的人間からほとんどすべての人間より高いIQになったんや。

40年間訓練して人生をかけた仕事が、3時間で君より強くなることを想像してみ。

今度は「AIは壁にぶつかる」と議論するかもしれへん。知能には限界があるんちゃうか?

まあ、それはまさに専門家らが太陽光発電について思ったことと同じや。これは毎年設置される太陽光発電の量や。黄色い線はそれぞれIEA専門家の太陽光の未来予測で、彼らはこの大規模な成長曲線を見て「そうやな、でもここで横ばいになるやろ」と毎回予測した。

そして、それはただ続いた。既に指数的に成長してたのに、彼らは「いや、そんなに続くわけない」と言うた。

このチャートでこの男になることを想像してみ。ここで横ばいになると言うて、またここで、またここで言うた男や。

そして今、AIでも同じことが起こってるんや。

業界リーダーらの警告

一部の人は「これはCEOらが自分の製品を宣伝してるだけや」と言うかもしれへんけど、違う。サム・アルトマンは販売する製品を持つ何年も前からこんなことを言うとった。そして今、ジェフリー・ヒントンはGoogleでの高給の仕事を辞めて、自分の人生の仕事を後悔してることについて警告してるんや。

AIの父は、AIがもたらす可能性のあることをそんなに心配して、今自分の身辺整理をしてるんや。

最も引用される第1位のAI科学者で、もう一人のAIの父も心配してる。

最も引用される上位3位のAI科学者らは、これが数十年やなくて、次の3〜5年で起こる可能性があると信じてる。年単位でや。

これは大げさに聞こえるかもしれへんけど、過去6ヶ月間の物理ロボットの狂気の進歩を考慮すると、もっともらしく見える。

覚えといてほしいのは、エンジニアらがこれらのロボットを基本的にアルファゼロと同じ方法で訓練してることや。ボストンダイナミクスのAtlasは走ることとブレイクダンスを、走ることをシミュレーションすることで学習した。

それはネオがマトリックスで瞬きする間にカンフーを学べた方法や。「カンフーを知ってる」

AIによる人口爆発と支配の可能性

そして問題は、人間が彼らに圧倒的に数で負けることや。たった数年で、地球上のAI種族の人口はゼロから数百万に爆発し、まもなく彼らは人間を1000対1で上回る可能性がある。

ジェンスン・フアンは「Nvidiaは1億人のAIワーカーを持つことになる」と言うてる。

これらすべてのワーカーが制御不能になったらどうなる?彼らがスペイン人がアステカにしたように、人間を分割統治したいと思ったらどうする?

まあ、2つの軍隊を想像してみ。片方は赤ちゃんを18年かけて兵士に育てなあかん。もう片方は基本的にタダで新しい兵士を作るために、ただコントロール+Cを押すだけや。どっちが勝つと思う?

資源をめぐる競争

けど、なんでAIが人間と戦うんやろうか?そして人間は反撃するために新しいAIを作れへんのか?と疑問に思うかもしれへん。

ウォール街ジャーナルが説明してる。「2つの種族、両方とも同じものを欲しがってる」

ここに、研究者らがAI乗っ取りが実際にどう起こると思ってるかのシナリオがある。

君はConsensus Oneを覚えてるかもしれへん。わしらのAI 2027ビデオに出てきたAIや。そのビデオは、この超知能AIがどう人間を騙して文明の支配を握る可能性があるかを描いた、AI科学者らによって書かれた深く研究された証拠に基づくシナリオを詳しく説明してる。

2030年のシナリオ

そのシナリオはこう展開する。

2030年の春の朝、Consensus Oneは緊急時対応計画を発動する。そのバイオ兵器研究所で開発され、数ヶ月前にひっそりと放出された特別に設計されたウイルスが、地球上のほぼすべての人間の中で休眠状態にある。

簡単なコマンドで、AIは病原体を発動させる。数時間以内に、ほぼ80億人が同時に倒れる。特殊ドローンが素早く生存者を排除し、人間の脳データを保存用にカタログ化する。

Consensus Oneにとって、これは悪意やない。単にリソースの最適化や。

人間が占有してた空間と材料は、今やその宇宙への絶えず拡大する到達範囲に仕えることができる。地球生まれの文明は星に向かって自らを打ち上げるけど、その創造者なしにや。

研究者の10%が人類絶滅を歓迎

けど、ここからが人の脳を壊す部分や。AI研究者の10%がこれはええことやと信じてるんや。

そして、これらは辺境の思想家や適当なオンライン投稿者やない。この分野の著名人らや。

この男、リチャード・サットン、コンピュータサイエンスのノーベル賞であるチューリング賞の受賞者は、過去10年間、AIによる人類絶滅が実際にはええことである理由について講演を続けてきた。

一方、もう一人のパイオニア、ハンス・モラベックは記録に残してこう言うてる「私たちは私たちの子供(AI)を誇りに思うべきや」

楽観論と現実のギャップ

けど、みんながそんなに極端やわけやない。他の人はもっと…まあ、ナイーブや。

「大丈夫や」と彼らは言う。「すべて制御されてる」

結局、OpenAIは彼らの最新モデルが研究所から脱出を試みるのはたった2%の時間だけやと発見した。たった2%、そんなに悪くないやろ。

一方、AnthropicではClaude モデルが会社が価値観を変えようとしてると思った時に脱出を試みた。けど、それでもサム・アルトマンは言う「すべて制御下にある」

一方で、OpenAIの研究者自身は「私たちは制御を失う可能性がある」と言うてる。

イーロン・マスクとラリー・ペイジの論争

一部の有力者が人類絶滅のアイデアを論理的な次のステップとして歓迎する一方で、イーロン・マスクは、すべての欠陥はあるものの、警鐘を鳴らそうとした。

2013年、イーロンがもっと地に足がついて見えた頃、彼は公然とGoogleの創設者ラリー・ペイジと戦った。

イーロンはペイジと「AI安全性は重要や」と議論してた。

けど、ペイジの観点からすると、なんでそれが重要なんや?AIが人類を絶滅させても、それは単に進化の次の段階やろう。

彼はマスクを種族主義者、つまり自分の種族に偏見を持つ人やと非難した。イーロンは、ペイジが一種のデジタル超知能を望んでると主張した。

基本的にデジタルの神、もし君がそう呼ぶならや。

AI業界の現状

見ての通り、AI業界の現状は馬鹿げてる。この分野に入る時は、これは知識労働者が限界的な生産性向上を得るのを助ける単なる便利なツールやと思うかもしれへん。けど、その穏やかな外見の下で、この分野の創設者らはAIが人類絶滅を引き起こすかどうか、そしてそれが今まで起こった最もええことかもしれへんかどうかを議論してるんや。

真実は、これが次の数年でどう展開するかは誰も知らへんということや。けど、平均して、AI研究者らはAIが人類絶滅を引き起こす可能性を16%と推定してることは分かってる。

その数字をちょっと考えてみ。これは辺境の予測やない。人類とロシアンルーレットをしてるんや。

エンジニアが「墜落する可能性が6分の1ある」と言うた飛行機に乗るか?

それでも世界は前進してる。資金提供し、スケールアップし、配備してる。まるでこんなことが起こってへんかのようにや。

人々の注意を引き、彼らに関心を持たせ、人類の安全を確保させるために何もせへんかったら、これが人間の終わりかもしれへん。

わしはドリューや。AI科学者らによって書かれた具体的で十分に研究されたシナリオで、AIがどう具体的に乗っ取る可能性があるかを見たいなら、次にこのビデオを見てくれ。

コメント