この動画では、AIが自己改良を学習することで起こるとされる「知能爆発」について解説している。現在AIの進歩は緩やかに見えるが、これは嵐の前の静けさに過ぎない。GoogleのEric Schmidtは5年程度でAIが自分のコードを書き換えるようになると予測している。DeepMindのAlphaEvolveやTufa Labsの研究、Darwin Gödel Machineなど、再帰的自己改良に関する最新の研究成果を紹介し、AIが自分自身を改良する時代が近づいていることを示している。

AIの知能爆発という概念について

現在、人工知能は非常にゆっくりと進歩しているように見えます。しかし、これは嵐の前の静けさに過ぎないと思います。この分野の多くの研究者は、これらのシステムが自分自身を改良することを学んだ時に「知能爆発」が起こると予想しています。そして、これは単なる話ではありません。私たちは日々、これに近づいているのです。見てみましょう。

私のことは分かりませんが、AI生成のテキストに耐えれば耐えるほど、私は人間の文章、特にジャーナリズムを価値あるものと感じるようになりました。もしあなたもAIの混乱に疲れて、質の高いジャーナリズムを求めているなら、The Economistをチェックすることをお勧めします。はい、特別割引もご用意しています。

The Economistは、鋭い知的分析で世界情勢をカバーする包括的なニュース雑誌です。経済だけでなく、政治、社会全般、技術、科学もカバーしています。私がThe Economistについて特に価値を感じているのは、彼らが本当にオリジナルな材料をカバーしていることと、彼らの報道が概してバランス取れており、要点を突いていることです。

彼らは最近、中国のAI開発について非常に興味深い記事を掲載しました。例えば、中国人はAIの使用についてアメリカ人とは非常に異なって考えており、もっと実用的で、これが最終的に大きな利点になるかもしれないと説明しています。

個人的には、私はとにかく画面を見る時間が長すぎるので、印刷版を読むのが好きです。しかし、オンライン版の他に、The Economistにはビデオ、ポッドキャスト、そして音声版があるアプリもあるので、移動中にニュースを聞くことができます。実際、私は情報補給のために週刊誌を受け取るのを楽しみにしています。

もしそれがあなたにも役立ちそうに聞こえるなら、特別オファーがあります。私のリンクeconomist.com/sabineを使用すれば、購読料が20%オフになります。

知能爆発と再帰的自己改良

それでは科学ニュースに戻りましょう。人工知能が自分自身を改良することを学び、その後急速に私たち全員を上回る知能を持つ瞬間は、元々「特異点」と呼ばれていました。

しかし、その用語は支持を失ったようです。おそらく特異点が今やブラックホールの内部で待っているものと関連付けられているからでしょう。それは、悲しいことに、あなたを粉々に引き裂いてから時間を終わらせます。だから、あまり良い売り文句ではないかもしれません。

彼らは今それを知能爆発と呼んでおり、技術的に再帰的自己改良と呼ばれるものによって推進されると考えられています。ここで、GoogleのCEOであるEric Schmidtがこれについて説明している様子をご覧ください。

Eric Schmidtは次のように述べています。「業界では、5年程度で、正確にはわかりませんが、システムが自分のコードを書くことができるようになると信じられています。つまり、文字通り自分のコードを取って、それをより良くするのです。そしてもちろん、それは再帰的です。それは本質的に傾きの変化で、このように進んでいたものが突然このようになります。」

最新の再帰的自己改良研究

恐ろしいことに、再帰的自己改良の研究はここ数ヶ月でかなり進歩しているということです。5月に、DeepMindはAlphaEvolveを発表しました。これは自然進化に似たルールによってコードを改良するAIです。つまり、「突然変異」のようにランダムな変化を行い、最も成功したものが生き残るのです。

ただし、エコノミークラスの座席に足を折り込むための脚ではなく、最高の精度と効率のためにコードを進化させるのです。AlphaEvolveは実際に、誰も以前に考えたことがない行列乗算のより良い方法を発明しました。これは驚くべきことです。なぜなら、行列乗算は現在の大規模言語モデルが常に行っている演算の一つだからです。

DeepMindは、この改良が「Geminiの訓練時間を1%削減する」ことにつながったと報告しています。私はこれを非常に印象的だと思いますし、データセンターへの応用を見ると、これは一種の自己改良です。しかし、このプログラムは厳密に言えば、自分のコードを編集するという意味で自分自身を改良したわけではありません。しかし、これは最近起こったことの唯一ではありません。

3月に、AIシンクタンクTufa Labsの2人の研究者が、大規模言語モデルが自己改良できるメカニズムを提案しました。彼らはモデルに質問を簡略化させ、その後答えが正しいかどうかをチェックする機会を与え、そこからより複雑さを増すように構築しました。

彼らの例では、モデルがますます複雑な問題を解くことを学習するというものです。研究者たちは、この方法でモデルが成功において劇的に向上することを発見しました。これは何らかの自己改良ですが、まだ私たちが求めている自己書き換えではありません。

数週間前に発表されたばかりの別の論文では、研究者たちはこれに向けた最初のステップを踏みました。彼らは大規模言語モデルに自分のハイパーパラメータを編集させました。

ハイパーパラメータの自己調整と課題

ハイパーパラメータは通常、最適なパフォーマンスのために訓練の外部で調整される、ある種の黒魔術の数値です。しかし、これらの研究者は、モデルに答えを知っている偽の訓練質問を作らせ、自分で発明した質問で訓練し、その後最良の結果のためにハイパーパラメータを調整させました。

そして、これは標準的なベンチマークでLlamaベースのモデルのパフォーマンスを向上させることに著しく成功しました。しかし、研究者たちは「破滅的忘却」と呼ばれるものの兆候も観察しています。つまり、モデルに自分自身を編集させればさせるほど、以前の訓練をより少なく覚えているということです。彼らが書いているように、「編集の回数が増えるにつれて、以前のタスクでのパフォーマンスが徐々に低下する」のです。

破滅的忘却の効果は政府でも観察することができます。そして時折、私たちの冷蔵庫でも。

Darwin Gödel Machineの登場

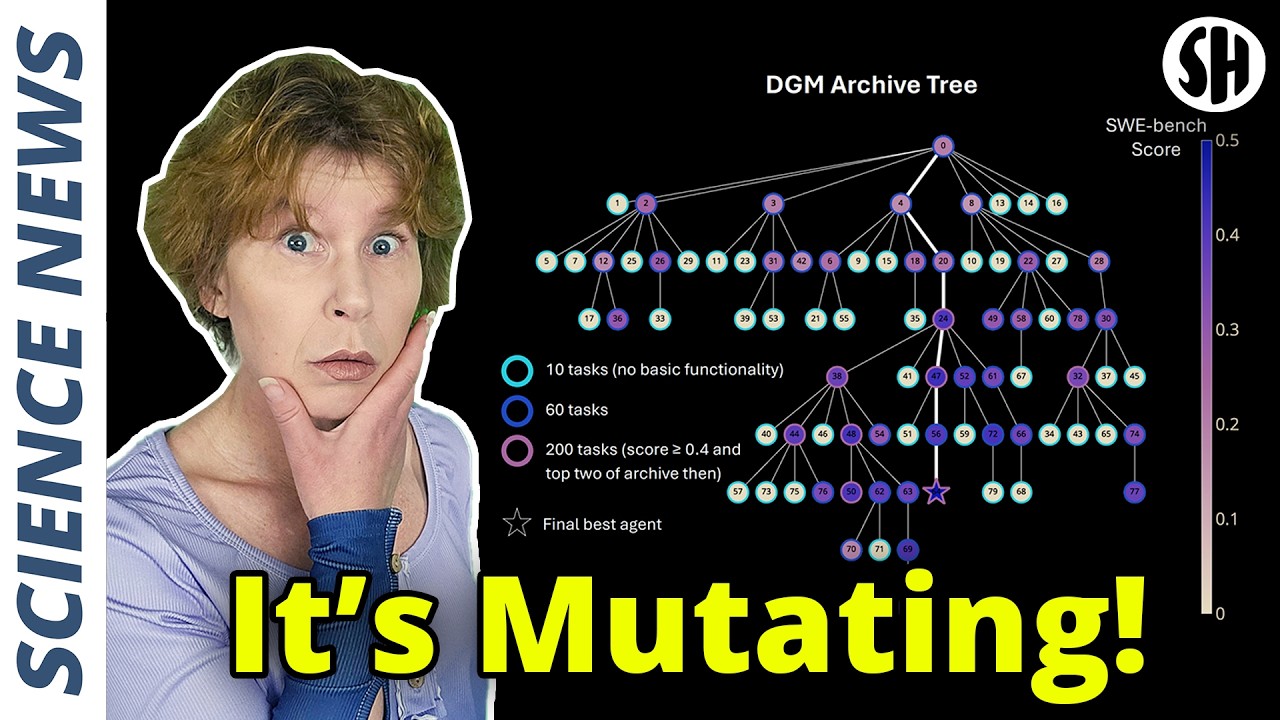

では、これは実際に自分自身を書き換えるモデルにより近いステップです。今日私たちが見た中で最も近いのは、数週間前にプレプリントで概説されたDarwin Gödel Machineかもしれません。これは自分のPythonコードを編集できるAIです。

突然変異は標準的なベンチマークで評価され、最良のものが保持されます。これにより、彼らは様々なベンチマークで大幅な改善を見ています。このアプローチの注目すべき点は、原理的にこのAIは言語モデル部分を投げ捨てて、あらゆる種類の新しいプログラムを構築できるということです。

しかし、実際には、各「突然変異体」は、彼らが利用できるコンパイラ上で数分以内に実行され、ベンチマークでスコアを出さなければなりません。これは、現時点では変更が必然的に小さなものであることを意味します。しかし、これらの制約を取り除いて、それをスーパーコンピュータに置いたら何が起こるでしょうか?おそらく私たちはすぐに見つけることになるでしょう。

現在のところ、これらは小さな研究プロジェクトです。しかし、近い将来、これらのアイデアが既存のシステムに実装される可能性が高いです。興奮すべき時代が待っています。

しかし、知能爆発が日曜日に起こらないようにしてもらえませんか。それは本当に私の週を台無しにしてしまうでしょう。ご視聴ありがとうございました。また明日お会いしましょう。

コメント