7,602 文字

こんにちは台湾の皆さん。ここに来ることができて素晴らしいです。最も重要な産業の一つが通信業界であることは言うまでもありません。世界のクラウドデータセンターがソフトウェア定義型になったように、通信業界もソフトウェア定義型になるべきだと考えるのは当然のことです。そのため、私たちは約6年かけて、メガワット当たりのデータレートまたはワット当たりのデータレートという点で驚異的なパフォーマンスを実現する、完全に加速されたラジオアクセスネットワークRAN RANSスタックを改良し最適化してきました。現在、私たちは最先端のAS6と同等のレベルに達しています。

そのパフォーマンスと機能のレベルを達成できるようになったら、その上にAIを重ねることができます。ソフトバンクやT-Mobile、Indoad、Vodafoneがトライアルを行っており、Nokia、Samsung、Kioseraが完全なスタックで私たちと協力しています。FujitsuとCiscoがシステムに取り組んでいるのが見えるでしょう。こうして今、5G上のAIまたは6G上のAI、そしてコンピューティング上のAIというコンセプトを導入する能力を持つようになりました。

量子コンピューティングでも同様のことを行っています。量子コンピューティングはまだノイズの多い中間規模量子(NISQ)の状態にありますが、すでに始められる非常に多くの優れたアプリケーションがあります。私たちはこれに興奮しており、量子古典型または量子GPU計算プラットフォームのクラスに取り組んでいます。

これをCUDA Qと呼んでおり、世界中の素晴らしい企業と協力しています。GPUは前処理と後処理、エラー訂正、制御に使用できます。将来、私はすべてのスーパーコンピューターが量子アクセラレーターを持ち、すべてが量子QPUに接続されると予測しています。つまり、スーパーコンピューターはQPUとGPU、そしていくつかのCPUを備えたものになるでしょう。

これが現代のコンピューターの表現となるでしょう。この数年間、私たちは推論時スケーリングを可能にする新しいコンピューター、つまり基本的に信じられないほど速く思考するコンピューターに取り組んできました。なぜなら、思考する際には頭の中で多くのトークンを生成し、多くの思考を生成し、答えを出す前に脳内で反復するからです。

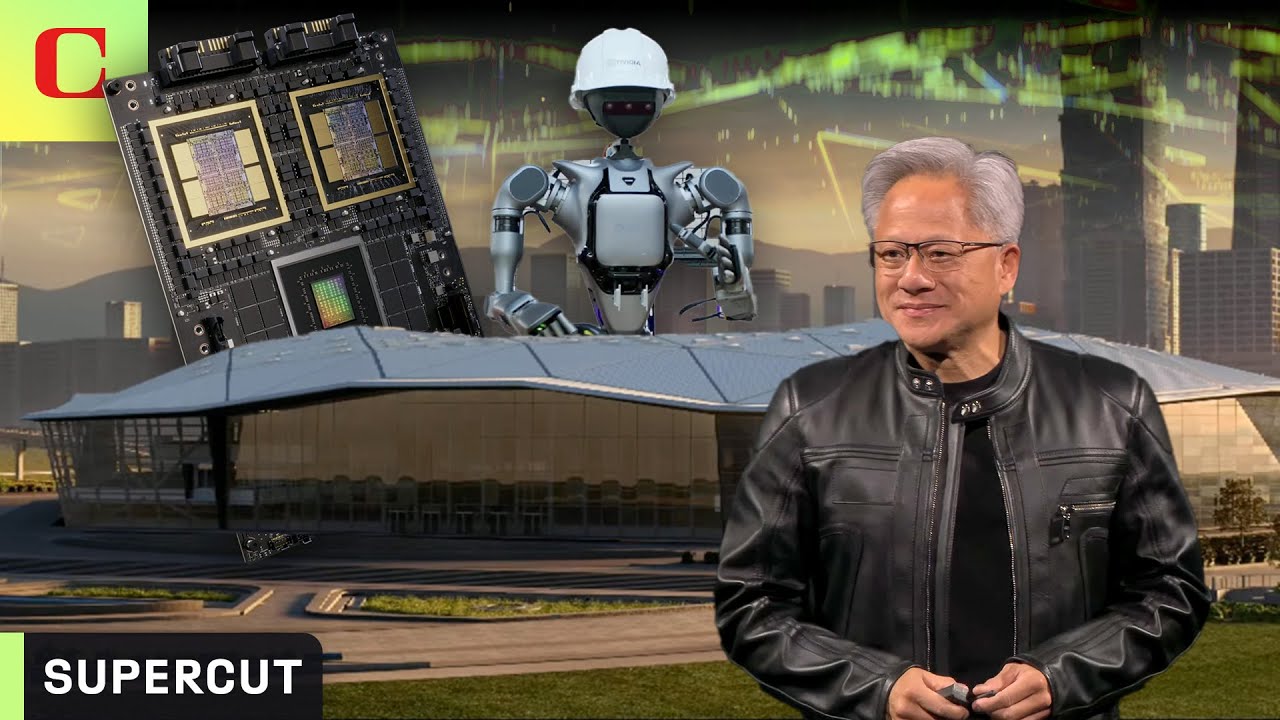

かつてワンショットAIだったものが、今や思考AI、推論AI、推論時スケーリングAIになり、これにははるかに多くの計算が必要になります。そこで私たちはGrace Blackwellという新しいシステムを作りました。Grace Blackwellはいくつかのことを行います。スケールアップする能力があります。スケールアップとは、コンピューターを巨大なコンピューターに変えることを意味します。

スケールアウトは、コンピューターを取り、多くの台を接続して、異なる多くのコンピューターで作業を行わせることです。スケールアウトは簡単です。スケールアップは信じられないほど困難です。半導体物理学の限界を超えたより大きなコンピューターを構築することは狂気的に困難です。そしてそれがGrace Blackwellが行うことです。Grace Blackwellはほぼすべてを破壊しました。

そして聴衆の皆さんの多くが、Grace Blackwellシステムの構築で私たちと提携しています。フル生産に入ったことを報告できて非常に嬉しく思いますが、同時に信じられないほど困難でもあったと言えます。HGXベースのBlackwellシステムは昨年末から完全に生産されており、2月から利用可能になっていますが、現在、私たちはすべての素晴らしいGrace Blackwellシステムをオンラインに投入しているところです。

それらは毎日世界中でオンラインになっています。数週間前からCorweaveで利用可能になり、すでに多くのCSPで使用されており、今ではあらゆる場所から登場し始めているのが見えるでしょう。皆がGrace Blackwellが本番稼働していることをツイートし始めています。今年の第3四半期に、私が約束したように、毎年リズムのように、プラットフォームの性能を毎年向上させます。

そして今年の第3四半期には、Grace Blackwell GB300にアップグレードします。GB300は同じアーキテクチャ、同じ物理的フットプリント、同じ電気機械構造を維持しながら、内部のチップがアップグレードされています。新しいBlackwellチップにアップグレードされ、現在1.5倍の推論性能、1.5倍のHBMメモリ、2倍のネットワーキングを持ち、システム全体の性能が向上しています。

これらすべては非常に大きなチップを構築できるようにするためのもので、NVLinkとBlackwellのこの世代により、これらの信じられないシステムを作ることが可能になりました。こちらはPegatronとQCT、Wishron、そして私たちからのものです。こちらはFoxconとGigabyte、ASUSからのものです。前面と背面を見ることができます。

その全体的な目標は、このBlackwellチップ(どれほど大きいかが分かるでしょう)を取り、一つの巨大なチップに変えることです。もちろんそれを可能にしたのはNVLinkですが、システムアーキテクチャの複雑さ、それらすべてを接続する豊富なソフトウェアエコシステム、このアーキテクチャを構築するために結集した150社の企業のエコシステム全体、そして技術、ソフトウェア、業界の全エコシステムが3年間の作業の成果であることを過小評価しています。これは巨大な産業投資です。

そして今、私たちは誰でも、データセンターを構築したい人なら誰でもそれを可能にしたいと考えています。それは大量のNVIDIA GB200や300のセット、Nvidia用の加速コンピューティングシステム、あるいは他の誰かのものでも構いません。そこで今日、私たちは非常に特別なものを発表します。

NVIDIA NVLink Fusionを発表します。NVLink Fusionは、セミカスタムチップではなくセミカスタムAIインフラストラクチャを構築できるようにするためのものです。セミカスタムチップの時代は古き良き時代だからです。AIインフラストラクチャを構築したいと考えており、皆のAIインフラストラクチャは少しずつ異なる可能性があります。多くのCPUを持つ人もいれば、多くのNvidia GPUを持つ人もいますし、誰かのセミカスタムAS6を持つ人もいるでしょう。

これらのシステムは構築が狂気的に困難で、すべてにこの一つの信じられない要素が欠けています。NVLinkと呼ばれるこの信じられない要素です。NVLinkがあれば、これらのセミカスタムシステムをスケールアップし、本当に強力なコンピューターを構築できます。そこで今日、NVLink Fusionを発表します。NVLink Fusionはこのように動作します。

これは100% NvidiaのNvidiaプラットフォームです。Nvidia CPU、Nvidia GPU、NVLinkスイッチ、Spectrum XまたはInfiniBandと呼ばれるNvidiaのネットワーキング、Nyx、ネットワーク相互接続、スイッチ、そしてシステム全体、エンドツーエンドで構築されたインフラストラクチャ全体があります。もちろん、希望に応じて混在させることもでき、今日から計算レベルでも混在させることが可能になります。

これはカスタムASICを使用して行うことです。素晴らしいパートナーがおり、すぐに発表しますが、彼らは特別なTPUや特別なASIC、特別なアクセラレーターを統合するために私たちと協力しています。それはトランスフォーマーアクセラレーターである必要はありません。大規模スケールアップシステムに統合したい任意の種類のアクセラレーターでも構いません。私たちはNVLinkチップレットを作成します。

これは基本的に、チップの右側に接続するスイッチです。セミカスタムASICに統合できるIPが利用可能になります。そしてそれを行えば、私が言及した計算ボードに直接フィットし、私がお見せしたAIスーパーコンピューターのエコシステムにフィットします。

おそらくあなたが望むのは、独自のCPUを使用することかもしれません。しばらくの間独自のCPUを構築しており、おそらくそのCPUが非常に大きなエコシステムを構築しており、Nvidiaをそのエコシステムに統合したいと考えているかもしれません。今、私たちはそれを可能にします。カスタムCPUを構築することでそれを行えます。

私たちはASICへのチップ対チップインターフェースを備えたNVLinkチップを提供します。NVLinkチップレットで接続し、そしてBlackwellチップと次世代Rubenチップに直接接続します。そして再び、これはこのエコシステムに直接フィットします。DJX Sparkは準備ができており、おそらく数週間後に利用可能になるでしょう。

素晴らしいパートナーが私たちと協力しています。Dell、HPI、Asus、MSI、Gigabyte、Lenovo、私たちと協力している信じられないパートナーたちです。そしてこれがDJX Sparkです。これは実際に量産ユニットです。これは私たちのバージョンです。しかし、私たちのパートナーは多くの異なるバージョンを構築しています。

これはAIネイティブ開発者向けに設計されています。あなたが開発者、学生、研究者で、クラウドを開き続けて準備し、完了時にそれをスクラブしたくない場合、基本的に常にオンで常に待機している独自のAIクラウドを隣に置きたいでしょう。

プロトタイプ作成と初期開発を可能にします。これが素晴らしいところです。これはDGX Sparkです。1ペタフロップスと128ギガバイトです。2016年にDGX1を配信した時、これはベゼルだけです。コンピューター全体を持ち上げることはできません。300ポンドです。これがDGX1です。1ペタフロップスと128ギガバイトです。

もちろん、これは128ギガバイトのHBMメモリで、こちらは128GBのLPDDR5Xです。性能は実際によく似ています。しかし最も重要なのは、ここでできる作業は、こちらでできる作業と同じだということです。わずか10年余りの間での信じられない達成です。

これは独自のAIスーパーコンピューターを持ちたい人のためのDGX Sparkです。価格についてはすべてのパートナーに決めてもらいますが、一つ確実なことは、誰でもクリスマスに一台は手に入れることができるということです。これがもう一つです。これも別のデスクサイドです。Dell、HPI、Asus、Gigabyte、MSI、Lenovoからも利用可能になります。

Box、Lambda、素晴らしいワークステーション企業からも利用可能になります。そしてこれがあなた自身の個人的なDGXスーパーコンピューターになります。このコンピューターは、壁のコンセントから得られる最高のパフォーマンスです。キッチンに置くこともできますが、ギリギリです。これをキッチンに置いて誰かが電子レンジを動かしたら、それが限界だと思います。

そしてこれが限界です。壁のコンセントから得られるものの限界です。これがDGXステーションです。これと私がお見せした巨大なシステムのプログラミングモデルは同じです。それが素晴らしいことです。一つのアーキテクチャ、一つのアーキテクチャ。そしてこれには1兆パラメータのAIモデルを実行するのに十分な容量と性能があります。

LlamaはLlama 70Bであることを思い出してください。1兆パラメータモデルはこのマシンで素晴らしく動作するでしょう。これがDGXステーションです。これは真新しいRTX Proです。RTX Pro EnterpriseとOmniverseサーバーです。このサーバーはすべてを実行できます。もちろんx86があります。すべての従来のハイパーバイザーを実行できます。

これらのハイパーバイザーでKubernetesを実行します。そのため、IT部門がネットワークを管理し、クラスターを管理し、ワークロードを編成したい方法は全く同じように動作します。Citrixやその他の仮想デスクトップをPCにストリーミングする能力もあります。

今日の世界で動作するすべてのものがここで動作するはずです。Omniverseはここで完璧に動作します。しかしそれに加えて、これは企業AIエージェント用のコンピューターです。これらのAIエージェントはテキストのみの場合もあります。これらのAIエージェントはコンピューターグラフィックスの場合もあり、小さなTJ、小さなおもちゃのJensenがあなたのところに来て、仕事を手伝ってくれるのです。

そのため、これらのAIエージェントはテキスト形式、グラフィック形式、ビデオ形式のいずれでも構いません。これらすべてのワークロードがこのシステムで動作します。モダリティに関係なく、世界で知られているすべてのモデル、知られているすべてのアプリケーションがここで動作するはずです。

実際、Crisisもここで動作します。部屋にGeForceゲーマーはいませんね。ロボティクスを実現するにはAIが必要です。しかしAIを教えるためにはAIが必要です。これが本当にエージェントの時代の素晴らしいところで、大量の合成データ生成、ロボティクス、大量の合成データ生成、そしてファインチューニングと呼ばれるスキル学習(これは多くの強化学習)と膨大な量の計算が必要です。

これは一つの時代、これらのAIの訓練、開発、そしてAIの実行に膨大な量の計算が必要な全体の時代です。先ほど述べたように、世界は深刻な労働力不足に直面しています。ヒューマノイドロボティクスが非常に重要な理由は、ほとんどどこにでも(ブラウンフィールドに)展開できる唯一のロボット形態だからです。

グリーンフィールドである必要はありません。私たちが創造した世界にフィットできます。私たちが自分たちのために作ったタスクを実行できます。私たちは自分たちのために世界を設計し、今、その世界にフィットして私たちを助けるロボットを作ることができます。ヒューマンロボティクスの素晴らしいところは、うまく機能すれば非常に多様性があるという事実だけではありません。

それはおそらく機能する可能性が高い唯一のロボットです。その理由は、技術にはスケールが必要だからです。これまでのロボットシステムのほとんどは量産規模が低すぎます。そして、これらの低量産システムは、フライホイールを十分遠く、十分速く回すための技術スケールを決して達成せず、それを改善するために十分な技術を投入しようとしないでしょう。

しかし、ヒューマンロボットは、次の数兆ドル産業になる可能性が高く、技術革新が信じられないほど速く、コンピューティングとデータセンターの消費が膨大です。しかし、これは3つのコンピューターが必要なアプリケーションの一つです。一つのコンピューターは学習用のAI。一つのコンピューターは、AIが仮想環境でロボットになる方法を学ぶことができるシミュレーションエンジン。

そしてその展開もあります。動くものはすべてロボット化されます。これらのロボットを工場に配置する際、工場もロボット化されていることを忘れてはいけません。今日の工場は信じられないほど複雑です。これはDeltaの製造ラインで、ロボット化の未来に向けて準備を整えています。それはすでにロボット化されソフトウェア定義されており、将来にはロボットがその中で働くことになります。

同じくロボット化された工場でチームとして連携して動作するロボットを作成し設計するためには、Omniverseを与えて一緒に働く方法を学ばせる必要があります。そしてそのデジタルツイン、あなたは今ロボットのデジタルツインを持っています。すべての機器のデジタルツインがあります。

工場のデジタルツインを持つことになります。これらのネストされたデジタルツインは、Omniverseが行えることの一部になります。これはDeltaのデジタルツインです。これはWiiWのデジタルツインです。これを見ているとき、もしも注意深く見すぎなければ、実際には写真だと思うでしょう。

これらはすべてデジタルツインです。すべてシミュレーションです。美しく見えるだけです。画像は美しく見えますが、すべてデジタルツインです。これはPegatronのデジタルツインです。これはFoxconのデジタルツインです。これはGigabyteのデジタルツインです。これはQuantaです。これはWistronのものです。

TSMCは次のファブのデジタルツインを構築しています。私たちが話している今この瞬間にも、今後3年間で世界中で5兆ドルの工場が計画されています。世界が再形成され、再工業化が世界中で移動しているため、5兆ドルの新しい工場です。新しい工場があらゆる場所で建設されています。これは私たちにとって、それらが良く、費用効果的に、時間通りに建設されることを確実にする絶大な機会です。

そしてすべてをデジタルツインに入れることは、本当にロボット化された未来への準備の素晴らしい第一歩です。実際、その5兆ドルの建設には、私たちが建設している新しいタイプの工場は含まれていません。私たち自身の工場でさえ、デジタルツインを配置しています。これはデジタルツイン内のNvidia AIファクトリーです。Gongはデジタルツインです。

彼らはGausongをデジタルツインにしました。すでに数十万の建物、数百万マイルの道路があります。そして、はい、Gausはデジタルツインです。私たちは次世代のITを作っているだけでなく、実際に全く新しい産業を作っています。この全く新しい産業は、私たちを前方の巨大な機会にさらすことになります。

一つのアーキテクチャの周りで私たちと一緒にエコシステムを構築している素晴らしいパートナーの皆さんと、AIファクトリー、企業向けエージェント、ロボットの構築でパートナーシップを組むことを楽しみにしています。今日来ていただいた皆さんに感謝します。素晴らしいComputexをお過ごしください。

コメント