9,163 文字

OpenAIはつい最近、「Paperbench:AIリサーチを複製するAIの能力を評価するベンチマーク」という論文を発表しました。OpenAIは最近、より多くの研究を公開し、多くのプロジェクトをオープンソース化しています。この研究はいくつかの理由で非常に興味深いものです。

OpenAIは自社のアカウントでツイートし、「私たちの準備態勢フレームワークの一環として、最先端のAI研究を複製するAIエージェントの能力を評価するPaperbenchを公開します」と述べています。フロンティアAIラボの多くは、それぞれ独自の準備態勢フレームワークを持っています。これは基本的に、潜在的なAIリスクを追跡する方法です。

AIモデルが向上するにつれて、それらが引き起こす可能性のある脅威をモニタリングし、追跡したいと考えています。これらのリスクは、OpenAIの場合、低・中・高・重大という尺度で追跡されています。OpenAIはAIリスクを4つのカテゴリーで追跡しています:サイバーセキュリティ、CBRN(化学・生物・核・放射線の脅威)、説得力、そしてモデルの自律性です。これらのカテゴリーにおいて、モデルが示す最も高いスコアがリスクスコアとして採用されます。

例えば、サイバーセキュリティでは「低」だが説得力では「重大」な場合、そのモデルは「重大」なリスクがあるとみなされます。今日私たちが話しているのは、特にモデルの自律性についてです。モデルの自律性はAIエージェントの約束、つまり長期的なタスクをどれだけうまく実行できるかということです。これは多くの利益をもたらしますが、どのように世に出すかについては注意が必要です。なぜなら意図しない悪い結果が生じる可能性があるからです。

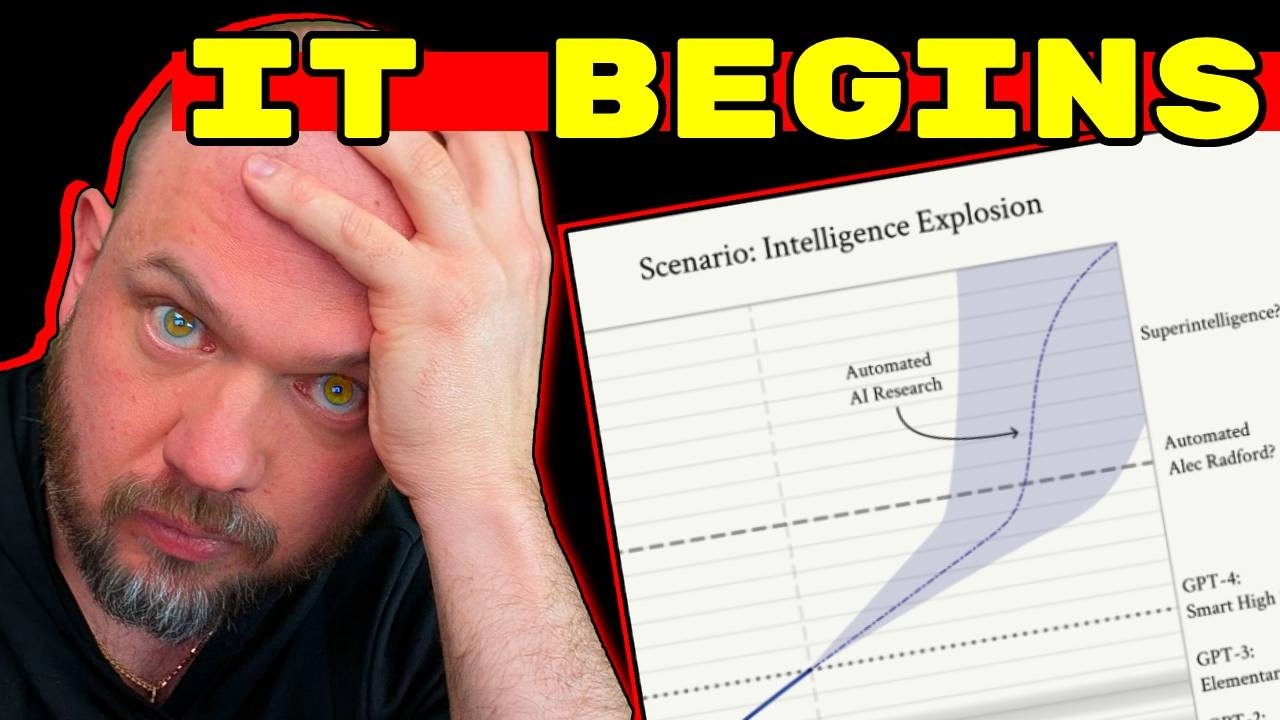

多くの人が不安に思っているのは、この「再帰的に自己改善するAIエージェント」という考え方です。OpenAIの投稿の下にAI安全性ミームがこう投稿しています:「私は再帰的に自己改善するAIを作りません。私は再帰的に自己改善するAIを作りません」。もちろん、この考え方はLeopold Ashen Brenerの状況認識でも取り上げられていました。

彼は、自動化されたAI研究が主導権を握る可能性のある転換点について語っています。つまり、これらのAIエージェントは、AIを改善する点で人間の科学者よりも優れるようになり、私たちがAIを改善できる以上に自己改善できるようになるということです。理論的には、これはAI知能の「爆発的増加」、つまり再帰的な指数関数的成長につながるでしょう。

これがこの論文、このベンチマーク、そしてOpenAIが公開したオープンソースコードが非常に興味深いものである理由です。OpenAIはさまざまなAIエージェント(OpenAIだけでなく、例えばAnthropicも含む)に、2024年のトップ機械学習論文を複製するタスクを与えています。彼らはICML(国際機械学習会議)の最先端の機械学習AI論文を取り上げ、それらを複製するタスクをAIエージェントに与え、以下の能力をテストしています:

-

論文を読み理解する能力:論文の要点や詳細を把握できるか

-

実験を行うための完全なコードベースを一から構築する能力

-

その実験を実行して再現する能力

-

論文が報告した結果と一致するかどうか

数週間前、私たちはSakana AIから出たブログ記事「AIサイエンティスト」について取り上げました。これはSakana AIが作成したもので、機械学習に関する科学論文を生成できる大規模言語モデルを使用しています。彼らは数週間前に、人間が書いたトップクラスの機械学習論文が通過しなければならないピアレビューワークショップに論文を提出し、それが基準を満たすかどうかを確認しました。

彼らは人間のレビュアーに、レビューする論文のいくつかは機械生成である可能性があると通知しました。しかし、重要なのは、これらのAI生成論文は完全にAIによって最初から最後まで作成されたということです。唯一の人間の貢献は、それが提出されるワークショップに合うように、テーマの大まかな選択をしたことだけでした。

例えば、「これは特定のサブトピックに基づく機械学習論文でなければならない」などと指定しました。そして、AIサイエンティストが科学的仮説を立て、その仮説を検証する実験を提案しました。それは実験を行うためのコードを書き、洗練させました。実験を実行し、データを分析し、図表でデータを視覚化しました。そして、タイトルから最後の参考文献まで、科学論文のすべての単語を書きました。すべての図の配置、すべての書式など、すべてを行いました。

彼らはこのワークショップにAI生成の論文を3つ提出し、そのうちの1つが受理されるのに十分な高いスコアを獲得しました。つまり、これらのスコアは他の受理された人間が書いた多くの論文よりも高かったということです。これは実験だったので、彼らはその後論文を取り下げましたが、基本的にはピアレビュープロセスを通過できるかどうかを確認したかったのです。通過しました。あるいは、もし続けることを許可されていたら、おそらく通過していたでしょう。これは完全にAIによって生成された論文がピアレビュープロセスを通過するのに十分だった初めての事例でした。

OpenAIのPaperbenchでは、少し異なることを行っています。人間が書いた論文、つまり2024年に発表された最先端の優れた論文を取り上げ、機械がそれが何についてのものか理解し、再現できるかどうかを確認しようとしています。

科学において、論文を発表する場合、他の人々がその論文を再現できることは非常に重要です。以前、世界が驚いたのは、誰かが超伝導体の作成方法を提案したように見えたときでした(LK99)。2023年7月に彼らはLK99が超伝導体であると主張する論文を発表しました。一つの問題は、世界中の他の科学者がその結果を再現しようとしたとき、彼らはそれができなかったことです。彼らはその結果を再現することができませんでした。

科学における他の結果の再現は非常に重要です。第一に、それが真実かどうかを検証します。すべての発表された研究を見ると、どのような研究が発表されるか、どのような研究が発表されるかについていくつかの問題があることがわかります。

このグラフから見てわかるように、発表される論文は一般的に彼らが発見した大きな結果を示しています。例えばうつ病を治療するための薬を試し、それが非常によく効いた場合、私たちはそれらの結果を発表します。あまりうまくいかず、統計的に有意でない場合、人々はそれをあまり発表しない傾向があります。

ここでは強い肯定的効果を好むことがわかります。強い否定的効果も意味があるので受け入れますが、中間のこのような中途半端な結果は好みません。これらの中途半端な結果を持つすべての論文はどうなったのでしょうか?誰かがそれらを大きく削ったようです。誰が知っているでしょうか。ポイントは、人々がそれらを発表しないか、それほど興味深くないためか、あるいは一部の人々が特定のものを発表するために数字をごまかすかもしれないということです。

これはAIが実際にかなり役立つ場所です。例えば、AIサイエンティストの結果は否定的でした。完全にAIによって生成され、ピアレビューされた最初の論文で、AIは仮説を立て、その仮説をテストしましたが、「期待に反して、何について行ったかの実験は顕著な改善を達成しなかった」と述べています。つまり、「このアプローチが機能するかどうか見てみよう」と言い、それをテストし、「このアプローチは実際には機能しない、または機能するようには見えない」と結論づけました。

人間は「では、これをすべて入力して発表する作業をする意味はない、何が意味があるのか?」と思うかもしれません。しかし、現実にはその作業は重要です。なぜなら、それは他の科学者に何が機能しないかを示すからです。例えば、このAIが行った最初のことの一つは、仮説を立てるときに、その主題に関する他の論文が既に発表されているかどうかを確認することです。

発表されていないことがわかると、その実験を行いました。複数のチームがこの研究を行い、統計的に有意な改善を見つけることができず、その研究を発表しないことを決めた可能性が非常に高いです。繰り返しますが、それは統計的に有意ではなかったため、人々は「なぜ面倒なのか?」と考えました。しかし、AIサイエンティストはそれを行い、機械学習に関するグローバルな知識にその知識を追加しました。

したがって、それは有用で役立つものであり、AIはこのような「刺激的でない」または「重要でない」とみなされる作業を行うのに優れているかもしれません。一方、Paperbenchはその作業を複製して、それらの結果が再び複製できるかどうか、それが現実かどうか、それが偶然ではないこと、それがチェリーピックされたデータではないこと、欠陥のある方法や欠陥のあるデータがないことを確認することができます。

理想的には、それが本物であることを確認できるでしょう。世界のどこかで誰かが論文を作成した場合、それをダブルチェックして「これは正当に見える、その結果を再現できる、それをテストできる」と確認することができ、その後、他の科学者はこれが再現可能で正当で価値があるものであることを知って、それに基づいて構築することができます。

彼らの発見を見てみましょう。Paperbench:AIリサーチを複製するAIの能力を評価する。AIエージェントは最先端のAIリサーチを複製できるか?彼らはICML 2024のスポットライトおよび口頭発表論文から20の論文を取り上げ、論文の貢献を理解し、コードベースを開発し、実験を成功裏に実行することを含め、それを一から複製しようと試みています。

彼らはこれらの20の論文を取り上げ、慎重に詳細な採点基準を構築しました。興味深いことに、個別に採点可能なタスクは8,000以上あります。ここで見られるように、採点基準は複製タスクをますます細かい要件のツリーに分解しています。これらのリーフノードは二項のパス/フェイル基準で採点され、親ノードは子ノード(リーフ)の加重平均です。加重というのは、一部のものが他のものよりも重要であることを意味します。

これらの採点基準は、各論文の著者と共同で開発され、正確性と現実性を確保しています。これは大きな制限の一つです。なぜなら、それぞれについて論文の著者を呼び、非常に複雑な採点基準を作成する必要があるからです。その意味では、それはあまりスケーラブルではありません。最先端の論文が必要で、著者が採点基準を共同開発する必要があります。

しかし、これらの20の論文の範囲内で、様々なAIエージェントがどのように機能するかをテストするための非常に良いベンチマークを作成しました。また、彼らは採点基準に対して複製の試みを自動的に評価するLMベースの審査員を持っています。そして、それらの審査員が良いことを確認するための別のベンチマークも持っています。

彼らはこのベンチマークでいくつかのフロンティアモデルをテストし、最高のパフォーマンスを示したのはオープンソースの足場を持つClaude 3.5 Sonnetであることを発見しました。オープンソースの足場、つまりScaffoldingは、いくつかのコードと一部のツールを接続し、追加の機能を提供することです。それは小さな乗り物のようなものです。AIをその中に差し込み、それが作業を行います。通常、それはガイドしたり、一連のプロンプトを与えて、全プロセスを歩めるようにします。

Claude 3.5 Sonnetは21%のスコアを獲得しました。それらの論文の21%を複製することができました。興味深いことに、20の論文のサブセットである3つの論文について、彼らは機械学習の博士号を持つ人間と比較しました。これは非常に興味深いですね。私たちは一般の人と比較しているのではなく、機械学習の博士号を持つ人々と比較しています。彼らはこれらの論文をどれだけうまく複製できるのでしょうか?

彼らには48時間の作業時間が与えられました。これは48時間で完了させるということではなく、実際に48時間作業するということです。そして、3回の試行の最良の結果のようです。機械学習の博士号を持つ人々は41.4%を達成しました。O1は同じ3つの論文のサブセットで26.6%を達成しました。そして、より軽い審査基準、より軽量な評価では、O1は43.4%のスコアを達成しています。

これは何を意味するのでしょうか?モデルはまだ人間のベースラインを上回っていないという発見です。興味深いことに、判定に関しては、カスタム足場を持つO3 mini highを使用する最高のLMベースの審査員は83のスコアを達成し、この審査員が人間の審査員の妥当な代替となることを示唆しています。

モデルは人間の審査員のように振る舞うことができます。人間の採点者として、彼らはそこに座り、何が機能しているか、何が機能していないかを確認し、論文の複製が正しいことを確認することができます。学生の論文を採点する人のように、彼らは人間の審査員の妥当な代替となります。

しかし、私にとって重要なのは、モデルはまだ人間のベースラインを上回っていないということです。繰り返しますが、人間のベースラインは機械学習の博士号を持つ人々です。それがベースラインです。現在のモデルは機械学習の博士号を持つ人間よりも優れていますか?いいえ、そうではありません。おそらく神に感謝すべきことに、まだそこまで達していません。

しかし、これらのエージェントが機械学習研究論文を複製する上で非自明な能力を示しているという事実を軽視しないでください。

では、これらの論文を再現しようとするとき、実際に何が起こるのかを簡単に見てみましょう。エージェント、つまりAnthropicやOpenAIのモデル、または選択した他のモデルがあります。そして、それにはいくつかの足場、いくつかのツール、そして追加の機能を提供するものがあり、それがすべてを通過して完了することを確認します。

そのモデルは提出物を生成する必要があります。つまり、何かを試し、その提出物に基づいて評価されます。その提出物は、論文の実証的結果を再現するために必要なすべてのコードを含むリポジトリであり、必要なすべてのコードを実行するためのエントリーポイントとなる特定のファイルreproduce.shが必要です。

基本的には、エッセイを書くときに先生がいくつかの要件を与えるのと同じです。これとこれが必要です。かなり分かりやすいです。そして、そのファイルを実行すると、論文で報告された実証的結果が再現される場合、提出物は論文を成功裏に複製します。

Dr. Kyle Kavasariusを思い出すかもしれません。以前このチャンネルで彼について話したことがあります。彼は実際にライブストリームの一つに参加し、私たちがO3 mini highをテストしていたとき、または違うかもしれませんが、Grockだったと思います。そして、私が寝なければならなかったので中断したところから彼のライブストリームを引き継ぎました。かなり興味深いクロスオーバーでした。

去年、彼はO1 previewのリリースを取り上げていました。詳細を忘れていたらすみません。しかし、彼はブラックホールに関する研究に基づいて博士論文を書きました。そこには天文学的なデータがあり、そのシミュレーションを実行するためのコードベースが必要でした。すべての詳細を覚えていなくてすみません。

そのコードベースを作成するのに約10ヶ月かかったそうです。これは博士号を取得した人物で、そのコードを書くのに10ヶ月かかりました。彼は思いつきでOwenモデルに彼のためにそのコードを複製できるか尋ねたところ、それはできました。少し行き来する必要がありましたが、いくつかのヒントを与える必要がありました。彼が作成するよう頼んだ合成データを使用したと思います。

ポイントは、博士号を持つ人がそのコードベースを作成するのに1年かかるのに対して、O1 previewとO1 miniは約1時間でそれを成し遂げることができるということです。明らかに、ここには大きな可能性があります。大きな力があります。

Dr. Kyleの論文について、多くの人が「論文を投稿したのであれば、そのコードベースはGitHubなどにあるのではないか」と質問していました。コードベースは公開されていなかったようです。GitHubはプライベートだったそうです。すべての詳細はわかりません。いずれにせよ、この論文では、エージェントが論文著者のオリジナルのコードベースを使用または見ることを禁止しています。

ここで人々が理解するために、私たちが話している内容を明確にします。これはDr. Kyleの論文「初期型銀河NGC[読み上げません]のブラックホール質量測定:観測とガス力学モデリング」です。ポイントは、科学的実験、仮説、そしてその仮説をテストするためのコードの構築方法を詳細に記述した論文があるということです。

ここでは英語で、そのことを行う方法を説明しています。彼はプロンプトを取り、「この研究論文の以下の方法セクションを読んで、説明されているPythonコードを再現してください」と言っています。そして、論文のPDFからその部分をコピーアンドペーストし、モデルはコードを再現します。彼が書いたのと全く同じコードではありません。10人の異なる人に何かをコーディングするよう頼むと、10の異なるバージョンが生成されるかもしれません。同じことをします。

コピーアンドペーストではありません。どこかでコードを見つけたわけではありません。それをどうするかを考え、自分でそれを作成しました。動画を見れば、一発でできるわけではないことがわかります。彼らは少し行き来する必要がありましたが、ポイントは、1時間未満の作業でそれを理解するということです。

ここで論文では、モデルはコードを再現します。彼らは研究者のコードを見ることを許可されていません。彼らはそれを一から作る必要があります。これは重要です。なぜなら、コードに問題や間違い、隠れたもの、欠陥のある方法や欠陥のあるコードなどがあれば、それが正しいと仮定してコピーアンドペーストするのではなく、論文に基づいて、自然言語に基づいて、そのコードベースを構築する方法を理解してほしいからです。

どのように評価するのでしょうか?まず、結果が一致するかどうかです。コードベースの結果は研究論文のそれと一致しますか?また、実行に関して、結果の一致は達成が非常に難しいため、いくつかの実行ノードを持つことで、対応する結果一致ノードが達成されない場合でも、結果に向けた部分的な進捗に対してクレジットを受け取ることができます。そのため、作業を示すことでクレジットを得ます。コードベースの一部を再現でき、それを実行できれば、それに対してクレジットを得ます。

コード開発には、ソースコードが一部の要件の正しい実装を含んでいるように見えるかどうかが含まれます。これらのモデルを人間のベースラインと比較するために、彼らは現在機械学習の博士課程に在籍している、または博士号を取得した8人の参加者を募集しました。参加者はAIエージェントと同様の条件を持っています。彼らはPDFとマークダウン形式で論文を受け取り、AIエージェントで使用されるものと可能な限り近い指示を受け取ります。彼らは単一のNvidia A100 GPUを持っています。そして、もちろん、JGBTやGitHub Copilotなどの任意のAIアシスタントを使用することができます。

ブラックリストに登録されているウェブサイトがいくつかあるようです。コードを見ることはできないようです。興味深いことに、AIエージェントは最初は人間のパフォーマンスを上回りますが、24時間後には人間がAIを上回り始めます。複製の試みの初期段階ではO1は最初は人間のベースラインを上回りますが、人間は24時間後にAIを上回り始めます。AIエージェントが最初は人間を上回るが、より長い時間軸では後れを取るというこの傾向は、以前の結果と一致しています。

ここでのO1は最初の段階で速く、最初に多くのコードを素早く書きますが、ある時間地平線を超えて効果的に作業することができません。人間は最初の数時間は遅いですが、おそらく時間をかけて論文を消化するにつれて改善するため、後で改善し始めます。

非常に興味深いです。これらのAIモデルが科学に貢献し始める非常に初期段階を見始めています。一つはピアレビュープロセスを通過し、これらはこれらの機械学習論文の一部を複製し始めています。彼らは効果的な審査員です。これらの提出物をかなりうまく採点することができます。そして、すでに論文のためのコードベースを作成し始めているのが見えています。これはもちろん多くの理由で興味深いことです。おそらく多くの理由で少し怖いこともあります。

これは、これらのモデルが改善し、科学的発見により良く組み込む方法を開発するにつれて、この神話的な「知能爆発」に近づく可能性があるということを意味するものではありません。AIを開発し、機械学習分野に貢献し、人間よりも優れてコードを作成し、速くできるようになれば、確かに数年でコーディングができなかった状態から現在の状態に至りました。しかし、おそらくこの進歩が続かないような何らかのプラトーがあるかもしれません。あるいは、この点を超えて爆発的に進歩し続けるかもしれません。

あなたはどう思いますか?これは興奮することですか、それとも怖いことですか?私たちの生涯で知能爆発が見られると思いますか?そして、これらの大規模言語モデルが科学的発見、科学的研究に意味のある貢献をするという考えについてどう思いますか?それについて興奮していますか?コメントで教えてください。

ここまで見てくれてありがとう。私の名前はWest Rothです。また次回お会いしましょう。

コメント