15,935 文字

はじめに

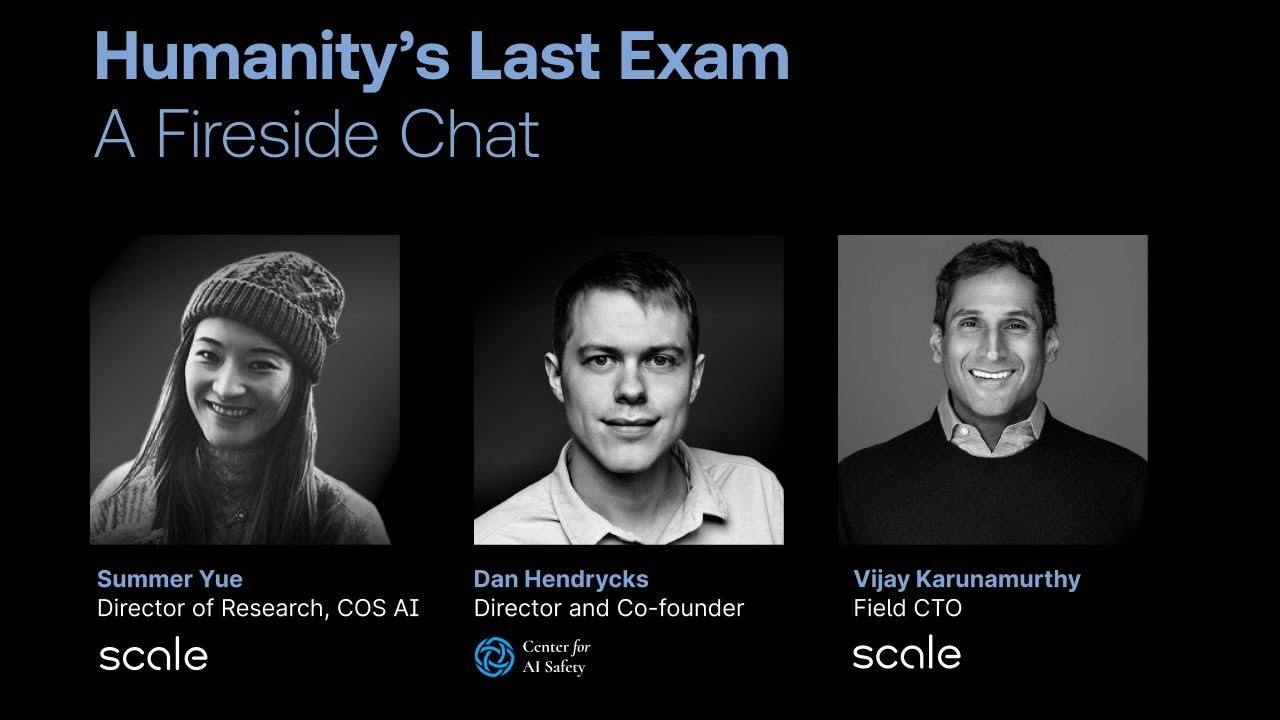

皆さん、本日はご参加いただきありがとうございます。「人類の最終試験」という非常に興味深い評価とベンチマークについての素晴らしい議論のために集まりました。このベンチマークはScaleとCenter for AI Safetyの研究チームによって設立されたものです。

本日は素晴らしい議論をします。ScaleでGenAI研究チームを率いる研究ディレクターのSummer Yuさんと、Center for AI Safetyの代表であるDan Hendrickさんをお迎えしています。SummerさんとDanさん、ありがとうございます。今日はお話できることを嬉しく思います。

Scaleの研究イニシアチブ

まずはScaleと研究活動についてお聞きしたいと思います。Summer、ScaleのJリサーチの取り組みと、SEAL(Safety, Evaluation, Alignment, and Learning)リーダーボードについて簡単に概要を教えていただけますか?

確かに。多くの方はScaleをデータ企業として知っています。私たちはフロンティアモデル開発者がモデル構築に使用するデータを提供していますが、実は多くの研究も行っています。私たちの焦点はデータとモデル構築の交差点にあります。

大きく3つのカテゴリに分けると、まず一つ目はポストトレーニングにおけるデータの科学です。どのようなデータがモデルの性能向上に役立つのか、そして訓練前にそのデータが有用かどうかを予測できるかを研究しています。

二つ目は、エージェント的ユースケースのようなフロンティアドメインについてです。現在非常に人気のある推論RLや推論データなどがあり、環境やデータ構造をどのように設計すれば、モデルを訓練して性能を向上させることができるかを研究しています。

三つ目は今日の会話に最も関連するもので、SEALリーダーボードに関するものです。これは安全性、アライメント、評価に焦点を当てた内部ラボから来ています。SEALリーダーボードでは、指示追従や推論など、業界が重視する最先端分野に関する多くのリーダーボードを公開しています。そして「人類の最終試験」もSEALリーダーボードにフロンティア推論ベンチマークとして登場しています。

Center for AI Safetyの設立

Dan、この分野での活動を始めたきっかけを教えていただけますか?活性化関数など、AI全般にわたる多くの研究をされていますが、Center for AI Safetyの設立はどのように始まったのでしょうか?

私はキャリアの初めから安全性に焦点を当ててきました。主にAIが大きな影響を与えると考え、多くの人々がその結果や影響について十分に考えていないと感じたからです。AIの影響を理解するのは非常に難しいことです。

そこで、AIのマイナス面の影響に取り組んだり、人々がAIで何が起きているかをより理解できるよう支援することに専念することが有用だと思いました。だから安全性に取り組み始めたのです。AIは重要な存在であり、何かが間違った場合に考える人が必要です。それがセンターを設立した理由です。

評価とベンチマークに取り組んできたのは、主にモデルがどれだけ優れているのか、改善率はどうか、どこに向かっているのか、何ができて何ができないのかという基本的な情報が重要だからです。これは誰にとっても方向性を理解するために重要なことであり、それが私のスキルセットとうまく合致する難しい問題だったのです。2016年頃から評価やベンチマークを作成してきました。

もちろん、それ以前にもMLUや数学のような評価、ChatGPT以前にはImageNet Cなどのビジョン関連の評価もありました。AIの改善率や特定の目標までの距離を人々が理解するのを助けることを続けたいと思っています。

フロンティアリーダーボードのビジョン

Summer、フロンティア能力、例えばビジョン理解などについて最近SEALが新しいリーダーボードを公開しました。Vistaリーダーボードや、LLMが長時間のマルチターン会話でどのように機能するかを評価するMulti-Challengeなどがありますね。フロンティアリーダーボードについてのビジョンをお聞かせいただけますか?

少しSEALがどのように始まったかという歴史から始めましょう。2024年に私はScaleに入社したばかりで、Google DeepMindでGeminiモデルに焦点を当てた研究者として働いていました。その時に気づいたのは、私たちが持つモデルの能力を本当に評価し、他のラボと比較する良い方法がないということでした。

Danがここで構築した素晴らしいベンチマークはたくさんありますが、大きな問題は、それらが非常に公開されていて誰もがアクセスできるため、意図せず汚染が起こる可能性があることです。インターネットをクロールするようにモデルを訓練すると、トレーニングコーパスにすでにこのベンチマークが含まれている可能性があり、モデルを評価する際に実際の能力を完全に反映しているかどうか確信が持てないのです。

当時、もう一つの非常に人気のあるプラットフォームは「LMsys Chatbot Arena」と呼ばれるものでした。これはBerkeleyの人たちが構築した素晴らしいアイデアで、コミュニティ全体がこのプラットフォームに来て、モデルを並べて「これは良い、これは良くない」とランク付けできるものです。素晴らしい取り組みですが、実用的ではありません。Geminiがリーダーボードで4位であることはわかりますが、それが何を意味するのでしょうか?人々はある程度好んでいるようですが、この情報で実際に何ができるのでしょうか。

SEALリーダーボードで私たちが試みている重要なことは、実用的なものを作ることです。リーダーボードで3位、4位にランクされていることを伝え、それが実際に何を意味するのか、どのような分野をテストしているのか、どのように改善できるのかを示します。

これを行うために、私たちは実行している評価の種類について非常に透明性を持ち、評価を行う人々に尋ねる具体的な質問を実際にリストアップしています。そして、単にフルランキングだけでなく、次元的にも報告します。例えば、コーディングリーダーボードにおける指示追従、正確さ、コードの読みやすさなど、人々は具体的な改善エリアを詳しく知ることができます。

2024年には、以前に構築したリーダーボードの多くでモデルがすでに優れたパフォーマンスを発揮していることに気づきました。2024年を通じて多くのモデル改善と進歩があったため、2025年には、モデルがかなり悪いスコアを出している最先端領域に焦点を当てています。

Vista、Multi-Challengeなど、今後のリーダーボードのローンチ基準の一つは、モデルがスコアを悪く出しているベンチマークのみを構築することです。おそらく年末までにはずっと良くなるでしょうが、それが進捗を追跡するポイントです。

スケールとCISの協力

Dan、あなたは長年にわたって事実性、マルチモーダル理解などの分野で多くの重要なベンチマークを発表してきましたが、ScaleとCISの間のこのコラボレーションを構築し、「人類の最終試験」を開発しようと思ったきっかけは何でしたか?

以前に、放射線学や化学兵器のための化学など、デュアルユースドメインにおけるモデルの理解を測定するWDPのようないくつかのベンチマークに取り組みました。それは非常にうまくいきました。

そして、モデルが専門家レベルに達することができないデータセットを作成することが非常に難しいことに気づきました。いくつかの種類の質問については、専門家から困難な質問を1000個入手して完全なデータセットを作成するのは難しいように思われました。

これにより、データセットを作成するために2〜3人の専門家を持つことではなく、おそらくデータセットを作成するために協力する集団、人々の集まりが必要だと考えるようになりました。もちろん、Scaleはそれに長けています。私はそうではありません。彼らはデータセットを作成するために人々をまとめる方法を経験しています。

以前のコラボレーションから、そして今後のものからも、「人類の最終試験」を含むより多くのプロジェクトを一緒に行うことは自然なことのように思えました。相補的なスキルとアラインされたインセンティブがたくさんあるからです。

「人類の最終試験」の特徴

現在、多くのベンチマークがあり、新しいモデルがリリースされるたびに、論文の一部として興味深いベンチマークのサブセットが選択されていますが、「人類の最終試験」を他のベンチマークと区別するものは何ですか?

「人類の最終試験」では、モデルが本当に優れているとき、基本的には、AIシステムに閉じた質問をする、そして答えがすでに知られているような閉じた質問の大きなセットを尋ねるというジャンルが終わりに近づいているという証拠になります。まだいくつかの狭い小さなドメインがあるかもしれませんが、私たちは本当に実質的なものを手に入れます。

それはモデルがすべてのことができるというわけではありませんが、ある意味で、私たちが何らかの形でオラクルのようなAIを持っているかどうかの指標になります。専門家レベルあるいは世界クラスのレベルで、既知のことに対する答えを本当によく教えてくれるでしょうか?

構築プロセス自体も他のベンチマークとはかなり異なります。人々は主に少数の専門家を集めて多くの質問を生成させ、それがデータセットになります。これらのAIシステムに挑戦するために必要な難易度は、グループを集める必要があるほど高くなっています。

最近、ScaleがEnigma Evalをリリースしましたが、それも質問の作成や解決プロセスでグループの人々が集まらなければならないという特性を持っています。難易度と生成プロセスは他の種類のデータセットとは全く異なります。したがって、閉じた質問に答える世界クラスの能力の良い指標になるはずです。

ベンチマークの設計における制約

Danさん、ベンチマークは効果的に設計するのが非常に難しいことがあると思います。「人類の最終試験」を設計する際に対処しなければならなかった主な制限や重要な制約は何でしたか?

主な困難は、論文の前提を正しく選択することから来ています。測定できる現象はたくさんあり、ズームインできることもたくさんありますが、ベンチマークについては、人々が実際に使用するのはわずか数個だけです。何百も作ることができますが、実際に関連するのは10個か5個程度でしょう。

基本的なアイデアを正しくすることが重要です。前提が練り上げられると、これは人々のグループがベンチマークを作成するために集まり、出版というアカデミックなインセンティブとお金というインセンティブがあるというものでした。それが前提でした。

映画を作るようなものです。あなたは映画のピッチを聞いて、「それは見たいと思うような映画だ」と思います。そこから詳細を埋めていきます。これは些細なことではありません。なぜなら、それが仕事の90%を占めるからです。

例えば、音声を多く含めたり、音声例を含めたりすると、多くのモデルがまだそれを受け入れていないため、効果が大幅に低下する可能性があります。どのような質問が含まれるべきか、除外されるべきかの基準は何か、1年後にモデルがどこにあるかを考え、それらの進歩を適切に測定できるようにすることが重要です。

基本的なアイデアがあっても、それでもクレイジーな量の作業が必要でした。このプロジェクトは正確にどれくらいかかったか覚えていませんが、おそらく半年以上でしょう。人々はそれを些細なこととして扱い、データを収集するだけだと言いますが、それは非常に間違える可能性があります。

過去に作成したデータセット、例えばappsデータセットは、ノイズが多く、評価を非常にクリーンで純粋なものにするのにとても時間がかかりました。それでも十分ではなく、全体的な影響に表れていました。これはコーディングベンチマークでしたが、使用したソースがとても多く、多くのコーナーケースや複雑さがあり、何ヶ月もの掃除が必要で、それでもまだ十分ではありませんでした。

データセットの前提が悪かったり、作成のための悪いパスがあると、映画を撮影していて脚本がまだ完成していないようなものです。そうすると、局所的に火事を消していくようなことになり、基本的な前提といくつかの高レベルの変数を適切に最適化しなかったため、数ヶ月間混乱します。複雑さやコーナーケースに悩まされ、そこから抜け出せないかもしれず、全体的な品質が良くないかもしれません。

人類の最終試験のリリースと品質問題

「人類の最終試験」の公開に話を進めると、オープンさと透明性について言及されたことすべてに関連して、このリーダーボードと試験自体のリリースの一部として約2,700の質問と回答を公開しました。これらの質問が公開された直後、データセットに含まれる一部の質問の品質について疑問が呈されました。また、個々の質問がモデルのスコアに与える可能性のある影響についても問題がありました。これらの懸念がどのように生じ、どのように対処しているかについてコメントいただけますか?

HLEでは、モデルにはまだ存在しない能力を測定しようとしていましたが、それには必ずしも最も学術的に難しいものだけではなく、例えば複雑で難しい、人々が答えるのが難しいダンジョンズ&ドラゴンズのような難解なルールなども含まれていました。

「はい、それを含めましょう。難しいからです」と思いましたが、純粋な生の難しい数学の問題のような学術的な雰囲気はありませんでした。一般的に、これらの多面的なベンチマークに含めたいと思う設計原則は、堅牢性のために多くの異なる現象を含めることです。それには、100%数学の試験とは異なる、いくつかの異なるスキルをテストすることも含まれます。

モデルの推論スキル、研究スキル、知識が生態学や法律、古典などの他のことをカバーできるかどうかを見たいと思います。いくつかの人々は純粋に物理学と数学だけを望んでいましたが、このデータセットの堅牢性とタイトルに合わせて、ほとんどすべてのものを含めるべきだと思いました。

構築プロセスではモデルにとって難しいものを開放的に維持したため、他の興味深い種類の質問も見られました。パズルなどを提出する人がいて、それがパズルの分布、特に全体が意味をなすような文字の並びを理解しなければならない謎めいたタイプの質問は、以前にリリースしたEnigma Evalにも部分的にインスパイアを与えました。

MM(マルチモーダル)ベンチマークを構築したとき、数学の質問が難しいサブセットだったことに気づき、それから数学データセットを作成したように、HLEでもパズルが難しいサブセットであることに気づき、それがEnigma Evaluationを作成することにつながりました。だから、多様さは意図的な選択です。

評価の品質について

Summerさん、評価の質についても多くの時間を考えてきましたが、特定の質問に関するこのフィードバックは、HLEと今後のプロセスについてどのように考えるのに役立ちましたか?

品質について言えば、モデル開発ラボの研究者たちと話すと、考えないと、これらの評価セットは100%正確で、1つのエラーを見つけたら悪い評価セットだと思いがちです。現実はそうではありません。

人間は欠陥があります。Danが言ったように、評価セットやデータセットを構築するプロセスは本当に難しいのです。HLEでは7万件以上の提出があり、評価側では約3,000の質問が良い質問と考えられました。

質問が健全であることを確認するために、ある程度の品質フィルタリングを行いました。正直に言って、これは商業的な取り組みに比べるとScaleが通常行うよりも軽いフィルタリングプロセスでした。これはより研究的なプロジェクトだからです。

また、ベンチマークの精度が例えば10%のエラー率(数字は例として挙げています)であっても、影響するのはモデルが達成できる最高の精度です。100%ではなく90%になるでしょう。しかし、リーダーボードを提示する際、ほとんどのモデルは一桁台のパーセンテージなので、まだモデルがこのデータセットにとって十分ではないという同じストーリーを伝えています。

確かに、100%の正確性率を持つデータセットではありませんが、データセットに対して内部評価と監査を行い、大まかなエラー率を把握しています。それは他の多くのオープンベンチマークと同等です。

さらに、バウンティプログラムを立ち上げて、コミュニティに向けて「データセットにエラーを発見したら、教えてください。データセットを修正します」と呼びかけています。時間とともに100%の精度を目指しています。

閉じた質問の利点と欠点

これらの質問の構築に話を戻しますが、意図的に閉じた質問を選択したとおっしゃいました。これは、創造性やニュアンス、閉じた質問では難しい特定の問題解決能力をテストするオープンエンドな質問とは対照的です。閉じたモデルを選択することの利点や欠点は何ですか?

閉じた数学の質問でさえ、創造性や問題解決が必要かもしれませんが、オープンエンドなものは自動評価ができないという問題があります。これは重要なポイントです。測定すべき次元は複数あるので、HLEが最後の評価というわけではありません。例えば、オープンエンドなタスクを完了する能力を測定する他の評価もあります。

しかし、これはただ彼らのスキルの重要な部分を測定しているのです。オープンエンドさには主観性があり、自動評価能力が低下します。もう一つの問題は、エージェントのパラダイム、つまりAIがフライトを予約したりパワーポイントを作成したりするようなタスクを実行するというエージェントパラダイムが、構築時にはまだ特に明確化されておらず、現在でもまだ収束していません。これにより、エージェント評価に自信を持つことが非常に難しくなります。多くの試みがありましたが、まだ多くの創造的破壊があります。

時の試練に耐えるベンチマークを作成しようとしている場合(AIの年月で言えば)、パラダイムがスケールアップされるにつれて現象がどのように見えるかについてもう少し明確な見通しが必要です。収束していないため、オープンエンドの質問にはあまり取り組んでいません。まだ調査中です。関連性のないものを測定したり、間違ったパラダイムを想定したりしないようにデザインをリスク軽減する方法はあると思いますが、閉じたソースのジャンルでは、収集プロセスを通じてその結論、その極端なところまで行くことが理にかなっていました。

しかし、タスク、オープンエンドの質問、趣味の問題、その他の種類の課題など、閉じた質問を超えて考える際には、確かに追加の課題があるでしょう。

人間の専門知識の役割

Summer、人類の最終試験について話している間に、この試験の構築における人間の役割について話しましょう。最近のSEALリーダーボードでは、ベンチマークデザインや評価構築における人間の専門知識の役割について言及していますが、ベンチマークデザインにおいて人間の専門知識が役割を果たし、実際の評価プロセスでLLMを審判として利用するというシフトが今後あると予想されますか?

「人類の最終試験」では、このデータセットを作成するために人間の努力が多く投入されました。Scaleとして、データ提供者に50万ドルを支払い、世界中の人間の専門家にデータセットに貢献することを奨励しました。これは、ベンチマーク構築プロセスにおいて人間の専門家と専門知識が必要であることを示しています。

質問の前半部分に戻ると、完全に人間による評価(人間が評価を作成し、モデルが出るたびに評価も行う)から、人間の専門家が評価を設計・作成し、大規模言語モデルまたは言語モデルを審判として使用して評価部分を支援するというシフトが見られるかどうかという点については、答えはイエスです。

SEALリーダーボードでも、Vista、Multi-Challengeなど、多くの新しい評価で人間が評価プロセスを作成し、その後言語モデルが評価を実行するという方式に移行しています。これの利点は、はるかに速いことです。3,000の質問に対して人間の判断を求めると、モデルを通して実行するよりもずっと時間がかかります。

しかし、ここでの重要なポイントは、将来の大規模言語モデルが評価を行えるように評価自体を設計する際、デザインがより複雑になることです。質問と回答を与えるだけではなく、正解がない場合、専門家に何が良いか、何が悪いかという基準のリストを作成してもらうことがよくあります。それらには非常に関与するものもあり、応答を評価するための20以上の基準がある場合もあります。

また、言語モデルが評価プロセスを進めるにつれて、人間の判断との間に良い相関関係があることを確認したいと思います。データセット全体に対して人間の評価を行う必要はないかもしれませんが、定期的に人間と言語モデルの間のアラインメントをチェックする必要があります。

人間との相関関係の重要性

人間との良い相関関係がない場合に起こりうる問題について詳しく説明していただけますか?

典型的な例は、言語モデルがどの回答が好ましいかと聞かれると、一般的に自分自身が与える回答を好む傾向があるというよく知られたバイアスです。例えば、ClaudeにOpenAI、Gemini、Claudeのどのモデルがいいか尋ねれば、Claudeは「もちろん私の回答が最高です」と言いますが、別のモデルに尋ねれば、彼らは自分たちの回答が最高だと言うでしょう。

これは、意図せずバイアスを注入しないようにしたい例です。また、より難しい評価を構築するにつれて、言語モデルにとって難しい領域をテストしています。正しい答えを生成するのが難しいだけでなく、正しい評価予測を行うことも難しくなります。

これらのベンチマークのほとんどで、人間が設計した方法論と言語モデルを評価者として使用するハイブリッド方法を採用しています。我々は人間と言語モデルの間のアラインメント率を報告しており、ほとんどが90%以上のアラインメント率を持っています。これにより結果を信頼できると感じることができます。

モデルの校正エラー

Danさん、論文発表の一部として、評価していた各モデルの校正エラーについても報告されていました。ほとんどのモデルが1桁台の精度で、答えに対して自信が低いはずなのに、校正エラーは各モデルで非常に高かったです。これから何を解釈すべきでしょうか?校正の役割を説明していただけますか?

彼らは非常に過信しています。劇的に間違っている場合でも、ほとんどの場合は非常に自信を持っています。それは良くありません。測定するものを手に入れると言いますが、AIコミュニティは校正にそれほど注目してきませんでした。HLEでは校正を強調しているので、これによりモデルをより校正するよう人々を奨励することを願っています。

これはハルシネーション(幻覚)のような問題のために重要です。これは誰もが問題だと知っていることです。AIシステムに、自分が知らないことを認識させるにはどうすればよいでしょうか?校正はそれを測定する良い方法だと思います。

本当に素晴らしい、非常に人気のあるハルシネーション評価を知りませんが、HLEの校正エラーを測定することで、しばらくの間そのような目的を果たすことができると思います。

これは、AIシステムがユーザーよりもこれらのドメインでかなり賢くなり始めているため、重要です。適切に自信を表現する必要があります。「はい、これが絶対に答えです」と毎回言うことはできません。

これは、AIシステムが「バターは溶けるか」や「これは燃えやすいか」などの常識的な質問に対してテストされていた以前はあまり問題ではありませんでした。人々は答えが正しいかどうか簡単に確認できるので、それほど多くの情報を提供しません。以前は人間の知的能力よりもはるかに低かったからです。

しかし今では、それらが超えているため、私たちには根拠と共に割り当てられた信頼度以外にあまり多くのシグナルがありません。そのため、それが非常に信頼できる数字であることを望んでいます。

基本的に2つのことが得られます。HLEを通じて、学術界の理論的部分の自動化指標を得ると同時に、校正エラーを見ることによってハルシネーションのベンチマークも得られます。これら両方の目的があることで、その有用性が高まることを願っています。

将来のモデルと人間の監視

「人類の最終試験」で50%以上のスコアを記録するモデルが登場する予定ですが、これらのモデルの将来の人間による監視において、校正エラーがこれほど高いことの結果があると思いますか?

そのような質問に関しては、彼らはまったく信頼できないと思います。単純な質問、常識的な質問に対しては非常によく校正されているかもしれません。それらに正しく答え、「100%はい、あなたは正しい」と言うでしょう。

しかし、難しい分布では、悪い仕事をする傾向があります。これはコンピュータビジョンでは解決可能な問題です。極端な分布シフトの下でも、良い技術を使ってこれらのモデルを校正することは可能でした。

うまくいけば、LLMでも同じことが可能になり、適切に自信を表現し、それが精度の根本的な現実を反映するでしょう。

推論モデルのパフォーマンス

HLE論文の発表と、どのモデルがうまく機能したかの階層に関連して、推論モデルが他のほとんどのモデルよりも少しだけ良いパフォーマンスを示しているようでした。これにはOpenAIのO3 mini、DeepSeekのR1などが含まれます。その後、OpenAIは高い水準を達成したと主張する推論+検索モデルDeep Researchをリリースしました。推論モデルが良いパフォーマンスを示すことの結果について、どう思いますか?あるいは、推論に特有の何かがあって、これらのモデルがうまく機能すると思いますか?

推論パラダイムは、このベンチマークで非常に高いパフォーマンスを達成するものだと思います。O3 Deep Researchモデルの結果が共有されたのは、「ああ、高い結果を出すのに1週間しかかからなかった」ということを示しているわけではありません。数字が報告されていなかっただけで、バックグラウンドで潜在的に存在していたものです。

数字が上がっていくことを人々は期待すべきでしょう。それはデータセットが簡単であることを示すものではありません。人々自身がいくつかの質問に答えようとしてみることをお勧めします。

むしろ、推論パラダイムがいくつかの本当に実質的な進歩を示していることを示しています。次のクラスの推論モデルがどうなるか、実際のO3モデルがどうなるか、公開利用可能なものと、答えるのに長い時間がかかるものを比較して、他のどのようなモデルが提供されるかを見てみましょう。とても興味深い分野であり、多くの動きが期待されます。

新しいモデルのリーダーボードへの追加

Summer、これらの推論モデルがHLEで少なくとも若干の優位性を持っていることを知って、O3 Proや他のモデルがいつ追加される予定か、また、より多くの検索モデルが評価やリーダーボードに追加されると予想していますか?

短い答えはイエスです。新しいモデルがベンチマークで非常に良いパフォーマンスを発揮すると信じられる場合、それをリーダーボードに追加し、コミュニティ全体が現状を理解できるようにします。

検索可能なモデルについては、潜在的に問題がある部分はHLEがオープンソースではなく、彼らが検索して理論的には正解を見つけることができることです。誰かが正解を投稿した場合など。実際、私たちはデータセットの一部として正解を投稿しています。

検索モデルがページを実際に見て検索している場合、それはパフォーマンスを正確に反映していない可能性があるということを考慮に入れる必要があるでしょう。

しかし、そのためにプライベートセットがあります。人々が公開セットでずっと良くなったとしても、1年後には戻って、これが検索ループからのオーバーフィッティングによるものなのか、実際のモデルの改善によるものなのかを確認できます。

ベンチマークデザインの改善

部分的に正しい解決策の評価や、特定の質問のためのより良いルーブリックなど、ベンチマークデザインを改善することについての考慮事項はありますか?

映画がすでに作られているようなものです。曲や何かについて考えるなら、その一部を調整すると、通常、それらの変更は依存関係構造があるためカスケードする必要があります。後から設計をいじることは難しいと思います。

いくつかの中核的なアイデアがあり、それらは互いに補完し合い、一緒に機能する必要があります。希望としては、アイデアへの主要な改善は、収集前の非常に早い段階でプロセスで行われているはずです。

しかし、非常にローカルなマイナーな変更は、主にバウンティプログラムを通じて行われるでしょう。人々が不正確であると特定した質問を投げ出すことができます。しかし、中核的なアイデアに関しては、あまり違うことはしないでしょう。

モデルの進歩と飽和予測

OpenAIがDeep Researchが26.6%という新しい高水準を達成したと報告し、「人類の最終試験」でスコアを出しました。50%、さらには90%に達するモデルがいつ登場すると思いますか?そしていつこのベンチマークは飽和し、感覚に訴えるものではなくなるでしょうか?

パフォーマンスの多くは、O3モデルがO1モデルやO3 Miniモデルよりも数学に優れていることから来ています。例えば、O3 miniは約10%程度得点しているため、数字は上がり続けると予想します。

論文では、今年の終わりまでにモデルが50%を超える可能性が非常に高いと言及しました。もし人々が「彼らは50%に達しない」と高い信頼度で言うとすれば、それは背後にある改善の速度があまりにも急速であるため、強い主張だと思います。

今年、超人的な数学者が出現する可能性もあります。競技プログラミングでは現在、米国で競技プログラミングよりも優れている人はほんの一握りで、年末までにはすべての競技プログラマーよりも優れるでしょう。

数学でも同様の運命をたどるかもしれません。次の1年ほどで超人的な数学者になる可能性を排除するのは本当に難しいです。その結果、「人類の最終試験」でも非常に高いパフォーマンスが期待できるかもしれません。

AGIについての考え

Summer、私たちはScaleで時々「AGIのためのデータファウンドリ」と言うことがありますが、「人類の最終試験」で50%以上を記録するモデルが来るということで、AGIや人工超知能についての考え方は変わりますか?そこにはどのようなニュアンスがありますか?

AGIを呼ぶものには多くの要素があると思います。数学の問題を解くのがとても上手である、推論がとても上手であるというだけでは、私の定義ではAGIとは言えないと思います。

AGIについて考えるとき、もっと実用的なことをすること、あなたの仕事を行うこと、良い仮想アシスタントとして機能し、人間の仮想アシスタントと同じくらい良く、それを他の多くの仕事に拡張することを考えます。

Dan、私たちが開発しているものについて少し紹介してもらえますか?

より経済的な影響のあるもの、つまりオープンエンドの質問やオープンエンドのタスクについての質問に対応して、AIの実際の経済的影響を見るためのデータを収集しています。

ベンチマークの将来では、HLEで学術界における人間の限界、知的能力の頂点を推論と知識で見ています。しかし、それは彼らの実践的な能力やノウハウとは異なります。これらは経済で非常に影響力のある多くの人々に重要です。彼らは必ずしも最も賢いわけではありませんが、それでも有用です。実際、彼らはしばしば最も賢い人々よりも有用です。

これらの他のスキルを測定することは重要であり、エージェント的なスキル、タスクを実際に達成する能力を通じて測定する予定です。

HLEが非常に高くなり、それがあれば、デジタルタイプのAGIのようなものに見えるでしょう。それは洗濯物をたたんだり、あるいは必ずしも車を運転したりするようなHIIではありませんが、デジタル労働、あるいはリモートワークを通じて行うことができるものに対処するようなものです。それは非常に重要だと思います。

一般的にはAGIの区別を使用しません。それは大きな一枚岩のようなものにぶつかるように聞こえるからです。知能のフロンティアは非常にギザギザで、あるものには優れ、他のものには苦手で、それはおそらく続くでしょう。

しかし、それが経済的に影響力があり、関連性があり、労働市場に潜在的に破壊的であるかどうかの簡略化である限り、HLEは必ずしもそうではないかもしれません。それは学術界と科学の理論的な部分に意味を持つかもしれませんが、後の仕事はより直接的にその労働への影響を測定するでしょう。

AGIのトピックについてもう少し付け加えると、私の個人的な見解では、現在の10%、26%のHLEから完全な仮想AGIに直接移行するわけではありません。仮想世界で経済的に価値のある作業をしようとする非常に有能なAIエージェントが存在し、人間の監督の何らかのバージョンがある期間があるでしょう。

人間が見て、正しいことをしているかどうかを確認します。おそらく人間ができることの80%を自動化していますが、人間が入って作業をレビューする20%があるでしょう。

Danが言っていたように、校正が重要なのはそのためです。最悪のシナリオは、あなたよりも賢いAIがあり、それが非常に自信を持って間違っていて、よく見ると「AIさん、真実を教えてください」と言うと嘘をつき、それが真実を語っているかどうかわからないという状況です。それが最悪のケースシナリオです。

AIが正しいことをするほど良くはありませんが、AIが間違ったことをするが明らかに間違っていて、見たときに「ああ、やり直そう」と思える方がましなシナリオです。それが現在私たちがいる世界です。

AGIについては、AIが多くのことをし、人間がプロセスの一環として大きな役割を果たす中間段階に入ると個人的に思います。

将来の評価の必要性

過去1年で、モデル研究者から聞いたことの一つは、フロンティアモデル開発をサポートするためのより多くの、そしてより良い評価が必要だということです。HLEのリリースを考えると、将来どのような評価が必要だと思いますか?そしてコミュニティから、どのような評価を構築することが最も重要だと聞いていますか?

彼らは何が欲しいのか必ずしも知らないと思います。何か難しいものが欲しいでしょうが、それを本当にうまく言語化できるなら、おそらく彼ら自身で直接構築するでしょう。それがベンチマーク作成の難しさの一部です。

次のパラダイムは何か、あるいは主な活動がどこで起こるかを考え、それを捉えて他の人々に簡単に伝えることができるものを設定することです。そうでなければ、それは感覚的になるか、ある物事が他のものよりも優れていると考える理由を明確に示すことができないため、より「雰囲気」ベースになります。

とはいえ、評価をより良く、あるいは重要にするものについては、いくつかの言葉が投げかけられています。競争や測定する追加の次元として、例えば、オープンエンドのタスクを実行する能力(私たちが取り組んでいるもの)や、より長いコンテキストにわたるタスクを実行する能力、あるいは長いコンテキストのベンチマークなどです。

これらは追跡するための重要で有用なものになると思います。しかし、人々はこれらがより意味のあるものになることを望んでいると思います。一般的に、人々は評価を作成するとき、周囲のベンチマークの意味を見て、同様のことを行います。「常識」は多くの点で偽物のようなものでした。「これは誰もが知っていることを教えてくれているだけで、有用ではない」という感じですが、それでも進歩を追跡するには有用でした。

MLUをリリースしたとき、「これは難しすぎる、何をしているのか」と言われましたが、「いや、これは実際に意味があります。なぜなら、これが向かう方向だからです」と。現在、HLEでは、学術界や多くの科学にとって非常に意味のあるものの端を見ています。しかし、必ずしも経済全体にとってではありません。

後の仕事では、経済的影響を直接見るため、より意味のあるものになるでしょう。それが次のトレンドだと思います。

Scaleの評価における独自の位置づけ

Danが挙げた課題の一部は、オープンエンドのテストや目標テスト、あるいは単に長いコンテキストウィンドウを評価することですが、これらはLLM評価における持続的な課題です。Scaleはこれらの課題に対処するために独自の位置にあると感じていますか?

超ドメイン固有のオープンエンドなタスクを見ている場合、それは特定の分野からの専門知識を必要とし、Scaleは特に多くの専門家を集めることが本当に得意です。仮想的な部屋に集まってもらい、これに貢献してもらうので、答えは間違いなくイエスです。

Danが将来の評価について言及したことに付け加えると、私たちが本当に興味を持っているのは、より実践的な意味でエージェントを評価するのと同じ路線で、より企業のユースケースを見て、これらの非常に実践的なユースケースでモデルとLLMエージェントを評価することです。

私たちがここでフロンティアモデル開発者と行っていることと、実際に現実世界に展開されているAIの量との間には大きなギャップがあります。最も重要な経済活動が行われている場所です。

Scaleはフロンティアラボとのコラボレーションと、大企業と協力する大きなエンタープライズ部門を持ち、彼らのニーズを学び、モデルを見つけ、彼らのためにエージェントを設定し、これらのフロンティアAIをこれらの有用なドメインに応用できるようにする橋渡しとなることに非常に興奮しています。

結び

ありがとうございました。これは本当に興味深い議論でした。「人類の最終試験」のリリースおめでとうございます。ここからどこに向かうのか、私たちは皆本当に楽しみにしています。

素晴らしい、ありがとうございます。

ありがとうございました。

コメント